域泛化(Domain Generalization)解决的问题是如何让从源域数据训练的模型泛化到具有任意数据分布的目标域,对机器学习和模式识别应用具有重要意义。

在过去的十年中,针对解决域泛化问题的方法层出不穷,例如有基于域对齐的方法、基于元学习的方法和基于数据增强的方法等等。

本篇发表于TPAMI2022的综述文章『Domain Generalization: A Survey』详细介绍了域泛化的背景,回顾域泛化领域过去十年的发展历程,以及对域泛化未来的发展方向进行了深度探讨。

在第一章节中,文章简要介绍了域泛化的研究动机并概括了域泛化领域的发展。

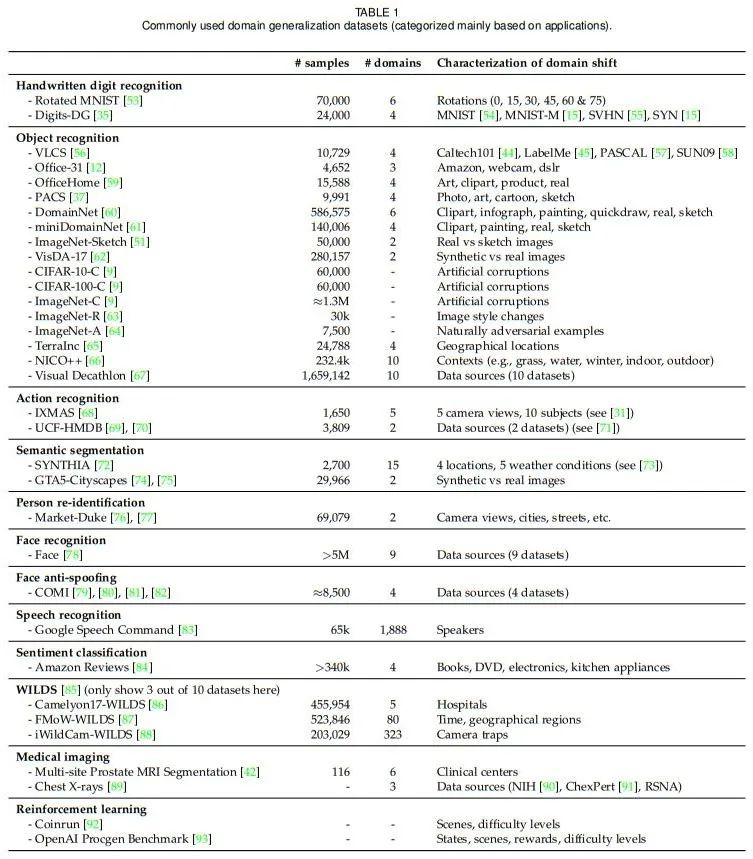

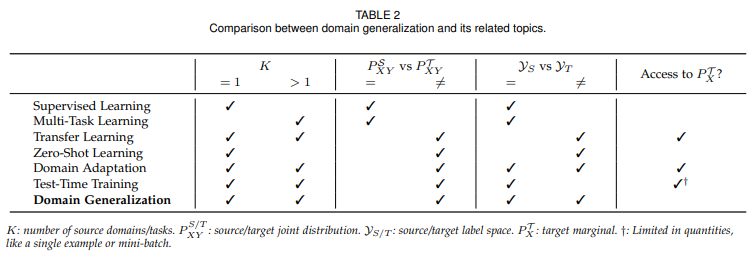

在第二章节中,文章介绍了域泛化的历史,讨论了域泛化这个概念是如何被提起的以及域泛化问题的定义是什么。文章还对常用的域泛化基准数据集进行了整理,并讨论了域泛化和相关领域(如域自适应和迁移学习)的关系。

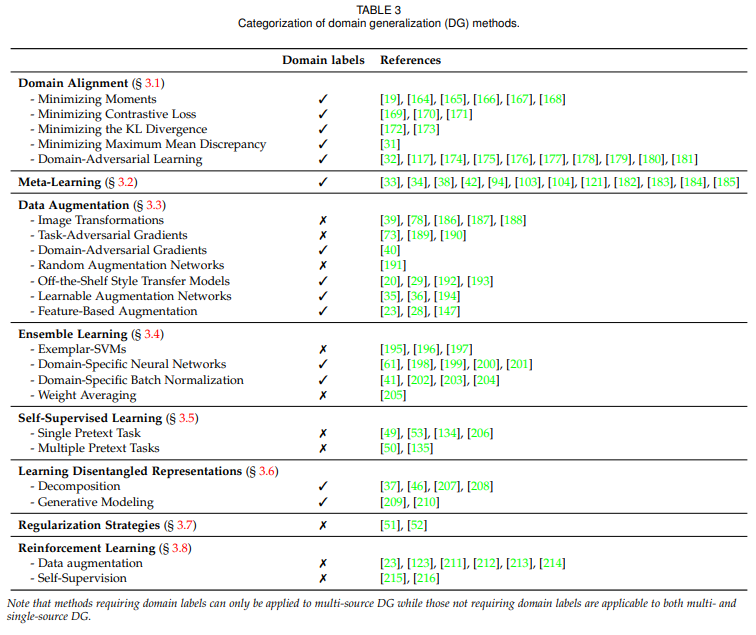

第三章节则是文章的重点。在第三章节中,文章对域泛化领域近十年的方法做了详细分类,包括了域对齐(Domain Alignment)、元学习(Meta-Learning)、数据增强(Data Augmentation)、集成学习(Ensemble Learning)、自监督学习(Self-Supervised Learning)、分解表征学习(Learning Disentangled Representations)、正则化方法(Regularization Strategies)以及强化学习(Reinforcement Learning),并对每一类方法的性质和特点进行了讨论,方便读者能够根据具体问题寻找合适的方法。

在第四章节中,文章简单讨论了域泛化领域的理论研究。

在第五章节中,文章从三个角度展开了对未来发展方向的探讨,即模型架构、学习方法以及基准数据集。

请感兴趣的读者阅读文章原文以及作者整理的域泛化算法代码库。

- 文章链接:https://arxiv.org/abs/2103.02503

- 代码链接:https://github.com/KaiyangZhou/Dassl.pytorch

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢