论文题目:Toward Practical Self-Supervised Monocular Indoor Depth Estimation

论文链接:https://arxiv.org/pdf/2112.02306.pdf

前言

自Facebook改名为Meta后,元宇宙的概念被各种追捧,空间虚拟化作为元宇宙的特性之一,与其相关的AR、VR等应用已经被研究了很多年,而深度估计又是AR/VR中不可或缺的基础技术,这里我们对Meta Reality Labs新鲜出炉的一篇面向室内空间的实用性自监督单目深度估计论文进行解读。

研究动机

当前大多数自监督单目深度估计方法(如MonoDepth,MonoDepth2,DepthHints,ManyDepth等)都专注于自动驾驶场景,并且会在大规模的自动驾驶场景数据集(如KITTI、CityScapes等)上进行训练。而相比于自动驾驶场景,利用自监督学习室内场景的深度更加具有挑战性,主要由以下几个原因:

- 结构先验(structure priors):在自动驾驶场景中进行深度估计时通常会在学习范式中施加一个比较强的场景结构先验,如图像的上面一部分通常是距离较远的天空或建筑物,而下面一部分则通常是由近向远延伸的道路;但是在室内场景中,这种结构先验是很弱的,因为目标往往杂乱无序的排列在近处。

- 深度分布:在自动驾驶场景中,深度的分布在道路上由近到远往往是 比较均匀的;而在室内场景中,深度可以集中分布在或近或远的范围,例如桌子或者天花板的近景,这就给在室内场景中预测准确的度量深度(metric depth)造成挑战。

- 相机位姿:在自动驾驶场景中,由于传感器往往被固定在车辆上,因此其平移往往发生在一个平面上,且其旋转仅仅由航向角控制,即位姿估计只包含了3个自由度(2平移+1旋转);而在室内场景中,传感器可以任意移动,即包含了6个自由度的运动(3平移+3旋转),因此一个理想中的位姿估计网络需要能够应对室内场景中任意的相机姿态和复杂的场景结构。

- 无纹理曲面:在室内场景中存在大量的无纹理区域(如墙面等),这会导致自监督单目深度估计中常用的光度约束产生歧义。

以上原因的存在,使得现有的自监督单目深度估计算法在比较复杂的室内场景中泛化能力较差。

论文贡献

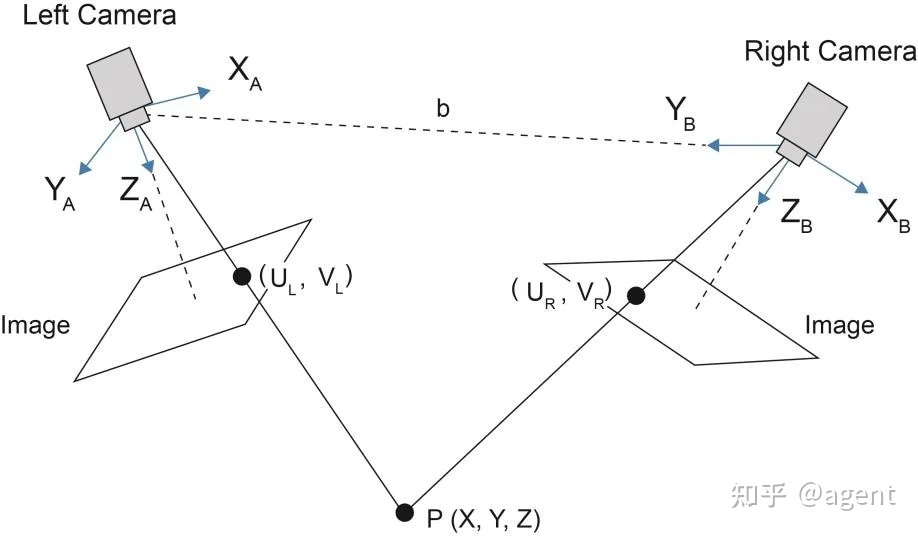

为了提升在复杂室内场景中的深度估计鲁棒性,论文中提出了一种结构蒸馏(structure distillation)的方法——DistDepth,该方法可以从一个预训练过的深度估计模型中学习生成结构化的深度信息,需要注意的是学习到的深度信息是与度量无关的,即其学习到的是相对深度,而不是绝对深度。论文中所提出的蒸馏策略同时考虑了统计意义上的深度结构相似性和空间遮挡边界相似性,使得结构信息可以有效地整合进自监督深度估计模型中。在自监督分支中,还利用左右一致性学习度量信息。最后将二者结合起来,就可以获得室内场景的包含结构化和真实度量的深度信息,并且可以做到实时推理。

另外,论文中还收集了两组数据集:SimSIN数据集是从上千个仿真环境中获取到的;而UniSIN数据集则包含了500组现实场景下室内环境的扫描序列。基于所收集的数据集,论文通过一系列实验提供了覆盖方法、数据和应用的全面研究方案。

最终,论文证明了所提出的面向实际应用的室内场景深度估计模型可以在无需精确的深度真值标注的情况下,仅仅通过在仿真器中高效地采集数据,就可以拥有强的泛化能力,同时其深度感知的精度高,且推理的实时性强。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢