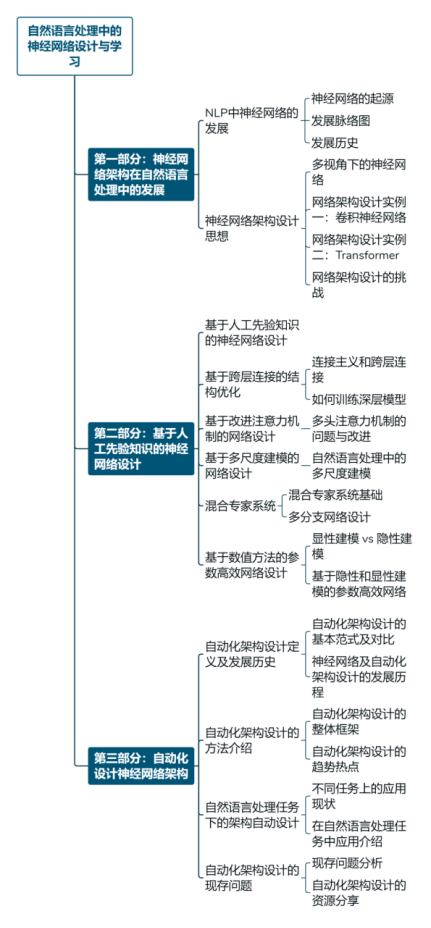

神经网络技术是现代人工智能的关键技术,在自然语言处理、图像处理等领域表现出优异效果。来自东北大学自然语言处理实验室、小牛翻译团队的肖桐教授、博士生李垠桥、李北在CCMT 2022会议所进行的《自然语言处理中的神经网络设计与学习》演讲报告,从神经网络架构在自然语言处理中的发展、人工神经网络设计和自动化架构设计三个方面对该领域技术发展进行了全面梳理,同时也对方向的未来发展进行了分析和探讨。

近些年来,人工神经网络方法已经成为了自然语言处理中最重要的范式之一。但是,大量依赖人工设计的神经网络结构,导致自然语言处理领域的发展很大程度依赖于神经网络结构上的突破。由于神经网络结构设计大多源自研究人员的灵感和大量经验性尝试,如何挖掘这些神经网络结构背后的逻辑,如何系统化的思考不同神经网络结构之间的内在联系,是使用这类方法时所需要深入考虑并回答的问题。甚至,可以想象,让计算机自动设计神经网络架构,也可以成为进一步突破人类思维限制的方向之一。

在《自然语言处理中的神经网络设计与学习》中,讲者们根据自身研究经验对上述问题进行了回答,对神经网络架构的基本发展脉络、常用的神经网络架构的设计理念进行分析,同时对神经网络架构的自动设计方法进行整理。这些内容可以为相关研究者供模型架构设计上的一些思路,以及实践中的参考。同时,讲者在分享中也呼吁研究者更多地以系统化的思考方式来看待神经网络方法在自然语言处理中的应用,而非简单像“黑盒”一样使用它们。

感兴趣的小伙伴可以复制以下链接,进入机器翻译学堂网站查看详细讲解文章。

第一部分:https://school.niutrans.com/qualityArticleInfo?id=278

第二部分:https://school.niutrans.com/qualityArticleInfo?id=279

第三部分:https://school.niutrans.com/qualityArticleInfo?id=280

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢