不知不觉,AI技术的渗透,已经开始超出人们的想象。

去医院照个CT,都有AI作为双重保障,通过视频画面动作识别,确定病人在进入机器前已经得到有效保护。

还有流水线产品是否有瑕疵,公共场所人们是否戴了口罩,工人是否佩戴安全帽、后厨是否达到“明厨亮灶”、应急通道是否有违停车辆等生产、生活中常见的场景,也都已经在用AI来识别检测了。

更让人意想不到的是,如上千差万别的场景,可以只用一个预训练大模型来搞定。

而且不用收集大量样本数据集,零数据即可启动、小样本就能调优。

仅需半个月,就可以完成模型训练并投入使用。

要知道,在传统算法训练模式下,一般是“一套算法对应一个场景”,换个识别对象,就需要重头收集样本数据、开发训练了。

这就导致一套算法上线,往往是几个月的长战线模式,背后需要投入很高的人力物力成本。

而在数字化改革的浪潮下,千行百业涌现出越来越多的细小场景,传统“一套算法对应一个场景”的算法训练模式遇到前所未有的挑战。

在此需求和背景下,用一个算法模型就能解决所有场景问题无疑是一剂解决问题的良方,那到底是谁率先拿出了可以“单挑”1000万个场景组合的预训练大模型?

又为什么会在此刻走入我们的视野?

AI 2.0时代开启,行业玩家技术路线已备好

这可以从基础设施、行业需求两个方面来解答。

首先在基础设施上,我国构建的视频大数据系统经比较完善。

目前,全国几亿台摄像设备,可以构成一个空前巨大的视频大数据库。

但是这些设备中,仅有20%是智能的。

这意味着收集到的海量数据,实际被应用的并不多。

而且其中的大部分算法,都集中在人脸识别、车牌识别等高频应用场景上。

在低频场景中能识别的对象非常少,准确性也不够高。

与此同时,当AI发展步入深水区后,各行各业对于视觉识别的需求越来越高,碎片化场景扎堆涌现。

也就是第二方面影响因素——行业需求。

正如开头提到的诸多场景,如后厨、CT室、施工现场等,在数字化浪潮的驱动下,这些细小场景也都迫切寻求智能化支持,它们共同组成了一个占比80%的长尾场景。

问题在于,这些细小场景自身特点鲜明,很难用一个训练好的算法一网打尽。

比如后厨需要识别灶台上东西的摆放是否正确,工地则需要识别工人是否佩戴安全帽。在识别对象类型、物体属性、关系和行为上,这两个场景几乎没有共同之处。

如果使用传统的“烟囱式”算法平台呢?

可行性并不高。

可以用城市管理的场景举例说明。

它最大的特点就是碎片化,从马路牙子是否有破损、树木是否倒伏、车辆是否违停到窨井盖是否缺失等,几乎场景内每一个点,都是一个定制化需求。

如果使用传统算法模式,算法厂商需要根据每一个点来设计算法,单个算法的费用可能就会高达几十万。

而且还需要需求方自己去采集样本图片包,采集量少则几千,多则几万张。

然后算法公司才能拿着这些图片去训练算法,整个开发周期可能长达几个月,最后才能实现交付。

假如训练出的算法不够好,还要继续再次进行迭代,可能又要等一个多月的时间才能再次交付。

这样的时间成本、金钱成本,客户是难以承担的。

但与此同时,当AI发展步入深水区后,各行各业对于视觉识别的需求越来越高,碎片化场景在扎堆涌现。

显然要解决这样的碎片化场景的应用,必须要寻找一条新的技术路线。

在这样的背景下,预训练大模型技术横空出世。

预训练大模型从根本上改变了人工智能的技术逻辑,意味着“作坊式”模式的终结,“AI工业化”模式的到来,是开启人工智能2.0时代的具有里程碑意义的技术变革!

人工智能1.0 时代,对每一个识别的场景(目标)都要训练一个对应的算法模型,每个模型的训练都要有大量的样本并标注,也就是“一套算法对应一个场景”。

人工智能2.0时代,通过海量数据进行预训练形成一个具有通识能力的大模型,以“大规模预训练﹢微调”范式满足多元化需求,也就是“1个模型适用N个场景”。

去年,随着美国Open-AI 公司的GPT-3预训练大模型的发布,海量数据预训练对算法能力的提升肉眼可见,从而在人工智能领域掀起一股热潮,俨然成为一个新的赛道。

联汇科技,从预训练大模型赛道上跑出来的一匹黑马。

联汇科技是国内最早自主研发大规模预训练算法模型的公司之一。

同时联汇科技还发布了首款基于视觉语言预训练大模型的OmVision视觉认知平台,为视觉智能产业提供了全新的AI视觉认知基础工具平台。

OmModel——业界领先的多模态预训练大模型

OmModel是业界领先的多模态预训练大模型。

它通过大规模自监督学习的多模态人工智能算法,融合语言和视觉模态理解,完成基于行业的亿级图片、万级视频、十亿级图文大规模预训练,实现用更小的标注样本数量,融合更多的模态信息,获得更为精准的视觉AI模型,从而实现了本文开头描述的一个模型应对千万种场景的超强能力。

OmModel预训练大模型提供了具有超强通识能力的解决方案,以“预训练大模型+下游任务微调”的方式,有效地从大量标记和未标记的数据中捕获知识,解决模型通用性差的问题,极大地扩展了模型的泛化能力,使模型更加“融会贯通”、“举一反三”。

同时,随着数据规模和模型规模的不断增大,模型精度也将得到进一步提升。

联汇科技首席科学家赵天成博士表示:

高门槛、高成本一直是人工智能产业化落地的最大障碍。

而人工智能的最终目的是要能为百行千业赋能,这就要求人工智能的应用落地门槛要足够低,成本也要控制在合适的范围内。

现在我们找到了解决这个问题的钥匙,就是通过预训练大模型,重新定义算法的生产流程,用一个算法模型搞定千万种场景,解决大量碎片化应用场景的问题,让人工智能更易用,实现真正的普惠AI,用“普惠AI+行业”的融合创新赋能更多企业与用户。

OmModel预训练大模型是预先用海量多模态数据,通过自监督训练出一个对生活中大多数人、物、行为、属性等具有强大通识认知能力的认知模型。

OmModel预训练大模型目前具有20000多种目标、300多种属性、200多种行为的强大通识能力,到年底更可以达到50000多种识别目标。

而且它还具有强大的文字语言理解能力,我们可以通过文字描述,对拟识别的场景进行定义,通过目标、属性、行为三要素的灵活搭配组合,就可以生成千万种不同功能的算法应用;彻底打破了传统视觉识别算法“样本采集、样本标注、训练调参”的生产模式。

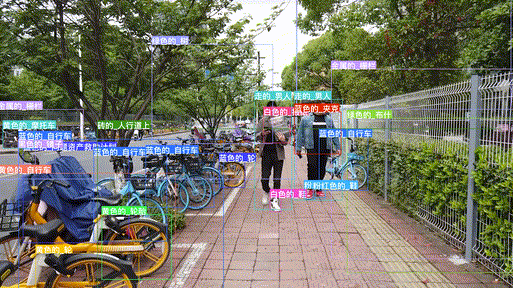

比如在城市管理的场景下,OmModel可以自动识别道路上几乎一切对象,树木、人、自行车、人的动作等都能搞定。

当我们要生成一个算法的时候,只要输入相应的文字描述即可。

如“骑自行车的男人”或者“道路上的垃圾”就可以马上生成相应的算法。

而且,用预训练大模型,能够通过更少的参数量,实现和行业知名大模型同等或者更好的性能。

平均算法模型的识别精准度可以提高40%,而训练数据量可以降低90%。

开发周期由平均几个月缩短为几天,还可以拥有更快的推理速度,从而有效覆盖大量长尾应用场景。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢