今天给大家介绍的是来自UCLA的孙怡舟教授团队和Snap公司联合发表在NeurIPS 2022上的文章"Explaining Graph Neural Networks with Structure-Aware Cooperative Games"。研究GNN的可解释性,有助于提高人们对模型的信任程度,并促进模型的进一步改进。目前已有多种GNN解释方法被提出,其中博弈论中的Shapley值法已被运用到多个解释模型中。然而,本文认为Shapley值法并不具备结构感知性,即在进行解释时,该方法默认图中的每一个节点都可以与其他任一节点产生交互,且不同节点间产生交互的机会是均等的,这不符合图结构数据的消息传递机制。因此,针对图分类任务,本文提出一种结构感知的GNN解释方法GStarX,利用图的结构信息来改进解释。实验证明,GStarX在不同图分类任务数据集上的解释效果优于现有最先进的模型。

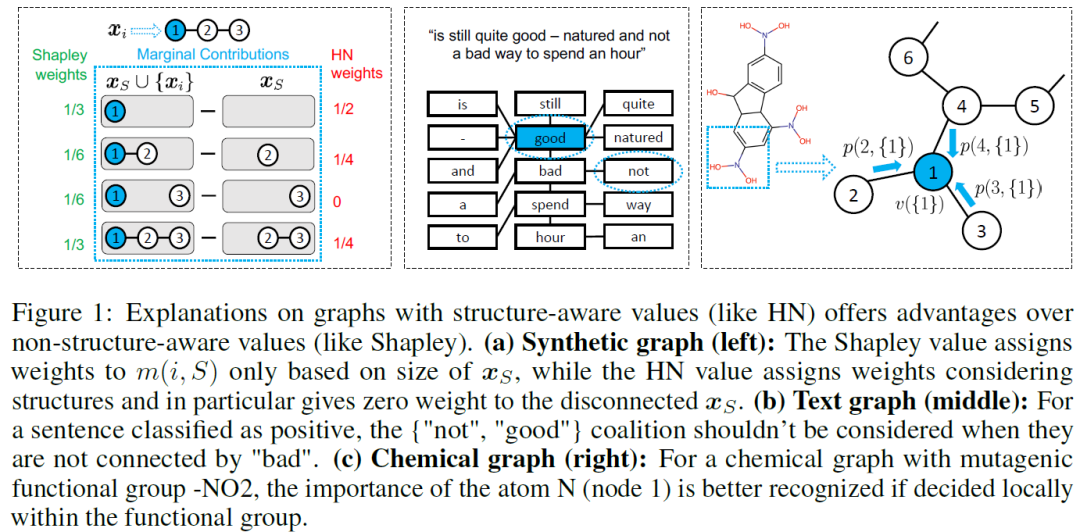

本文首先介绍了合作博弈和基于子图的GNN解释方法这两类概念,接着提出了合作博弈的HN值法并基于此设计了能够捕获图结构信息的GNN解释方法GStarX。为便于后续理解,图1给出3个实例:

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢