文本引导的图像生成模型火了,同时带火的还有用文本提示对图像进行修改的模型。

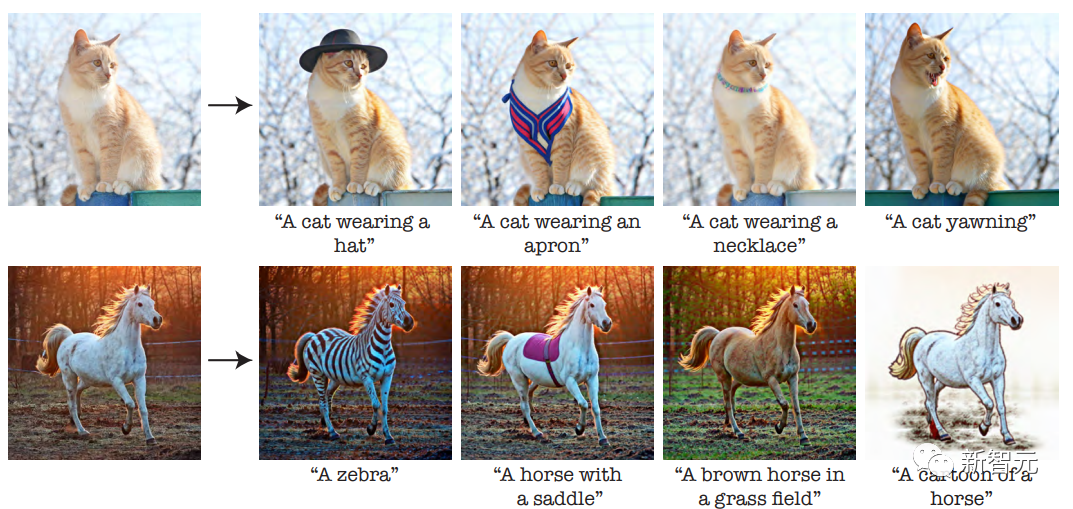

比如已经有了一张照片或者是生成的图片,想要给图片中的猫加个帽子,或者给人物换个姿势、图像换个风格,用文字命令的形式输入到模型中,这个过程就叫基于文本的图像编辑(Text-Based Image Editing)。

本文将为大家介绍两个时下最新的「图像编辑」工具。

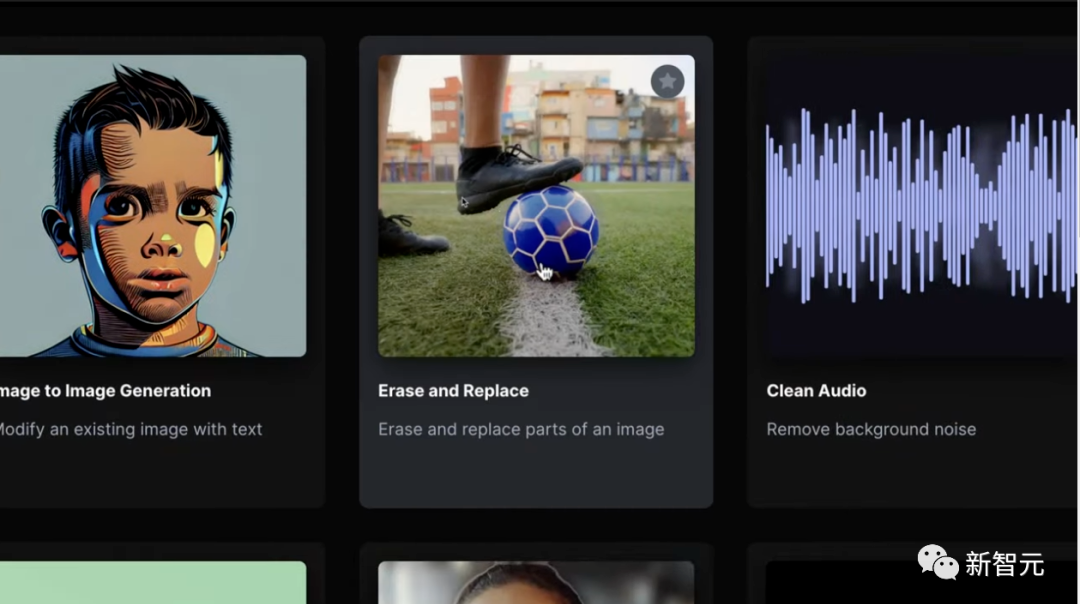

第一个是浏览器中在线就能用的Runway,其内置在AI Magic Tools下的「Erase and Replace」功能也是刚刚上线。

网站地址:https://runwayml.com/

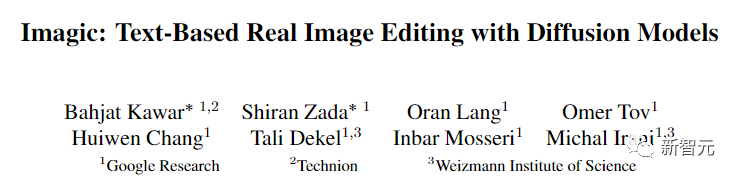

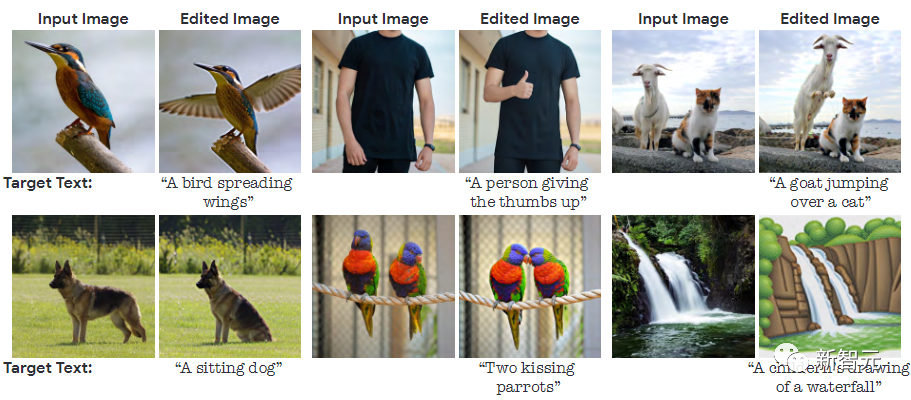

第二个则是Google Research最近联合魏茨曼科学研究所发布的新模型Imagic,首次实现了应用于单一真实图像复杂的(非刚性的)语义编辑能力。

论文地址:https://arxiv.org/pdf/2210.09276.pdf

相比以往的方法限于特定的编辑类型(如物体叠加、风格转移)、仅适用于合成图像、或者需要一个物体的多张输入图像,Imagic可以改变图像中一个或多个物体的姿势和构成,同时保留其原始特征,比如让一只站立的狗坐下、跳起来,让鸟张开翅膀等等。

Stable Diffusion提供的重渲染功能每次编辑都会改变图像中其他的重要元素,所以老手们不得不再使用Photoshop修复丢失元素,而Imagic的处理结果更好(显然不利于Photoshop的推广)。

顺带一提,就在Imagic发布的6个小时后,就被自家兄弟砸了场子。

左为Imagic,右为UniTune

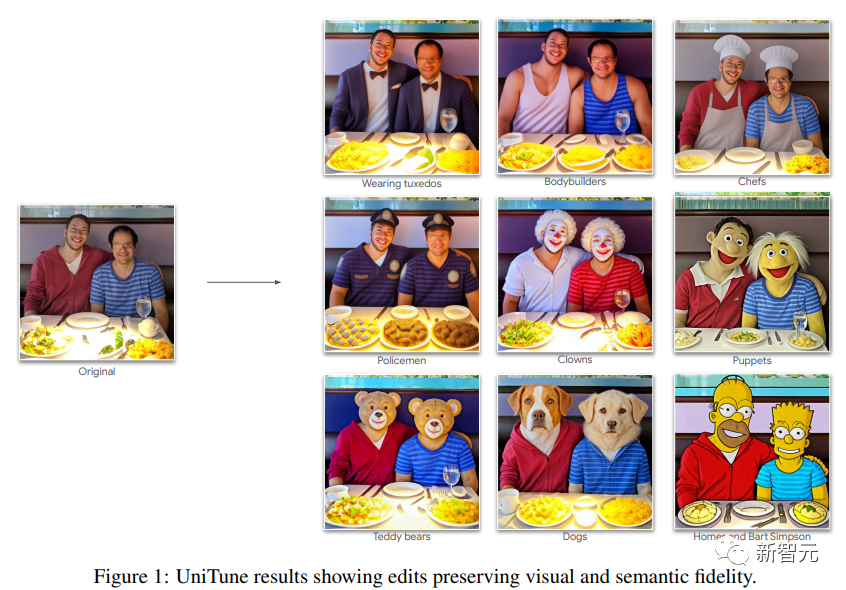

Google Research的第二篇论文中提出的模型UniTune同样是在单张图像通过文本对图像进行编辑。

论文地址:https://arxiv.org/pdf/2210.09477.pdf

UniTune方法的核心是,通过正确的参数选择,可以在单个图像上对大型文本到图像的扩散模型(文中使用Imagen)进行微调,促使模型保持对输入图像的保真度,同时允许用户进行转换操作。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢