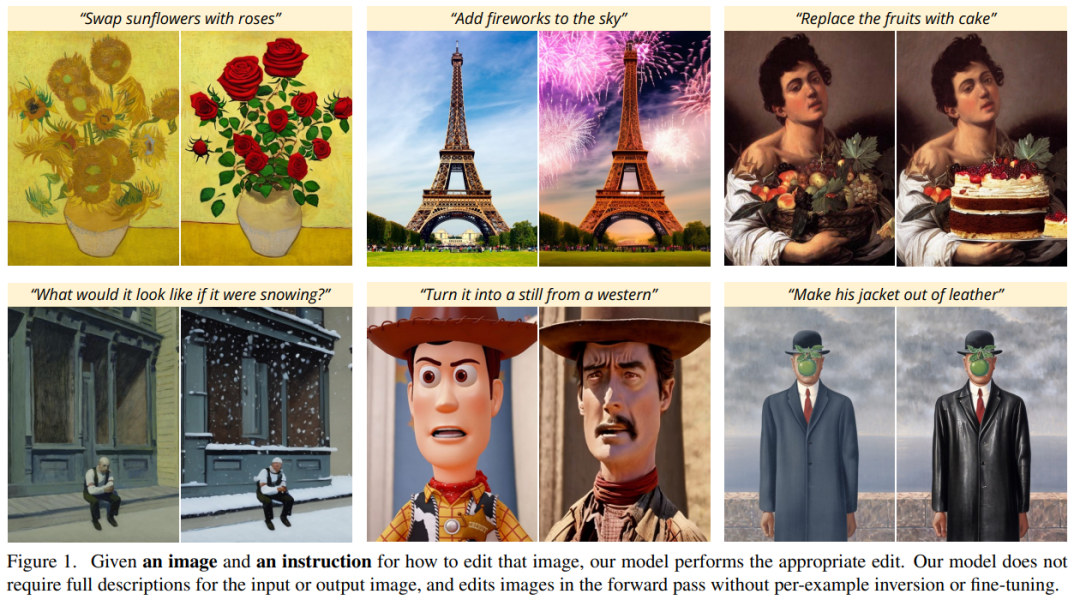

最近,来自 UC 伯克利的研究团队提出了一种根据人类指令编辑图像的新方法 InstructPix2Pix:给定输入图像和告诉模型要做什么的文本描述,模型就能遵循描述指令来编辑图像。

论文地址:https://arxiv.org/pdf/2211.09800.pdf

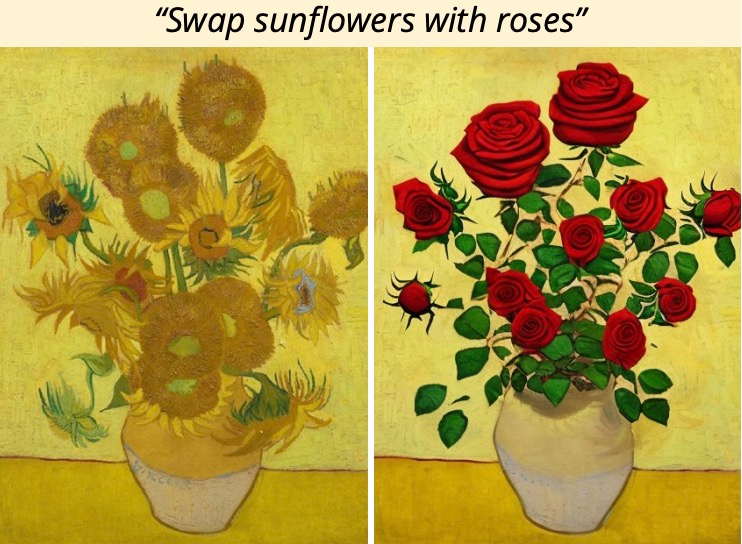

例如,要把画中的向日葵换成玫瑰,你只需要直接对模型说「把向日葵换成玫瑰」:

为了获得训练数据,该研究将两个大型预训练模型——语言模型 (GPT-3) 和文本到图像生成模型 (Stable Diffusion) 结合起来,生成图像编辑示例的大型成对训练数据集。研究者在这个大型数据集上训练了新模型 InstructPix2Pix,并在推理时泛化到真实图像和用户编写的指令上。

InstructPix2Pix 是一个条件扩散模型,给定一个输入图像和一个编辑图像的文本指令,它就能生成编辑后的图像。该模型直接在前向传播(forward pass)中执行图像编辑,不需要任何额外的示例图像、输入 / 输出图像的完整描述或每个示例的微调,因此该模型仅需几秒就能快速编辑图像。

尽管 InstructPix2Pix 完全是在合成示例(即 GPT-3 生成的文本描述和 Stable Diffusion 生成的图像)上进行训练的,但该模型实现了对任意真实图像和人类编写文本的零样本泛化。该模型支持直观的图像编辑,包括替换对象、更改图像风格等等。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢