论文标题: LAS-AT: Adversarial Training with Learnable Attack Strategy

收录会议: CVPR 2022

代码链接: https://github.com/jiaxiaojunQAQ/LAS-AT

许多先前工作证明,深度神经网络(DNN)的许多实际应用都很容易受到对抗样本(AE)的影响,如图像分类、物体检测、机器翻译等。为了解决该问题,有许多相关的防御方法被提出。其中,对抗训练(AT)被认为是最有效的防御方法之一。对抗训练经常被建模为求解一个min-max问题,而对抗样本的生成是求解该问题的关键。以前的研究工作大多采用投影梯度下降法(PGD),并手动指定攻击参数来生成AE,这些攻击参数的组合可被视为攻击策略。目前的方法主要存在以下两个问题:

1)大多数现有的方法仅利用手工制定的攻击策略来生成AE,即仅使用固定的攻击策略来生成AE,限制了模型的鲁棒性;

2)大多数方法只使用一种攻击策略,而目前已有研究指出在对抗训练的不同阶段中使用固定的攻击策略会使得模型的鲁棒性受限。

在本文中,我们通过引入“可学习的攻击策略”,即LAS-AT,提出了一个新颖的对抗训练框架,它可以学习自动产生攻击策略以提高模型的鲁棒性。

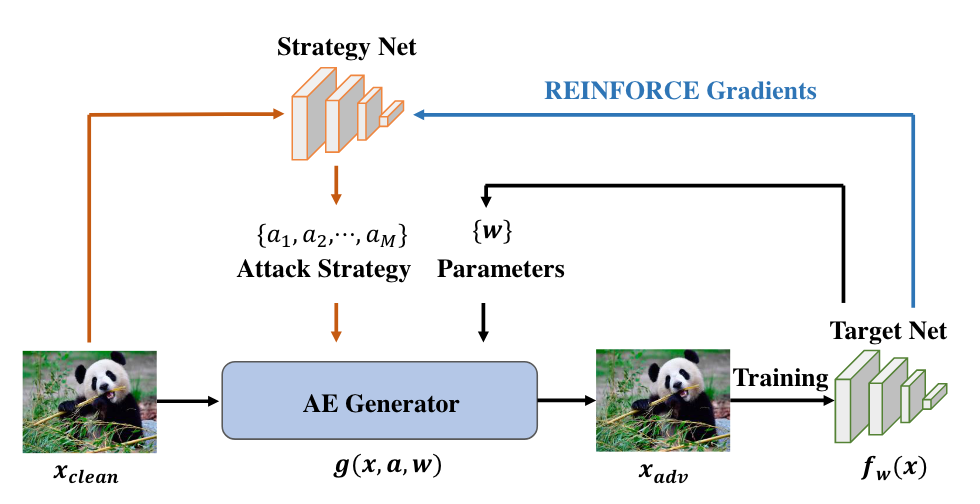

LAS-AT方法的总体框架如图所示:

LAS-AT框架图:它由一个策略网络和一个目标网络组成。这两个网络是具有竞争关系的。对于策略网络,在给定一个干净的图像时,策略网络会生成一个对应的针对该样本的攻击策略;对于目标网络,AE生成器会根据攻击策略和目标网络来生成一个AE,用于训练目标网络。同时,目标网络也会分别给予AE生成器和策略网络一个监督信号。

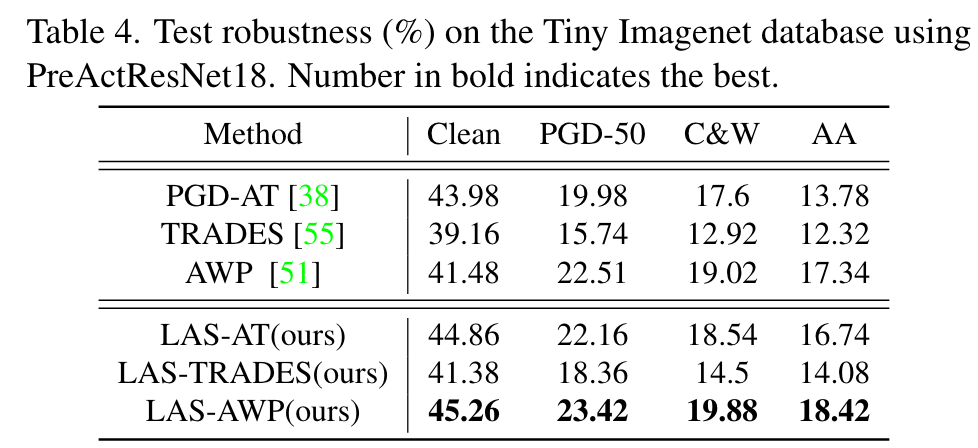

Tiny-ImageNet结果:

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢