AIGC(人工智能生成内容)目前是 AI 领域最热门的话题之一,还被 Science 评为 2022 年度十大科学突破。短短数月,爆红 AI 圈的 Stable Diffusion 已升级到 2.0 版本。高昂的成本也一定程度上限制了 AIGC 产业的大规模普及。以 Stable Diffusion 为例,其背后的 Stability AI 维护超过 4000 个英伟达 A100 的 GPU 集群,并已为此支出超过 5000 万美元的运营成本。面对快速迭代的模型、算法和下游任务,如何降低应用成本成为 AIGC 真正走向落地的核心问题。

作为当下最火热的开源 AI 大模型解决方案,Colossal-AI 已收获 Github Star 七千多颗,此前在 Stable Diffusion、GPT-3、AlphaFold 等大模型上展现卓越性能优势。针对 AI 大模型落地成本高昂这一痛点,Colossal-AI 本次更新聚焦于降低大模型应用成本以及增强易用性,包括:

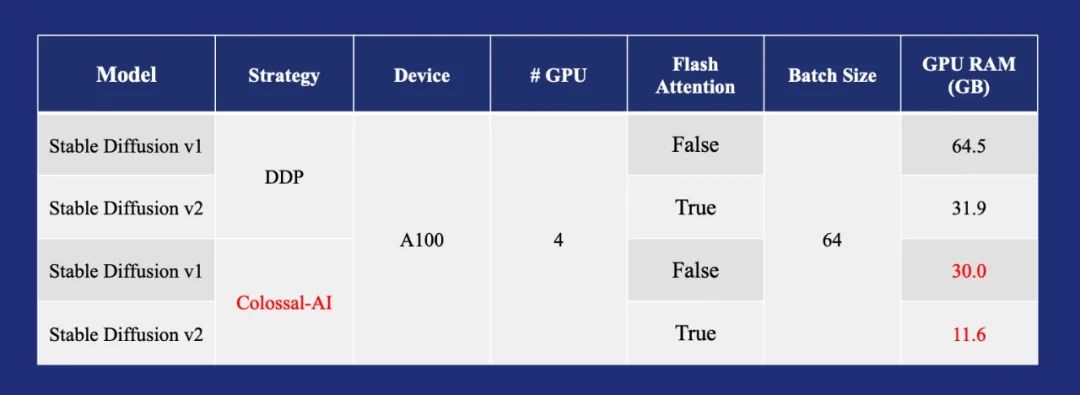

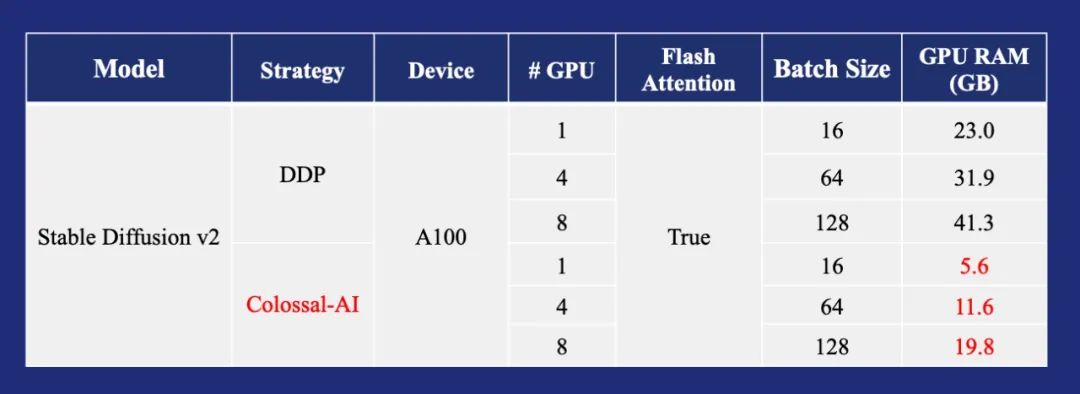

- Stable Diffusion 2.0 低成本训练 / 微调 / 推理,最多可降低显存消耗 5.6 倍,使硬件成本直降 46 倍,一行代码即可使用;

- 1750 亿参数 BLOOM 模型单机推理,显存消耗降低 4 倍,使硬件成本降低 10 余倍;

- 一行代码实现自动搜索最佳并行策略,显著降低分布式训练上手门槛,原生支持 Hugging Face,Timm 等热门 AI 模型库。

开源地址:https://github.com/hpcaitech/ColossalAI

Stable Diffusion 2.0 基于简单易用的 PyTorch Lightning 框架搭建。作为 PyTorch Lightning 的官方大模型解决方案,Colossal-AI 在第一时间跟进,开源了更为高效,硬件门槛更低的全套训练 / 微调 / 推理方案:

-

可减少训练显存消耗 5.6 倍,硬件成本最高降低 46 倍;

-

支持 DreamBooth 单 GPU 快速个性化微调;

-

推理显存消耗降低 2.5 倍。

该方案也将于近期合并进入当下最火热的 AI 模型社区 Hugging Face,进一步方便用户使用。

Colossal-AI 通过一系列显存优化技术和支持 Stable Diffusion 2.0,使 Stable Diffusion 平均在每个 GPU 上使用大 batch size 16 训练的显存需求从 64.5GB 降低 5.6 倍至 11.6GB,还可扩展至单 GPU 或多 GPU 并行。相比使用最先进的 A100 80GB,目前仅需 3060 等消费级显卡即可满足需求,硬件成本最高直降 46 倍。更多用户可以在消费级 GPU 上,低成本地开展 Stable Diffusion 的相关研究与应用落地。

面向大模型时代的通用深度学习系统 Colossal-AI,可实现高效快速部署 AI 大模型训练和推理,降低 AI 大模型应用成本。自开源以来,Colossal-AI 已经多次在 GitHub 热榜位列世界第一,获得 GitHub Star 超七千颗,并成功入选 SC、AAAI、PPoPP 等国际 AI 与 HPC 顶级会议的官方教程。

Colossal-AI 相关解决方案已成功在自动驾驶、云计算、零售、医药、芯片等行业知名厂商落地应用,广受好评。例如,近期火爆的 ChatGPT 尚未开源,且不具备联网功能。Colossal-AI 已成功帮助某世界 500 强企业,开发具备在线搜索引擎能力增强的聊天机器人模型。

参考链接:

https://www.hpc-ai.tech/blog/colossal-ai-0-2-0

阅读更多请点击这里

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢