随着DALL-E 2,Stable Diffusion等图像生成模型的发布,text-to-image模型生成的图像在分辨率、质量、文本忠实度等方面都得到了飞跃性提升,极大促进了下游应用场景的开发,但相关研究表明,目前的生成模型技术仍然存在一个重大缺陷:无法在图像中呈现出可靠的视觉文本。

有研究结果表明,DALL-E 2在图片中生成连贯文本字符上非常不稳定,而最新发布的Stable Diffusion模型则是直接将「无法呈现可读的文本」列为已知的限制。

字符拼写错误:(1) California: All Dreams Welcome, (2) Canada: For Glowing Hearts, (3) Colorado: It’s Our Nature, (4) St. Louis: All Within Reach.

最近Google Research发布了一篇新论文,试图了解并提高图像生成模型渲染高质量视觉文本的能力。

论文链接:https://arxiv.org/abs/2212.10562

研究人员认为当下的text-to-image生成模型模型存在文本渲染缺陷的主要原因是缺乏字符级的输入特征。

为了量化该输入特征在模型生成中的影响,文章中设计了一系列控制实验对是否包含文本输入特征的文本编码器(character-aware和character-blind)进行对比。

研究人员发现,在纯文本领域,character-aware模型在一个新的拼写任务(WikiSpell)上获得了很大的性能收益。

将该经验迁移到视觉领域后,研究人员训练了一套图像生成模型。实验结果表明character-aware模型在一系列新的文本渲染任务(DrawText基准)中比character-blind更胜一筹。

并且character-aware模型在视觉拼写方面达到了更高的技术水平,尽管训练的样例数量少得多,其在不常见的单词上的准确率仍然比竞争模型高出30多个百分点。

Character-Aware模型

语言模型可分为直接访问构成其文本输入字符的character-aware模型和无法访问的character-blind模型。许多早期的神经语言模型直接在字符上进行操作,而不使用多字符的token作为标记。

后来的模型逐渐转向基于词汇表的tokenization,其中一些模型如ELMo仍然保留了character-aware,但其他模型如BERT则放弃了字符特征以支持更有效的预训练。

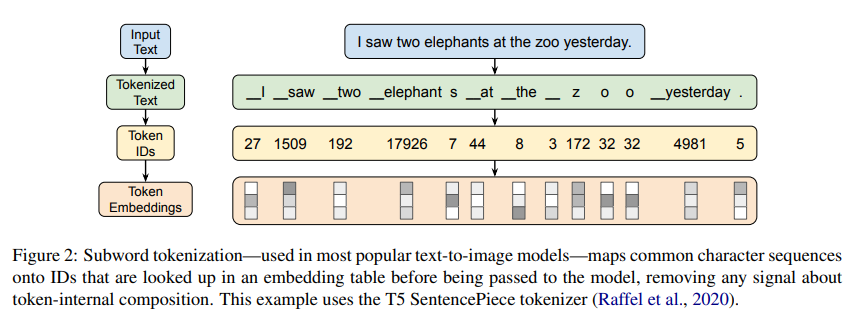

目前,大多数广泛使用的语言模型是character-blind的,依靠数据驱动的子词(subword)分割算法,如字节对编码(BPE)来生成子词pieces作为词汇表。

虽然这些方法对于不常见的序列可以退回到字符级表示,但它们在设计上仍然会将常见的字符序列压缩成不可分割的单元。

这篇论文的主要目的是试图了解并提高图像生成模型渲染高质量视觉文本的能力。为此,研究人员首先孤立地研究了当下文本编码器的拼写能力,从实验结果可以发现,尽管character-blind文本编码器很受欢迎,但它们没有收到关于其输入的字符级构成的直接信号,导致其拼写能力有限。

研究人员还测试了不同规模、架构、输入表示、语言和调整方法的文本编码器的拼写能力。

这篇论文首次记录了character-blind模型通过网络预训练诱导出强大的拼写知识(准确率>99%)的神奇能力,但实验结果表明这项能力在英语之外的语言中并没有得到很好的泛化,而且只有在超过100B参数的规模下才能实现,所以对于大多数应用场景是不可行的。

另一方面,character-aware的文本编码器能够在更小的尺度上实现强大的拼写能力。在将这些发现应用于图像生成场景时,研究人员训练了一系列character-aware的文本到图像的模型,并证明它们在现有的和新的文本渲染的评估中明显优于字符盲目的模型。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢