作者:Xu Gu, Yuchong Sun, Feiyue Ni, 等

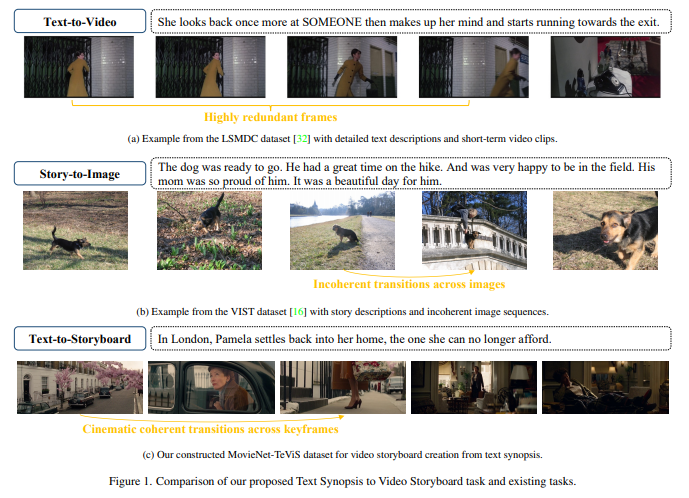

简介:本文研究Text-to-Video Generation领域的文本生成故事板任务。故事板是视频创作的路线图,它由逐个镜头的图像组成,以可视化文本概要中的关键情节。然而,创建视频故事板仍然具有挑战性,这不仅需要高级文本和图像之间的关联,还需要长期推理以使镜头之间的过渡平滑。在本文中,作者提出了一项称为文本概要到视频故事板 (TeViS) 的新任务,旨在检索有序的图像序列以可视化文本概要。作者基于公共 MovieNet 数据集构建了 MovieNet-TeViS 基准。它包含 10K 文本概要,每个文本概要都与关键帧配对,这些关键帧是通过考虑相关性和电影连贯性从相应电影中手动选择的。作者还为该任务提供了一个编码器-解码器基线。该模型使用预训练的视觉和语言模型来改进高级文本图像匹配。为了提高长镜头的连贯性,作者进一步建议在没有文本的大型电影帧上对解码器进行预训练。实验结果表明:作者提出的模型在创建与文本相关且连贯的故事板方面明显优于其他模型。

论文下载:https://arxiv.org/pdf/2301.00135.pdf

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢