作者:Chaoqi Zhen , Yanlei Shang , Xiangyu Liu ,等

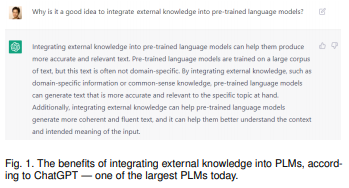

简介:本综述提供了快速发展的“知识增强型预训练语言模型”领域当前进展的全面视图。通过使用 BERT 等预训练语言模型 (PLM),自然语言处理 (NLP) 发生了革命性变化。尽管在几乎每一个 NLP 任务中都创造了新记录,但 PLM 仍然面临着许多挑战,包括可解释性差、推理能力弱,以及在应用于下游任务时需要大量昂贵的注释数据。通过集成外部知识增强型预训练语言模型(KEPLM),将具有潜力以克服上述限制。在本文中,作者通过一系列研究系统地检查了 KEPLM。具体来说,作者概述了要集成到 KEPLM 中的常见类型和不同格式的知识,详细介绍了构建和评估 KEPLMS 的现有方法,介绍 KEPLM 在下游任务中的应用,并讨论未来的研究方向。通过快速全面地了解该领域的最新发展,研究人员将从这项调查中受益。

论文下载:https://arxiv.org/pdf/2212.13428.pdf

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢