作为人工智能领域「暴力美学」的代表作,GPT 可谓是出尽风头,从诞生之初的 GPT 1.17 亿参数,一路狂飙到 GPT-3 1750 亿参数。随着 GPT-3 的发布,OpenAI 向社区开放了商业 API,鼓励大家使用 GPT-3 尝试更多的实验。然而,API 的使用需要申请,而且你的申请很有可能石沉大海。

为了让资源有限的研究者也能体验一把玩大模型的乐趣,前特斯拉 AI 负责人 Andrej Karpathy 基于 PyTorch,仅用 300 行左右的代码就写出了一个小型 GPT 训练库,并将其命名为 minGPT。这个 minGPT 能够进行加法运算和字符级的语言建模,而且准确率还不错。

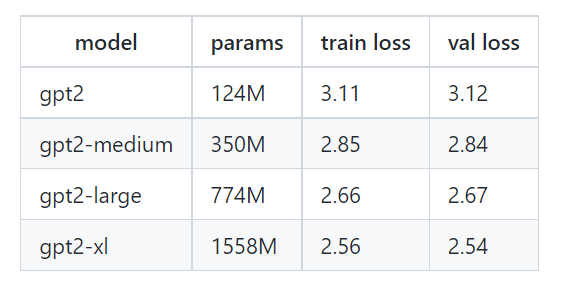

时隔两年,minGPT 迎来更新,Karpathy 又上线新版本,并命名为 NanoGPT,该库用于训练和微调中型大小的 GPT。上线短短几天,狂揽 2.5K 星。

项目地址:https://github.com/karpathy/nanoGPT

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢