来自今天的爱可可AI前沿推介

[LG] StitchNet: Composing Neural Networks from Pre-Trained Fragments

S Teerapittayanon, M Comiter, B McDanel, H.T. Kung (2023)

StitchNet: 用预训练片段创建高性能神经网络

要点:

-

StitchNet 范式:一种通过组合多个预训练网络的片段来创建高性能神经网络的方法; -

在评估片段的可组合性时,采用居中内核对齐(CKA)的新方法; -

提出用于线性层和卷积层的可组合片段的组合技术。

一句话总结:

StitchNet 是通过结合多个预训练网络的片段来创建高性能神经网络的方法,用居中内核对齐(CKA)来评估兼容性并指导选择。StitchNets 可以在较少的计算和数据资源的情况下实现与传统训练网络相当的精度,并可用于即时个性化模型创建和推理效率的提升。

摘要:

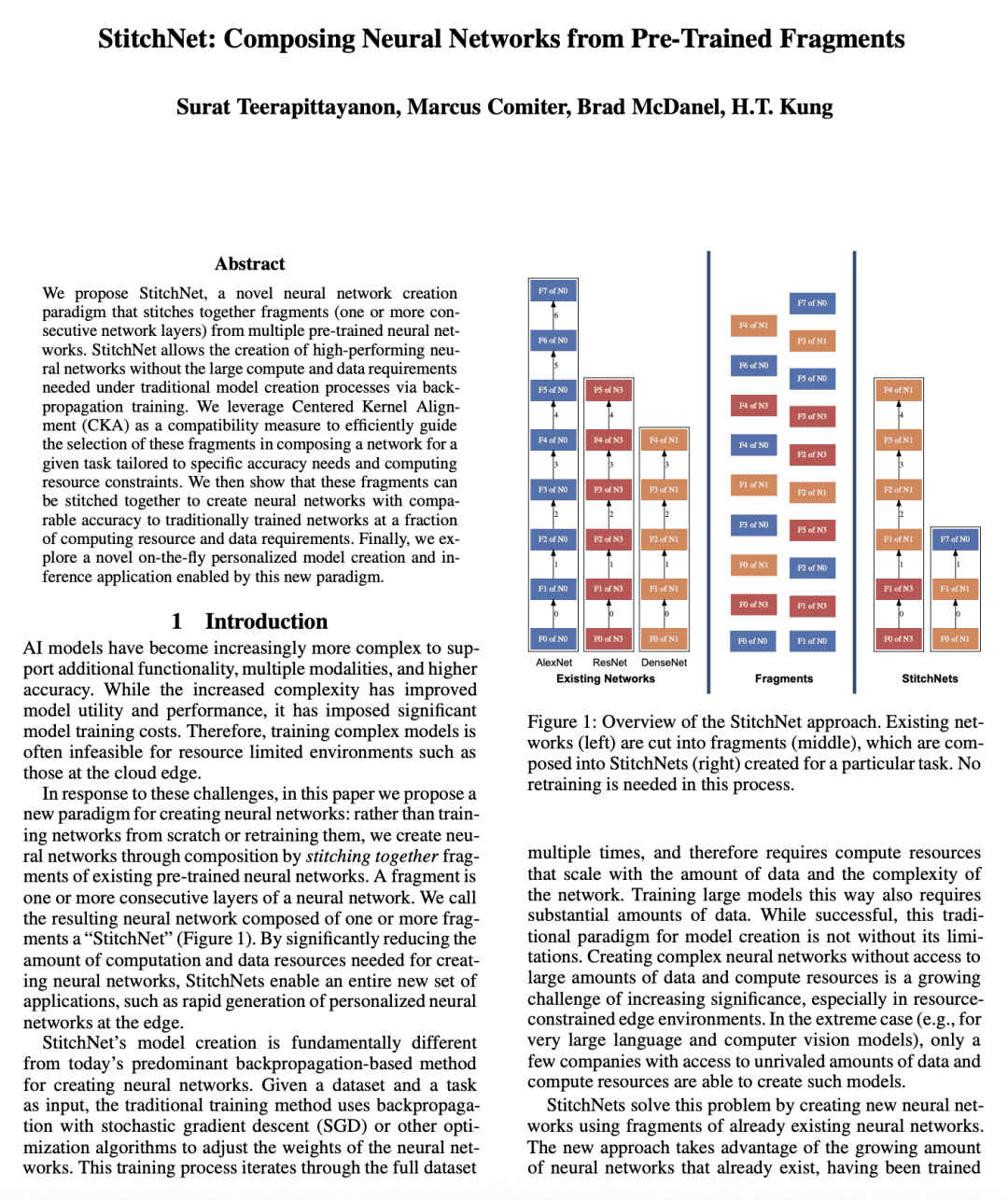

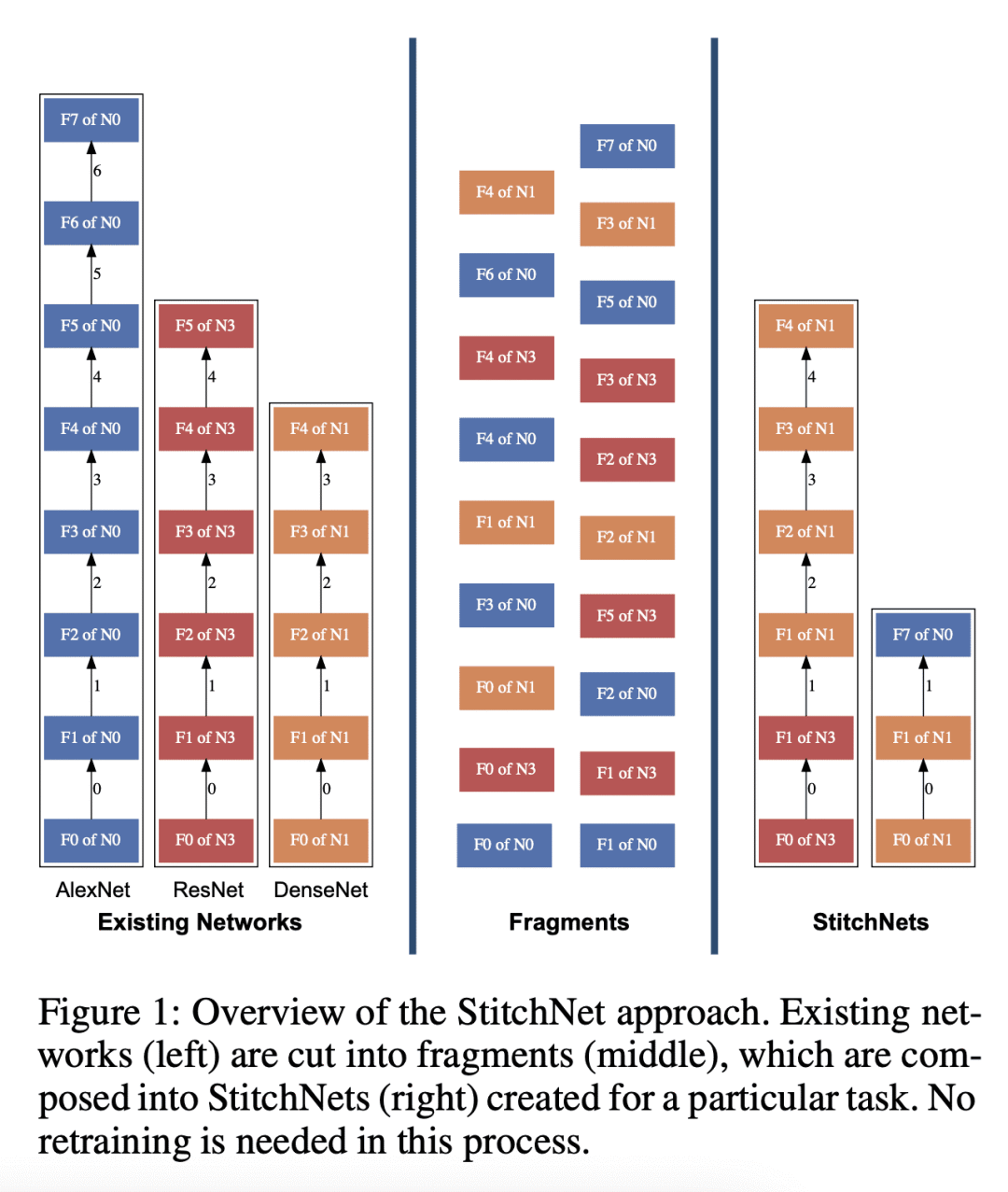

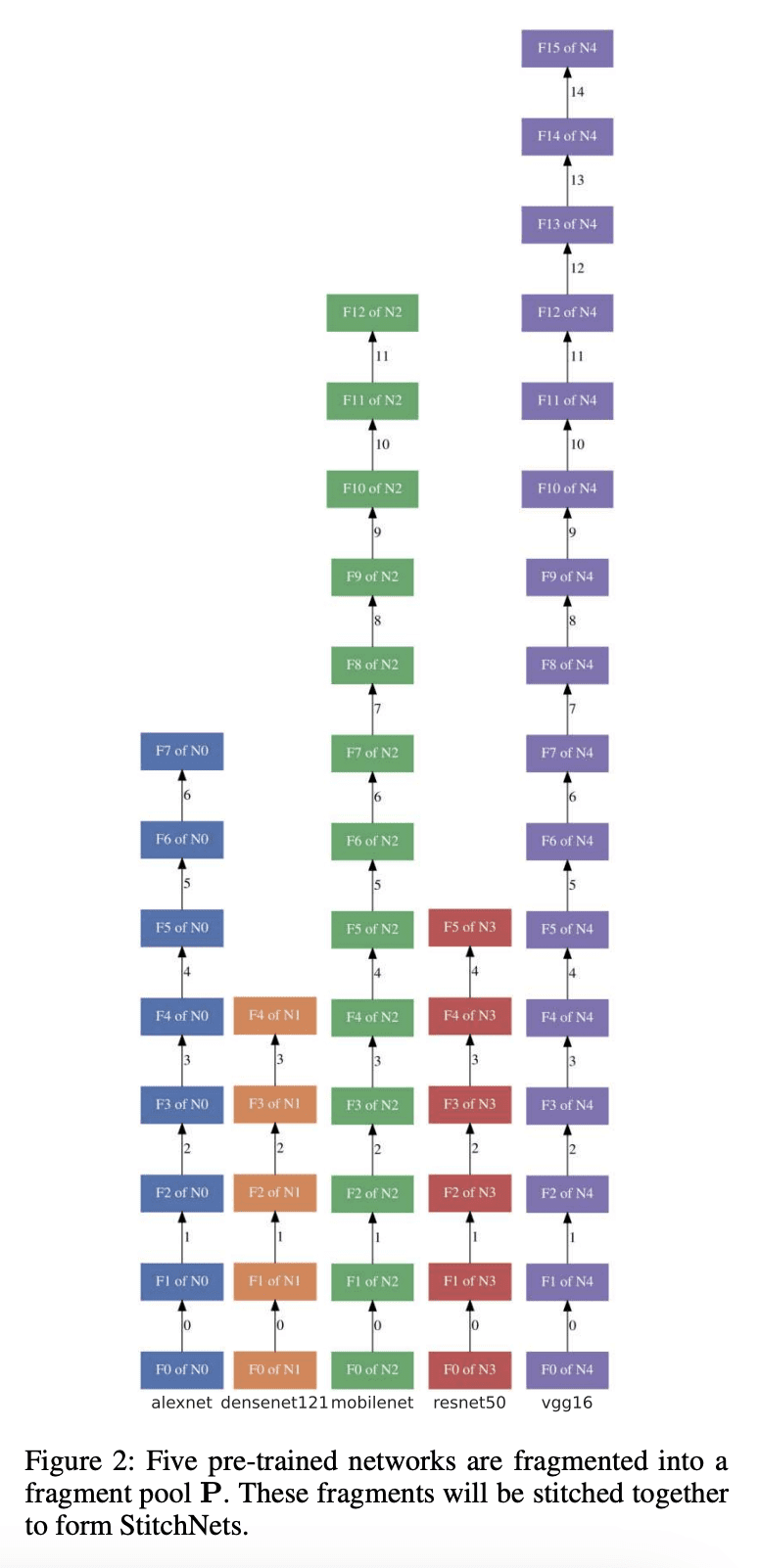

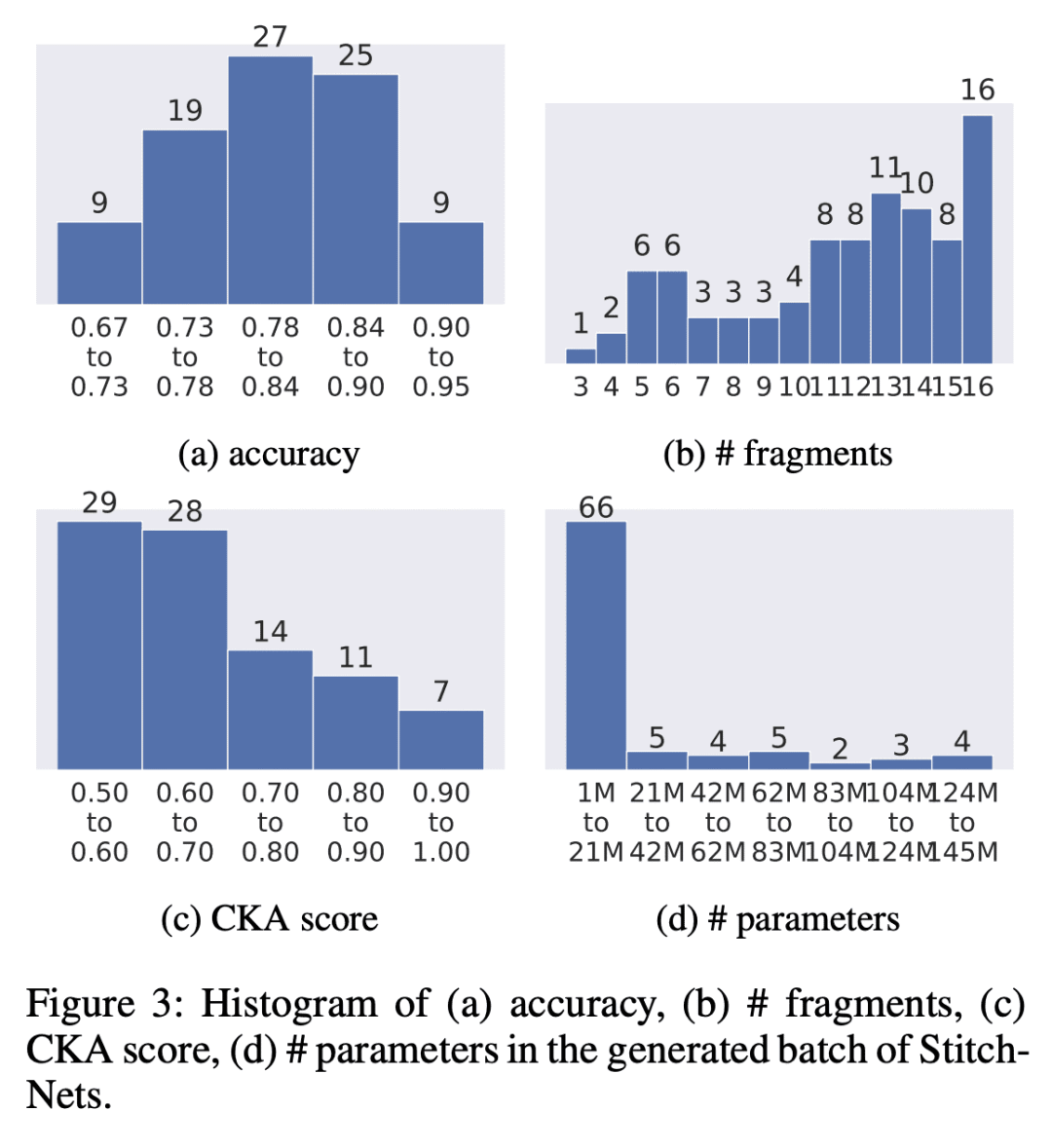

提出了 StitchNet,一种新的神经网络创建范式,将来自多个预训练神经网络的片段(一个或多个连续网络层)拼接在一起。StitchNet 可以不需要传统模型创建过程中反向传播所需大量计算和数据要求而创建高性能神经网络。利用居中内核对齐(CKA)作为兼容性度量,有效地指导这些片段在组成针对特定精度需求和计算资源约束的给定任务的网络的选择。本文展示了这些片段可以被拼接在一起,以创建与传统训练网络相当精度的神经网络,而计算资源和数据要求的比例小得多。本文还探索了这种新范式激活的新型即时个性化模型创建和推理应用。

We propose StitchNet, a novel neural network creation paradigm that stitches together fragments (one or more consecutive network layers) from multiple pre-trained neural networks. StitchNet allows the creation of high-performing neural networks without the large compute and data requirements needed under traditional model creation processes via backpropagation training. We leverage Centered Kernel Alignment (CKA) as a compatibility measure to efficiently guide the selection of these fragments in composing a network for a given task tailored to specific accuracy needs and computing resource constraints. We then show that these fragments can be stitched together to create neural networks with comparable accuracy to traditionally trained networks at a fraction of computing resource and data requirements. Finally, we explore a novel on-the-fly personalized model creation and inference application enabled by this new paradigm.

论文链接:https://arxiv.org/abs/2301.01947

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢