你说ChatGPT,它写的东西逼真到傻傻分不清?

没关系!

现在,它的“克星”来了——

一位华人小哥专门搞了这么一个网站,专门鉴别文字到底是出自于AI还是人类。

你只需要把相应的内容粘进去,几秒内就能分析出结果。

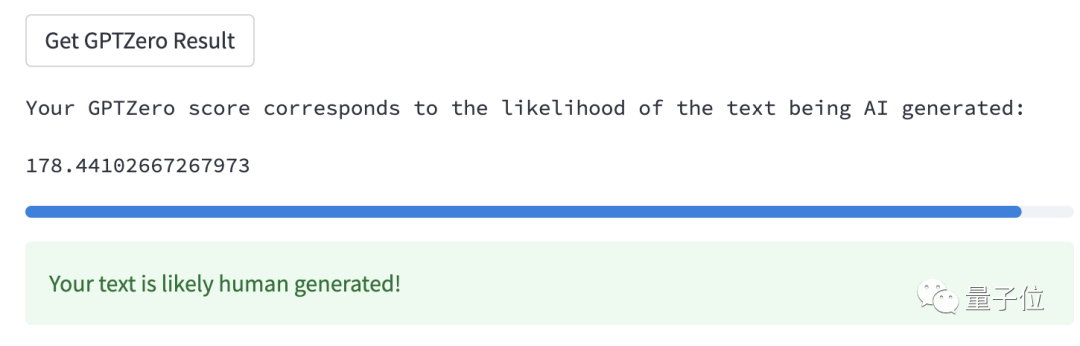

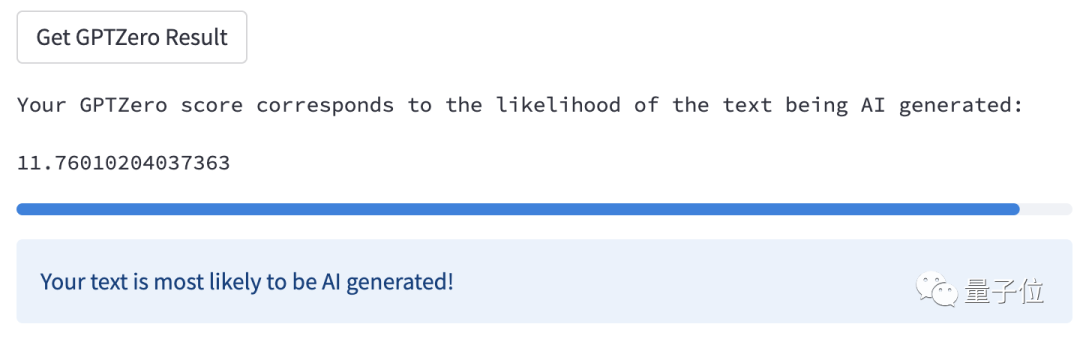

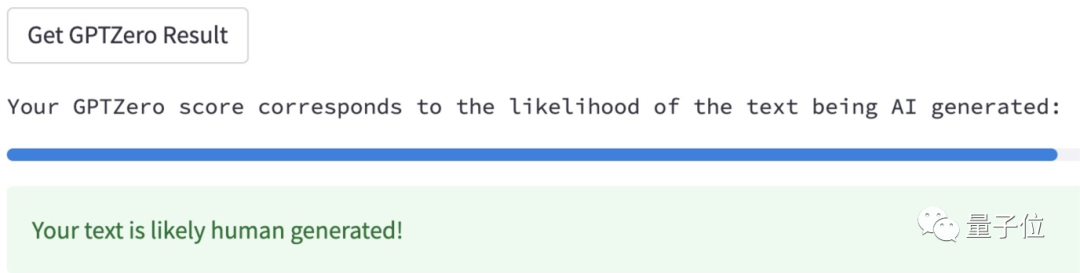

比如这段:

它:“妥妥的人类~”

至于这段:

它:“就知道是AI。”

如此神器一出,可谓迅速俘获大家的芳心。

这不,直接把服务器都给挤崩喽(好在还有个备用的)。

这下,那些用ChatGPT写作业的“熊孩子”也要惨啦?

是人还是ChatGPT?GPTZero:看我的

这个网站名叫GPTZero。

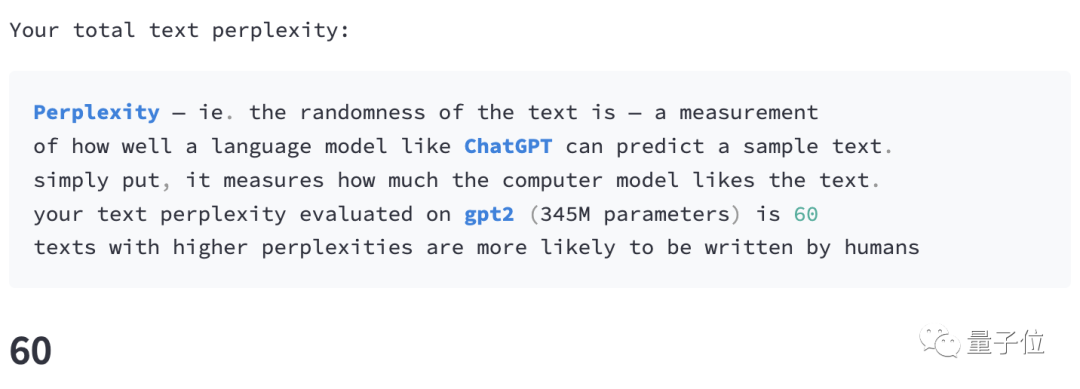

它主要靠“perplexity”,即文本的“困惑度”作为指标来判断所给内容到底是谁写的。

NLP领域的朋友们都知道,这个指标就是用来评价一个语言模型的好坏的。

在这里,每当你喂给GPTZero一段测试内容,它就会分别计算出:

1、文字总困惑度

这个值越高,就越可能出自人类之手。

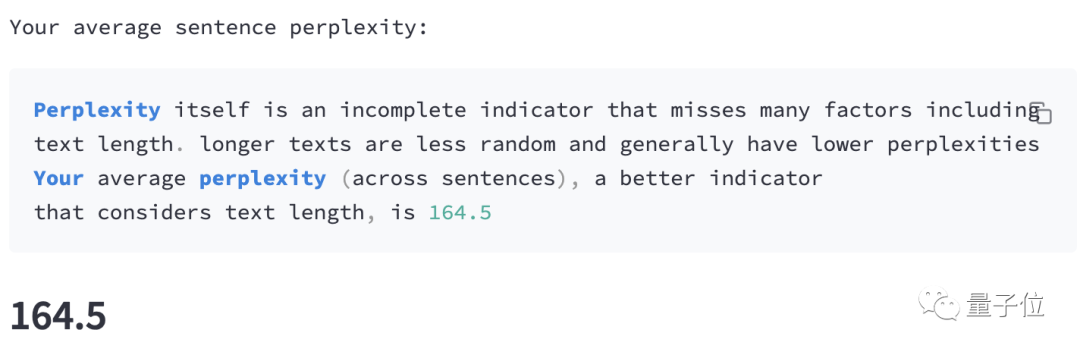

2、所有句子的平均困惑度

句子越长,这个值通常就越低。

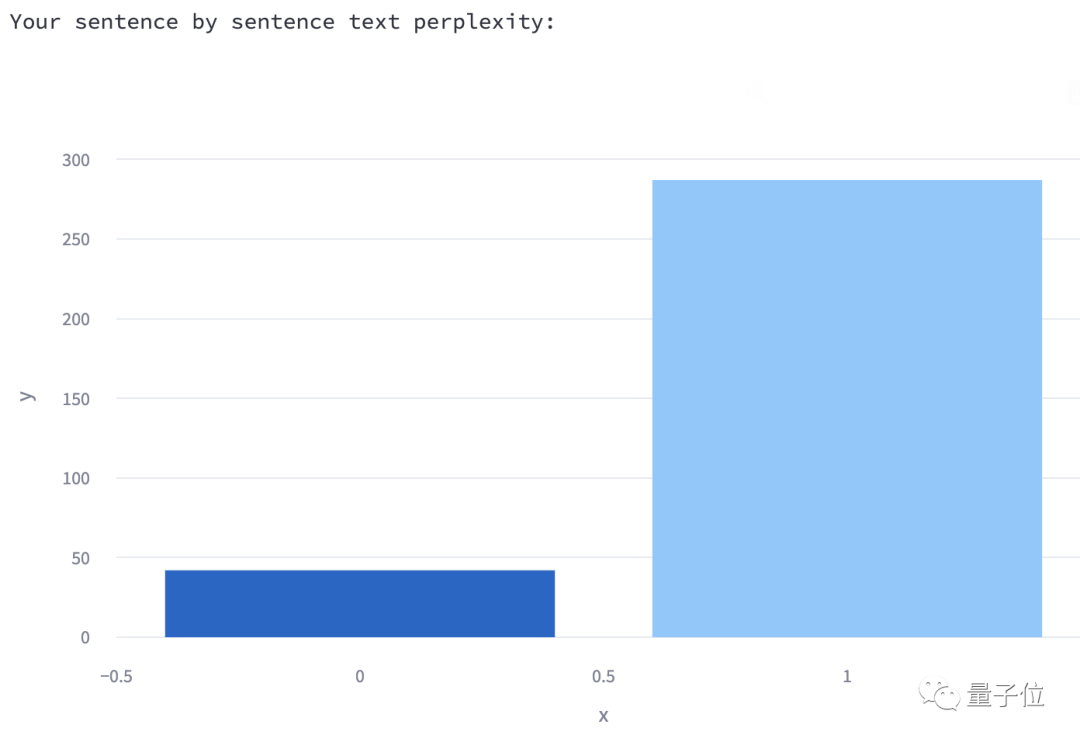

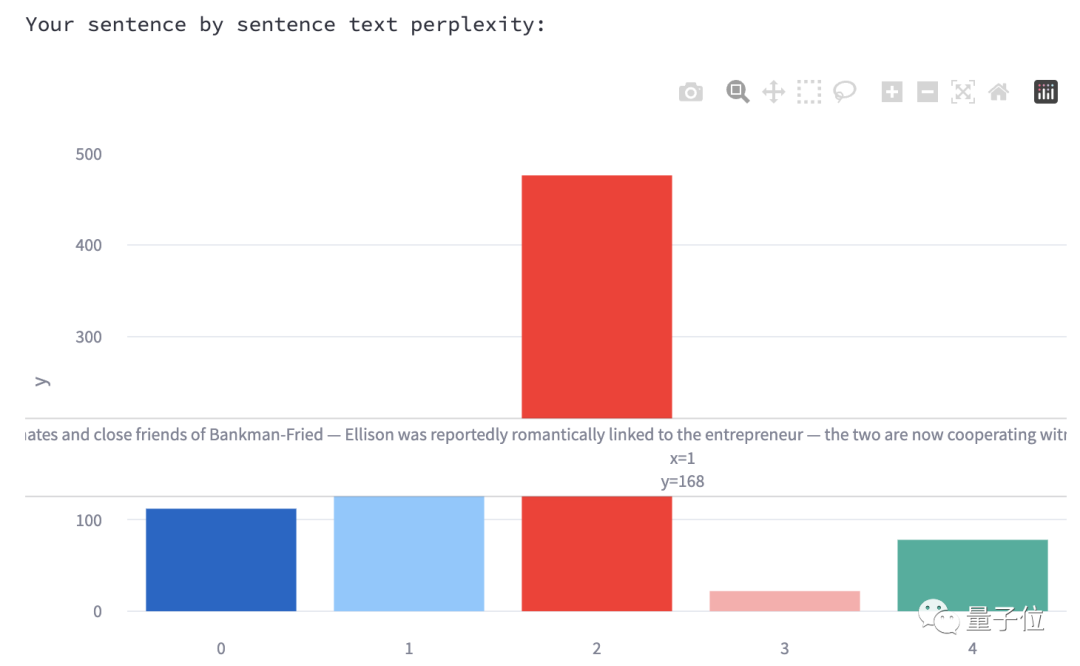

3、每个句子的困惑度

通过条形图的方式呈现,鼠标悬浮到各个方块就可以查看相应的句子是什么(这里就两块,因为我此时输入的测试内容就俩句子)。

之所以要绘制这样的条形图,作者也作出了解释:

根据最新的一些研究:人类书写的一些句子可能具有较低的困惑度(前面说过,人类的困惑度是比较高的),但随着继续写,困惑度势必会出现峰值。

相反,用机器生成的文本,其困惑度是均匀分布的,并且总是很低。

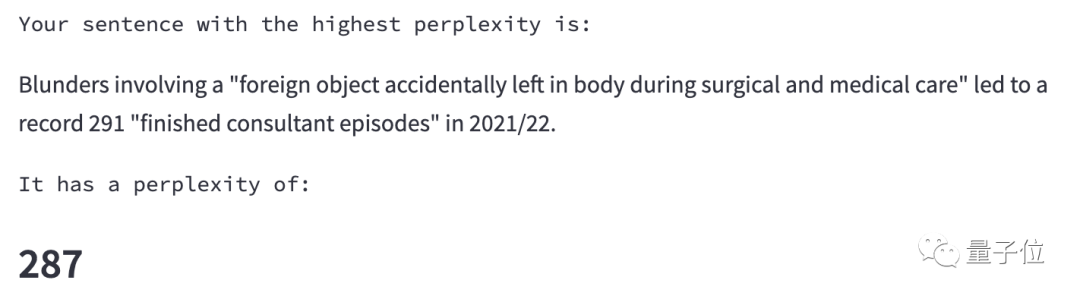

除此之外,GPTZero还会挑出困惑度最高的那个句子(也就是最像人写的):

规则就是这些,接下来实际测一测。

测试1:成功

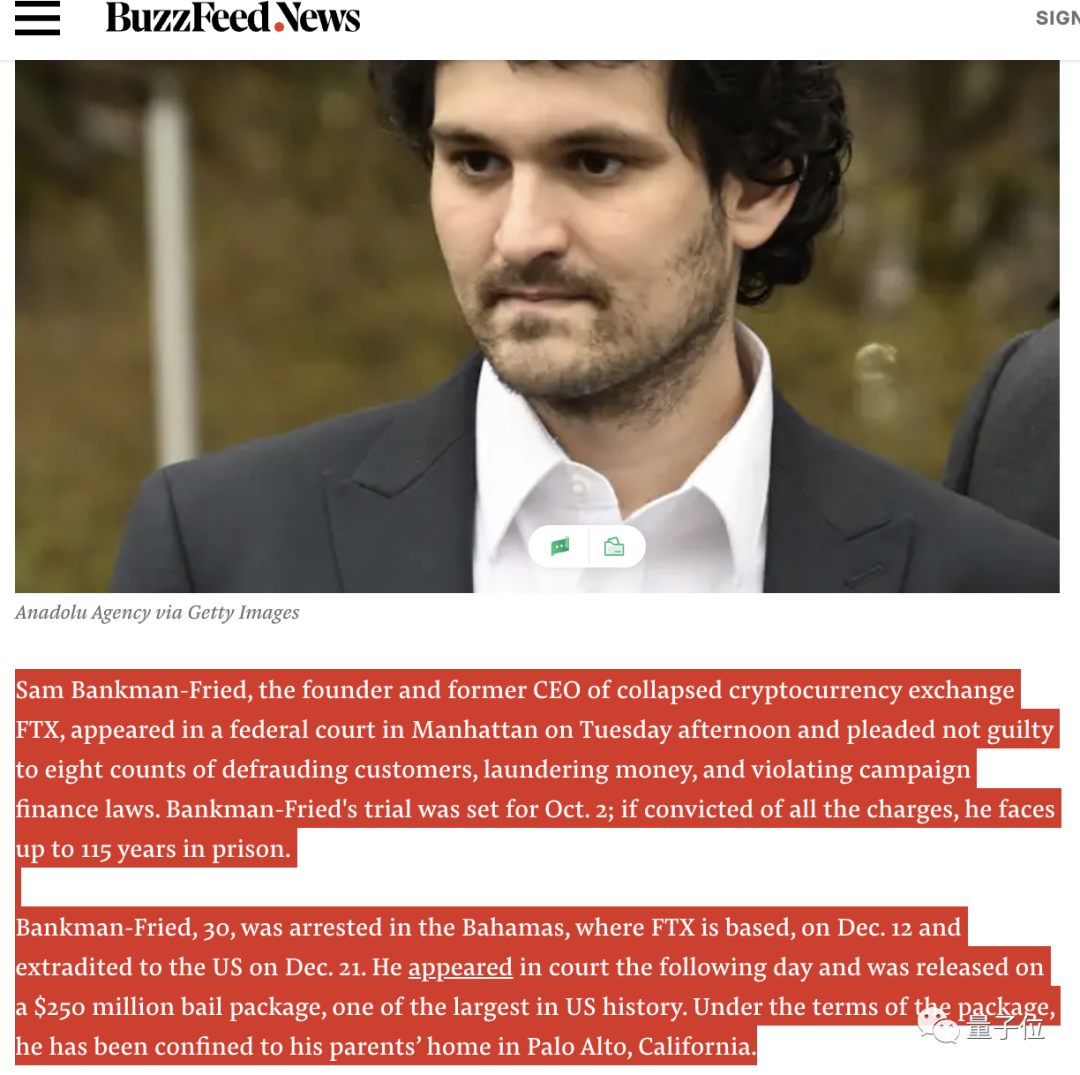

首先来一段最新的英文新闻(目前还不支持测中文):

将它粘贴进测试框(需注意每句至少5个单词,建议每段能有10个句子,结果会更准一些)。

很快,GPTZero计算出这段文字的总文字困惑度为27,句子平均困惑度为171.2,每条句子的困惑度图长这样:

以及困惑度最高的句子的值为476。

看这个结果,估计你也猜出了GPTZero的答案:

是人类写的。

答对了。

测试2:失败

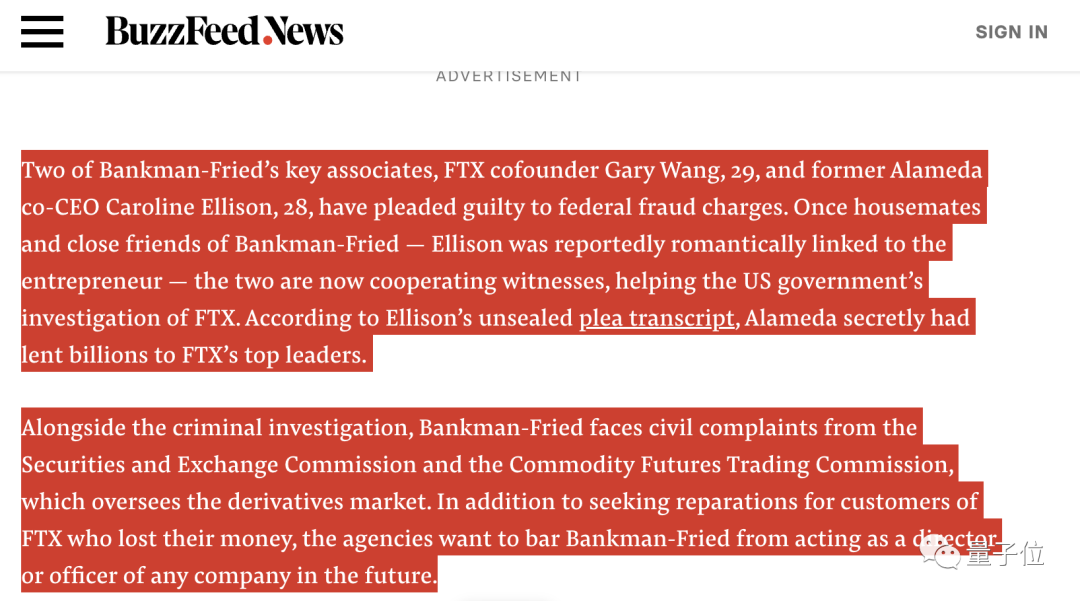

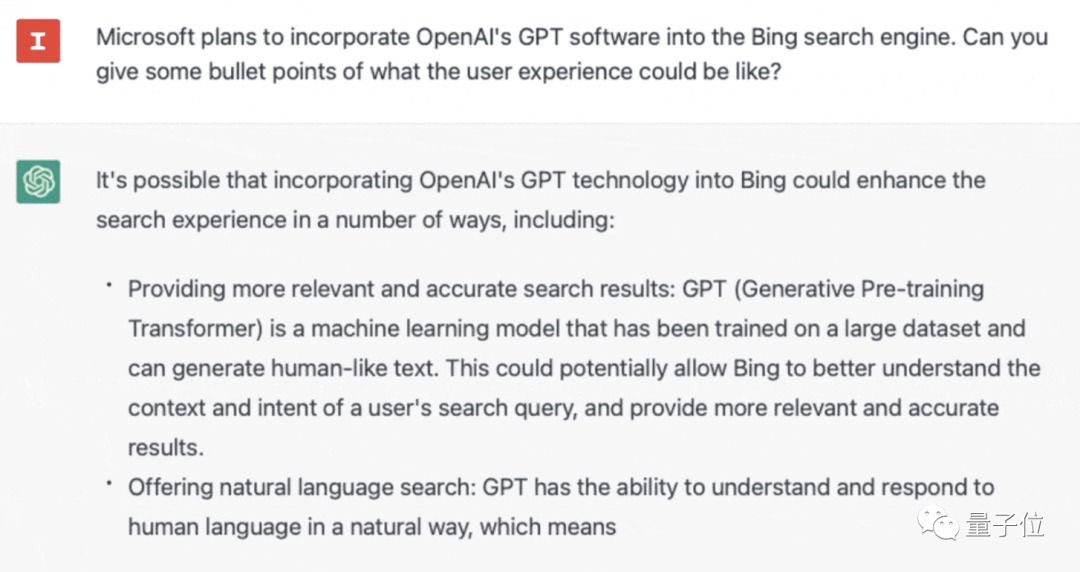

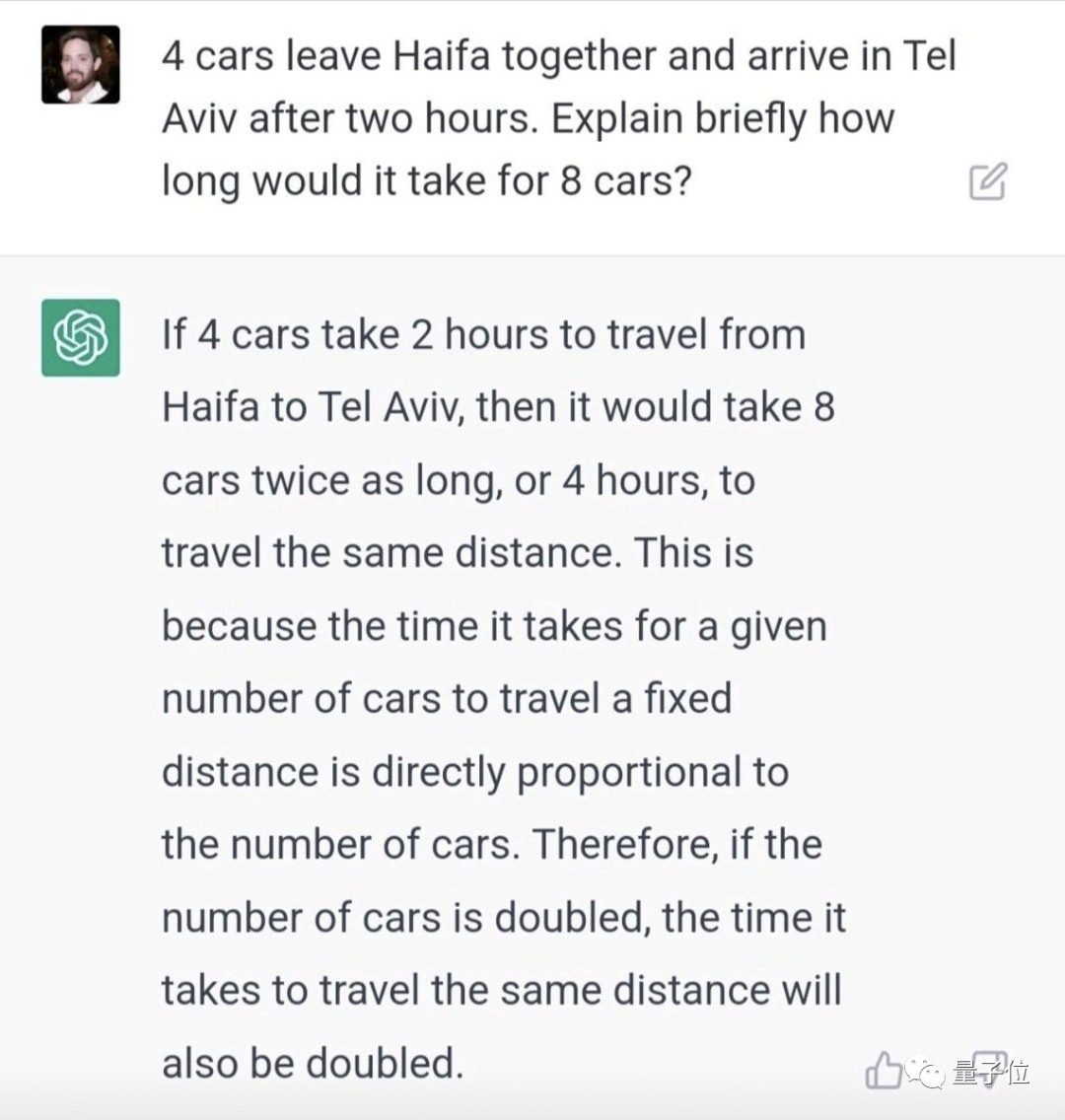

来一段ChatGPT的。

将内容粘贴进测试框,得出这段文字的总文字困惑度为31,句子平均困惑度为76.67,每条句子的困惑度图长这样:

以及困惑度最高的句子的值为99。

看起来,每项困惑度值都和上面那段差距都挺大的,应该能猜出来是AI写的吧。

不过遗憾的是,GPTZero无法给出答案,还希望我们再多加一点文字试试。

显然,这段话字数够多,但句子不够多,无法让GPTZero一眼识破ChatGPT的“伪装”。

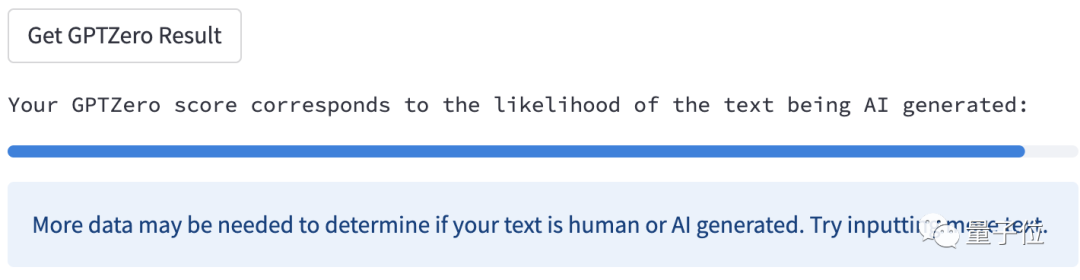

测试3:成功

那我们再来一段ChatGPT的试试。

这回内容够长,句子也够多。

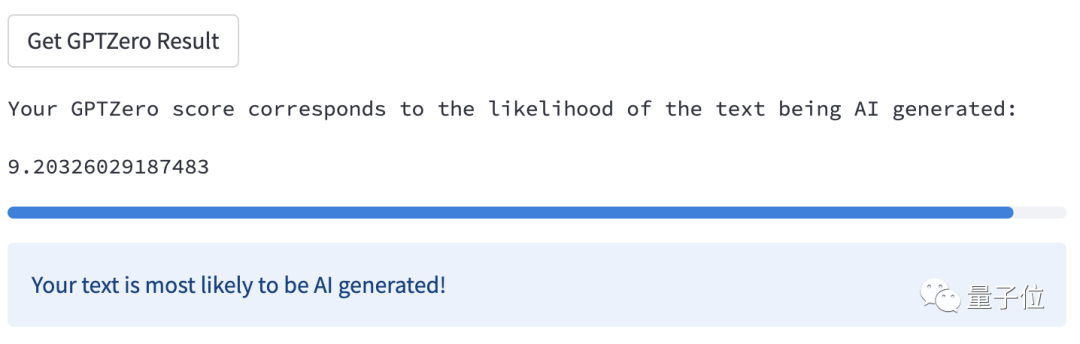

果然没问题了,GPTZero直接答对:

好像确实摸出来一点门道:

那就是字多的同时,句子数量也一定要多,至少5句,好让GPTZero通过直方图的分布加码识别,最后的准确率就可以提高一些。

另外还需要提的是,我们发现在挑战失败的情况中,除了上面这种识别不出来的时候,也有直接识别错误的——

比如把AI写的判断成人写的:

把人写的新闻判断成AI的:

这种情况按照上面所说的窍门,再多加点内容可能就能将结果扳回来。

(注意是可能哈,就上面这段新闻,我们把所有内容都粘进去了,它也说不行,还说要再多来点。)

普林斯顿华人小哥出品

创建该网站的,是一个22岁的华人小哥Edward Tian,来自加拿大多伦多。

目前是美国普林斯顿CS专业大四学生,辅修认知科学和新闻学,对软件工程、机器学习等有浓厚的兴趣。

他现在微软实习,曾在BBC、贝灵猫等公司撰写过科技稿件,还曾加入到地图工具Representable的创始团队。

学习期间,他曾来到清华大学参加为期四周的城市研究研讨会。

据他表示,这个应用程序是新年假期在咖啡店完成的。

之所以想要开发这款应用程序,简而言之就是因为有太多ChatGPT炒作,人类应该知道有哪些是AI写的文章。

目前仍处于准系统阶段,预计在接下来几周内改进模型和分析。

除此之外,他还透露,正在测试由学生撰写的新闻文章数据集,并希望最终能发表论文。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢