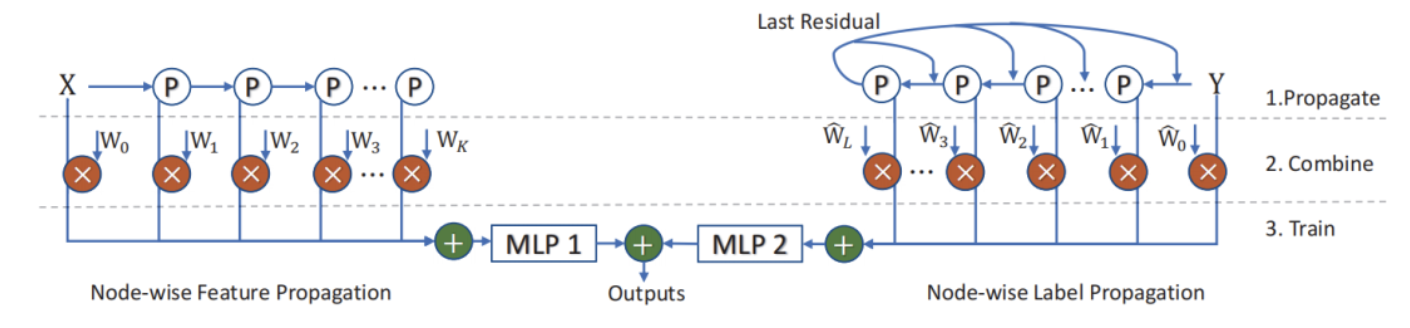

分享一篇北京大学崔斌教授团队发表在KDD 2022上关于图神经网络的文章:《Graph Attention Multi-Layer Perceptron》。图神经网络GNN在许多基于图的应用中取得了巨大成功。然而,大规模图的高稀疏性阻碍了它们在工业场景中的应用。虽然针对大规模图提出了一些可扩展的GNN,但它们对每个节点采用固定的𝐾-hop邻域,导致GNN模型在训练过程中对实际感知域不敏感,因此在稀疏区域内对节点采用大传播深度时,会面临过平滑问题。为了解决上述问题,作者提出了一种新的GNN架构-图注意多层感知器(GAMLP),它可以捕捉图知识的不同尺度之间的潜在相关性。GAMLP 符合解耦 GNN 的特点,特征传播的计算与神经网络的训练分离,保证了GAMLP的可扩展性。通过在14个图数据集上的大量对比实验,表明了GAMLP在具有高可扩展性和高效率的同时,还实现了最优的性能。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢