来自今天的爱可可AI前沿推介

[RO] ORBIT: A Unified Simulation Framework for Interactive Robot Learning Environments

M Mittal, C Yu, Q Yu, J Liu, N Rudin, D Hoeller, J L Yuan...

[NVIDIA & University of Toronto]

ORBIT: 交互式机器人学习环境统一仿真框架

要点:

-

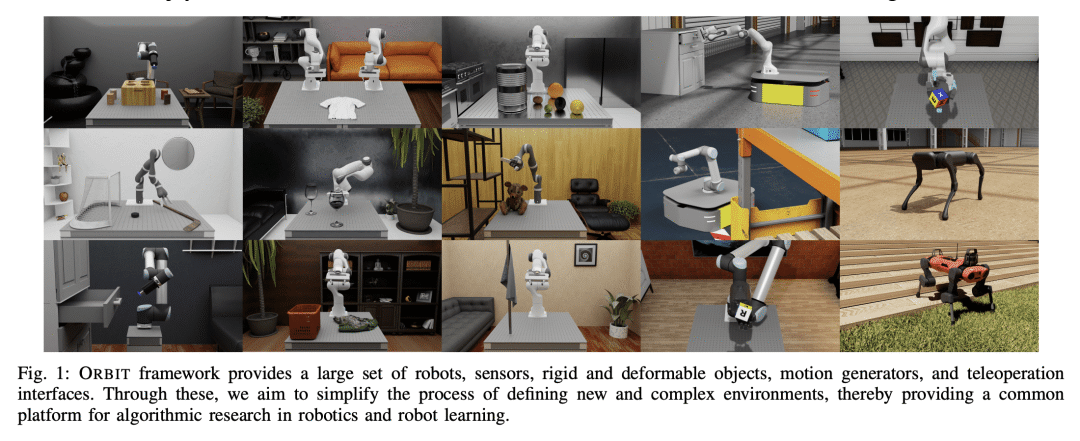

ORBIT 是一个统一的模块化机器人学习框架,由NVIDIA Isaac Sim提供支持,允许轻松有效地创建具有逼真场景和快速准确的刚性和可变形身体模拟的机器人环境; -

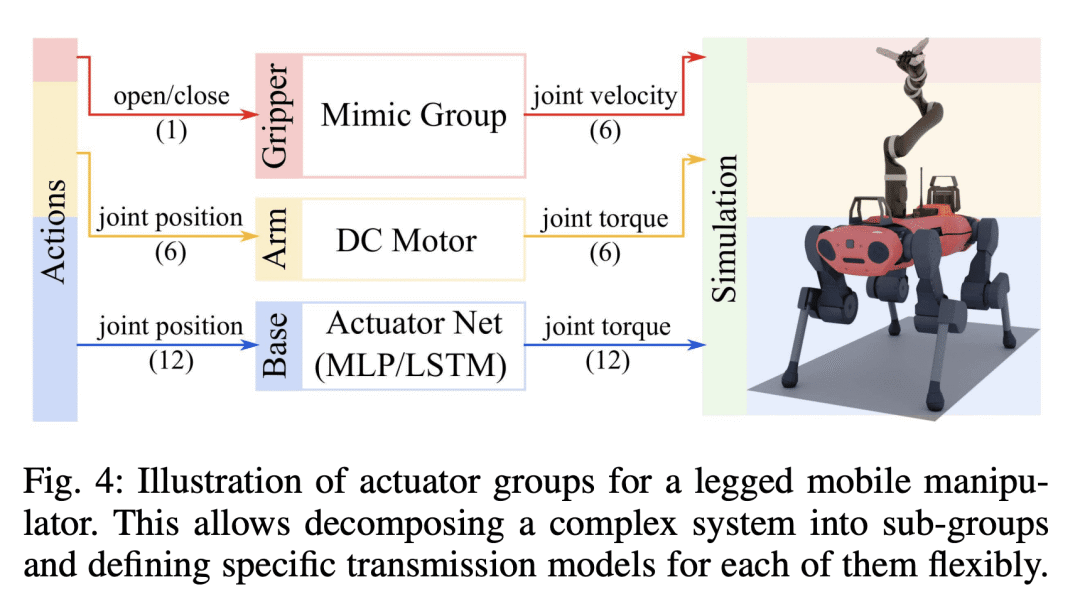

ORBIT 提供了一套不同难度的基准任务,支持用不同的观察和动作空间,包括具有不同物理传感器和运动生成器的固定臂和移动机械手; -

ORBIT允许利用基于GPU的并行化,在几分钟内训练强化学习策略,并从手工定制或专家解决方案中收集大型演示数据集。 -

ORBIT是一个开源框架,配有16个机器人平台、4个传感器模式、10个运动发生器、20多个基准任务和4个学习库,旨在支持各种研究领域,包括表示学习、强化学习、模仿学习以及任务和运动规划。

一句话总结:

ORBIT是一个机器人学习的模块化框架,可以轻松创建逼真的环境,支持各种基准任务,并能够从各种机器人平台、传感器和运动生成器中训练和收集数据,同时开源并旨在支持多个研究领域,包括表示学习、强化学习、模仿学习以及任务和运动规划。

摘要:

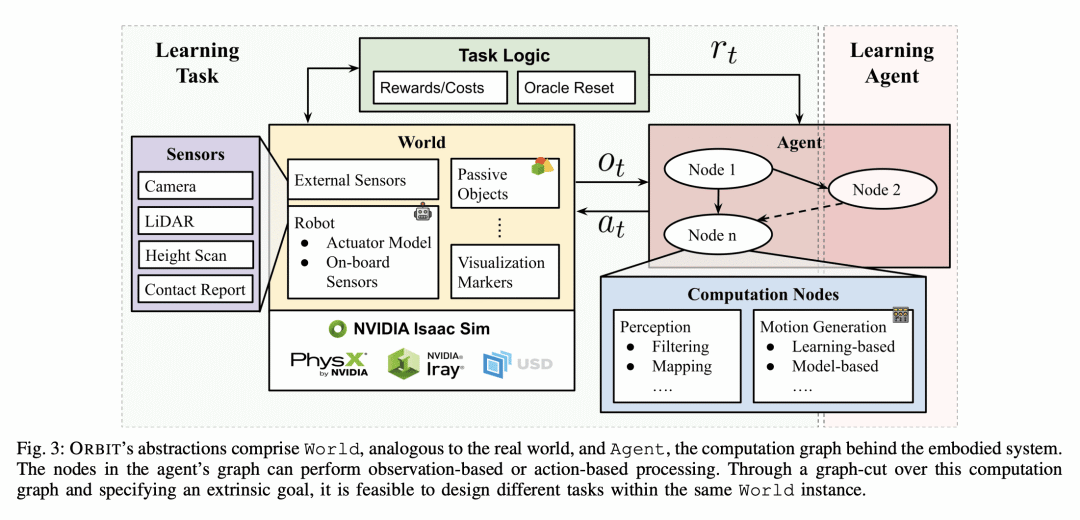

本文提出ORBIT,一个由 NVIDIA Isaac Sim 提供支持的统一模块化机器人学习框架。ORBIT提供了一个模块化设计,通过逼真的场景以及快速准确的刚性和可变形的身体模拟,轻松有效地创建机器人环境。通过ORBIT,提供了一套不同难度的基准任务——从单级橱柜打开和布折叠到房间重组等多阶段任务。为了支持使用不同的观测和动作空间,ORBIT包括具有不同物理传感器和运动生成器的固定臂和移动机械手。ORBIT允许利用基于GPU的并行化,在几分钟内培训强化学习策略,并从手工定制或专家解决方案中收集大型演示数据集。总之,本文提供了一个开源框架,该框架配有16个机器人平台、4种传感器模式、10个运动发生器、20多个基准任务和4个学习库。通过这个框架,目标是支持各个研究领域,包括表示学习、强化学习、模仿学习以及任务和运动规划。

We present ORBIT, a unified and modular framework for robot learning powered by NVIDIA Isaac Sim. It offers a modular design to easily and efficiently create robotic environments with photo-realistic scenes and fast and accurate rigid and deformable body simulation. With ORBIT, we provide a suite of benchmark tasks of varying difficulty -- from single-stage cabinet opening and cloth folding to multi-stage tasks such as room reorganization. To support working with diverse observations and action spaces, we include fixed-arm and mobile manipulators with different physically-based sensors and motion generators. ORBIT allows training reinforcement learning policies and collecting large demonstration datasets from hand-crafted or expert solutions in a matter of minutes by leveraging GPU-based parallelization. In summary, we offer an open-sourced framework that readily comes with 16 robotic platforms, 4 sensor modalities, 10 motion generators, more than 20 benchmark tasks, and wrappers to 4 learning libraries. With this framework, we aim to support various research areas, including representation learning, reinforcement learning, imitation learning, and task and motion planning. We hope it helps establish interdisciplinary collaborations in these communities, and its modularity makes it easily extensible for more tasks and applications in the future.

论文链接:https://arxiv.org/abs/2301.04195

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢