本文将解读中科院计算所数字内容合成与伪造检测实验室发表在ACM Multimedia 2022的工作。该工作提出了一种挖掘频域特性改进人体动作迁移视频合成的方法,通过频域下对单帧、时序两个维度对合成过程进行约束,显著提升合成视频的时序一致性。同时,单帧图像质量也有所提升。

论文链接:

https://dl.acm.org/doi/10.1145/3503161.3547781

预印版:

https://arxiv.org/abs/2209.00233

01. 背景介绍

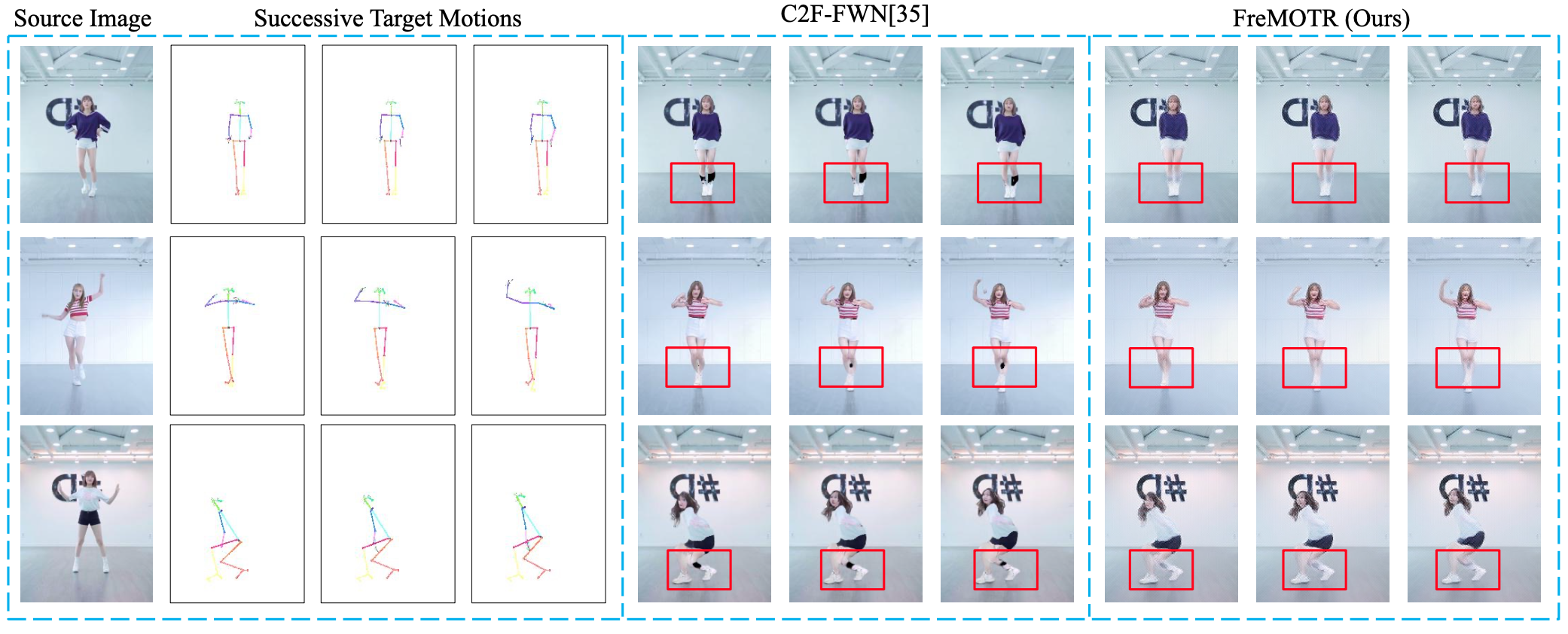

动作迁移视频合成,指合成一个人物执行指定动作的视频。如图1所示,给定人物图像、指定动作,动作迁移方法将合成该人物在新动作下的一组图像。其在电影编辑、虚拟试衣、虚拟客服等应用场景中有巨大的潜力。该任务对合成结果存在两个维度的要求:单帧图像要尽量逼真;连续图像要在时序上保持连贯一致。但如图1中现有方法C2F-FWN[5]的合成结果在时序上的不一致、噪声伪影等显著影响视觉质量,合成结果不够真实。

现有研究主要在像素域关注人物的合成。近期关于生成模型的研究中发现,当前生成模型不能有效建模真实图像的频域分布,易导致特定频率信号的缺失,而这一现象往往与合成结果的模糊、噪声等现象对应。相关研究将频域差异作为损失函数进行约束,尚未充分利用频域的特性对生成模型进行改进。

此外,现有动作迁移研究主要关注单帧图像的合成,少数工作通过光流、多帧平滑损失等对时序一致进行约束,但合成结果时序不一致的问题依旧存在,降低合成结果的视觉效果。在像素域观察到的噪声、伪影等时序不一致,也会对应于频域表示的异常信号,但这一特性目前未能被动作迁移相关工作利用。

基于以上两方面考虑,本文挖掘频域特性,改进动作迁移视频合成的方法,提出了Frequency-based Human Motion Transfer (FreMOTR)框架。本文首先提出了频域外观规整化(Frequency-domain Appearance Regularization, FAR),同时在像素域和频域建模单帧图像的特性,提升单帧图像的合成效果;此外,本文发现了真实视频与合成视频之间的时序频域差异,并提出时序频域规整化(Temporal Frequency Regularization, TFR)缓解这一差异。本文方法可使用任何已有动作迁移方法作为骨干网络,可以显著提高合成视频的时序一致性,同时能改善单帧图像质量。

本文主要贡献如下:

-

本文首次发现对真实与合成视频而言,其频域的时序变化有较大差异;

-

为实现时序频域规整化,针对性地提出了WTFR损失约束,有效地引导生成网络建模真实视频的时序频域变化;

-

为实现频域外观规整化,利用基于傅里叶卷积的编码-重构结构构建网络,减少了单帧人物图像中的噪声伪影等现象。

实验结果表明,本文提出的方法有效提高了合成结果的时序一致性,量化指标TCM[6]比现有方法提高30%,可以保持较长时间的一致性;单帧图像的质量也有所提升。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢