来自今天的爱可可AI前沿推介

[CV] Guiding Text-to-Image Diffusion Model Towards Grounded Generation

Z Li, Q Zhou, X Zhang, Y Zhang, Y Wang, W Xie

[Shanghai Jiao Tong University]

面向Grounded生成的文本到图像扩散模型引导

要点:

-

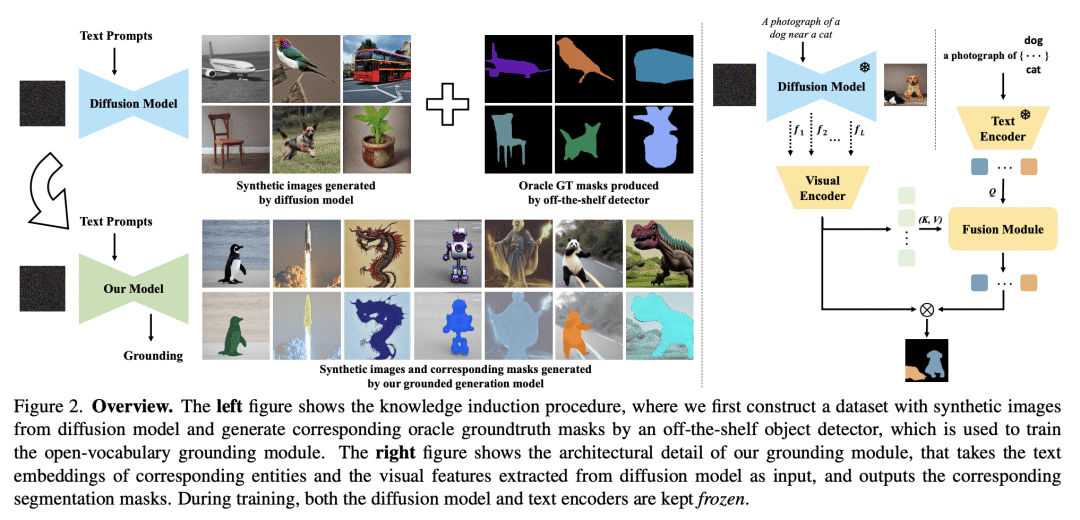

在现有的扩散模型中插入一个 grounding 模块,该模块可进行训练,使扩散模型的视觉和文本嵌入空间仅与少数目标类别对齐; -

提出一种由 {图像、分割掩码、文本提示} 三元组组成的数据集的自动化管线,以训练所提出的 grounding 模块; -

评估从文本到图像扩散模型生成的图像上的开放词汇 grounding 性能,该模块可以很好地分割训练时看到的类别的对象。

一句话总结:

提出一种用 grounding 模块将开放词汇对象 grounding 加入文本到图像扩散模型的方法,以及相应的数据集构建管线,显示出分割未见过对象的良好性能,以及用于零样本语义分割的潜力。

摘要:

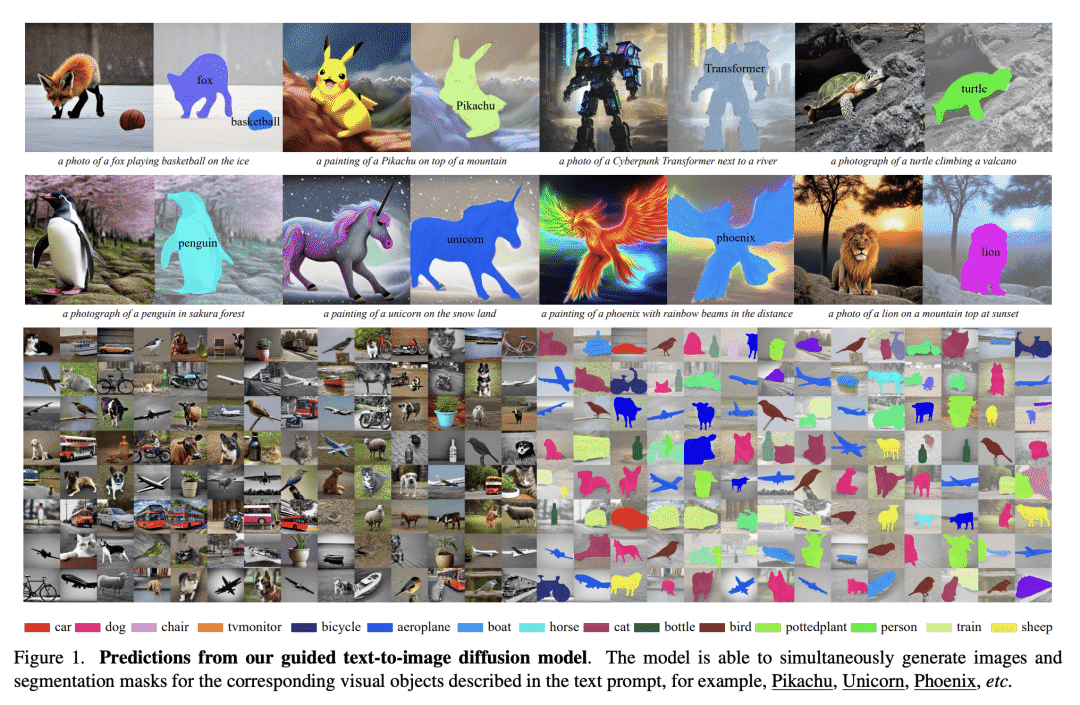

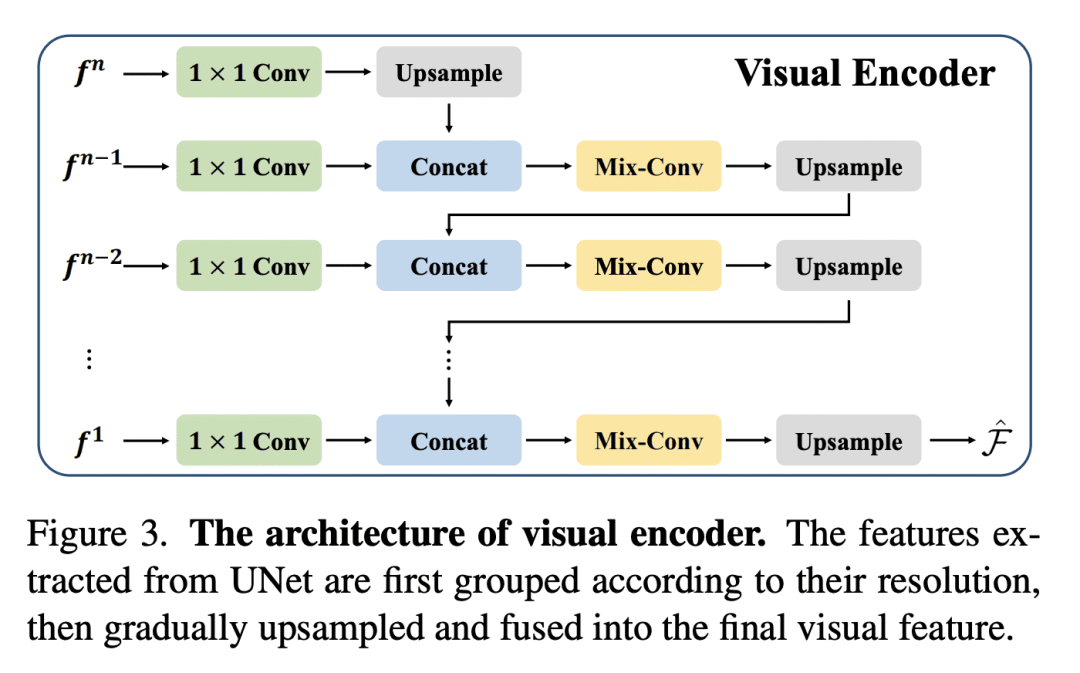

本文的目标是增强预训练的文本到图像扩散模型,该模型具有开放世界目标 grounding 的能力,即同时为文本提示符中描述的相应视觉实体生成图像和分割掩码。本文贡献如下:(i) 在现有的扩散模型中插入一个 grounding 模块,该模块可进行训练,使扩散模型的视觉和文本嵌入空间仅与少数目标类别对齐;(ii) 提出一种由 {图像、分割掩码、文本提示} 三元组组成的数据集的自动化管线,以训练所提出的 grounding 模块;(iii) 评估从文本到图像扩散模型生成的图像上的开放词汇 grounding 性能,该模块可以很好地分割训练时看到的类别的对象;(iv) 用引导扩散模型构建合成语义分割数据集,在此类数据集上训练标准分割模型表明,在零样本分割(ZS3)基准上具有竞争力,为采用强大的扩散模型进行判别性任务提供了新的思路。

The goal of this paper is to augment a pre-trained text-to-image diffusion model with the ability of open-vocabulary objects grounding, i.e., simultaneously generating images and segmentation masks for the corresponding visual entities described in the text prompt. We make the following contributions: (i) we insert a grounding module into the existing diffusion model, that can be trained to align the visual and textual embedding space of the diffusion model with only a small number of object categories; (ii) we propose an automatic pipeline for constructing a dataset, that consists of {image, segmentation mask, text prompt} triplets, to train the proposed grounding module; (iii) we evaluate the performance of open-vocabulary grounding on images generated from the text-to-image diffusion model and show that the module can well segment the objects of categories beyond seen ones at training time; (iv) we adopt the guided diffusion model to build a synthetic semantic segmentation dataset, and show that training a standard segmentation model on such dataset demonstrates competitive performance on zero-shot segmentation(ZS3) benchmark, which opens up new opportunities for adopting the powerful diffusion model for discriminative tasks.

论文链接:https://arxiv.org/abs/2301.05221

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢