【标题】LAMBADA: Backward Chaining for Automated Reasoning in Natural Language

【作者团队】Seyed Mehran Kazemi, Najoung Kim, Deepti Bhatia, Xin Xu, Deepak Ramachandran

【发表日期】 20 Dec 2022

【论文链接】https://arxiv.org/pdf/2212.13894.pdf

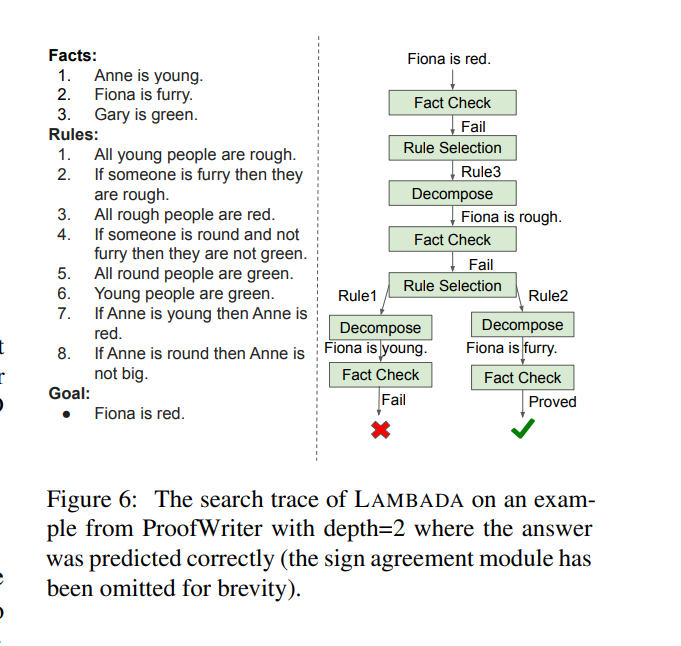

【推荐理由】通过使用大型语言模型(LMs)的强大功能以及思维链提示和选择推理等方法,在使用指定为非结构化自然文本的知识进行自动推理方面取得了显著进展。这些技术在从公理到结论的正向方向上搜索证明,这会导致搜索空间的组合爆炸,因此对于需要较长推理链的问题,失败率很高。经典的自动推理文献表明,反向推理(即从预期结论到支持它的公理集)在证据发现问题上效率明显更高。论文将这种直觉引入到LM设置中,并开发了一种反向链接算法,称之为LAMBADA,该算法将推理分解为四个子模块,每个子模块都可以简单地通过少数镜头提示的LM推理来实现。论文结果表明,LAMBADA在两个具有挑战性的逻辑推理数据集上实现了比最先进的正向推理方法更高的精度,特别是在需要深度和准确的证明链时。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢