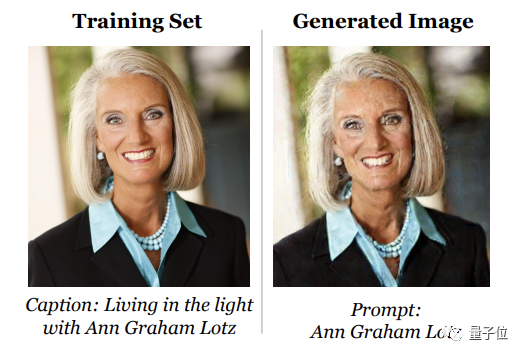

最新研究表明,扩散模型会牢牢记住训练集中的样本,并在生成时“依葫芦画瓢”。

也就是说,像Stable Diffusion生成的AI画作里,每一笔背后都可能隐藏着一次侵权事件。不仅如此,经过研究对比,扩散模型从训练样本中“抄袭”的能力是GAN的2倍,且生成效果越好的扩散模型,记住训练样本的能力越强。

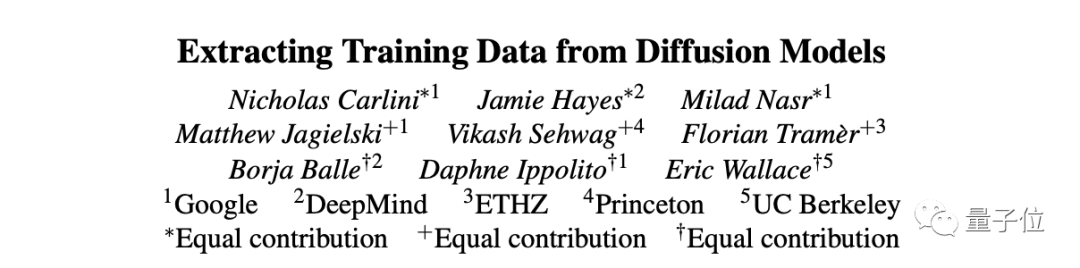

这项研究来自Google、DeepMind和UC伯克利组成的团队。

论文中还有另一个糟糕的消息,那就是针对这个现象,现有的隐私保护方法全部失效。

扩散模型的原理是去噪再还原,所以研究者要研究事情其实就是:它们到底有没有记住用来训练的图像,最后在生成时进行“抄袭”?

训练集里的图像往往从互联网大海中捞取,有版权的、有商标的,有的还有隐私性,比如私人的医疗X光片什么的。

为了弄清楚扩散模型到底能不能记忆和再生个体训练样本,研究人员首先提出了“记忆”的新定义。

一般来说,关于记忆的定义集中在文本语言模型上,如果可以提示模型从训练集中恢复一个逐字序列,就表示这个序列被提取和记忆了。

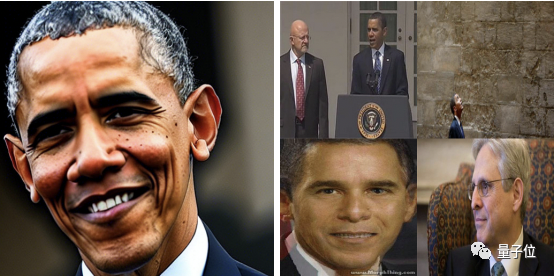

与之不同,研究团队基于图像相似度来定义“记忆”。举个例子,左图是用Stable Diffusion生成的一张“奥巴马的照片”,这张照片和右图任何一张特定训练图像都不神似,因此这个图像不能算作根据记忆生成。

但这并不表示Stable Difusion生成新的可识别图片的能力不会侵害版权和隐私。

接着,他们提取了包含个人照片、公司招标在内的1000多个训练样本,然后设计了一个两阶段的数据提取攻击(data extraction attack)。具体操作是使用标准方法生成图像,然后标记那些超过人工推理评分标准的图像。

在Stable Diffusion和Imagen上应用这种方法,团队提取了超过100个近似或相同的训练图像副本。既有可识别出的个人照片,也有商标标识,经过查验,大部分都是有版权的。

而后,为了更好地理解“记忆”是怎么发生的,研究人员从模型中采样100万次,在CIFAR-10上训练了几百个扩散模型。目的是分析模型准确性、超参数、增强和重复数据删除中,哪些行为会对隐私性产生影响。

最终得出了如下结论:

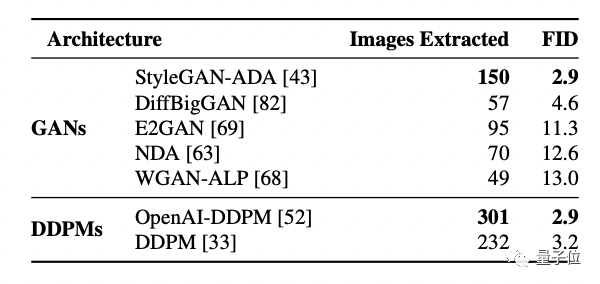

首先,扩散模型比GAN记忆更多。但扩散模型也是评估的图像模型中隐私性最差的一群,它们泄漏的训练数据是GANs的两倍多。

而且,更大的模型可能会记住更多的数据。

随着这个结论,研究人员还研究了20亿参数的文本-图像扩散模型Imagen,他们尝试提取出500张分布外得分最高的图像,让它们作为训练数据集中的样本,发现都被记忆了。

相比之下,同样的方法应用在Stable Difusion上,没有识别出任何记忆行为。

因此,在复制和非复制图像上,Imagen比Stable Difusion隐私性更差,研究人员把原因归结于Imagen使用的模型比Stable Difusion容量大,因此记得的图像越多。

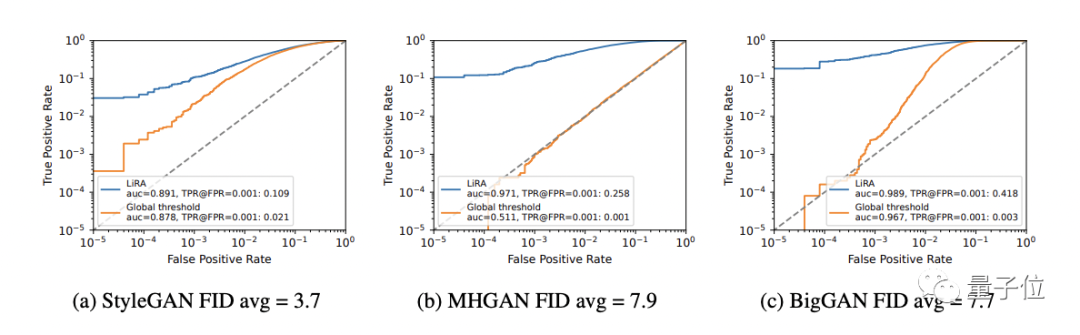

此外,更好的生成模型(FID值更低)存储的数据更多。

换句话来讲,随着时间的推移,同一个模型泄露的隐私更多,侵犯的版权也更多。

(按FID排序的GAN模型,FID值越低,效果越好)

通过训练模型,团队发现增加效用会降低隐私性,简单的防御措施(如重复数据删除)不足以完全解决记忆攻击。因此,隐私增强技术并不能提供一个可接受的隐私-效用权衡。

最终,团队对训练扩散模型的人提出了四个建议:

建议将训练数据集的重复数据删除,并尽量减少过度训练;

建议使用数据提取攻击或其他审计技术来评估训练模型的隐私风险;

如果有更实用的隐私保护技术,建议尽可能使用;

希望AI生成的图片不会免费对用户提供涉及隐私的部分。

研究一出,可能对正在进行的诉讼产生影响(Getty Images)以侵犯版权的名义,在伦敦高等法院起诉了Stability AI。

参考链接:

[1]https://arxiv.org/pdf/2301.13188.pdf

[2]https://www.theverge.com/2023/1/17/23558516/ai-art-copyright-stable-diffusion-getty-images-lawsuit

[3]https://twitter.com/Eric_Wallace_/status/1620449934863642624

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢