作者:Zunzhi You, Daochang Liu, Chang Xu

推荐理由:本文属于大模型安全领域的创新,是通过在自监督视觉表示学习的主流框架中:添加噪声而不是掩蔽,增强了下游微调模型的对抗性攻击的防御。

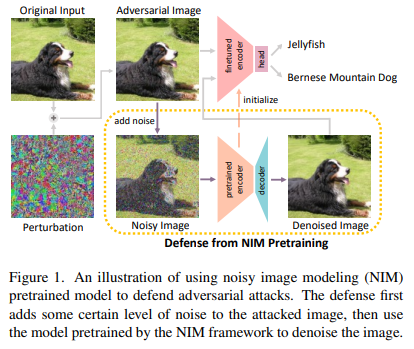

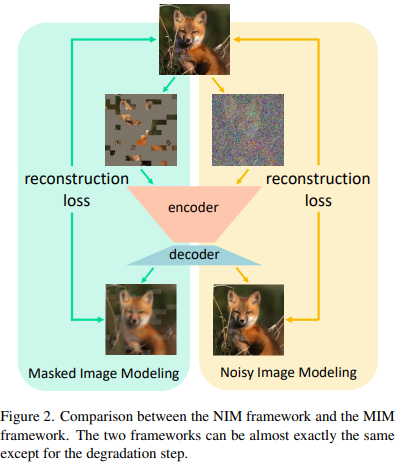

简介:Masked Image Modeling (MIM) 一直是自监督视觉表示学习的主流框架。在预训练-微调范例中,MIM 框架通过在解码器的帮助下重建遮罩图像块来训练编码器,当编码器用于微调时,解码器将被丢弃。尽管 MIM 模型在清洁图像上具有最先进的性能,但它容易受到对抗性攻击,限制了它在现实世界中的应用,而且很少有研究关注这个问题。在本文中,作者发现噪声图像建模 (NIM) 是 MIM 的一种变体,它使用去噪作为前置任务,不仅提供了良好的预训练视觉特征,还为下游模型提供了有效的对抗防御。为了实现更好的准确性 - 鲁棒性权衡,作者进一步建议从随机分布中对控制重建难度的超参数进行采样,而不是全局设置它,并使用去噪图像微调下游网络。实验结果表明:作者的预训练去噪自动编码器可以有效地对抗不同的白盒、灰盒和黑盒攻击,而无需使用对抗性图像进行训练,同时不会损害微调模型的准确度。

论文下载:https://arxiv.org/pdf/2302.01056.pdf

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢