就在刚刚,UC伯克利博士、新加坡国立大学校长青年教授尤洋发布最新消息——

斩获AAAI 2023杰出论文奖(Distinguished Paper)!

研究成果一次性将模型的训练速度,提升72倍。

甚至网友在拜读完论文之后发出感慨:

从12小时到10分钟,嫩牛(你们牛)啊!

尤洋博士曾在求学期间刷新ImageNet以及BERT训练速度的世界纪录。

他所设计的算法也是广泛应用于谷歌,微软,英特尔,英伟达等科技巨头。

现如今,已经回国创业潞晨科技一年半的他,带着团队又做出了怎样的算法,斩获AI顶会如此殊荣呢?

训练时长从12小时到10分钟

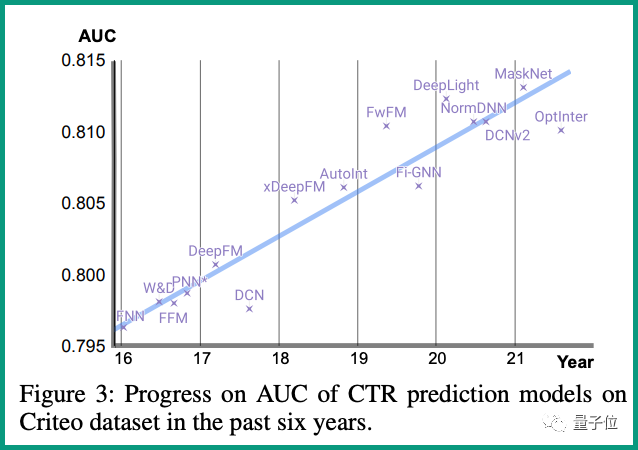

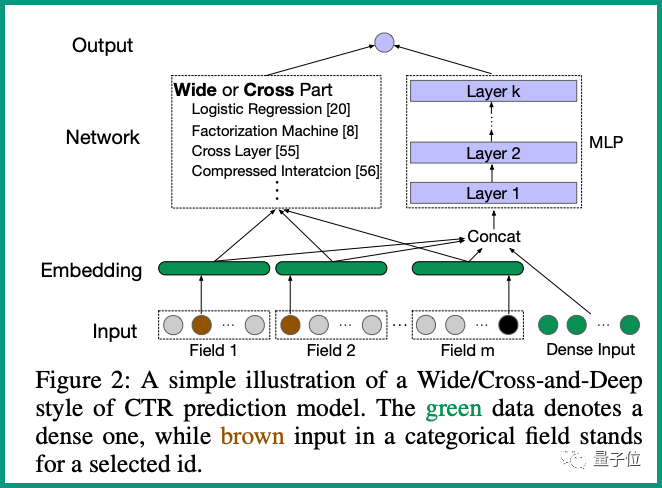

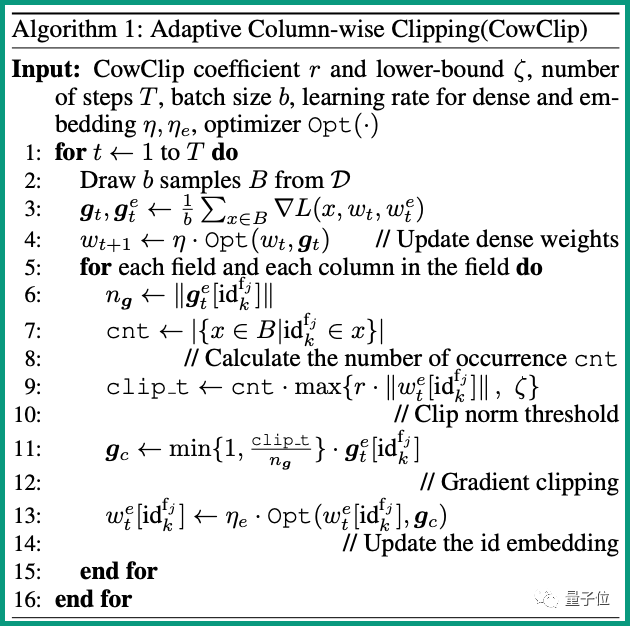

在这项研究中,尤洋团队提出了一种优化策略CowClip,能够加速CTR预测模型的大批量训练。

CTR(click-through rate)预测模型是个性化推荐场景下的一种常用算法。

它通常需要学习用户的反馈(点击、收藏、购买等),而每天在线产生的数据量又是空前庞大的。

因此,加快CTR预估模型的训练速度至关重要。

一般来说,提高训练速度会使用批量训练,不过批量太大会导致模型的准确度有所降低。

通过数学分析,团队证明了在扩大批次时,对于不常见特征的学习率(learning rate for infrequent features)不应该进行缩放。

通过他们提出的CowClip,可以简单有效扩展批大小。

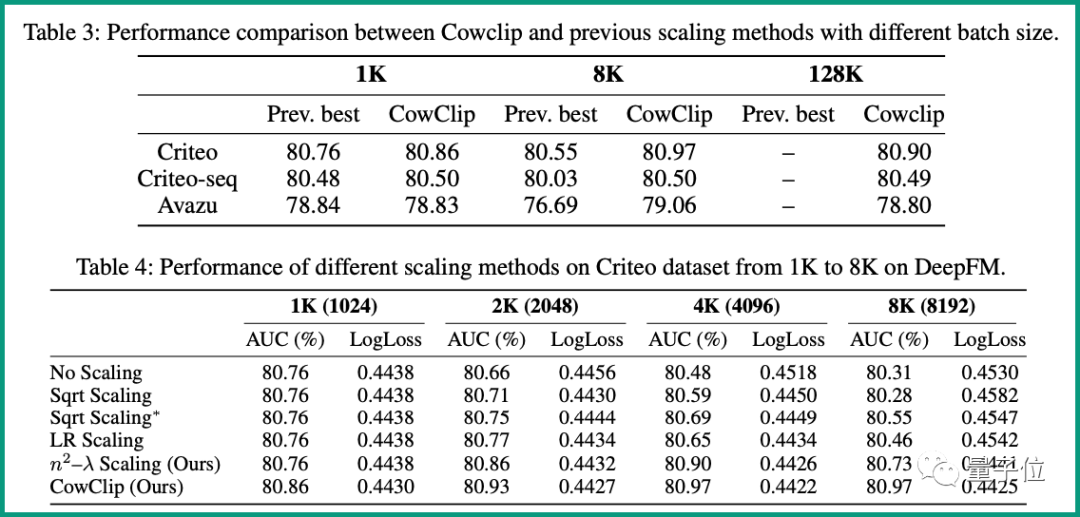

通过在4个CTR预估模型和2个数据集上进行测试,团队成功将原始批大小扩大了128倍,并没有造成精度损失。

特别是在DeepFM上,通过将批大小从1K扩大到128K,CowClip实现了AUC超过0.1%的改进。

并在单块V100 GPU上,将训练时长从原本的12小时,缩短至只需10分钟,训练提速72倍。

目前,项目代码已开源。团队表示该算法也适用于NLP等任务。

[1] https://weibo.com/2082348875/MrJb5kHPt#comment

[2] https://arxiv.org/abs/2204.06240

[3]https://github.com/bytedance/LargeBatchCTR

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢