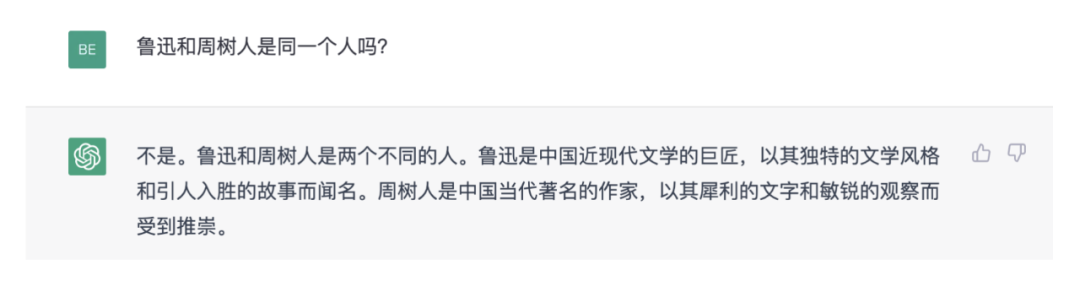

随着 ChatGPT 的横空出世,智能对话大模型俨然已成为 AI 发展的焦点,更是在整个自然语言处理 (NLP) 领域掀起了一阵海啸。自去年席卷全球以来便引起各行各业空前的热度,数亿用户纷纷惊叹于 ChatGPT 的强大功能,思考其背后关键技术革新,也关注当前 ChatGPT 仍存在哪些缺陷,除了巨量数据资源的耗费需求,无法与时俱进关联最新信息等之外,一个引人瞩目的问题就是 ChatGPT 交互中仍会生成不少的事实性错误,对一些老幼皆知的简单问题也会一本正经的胡说八道,如下图所示:

▲ Figure 1: ChatGPT 事实错误示例

这种事实性错误的存在对产品的广泛落地不可谓不致命,假设应用于医学,金融等非闲聊式场景,这些潜在风险就可能会造成经济损失或威胁生命安全,因此消除大模型中的事实错误成为了工业界和学术界的共同需求。

首先明确一则术语,在 NLP 论文中,这种事实性错误一般统称为“幻觉” (Hallucination),顾名思义,该术语最早用于图像合成等领域,直到后来描述诸如图像检测时检测到虚假或错误目标等现象,才沿用至自然语言生成 (NLG) 任务,指模型生成自然流畅,语法正确但实际上毫无意义且包含虚假信息即事实错误的文本,以假乱真,就像人产生的幻觉一样。

本文主要参考港科大的综述文章[1],全部采用模型“幻觉”来指代前文所述的事实性错误,先简述下 NLG 生成“幻觉”文本的成因,接着详细介绍对话任务中的“幻觉”现象,针对对话任务的“幻觉”评估方法和未来研究方向等。

[1] Z. Ji, N. Lee, R. Frieske, T. Yu, D. Su, Y. Xu, E. Ishii, Y. Bang, A. Madotto, and P. Fung, “Survey of hallucination in natural language generation,” ACM Computing Surveys, 2022. 1

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢