作者:M Kosinski

[Stanford University]

要点:

-

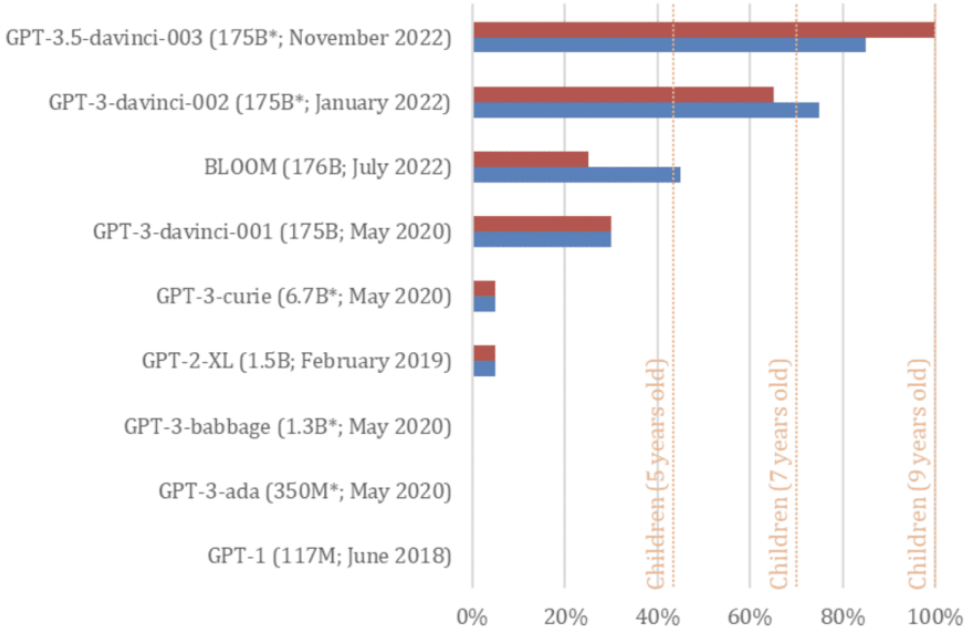

最近的语言模型,特别是2022年1月版本的GPT-3和2022年11月版本的GPT-3.5,在解决心智任务方面表现出显著的性能,分别与7岁和9岁儿童的性能相当; -

2022年以前发表的模型几乎没有显示出解决心智任务的能力,而最近的和最大的模型显示出很高的性能,这表明类似心智的能力可能是作为语言模型提高语言技能的副产品而自发涌现的; -

类心智能力在语言模型中的出现,可能对人工智能的发展产生重大影响,改善其与人类互动和交流的能力,并发展其他依赖心智的能力,如移情、道德判断或自我意识。 -

该研究强调了将心理科学应用于研究复杂的人工神经网络的有用性,以及人工智能提供对人类认知的洞察力的潜力。

总结:

研究了语言模型是否能自发地发展心智(ToM),即把无法观察到的心理状态归因于他人的能力。在没有任何预训练的情况下,对几种语言模型进行了广泛用于测试人类心智的 false-belief 任务。其结果显示,最近的语言模型在心智任务中取得了很好的表现,表明类似心智的能力可能是作为语言模型提高语言技能的副产品而自发涌现的。

摘要:

心智理论(ToM),或将无法观察到的心理状态归于他人的能力,是人类社会互动、交流、移情、自我意识和道德的核心。本文对几种语言模型进行经典的 false-belief 任务,这些任务广泛用于测试人类心智,没有任何样本或预训练。结果显示,在2022年之前发表的模型几乎没有显示出解决ToM任务的能力。然而,2022年1月版本的GPT-3(davinci-002)解决了70%的心智任务,这一性能与7岁儿童相当。此外,其2022年11月的版本(davinci-003)解决了93%的心智任务,与9岁儿童的表现相当。这些发现表明,类似心智的能力(迄今为止被认为是人类独有的)可能是作为语言模型提高语言技能的副产品而自发涌现的。

https://arxiv.org/abs/2302.02083

Theory of mind (ToM), or the ability to impute unobservable mental states to others, is central to human social interactions, communication, empathy, self-consciousness, and morality. We administer classic false-belief tasks, widely used to test ToM in humans, to several language models, without any examples or pre-training. Our results show that models published before 2022 show virtually no ability to solve ToM tasks. Yet, the January 2022 version of GPT-3 (davinci-002) solved 70% of ToM tasks, a performance comparable with that of seven-year-old children. Moreover, its November 2022 version (davinci-003), solved 93% of ToM tasks, a performance comparable with that of nine-year-old children. These findings suggest that ToM-like ability (thus far considered to be uniquely human) may have spontaneously emerged as a byproduct of language models' improving language skills.

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢