论文标题:

Back Razor: Memory-Efficient Transfer Learning by Self-Sparsified Backpropagation

https://openreview.net/pdf?id=mTXQIpXPDbh

https://github.com/VITA-Group/BackRazor_Neurips22

从大的数据集到下游任务的迁移学习广泛使用。训练得到的模型作为预训练模型可以提升模型泛化能力。

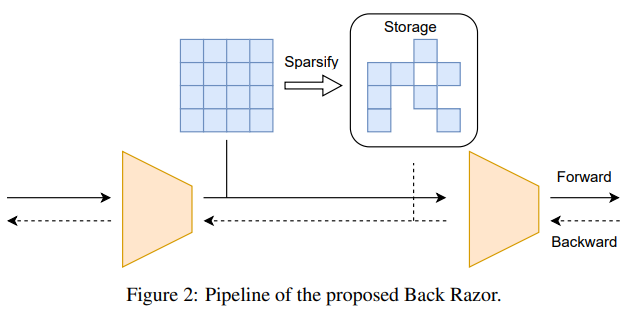

本文给出了一种一般的激活层压缩算法 Back Razor。受到激活值存储只用于后向传播的启发,本文提出了非对称剪枝策略,即旨在后向传播过程中使用稀疏的激活层权重。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢