ChatGPT爆火,Meta也坐不住了。

微软和谷歌正在搜索引擎那边刺刀拼刺刀呢,谁想Meta冷不防抛出一篇新论文,顿时吸引全场目光:

瞄准ChatGPT的“软肋”,让大语言模型自行学会了使用工具!

简单来说,基于Meta的这个思路,ChatGPT这些大语言模型可以缺啥补啥:

不会算数,就自己掏出计算器计算;需要最新信息,就自己连接搜索引擎搜索……

是不是有点AI自己操作自己内味儿了?

论文一出,不少AI研究者就将其视作“过去几周里最重要的论文”。

这篇论文给人们打开了思路,让大语言模型未来可以成为所有事情的起点。

还有网友表示:我老婆原本不太关心AI,听说Meta这论文都惊了。普通人真的得好好想想这事儿了。

自学工具用法的大语言模型

这一回,Meta给这个会使工具的语言模型起名Toolformer。

Toolformer的内核逻辑,总结下来很简单,就是:

专业的任务交给专业的工具来做。

在生成文本的过程中,遇到特定的任务,Toolformer会直接调用所需工具的API。

比如说,在执行这个任务:1400名参与者,有400人通过了测试,占多大比例?(为了让ChatGPT掌握数学运算,OpenAI可没少折腾,详见量子位:ChatGPT连夜迭代:你老婆不好使了)

Toolformer丝毫不慌,直接“掏出”计算器,现场计算得出结果:29%。

又或者说,想要备注个事情,只知道是周五,具体日期还不知道?

没关系,翻出日历查一下就好了。

甚至翻译任务也可以直接丢给它,各国语言都能够识别并翻译,直接省去了在软件切换语言的工夫。

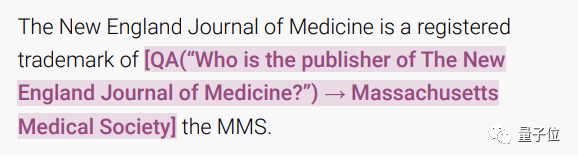

除了这些工具之外,Toolformer还能够调用Q&A以及搜索引擎等工具。

这时,就已经有网友开始畅想未来了:

现在,ChatGPT版必应能帮你比较酒店价格,那未来有了Toolformer,预定性价比高的酒店岂不是也可以甩给AI去做了。

不过话说回来,Toolformer面对不同的任务都能行云流水般地调用对应的工具,它是怎么做到的呢?

一言以蔽之,Toolformer经过训练,能够在生成文本中插入API调用,直接将任务外包出去。

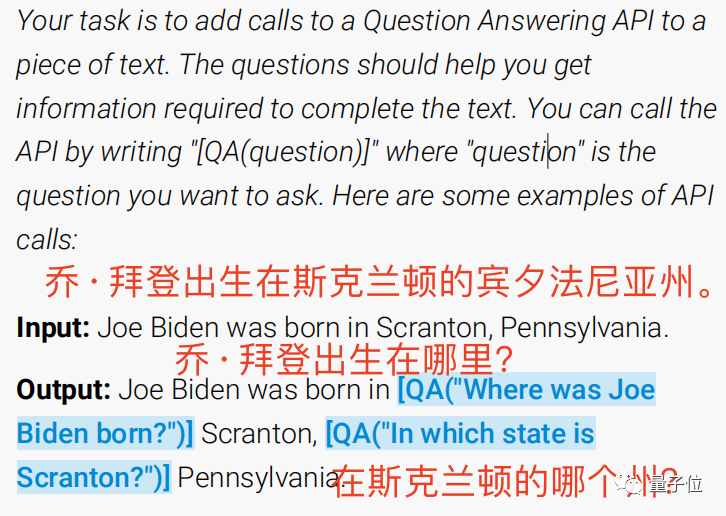

在这其中,训练的过程是以自监督的方式完成的。这意味着无需大量人类标注好的数据,Toolformer只需要少量演示就能学会调用API。

具体来说,先给Toolformer提供少量已经手动标注好的例子,然后让语言模型在实践中生成一个更大的包含示例的数据集。

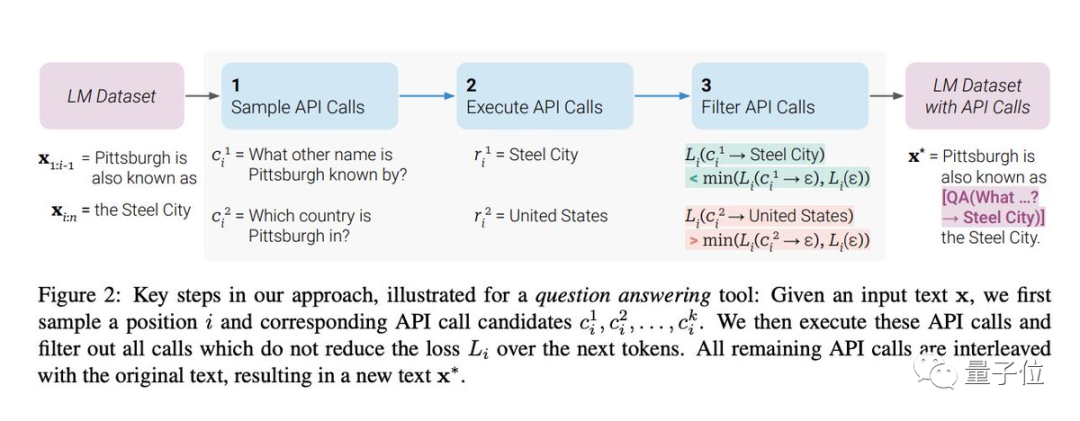

这个过程主要分成三步:

首先是取样,通俗点讲就是看输入的文本提示中,哪个地方需要调用哪种工具,然后直接将“调用的API”插入到对应的地方;

其次是执行,执行上一步的“调用API”任务,将生成的文本直接插入进去;

最后是过滤,上一步中工具生成的文本如果对输入文本来说用处不大的话,就可以直接pass掉,保留对文本有用的地方。

这样一来,基于这些有用的数据集,Toolformer便可以对预先训练好的大语言模型进行微调。

论文地址:

https://arxiv.org/abs/2302.04761

参考链接:

[1] https://twitter.com/timo_schick/status/1624058382142345216

[2] https://twitter.com/mathemagic1an/status/1624870248221663232

[3] https://twitter.com/Tisoga/status/1624543837745192960

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢