前几周,Meta发布了自家的大型语言模型LLaMA,参数量从70亿到650亿不等。论文中,仅用1/10参数的LLaMA(130亿)在大多数基准测试下超越了GPT-3。对于650亿参数的LLaMA,则与DeepMind的Chinchilla(700亿参数)和谷歌的PaLM(5400亿参数)旗鼓相当。

近日,国外论坛4chan上泄露了LLaMA的成品库。上周四,用户llamanon在4chan的技术板上发帖,通过种子文件(torrent)发布7B和65B的LLaMA模型。这个种子链接目前被合并到了LLaMA的GitHub页面。他还向项目提交了第二个拉请求,该请求提供了一个种子链接,链接到模型的另一组权重。

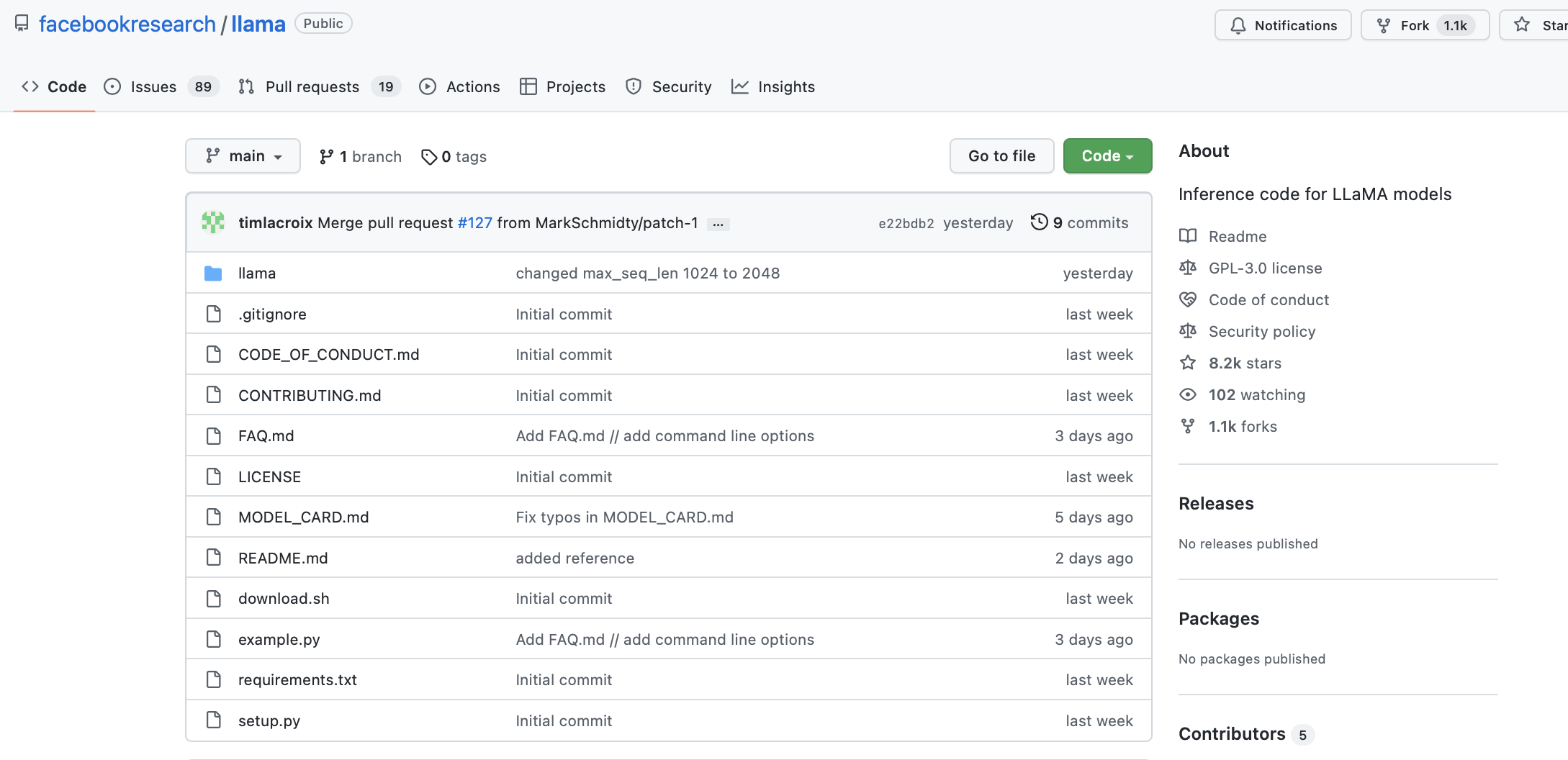

目前该项目在GitHub已收获8k星。

Git地址:https://github.com/facebookresearch/llama/pull/73/files

通过比特和字节库进行浮点优化,他们能够让模型在单个NVIDIA RTX 3060上运行。此外,GitHub 上的一名研究人员甚至能够在Ryzen 7900X CPU上运行LLM的7B 版本,每秒能推断出几个单词。在大规模多任务语言理解方面,即使相对较小的13B模型也与GPT-3水平相当,而GPT-3的规模是其13倍,33B版本远远优于GPT-3, 65B则可与现有最强大的LLM模型--谷歌的540B参数的PaLM竞争。

零样本归类功能,使得人们可以用LLM代替评分员来生成训练集,然后在这些训练集上训练较小的可服务的模型。测试中只有LLaMA-33B会设法遵循所要求格式给出答案,而且其预测是合理的,ChatGPT表现次之,能给出比较合理的答案,但时常不按规定的格式回答,较小的7B、13B模型则不太适合完成这项任务。

在代码生成提示中,给出搜索表的形式和希望达到的目的,要求模型给提供SQL查询语句。在与ChatGPT对比进行的各项测试中,LLaMA并没有如想象中一样大获全胜。当然如果其间差距只是由RLHF(带有人类反馈的强化学习)造成的,那小型模型的未来可能会更光明。

参考资料:

https://medium.com/@enryu9000/mini-post-first-look-at-llama-4403517d41a1

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢