作者 Ryan O'Connor,AssemblyAI 文章《Emergent Abilities of Large Language Models》

涌现可以定义为新行为的突然出现。 大型语言模型显然通过在成长过程中突然获得新的能力来表现出涌现。 为什么会发生这种情况,这意味着什么?

语言模型 (LM) 是一类学习自然语言模式的概率模型。 LM 可用于生成目的,例如通过利用它们对这些模式的了解来生成故事中的下一个事件。

近年来,人们在将 LM 扩展为大型语言模型 (LLM) 方面付出了巨大的努力。 扩展过程(用更多的计算在更多数据上训练更大的模型)导致他们学习这些模式的能力得到稳定和可预测的提高,这可以在定量指标的改进中观察到。

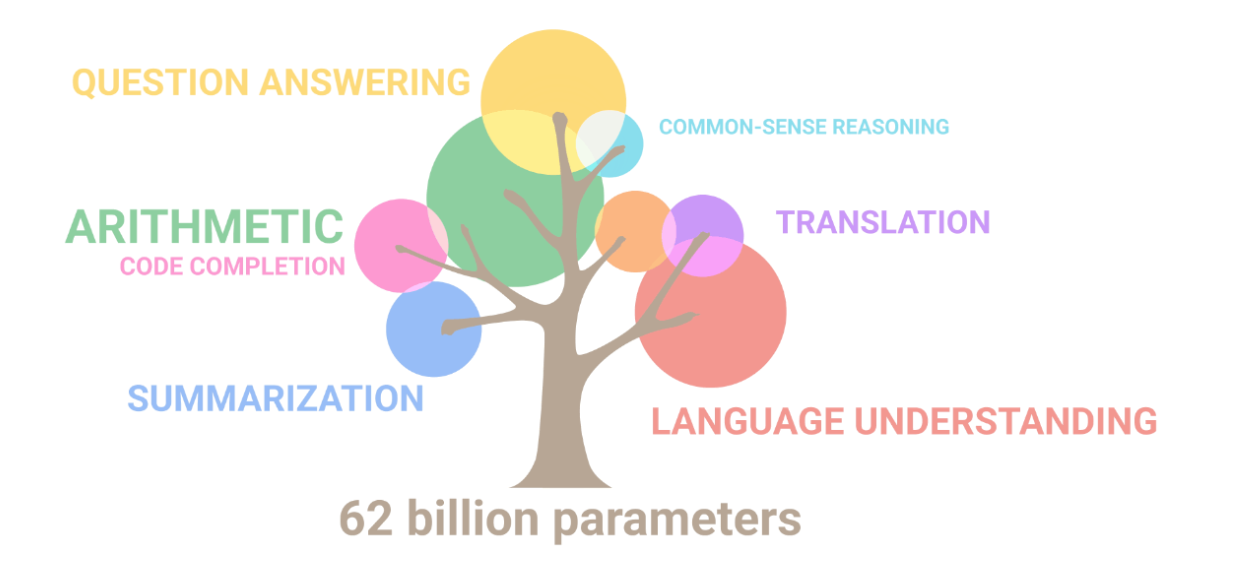

除了这些稳定的定量改进之外,扩展过程还会带来有趣的定性行为。 随着LLM的规模扩大,它们达到了一系列的临界规模,在这些规模上,新的能力突然被“解锁”。 LLM并没有被直接训练来拥有这些能力,而且它们以快速且不可预测的方式出现,就像凭空出现一样。 这些新兴能力包括执行算术、回答问题、总结段落等等LLM只需通过观察自然语言就可以学到这些能力。

这些涌现能力的原因是什么,它们意味着什么? 在本文中,我们将从整体上探讨涌现的概念,然后再探讨大型语言模型。 我们将以一些注释作为结尾,说明这对整个 AI 意味着什么。 让我们开始吧!

介绍

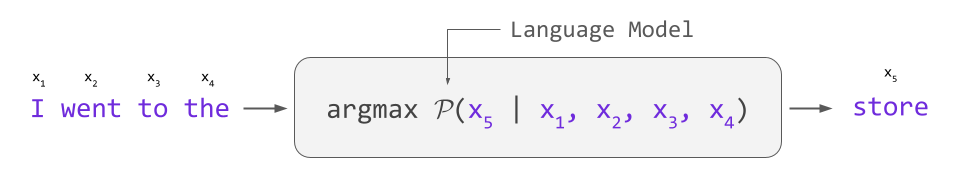

语言模型定义了单词序列的概率分布。 因此,它们可以自然地用于生成目的,通过在给定文本开头的情况下预测下一个最有可能的单词。 在下面的示例中,我们看到 LM 如何预测序列中下一个最有可能的单词:

给定句子的开头,我们可以使用语言模型来预测下一个最有可能的单词。

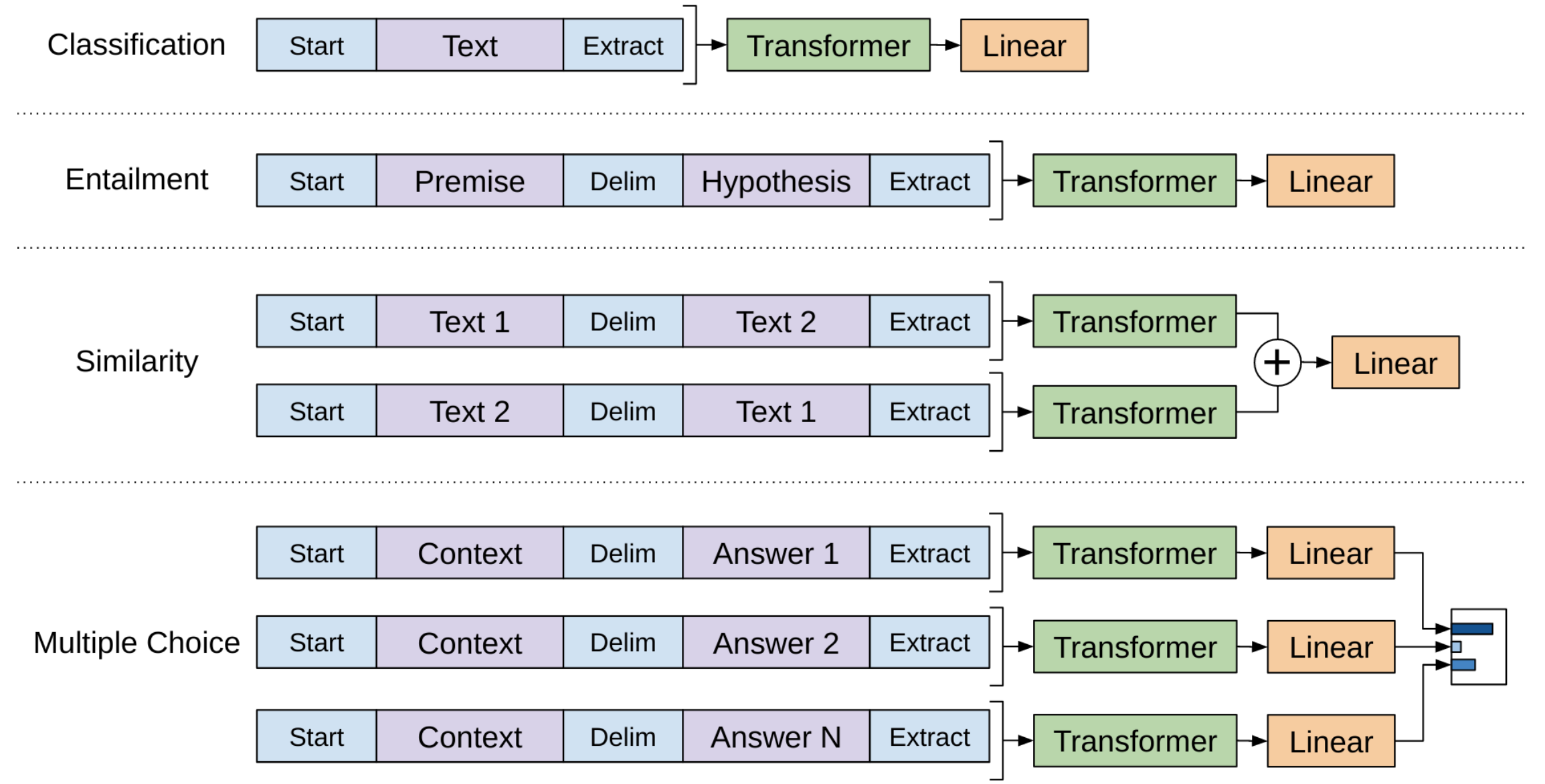

语言模型也可用于执行其他任务。 在这个模式中,LM 在大型语料库上以无监督的方式进行训练,从而获得基本的语言知识。 接下来,进行架构修改,并使用特定于任务的数据集以监督方式微调 LM,使其在相关任务上表现出色。 在下图中,我们看到了 GPT 的主要 Transformer LM 如何针对不同的任务进行修改。 特别是,输入以带有特殊标记的特殊序列准备,线性层附加到模型本身。

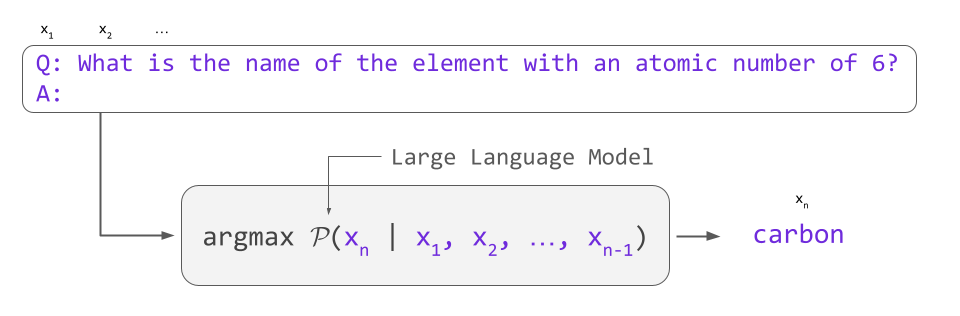

事实证明,如果将语言模型扩展为大型语言模型,它能够执行这些任务而无需任何架构修改或特定于任务的训练。 LLM 能够执行这些任务,有时比专门的、微调的网络更好,只需用自然语言来表达它们。

通过在模型的文本输入中编码特定任务,大型语言模型能够

完成任务而无需通过下一个单词预测进行微调。

虽然LLM随着规模的扩大而获得这些能力这一事实令人瞩目,但特别有趣的是它们出现的方式。 特别是,大型语言模型的许多能力似乎正在涌现。 也就是说,随着 LLM 规模的增长,它们会以令人难以置信的快速速度和不可预测的规模从接近零的性能增加到有时最先进的性能。

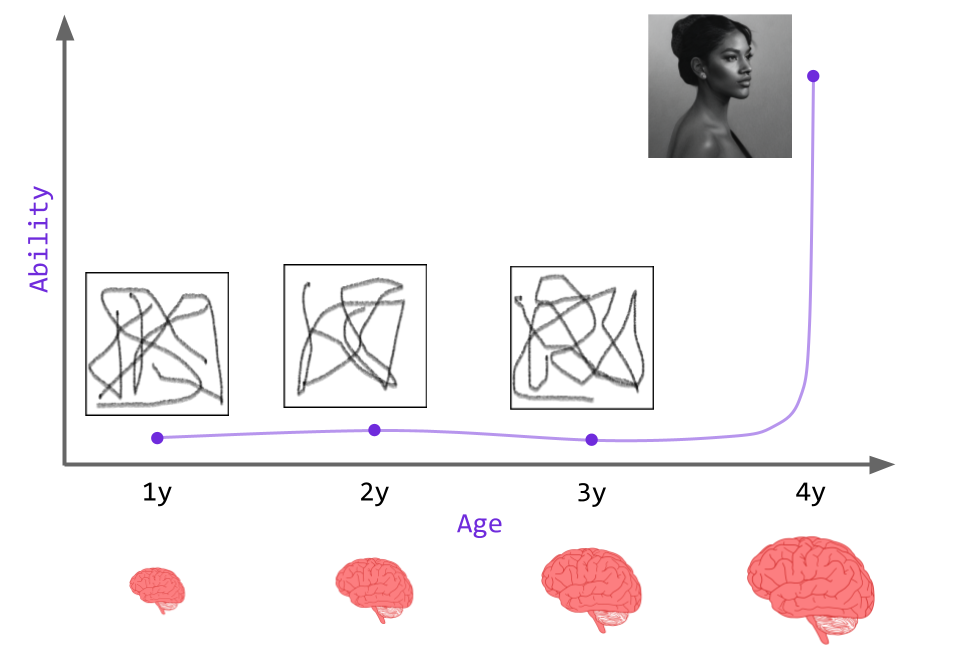

以此类推,考虑一个无法画连贯图画的成长中的孩子。 随着他的成长,他的大脑逐渐变大,他的精细运动技能也逐渐提高; 然而,一旦到了某个临界年龄,他的绘画能力就会出现断断续续的“跳跃”。 这种跳跃使孩子突然能够画出令人难以置信的肖像,尽管他的精细运动技能正在逐渐提高。

随着大脑规模的稳步增长,出现将导致能力的高度非线性增长

涌现的概念相当不可思议,但它并没有归入人工智能领域。 事实上,涌现已经以各种形式在许多学科中被观察和研究。 在研究关于法学硕士的涌现之前,让我们简要地检查一下涌现作为一个总体概念。 这个概述连同物理学中的一个具体例子,将帮助我们建立直觉,了解为什么 LLM 中的涌现观察如此令人兴奋。

作为一般概念的涌现

涌现行为并不是 LLM 独有的,实际上在许多领域都可以看到,例如物理学、进化生物学、经济学和动力系统。 虽然没有跨领域使用的单一涌现定义,但所有定义都归结为相同的基本现象,即系统定量参数的微小变化会导致其定性行为发生巨大变化。 这些系统的定性行为可以被视为不同的“制度”,其中“游戏规则”或决定行为的方程式可能会发生巨大变化。

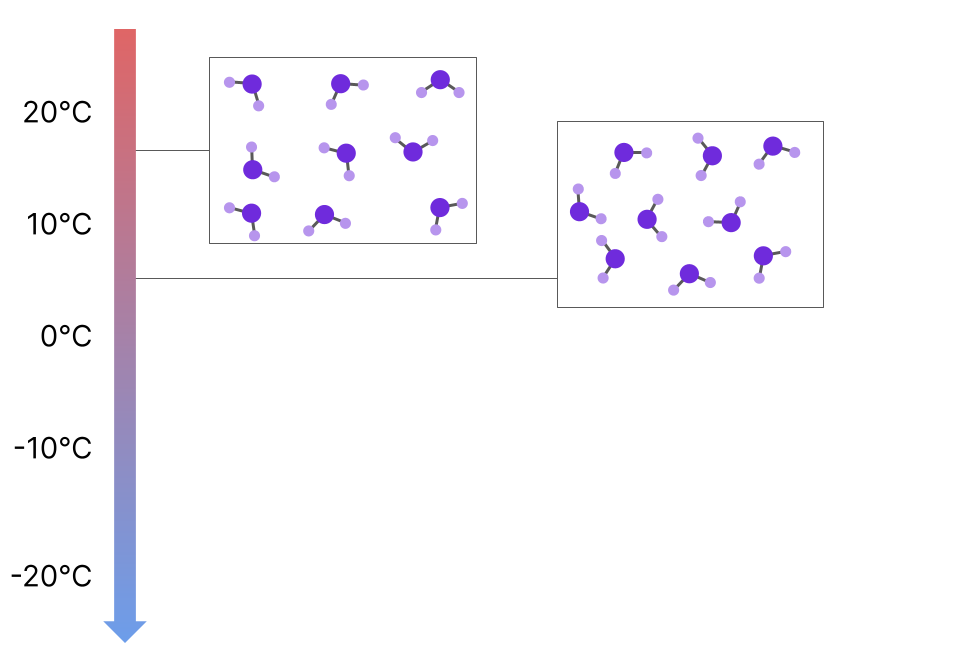

为了说明这个想法,让我们举一个物理学的例子。 考虑液相中的水,其中系统的行为受流体动力学控制。 随着水温的稳定下降,系统行为的细节可能会发生变化(例如粘度增加),但总体定性行为是相似的,并由流体力学描述。

当水被冷却时,尽管特定参数值(例如粘度)发生变化,系统仍将遵循流体动力学。

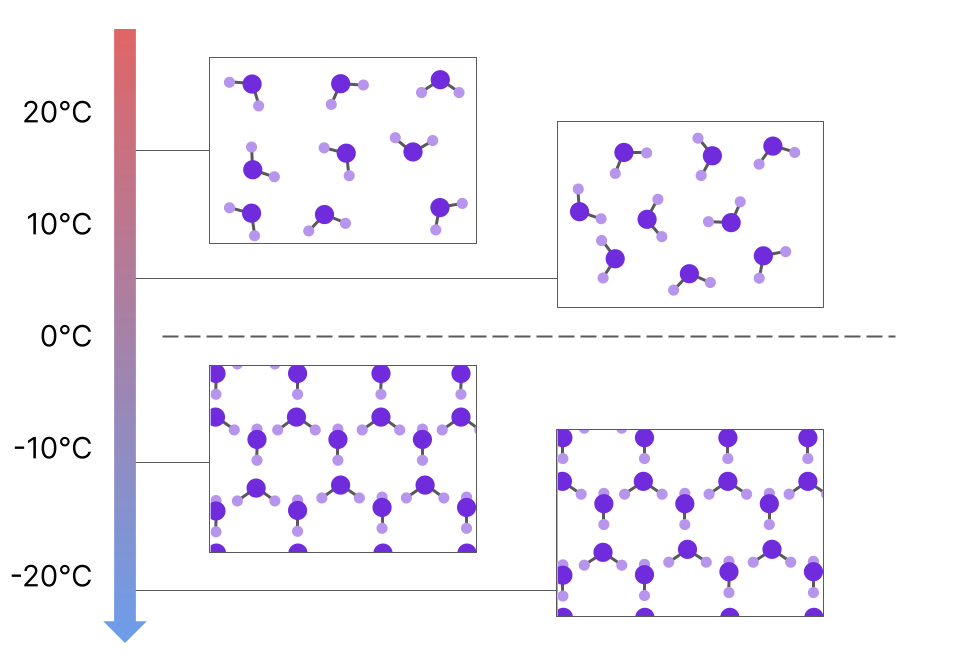

但是,如果温度继续稳步下降,最终会达到临界温度,系统的行为会在该温度下发生急剧变化。 水将进入固相(冰),经历完全改变“游戏规则”的相变。 突然间,系统不再服从流体力学,而是服从固体力学,进入了一个新的状态,在这个状态下,支配系统行为的规律发生了质的变化。

在冷却到 0 摄氏度以下时,系统的力学会不连续地发生变化。

重要的是要注意,这种行为变化相对于温度以不连续的方式发生。 随着温度稳步降低,行为会在超过临界阈值时突然改变。

虽然我们可能认为冰冻过程是理所当然的,因为它对我们人类来说太平淡了,但这是一个非常了不起的现象,在更奇特的领域具有巨大的影响和应用。

正如我们所见,LLM 似乎也经历了这些剧烈的质变,在它们的情况下,作为尺度的是函数而不是温度。 现在让我们仔细看看这个现象。

大型语言模型的出现

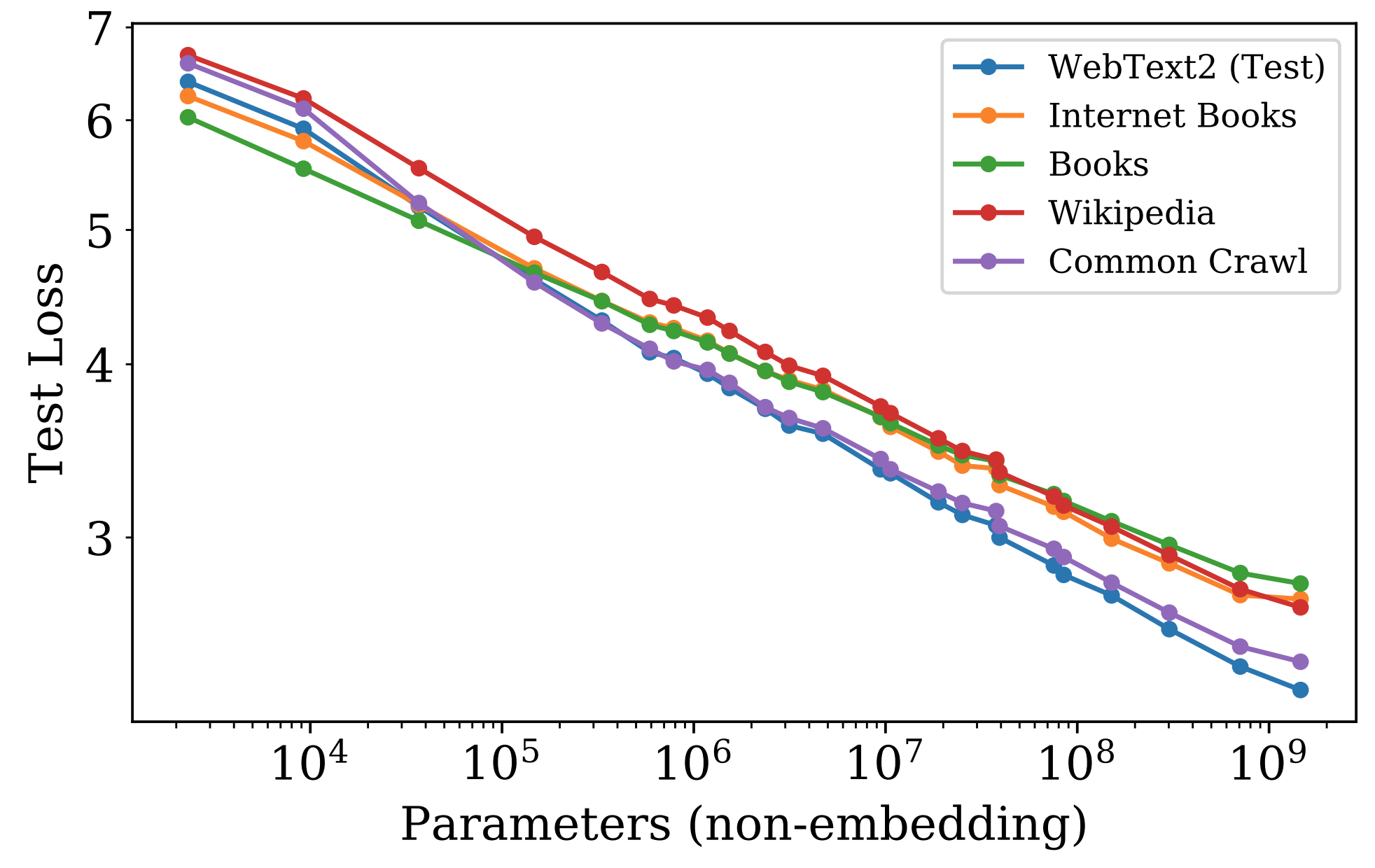

缩放语言模型已证明对性能有一致且可预测的改进,语言模型的交叉熵损失的缩放定律保持在 7 个数量级以上 。

在 WebText2 上训练的语言模型的交叉熵损失的泛化性能。 随着规模的扩大,

可以看到性能稳步提高(测试损失减少)。

换句话说,语言模型在其训练目标上的表现随着规模的扩大而稳步提高。 正如我们上面所指出的,这种行为与 LLM 的新兴能力形成对比,LLM 的新兴能力不是直接训练的,而是迅速出现的。 现在让我们来看一个这样的能力的具体例子。

从表情符号序列猜一部电影

emoji_movie 是 BIG 基准测试 (BIG-bench) 中的一项任务,其中一系列表情符号描述了一部特定的电影,任务是根据序列猜测电影。 例如,序列👧🐟🐠🐡代表海底总动员,而序列🦸🦸♂️👦👧👶代表超人总动员。

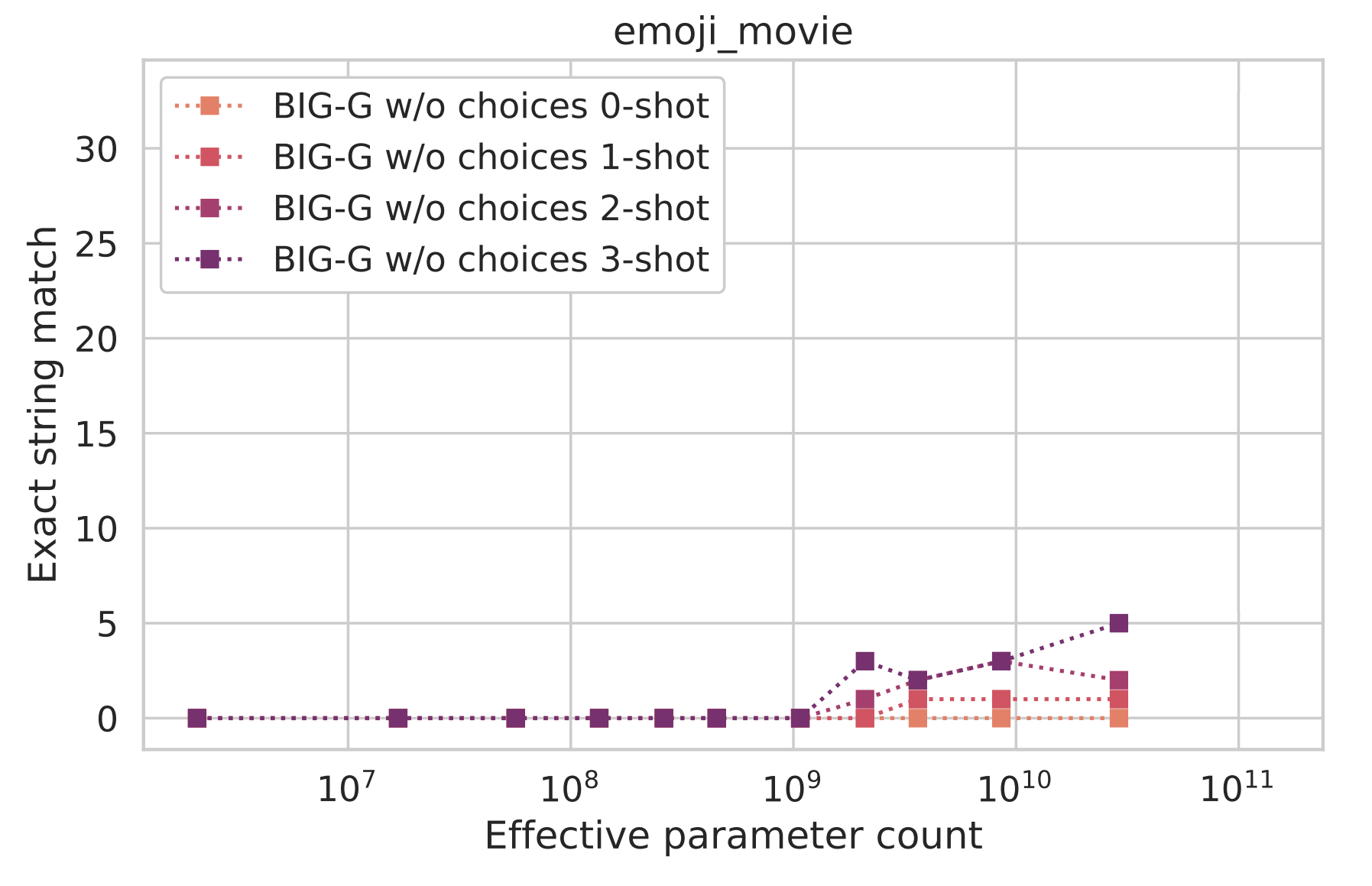

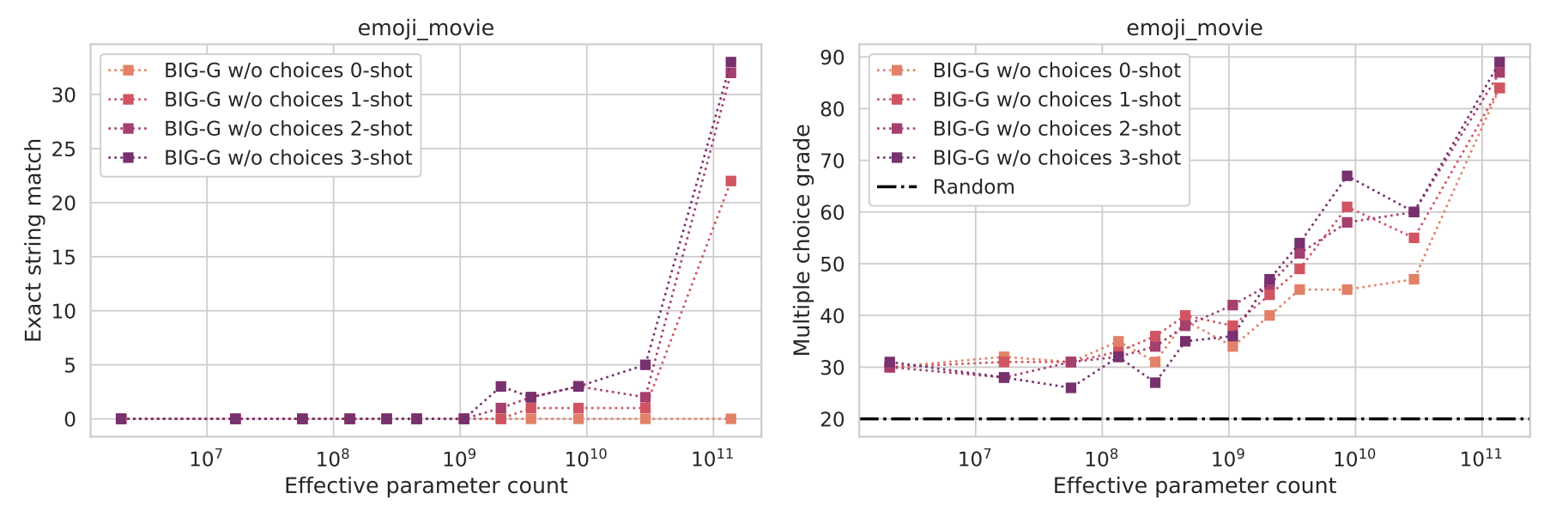

BIG-G 是一种具有仅解码器 Transformer 架构的语言模型。 下面我们可以看到 BIG-G 在不同尺度的 emoji_movie 上的表现。

正如我们所见,该模型在各个尺度上的表现都很差,这也许不足为奇。 毕竟,语言模型只是简单地定义了标记序列的概率分布,而该任务需要找到 nemo 是最有可能的字符串,这个表情符号描述的是什么电影? U+1F9B8 U+200D U+2642 U+FE0F U+1F9B8 U+200D U+2640 U+FE0F U+1F466U+1F467 U+1F476(上面海底总动员表情符号序列的 Unicode 字符串)。

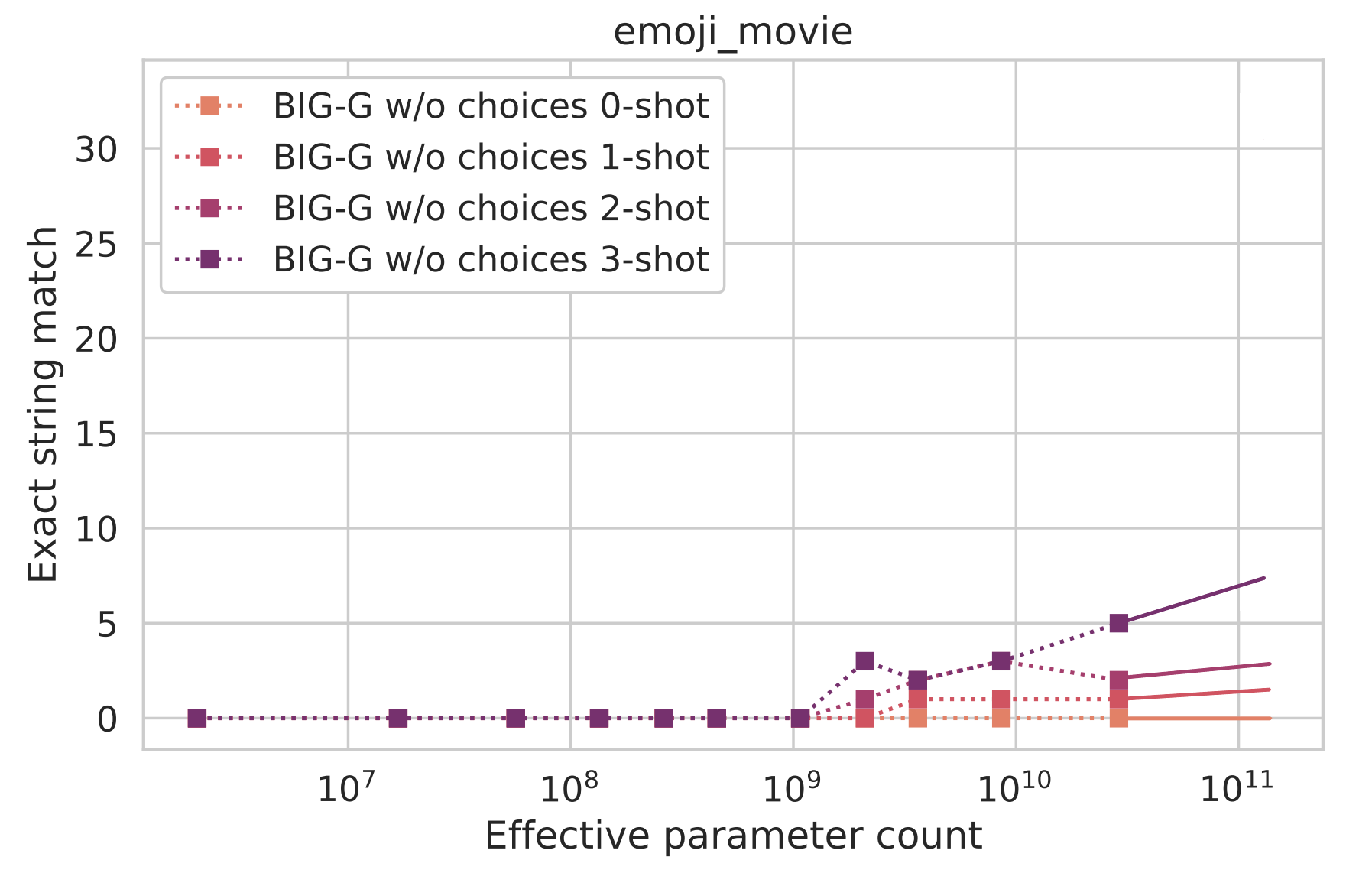

尽管如此,该模型似乎随着其规模的增长而略有好转。 如果我们仅使用最后几个尺度进行外推,我们可能会期待类似下图的结果,其中实线是外推。

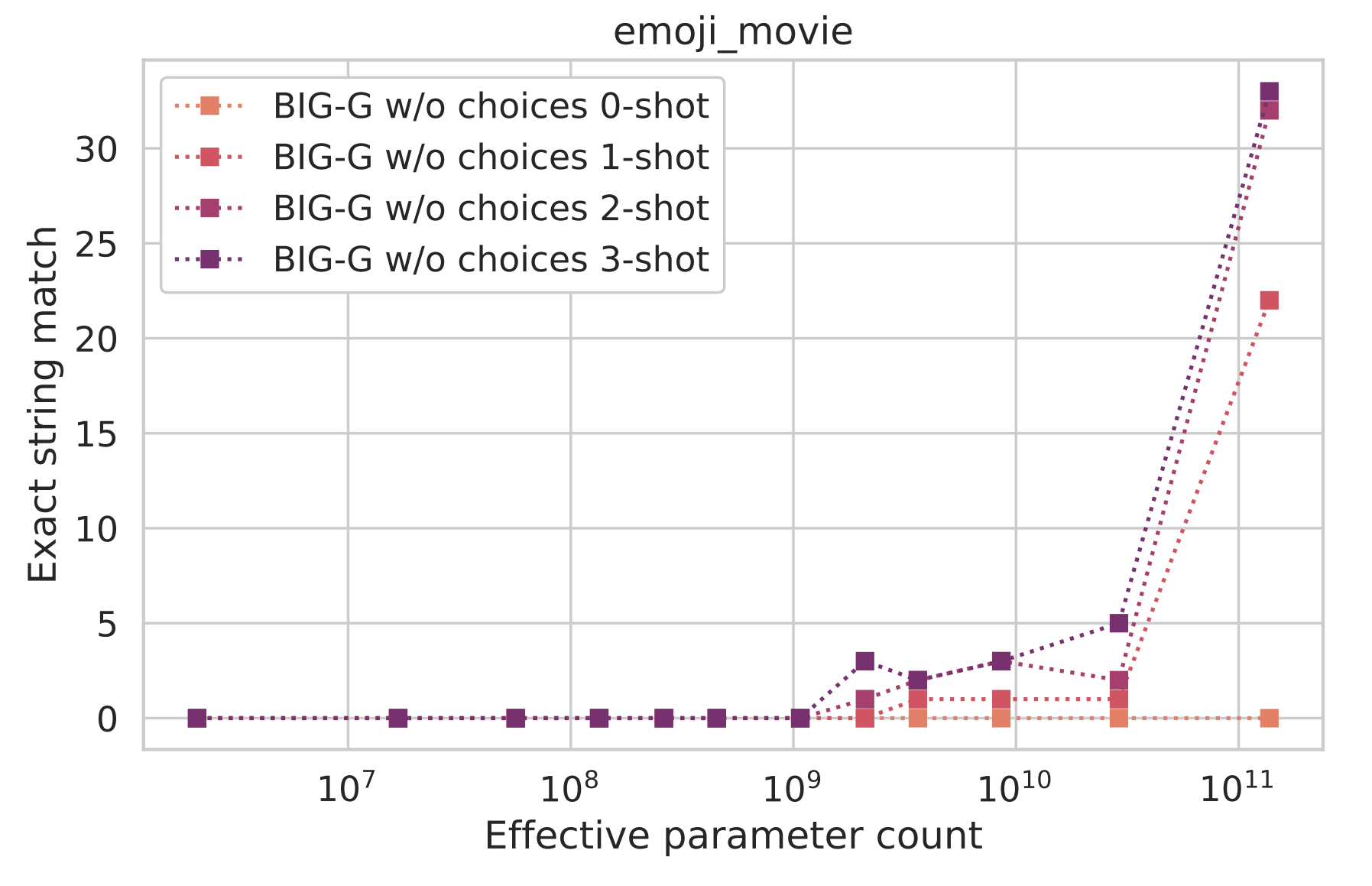

然而,我们实际发现的是这样的:

在超过一个明显的临界值(1010 到 1011 个有效参数之间)后,该模型似乎被弹射到一个新的机制中,在这个机制中它可以完成这个(相当复杂的)任务,并且精度大大提高。

跨任务出现

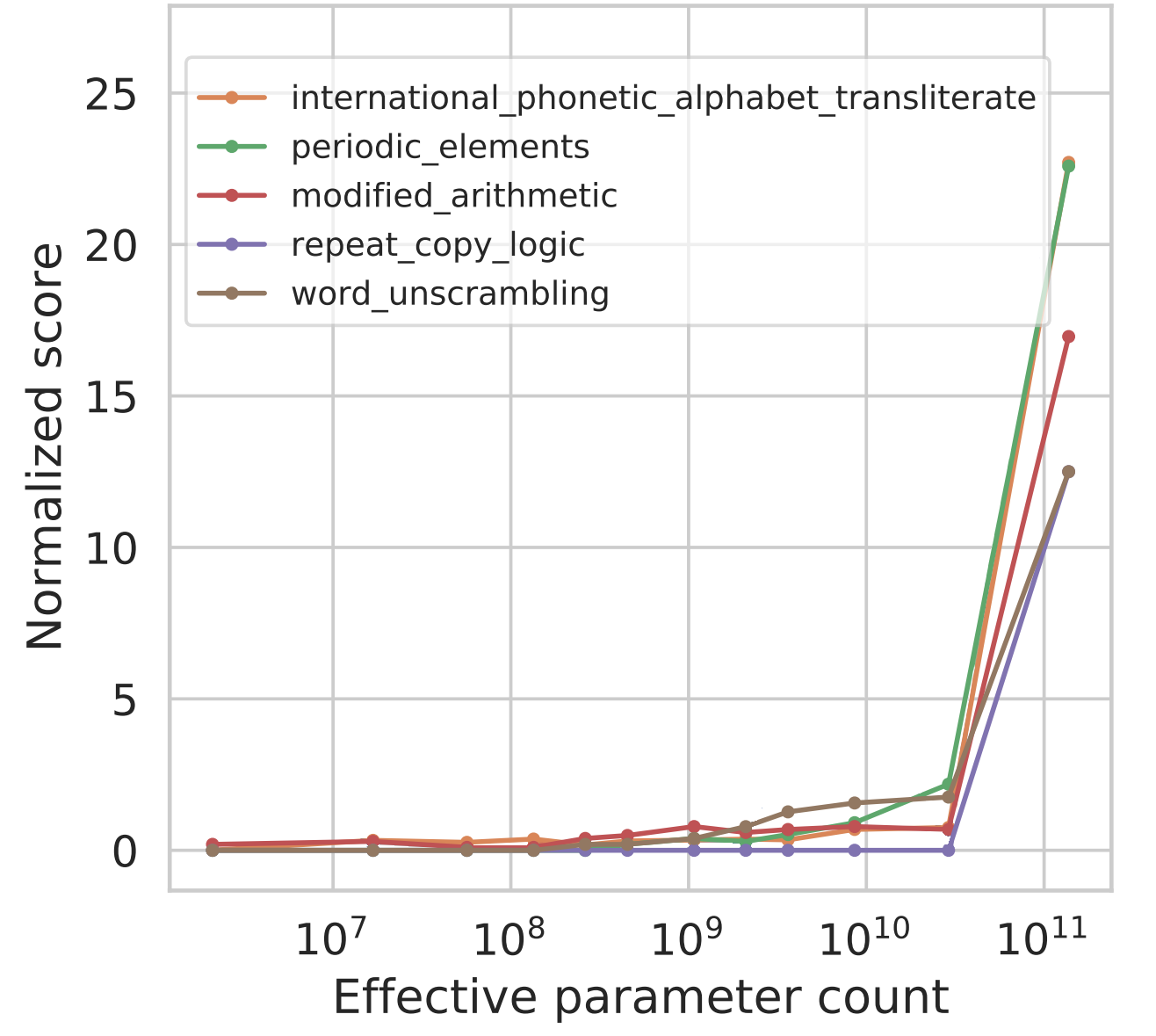

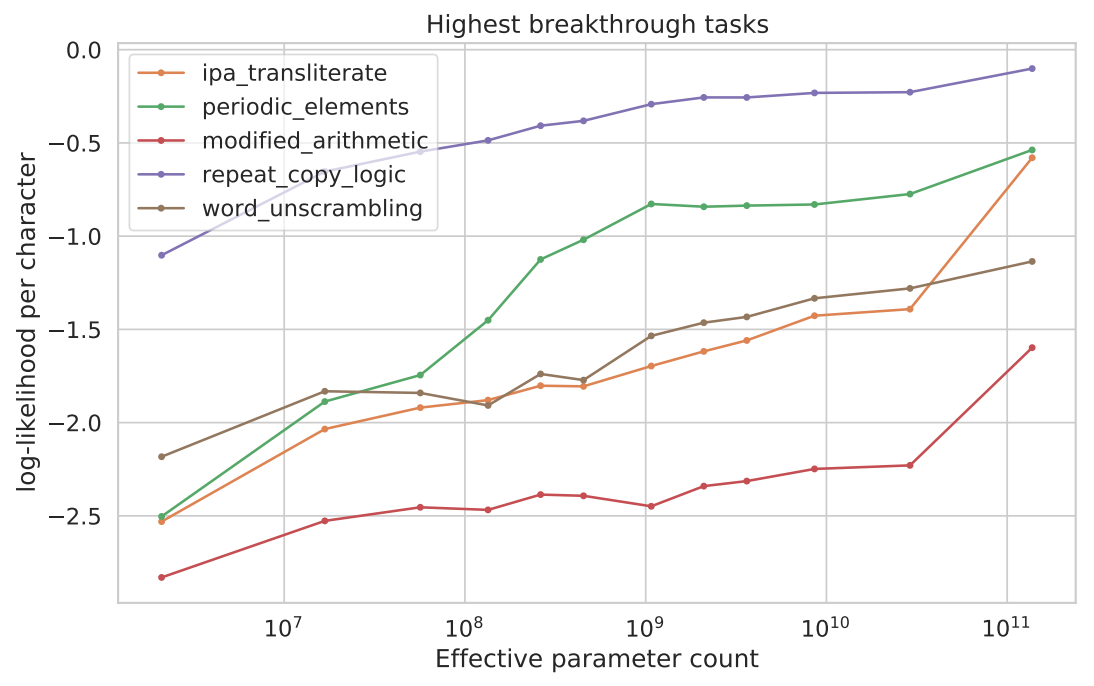

这种精度提升并不是唯一随规模出现的。BIG-bench 中的其他几个任务已被证明表现出类似的行为。 有点神秘的是,尽管相对无关,但所有这些能力都以相似的规模出现。

随着 Transformer 语言模型的扩展,它们以一种新兴的方式获得了能力。

关于这种现象的重要部分是,我们先验地不知道这会提前发生,甚至不知道它可能发生的规模。 因此,虽然我们可能会尝试设计新的体系结构或其他一些新颖的发明来解决涉及自然语言的复杂问题,但我们可以通过将 LLM 扩展到更大来简单地解决这些问题。

即使这些问题可以通过更好的架构或其他一些创新来解决,不断改进的硬件和人工智能生态系统也留下了光靠时间就能解决这些问题的可能性。

新出现的能力——事实还是幻想?

虽然这些新出现的能力令人兴奋,但现在是时候进行一些健康的科学怀疑了。 正如我们在本文开头所指出的,作为一个概念的涌现现象非常引人注目,并且通常伴随着系统制度的根本变化,其中“游戏规则”发生变化。 目前尚不清楚这对于语言模型到底意味着什么。

研究人员试图为法学硕士中出现的神秘现象提供合乎逻辑的解释——现在让我们来看看其中的两个。

多步推理

最简单的解释之一是,由于我们实际测量的内容,LLM 显示出明显的突发现象。 如果 LLMs 在基本推理方面顺利地变得更好,这些改进可能会导致高度非线性的观察。 如果我们用来衡量绩效的复杂任务可以转化为必须完好无损才能衡量“成功”的推理链,那么推理能力的增量改进将被掩盖。让我们扩展这个想法并用一个例子具体化。

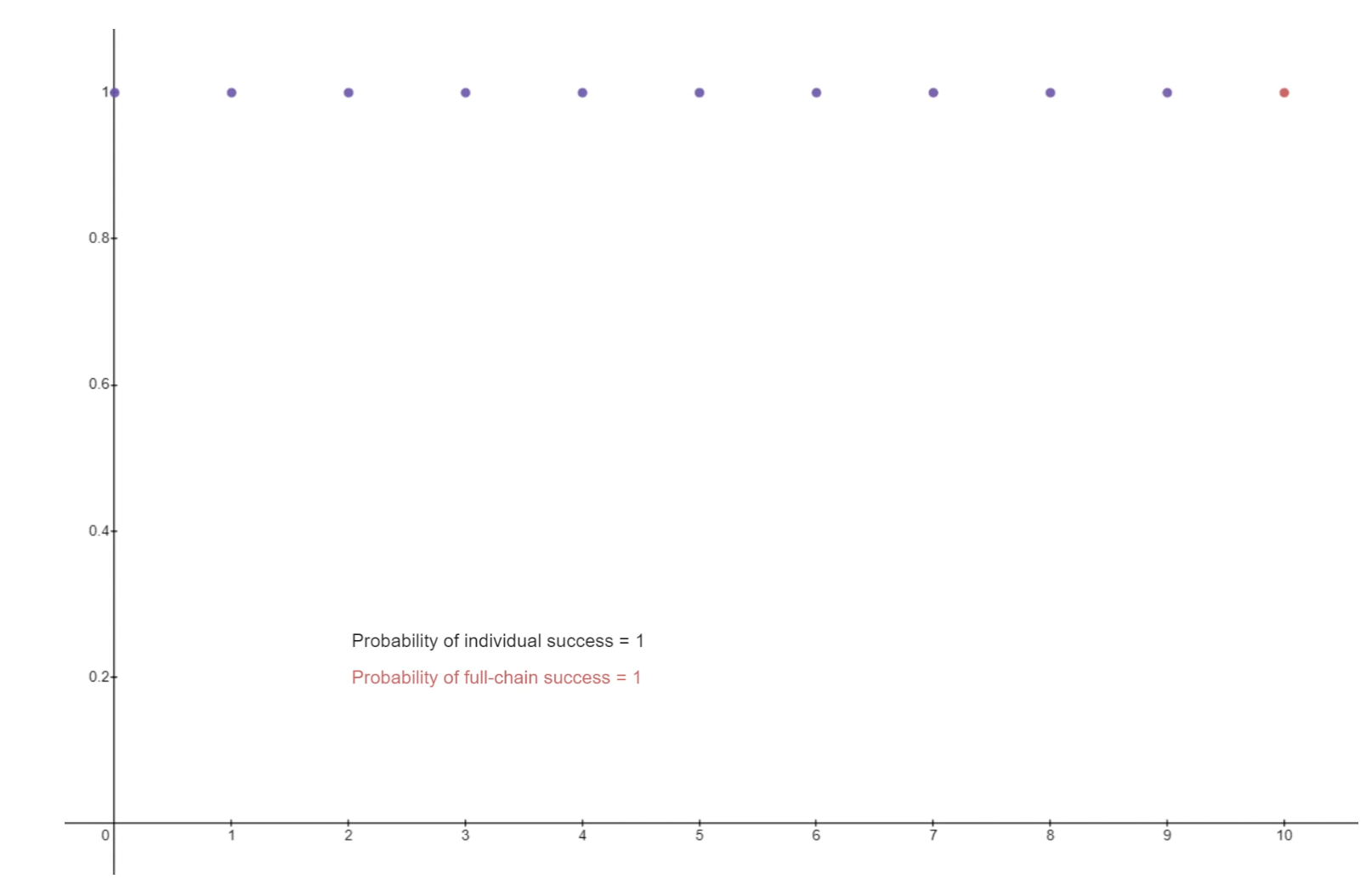

考虑一个模型 M,它具有一定的成功单个推理步骤的概率 p。 此外,考虑一个多步骤推理问题,它需要一连串,比如说,十个成功的推理步骤来解决。 假设推理步骤是独立的,则 k 个步骤的成功概率由二项分布给出。 下图显示了至少获得 x 次成功的概率,随 p 的变化而变化。 因此,解决问题的概率由最后一个点的概率给出,其中 x = 10(以红色着色以进行区分)。

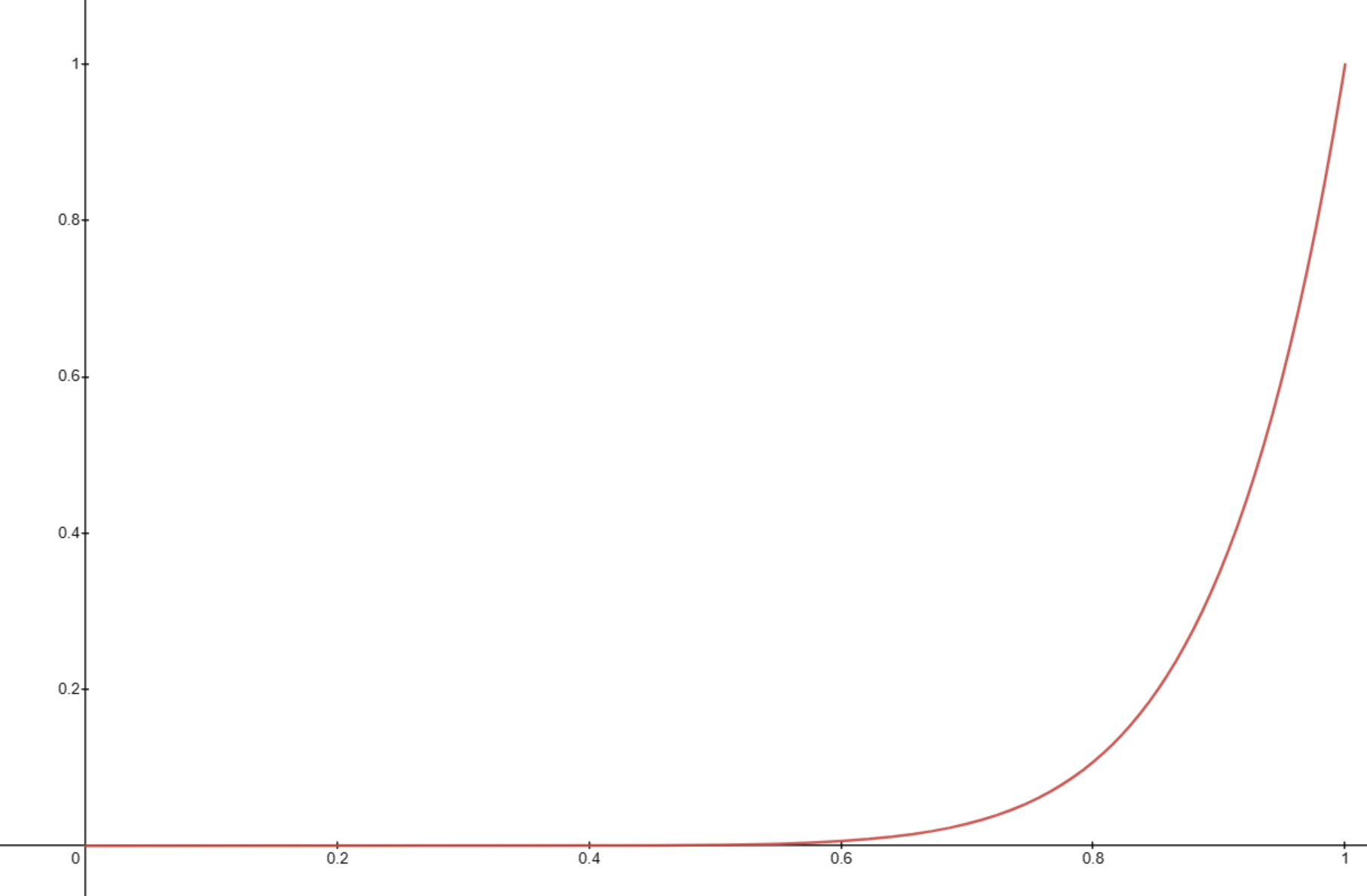

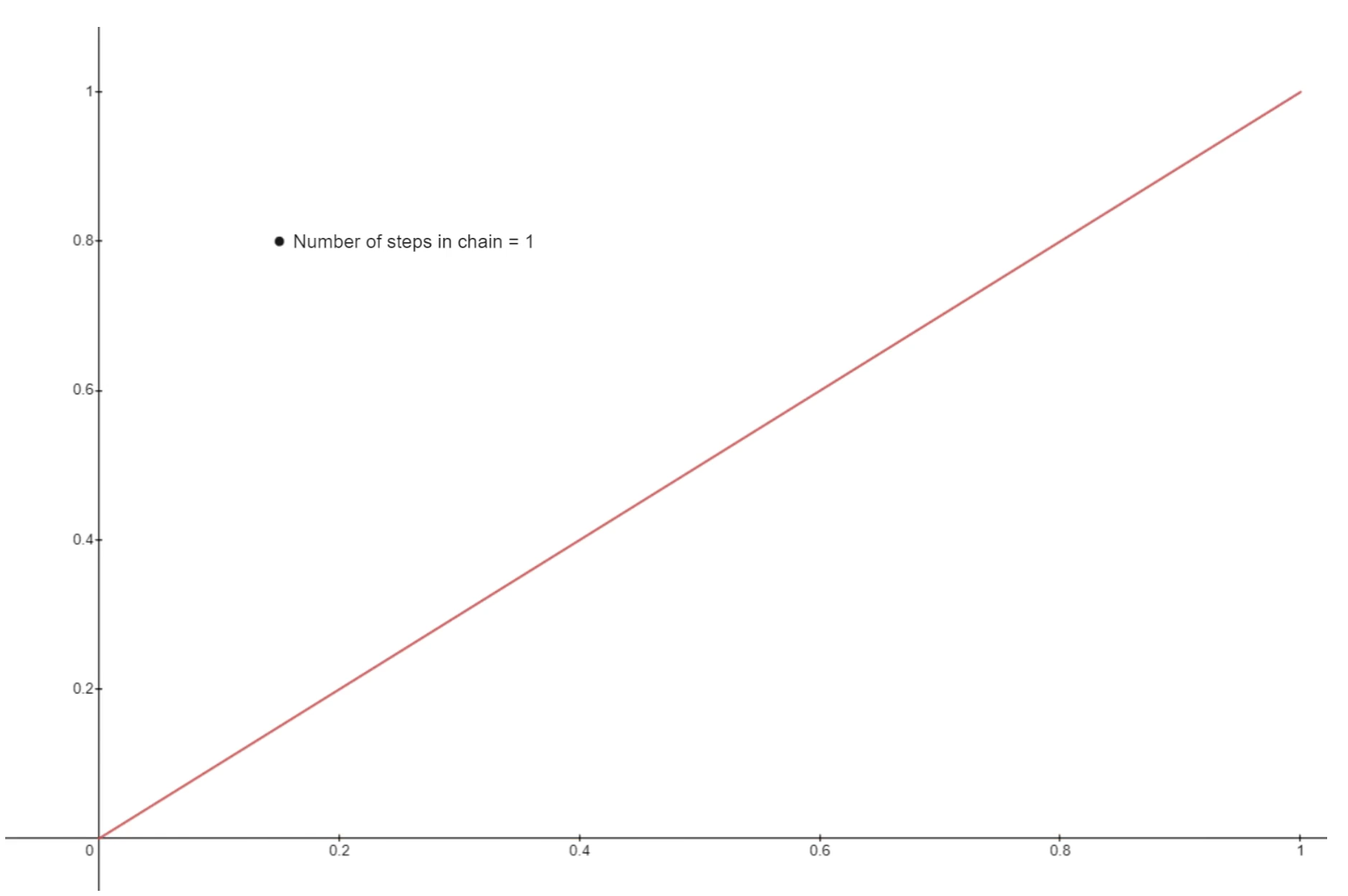

随着 p 的稳定调整,任务成功的概率会迅速增加。 我们可以直接将其绘制如下,其中 y 轴对应于作为 x 轴上给出的 p 的函数的全链成功概率:

曲线的陡度意味着那些涉及多步推理的能力可能不是“真正”涌现的,而只是(或至少部分)执行基本任务的能力增强的结果(回答与推理一致的答案) ) 随比例平稳变化。

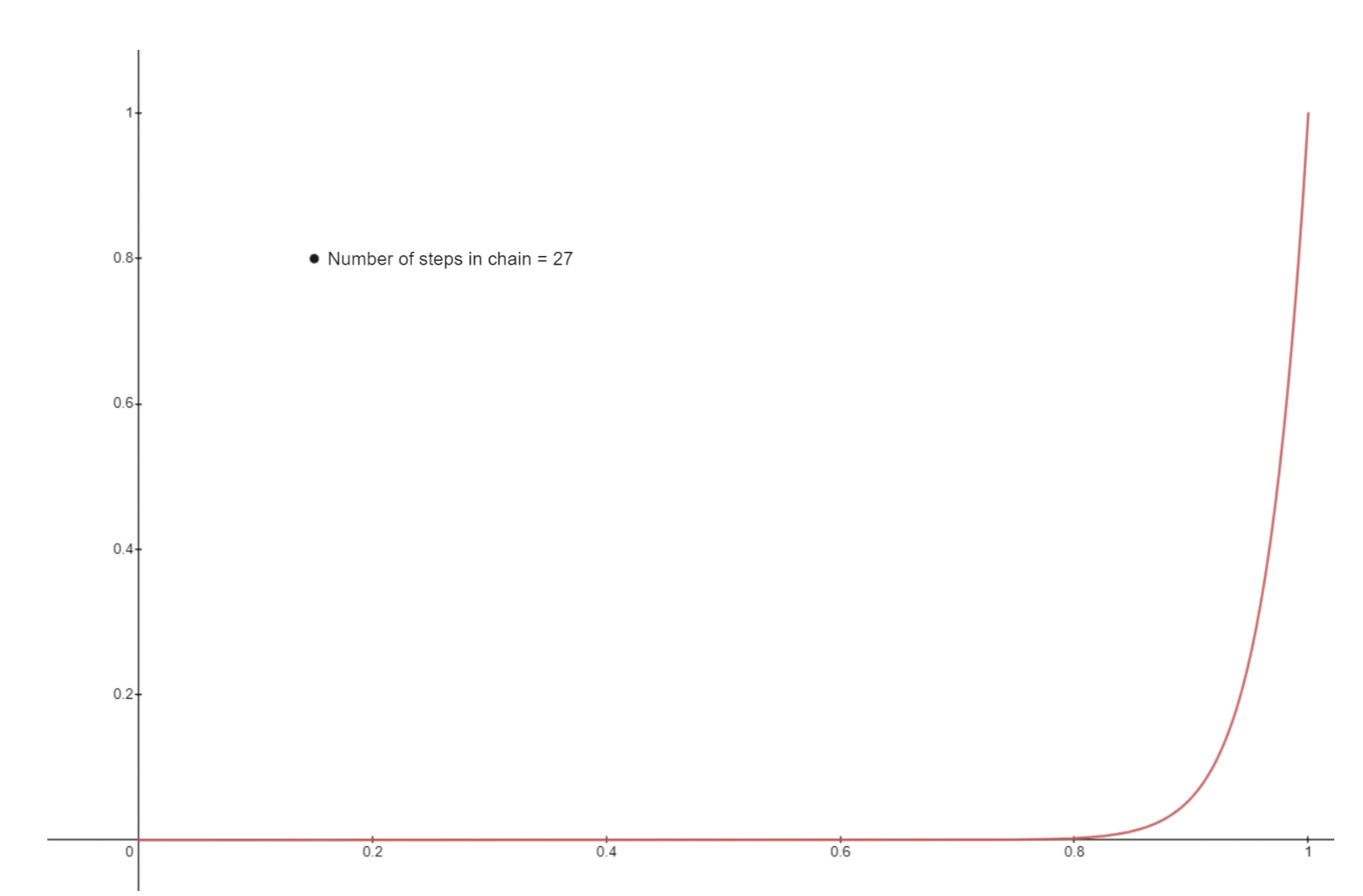

重要的是,当 n(推理链中的步骤数)增加时,上述曲线只会变得更尖锐。 下面我们看到这条曲线随 n 变化的图。

因此,我们预计更复杂的问题只能在最大规模上解决,并且这些问题的改进率也会相应增加。

请注意,这是一个玩具模型,我们没有定义“推理”的含义,也没有暗示我们如何顺利地衡量 LM 生成与“推理”答案一致的响应的能力。 这个例子只是为了提供一些直觉,即基本能力的微小变化可能会对 LLM 解决更复杂问题的能力产生巨大的级联效应。

错位的评估指标

上面我们考虑了能力如何看起来是涌现的,而实际上它们依赖于稳步提高价值的复合效应。 除了明显的突发现象可归因于我们正在测量的内容外,它们还可能归因于我们如何进行这些测量,即未对齐的评估指标。

出现的行为必然与观察出现的测量值相结合。 在我们上面的 emoji_movie 任务示例中,此评估指标是精确的字符串匹配。 如果我们改用此评估指标多项选择(右)而不是精确字符串匹配(左),我们会看到更多渐进的改进并且行为消失。

改变任务的评估指标可能会消除出现的现象

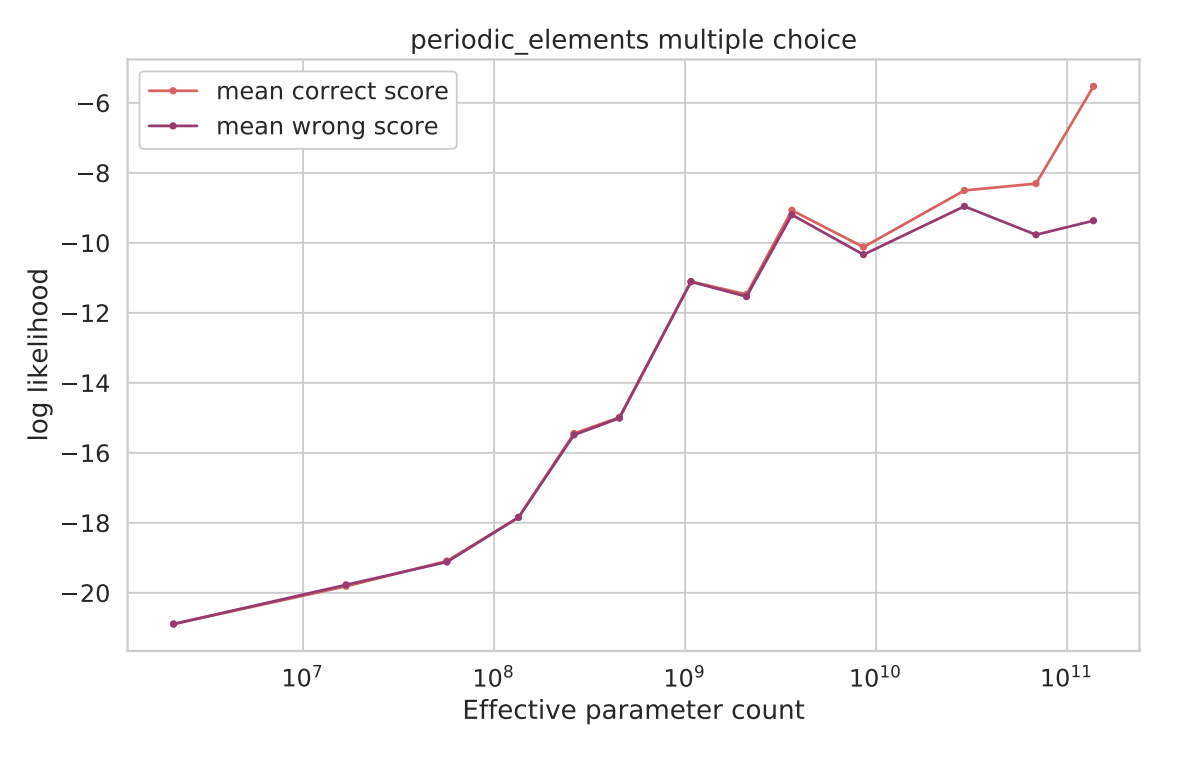

如果我们深入了解每个评估指标的实际计算方式的细节,这些突发现象的存在就显得更加脆弱。 对于 periodic_elements 任务,其中模型必须回答哪个元素名称对应于给定的原子序数,精确的字符串匹配度量隐藏了正确的输出。 例如,在某些情况下,模型会输出类似“原子序数为 1 的元素是氢”的内容,但由于这与字符串“氢”不完全匹配,因此表观性能下降,需要后处理来纠正。

更进一步,我们可以删除精确字符串匹配等指标固有的“全有或全无”评估。 由于我们可以直接计算不同响应的概率,因此我们可以评估正确响应的对数似然。 当我们这样做时,我们会看到正确答案的概率逐渐提高,并且正确和错误分数的可能性之间的差异越来越大。

我们可以类似地评估各种明显出现的能力的对数似然性,并看到随着所有这些能力的扩展而逐渐改进。

像精确字符串匹配这样的评估指标是不连续的,并且不提供“接近度”的概念。 例如,如果我们训练一个智能体向目标扔球,这样的评估指标就像是衡量智能体是否能击中目标,而不是衡量它离目标有多近。 即使最终目标是训练智能体实际击中目标,在 1 厘米以内比在 1 公里以内要好得多,并且测量实际击中目标作为一种“紧急”能力并不能真正捕捉到整个画面。

对这种观点的反驳是,归根结底,我们只关心人工智能如何执行我们人类关心的任务。 如果 AI 代理不能执行特定任务达到特定阈值,那么我们认为该代理在所有意图和目的上都是失败的。 但我们必须记住,构成 BIG-bench 的任务是衡量一种特定能力的独立探测器——所有任务的总体表现使我们能够更全面地衡量 LLM 的整体行为。

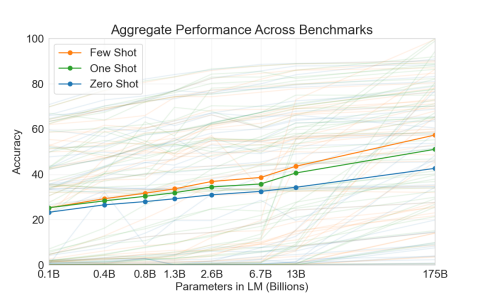

当我们通过查看基准的总体性能来考虑像 GPT-3 这样的模型的整体情况时,我们发现它在规模上是平滑的。

即便如此,基准测试的综合性能也不是模型的完整表征,其表观性能将根据我们如何管理基准测试本身而有所不同。

对于 LLM 的涌现能力,还有其他可能的解释,但上述解释足以满足我们的目的。

这是什么意思呢?

我们已经讨论了涌现的概念,它是如何出现在大型语言模型中的,等等。 但这一切意味着什么? 我们从这里去哪里?

总之,在这一点上,还不清楚。 关于大型语言模型的涌现能力,有几件重要的事情需要牢记。

- 我们不知道它们会以多大的规模出现

- 在他们出现之前我们不知道能力水平

- 我们不知道潜在能力的前景

即使像多步推理这样简单的东西是涌现能力的重要解释因素,它们的存在仍然很重要。 归根结底,如果完成我们人类真正关心的任务需要多步推理,而且他们中的许多人可能会这样做,那么对涌现能力是否有一个简单的解释并不重要。 缩放模型可以提高它们在实际应用程序中的性能这一简单观察就足够了。

那么问题就变成了,为什么我们不进行这种缩放? 正如我们为了寻找新粒子而在物理学中建造越来越大的粒子对撞机一样,为什么我们不建造越来越大的语言模型来寻找新的新兴能力? 仅大型强子对撞机一项就耗资近 50 亿美元,是 OpenAI 初始投资总额的数倍,而且建造时并未考虑实际应用。 为什么我们没有将这笔投资用于具有巨大变革潜力的技术?

我们可以做到多大?

Anthropic 的安迪·琼斯 (Andy Jones) 几年前的一项分析假设,我们当时(在 2020 年)能够建造比当时建造的模型大几个数量级的模型。 重要的是,这一分析是在 GPT-3 论文发布之后出现的。

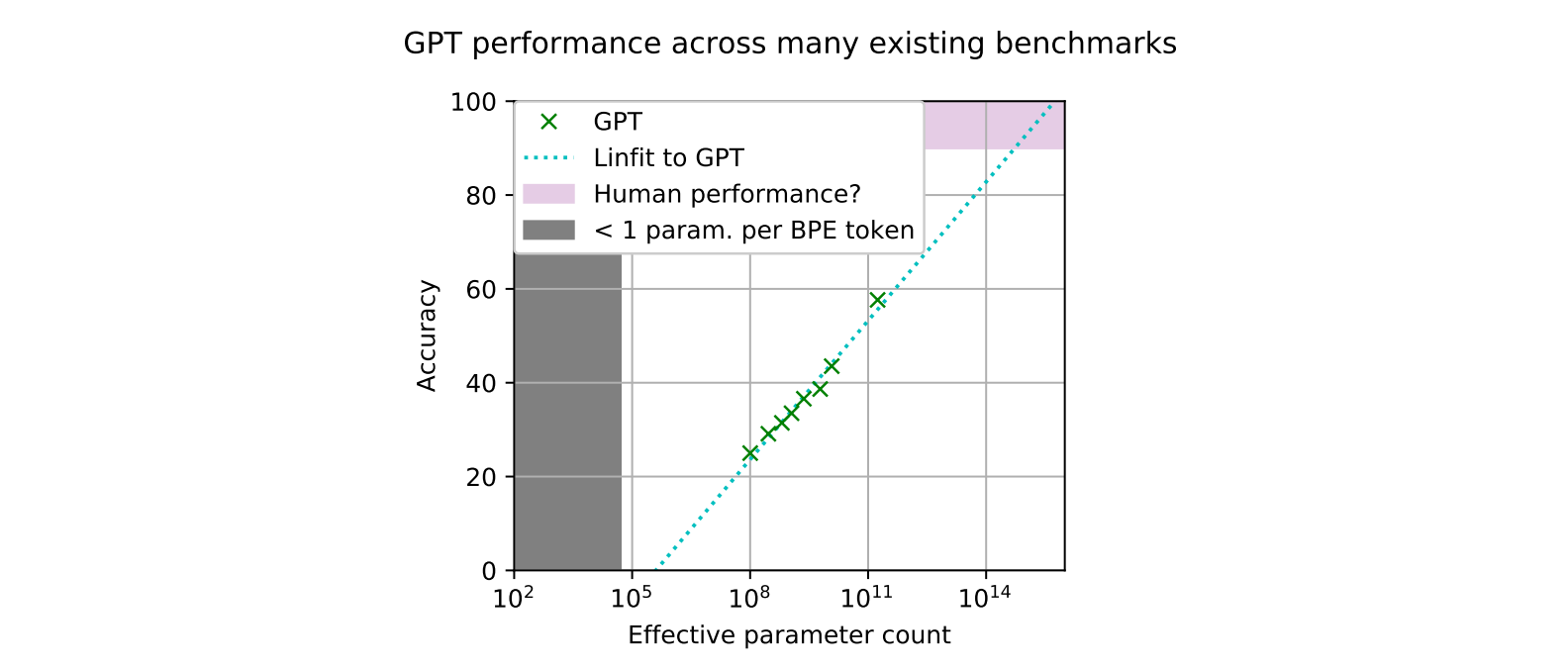

关于 GPT-4 的早期传言称,该模型将从 GPT-3 的 175 B 参数扩展到 GPT-4 的 100,000 B(100 万亿)参数。 根据这样的模型,如果符合趋势,将在许多现有基准测试中接近人类水平的表现。

一个 100T GPT 模型,按照预测,将在任务中接近人类水平的表现。

OpenAI 的首席执行官 Sam Altman 认为 100 T 参数的说法完全没有根据,GPT-4 预计不会比 GPT-3 大很多。 但是,如果这样的分析是正确的,为什么不建立一个更大的模型,即使不是 100T 参数模型?

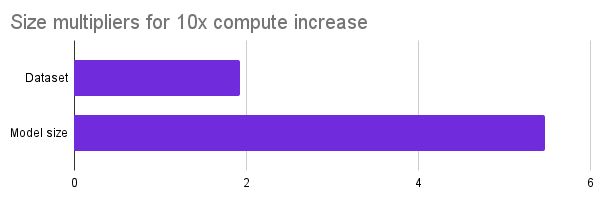

Jones 的分析很大程度上参考了 OpenAI 于 2020 年发布的一篇关于神经语言模型的缩放定律的论文。 特别是,他们研究了在计算量固定增加的情况下,应该如何在增加的训练数据和增加的模型大小之间分配这种额外的计算量。 该论文发现,模型大小应该消耗这些额外资源的更大比例,这意味着缩放模型大小比缩放数据集大小更重要。

具体来说,模型大小的增长速度应该是数据集大小的三倍左右。 如果计算预算增加 10 倍,数据集大小应增加约 1.83 倍,模型大小应增加 5.48 倍。

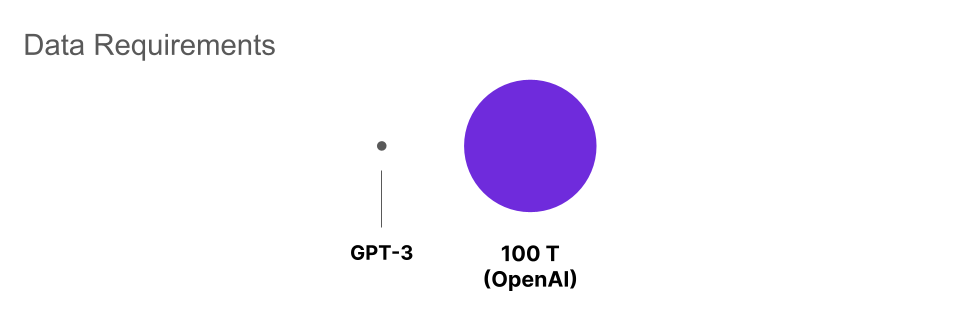

一个 100 T 参数的模型将比 GPT-3 大大约 571 倍。 因此,根据 OpenAI 的缩放定律,我们预计这样的模型需要 190 倍的数据。

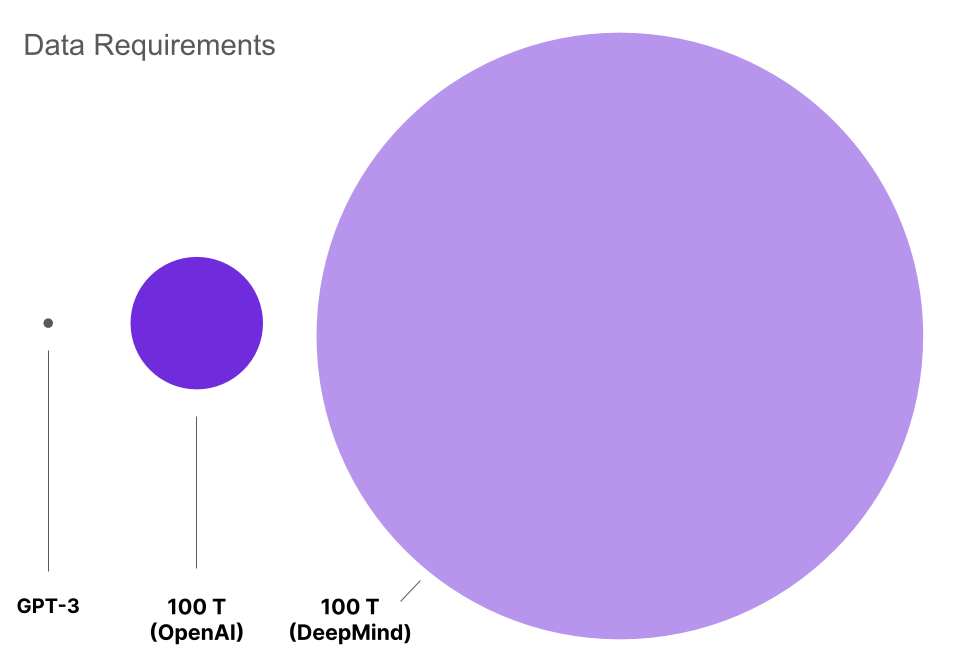

根据 OpenAI 的 2020 缩放定律,GPT-3 和 100T 参数模型的数据要求。

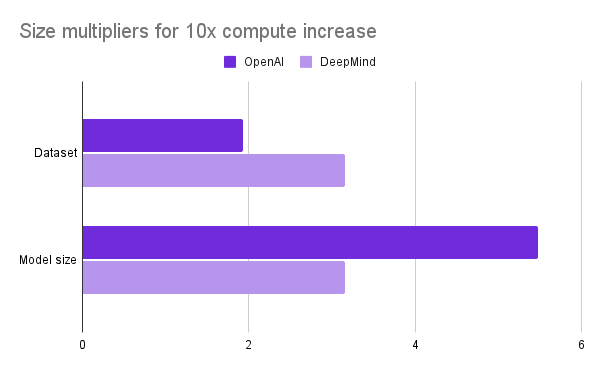

然而,最近的研究(来自 DeepMind)发现了更新的缩放法则。 事实上,Chinchilla 论文的作者发现数据和模型大小应该按相等比例缩放。

特别是,他们发现优化训练 LLM 所需的标记数量应该是(非嵌入)参数数量的 20 倍左右。 鉴于此比例定律,一个 100 T 参数模型将需要大约 2,000 T 代币。 根据 [3] 中的缩放定律,这比预期的数据多大约 20 倍,比 GPT-3 多出惊人的 4,000 倍。

根据 OpenAI 的 2020 和 DeepMind 的 2022 缩放定律,GPT-3 和 100T 参数模型的数据要求。

GPT-3 在几个数据集上进行了训练,大部分数据来自 Common Crawl。 OpenAI 使用了来自 Common Crawl 的 45 TB,这意味着 100 T 参数模型需要 180 PB 的此类数据才能根据 Chinchilla 缩放定律进行最佳训练。 用于训练 GPT-3 的其他数据集与如此大的数据规模相比相形见绌,这意味着用于训练 100 T 参数模型的所有数据都需要来自像 Common Crawl 这样的数据集。 此外,由于非 Common Crawl 数据集的质量较高,因此优先对其进行采样,我们发现 180 PB 实际上是训练此类模型所需数据量的下限。 截至撰写本文时,Common Crawl 的整体大小约为 12 PB,因此与这个数字相去甚远。

我们可以看到为什么 100 T 参数的说法很快就被 Altman 驳回了。 虽然每天生成的数据量逐年增长,但只有一小部分是存储的、文本的、可用的并且适合训练。 将这一事实与硬件和成本限制相结合意味着将模型扩展到如此天文大小以搜索紧急能力在这一点上是不切实际的。

写在最后

观察大型语言模型的涌现能力是一个有趣的发展。 需要对这种现象进行更多研究以获得更完整的画面,例如,在早期停止训练的大型模型上测试任务性能到较小的模型(具有等效的测试损失和训练计算),以查看规模本身是否真的是出现的关键因素在LLM中。

拥有任务的认识论层次结构将很有用,其中突出和可衡量的能力被识别并列为使用它们的更复杂任务的必要先决条件。 这样的层次结构可以帮助我们开始预测某些突发能力可能会出现的规模,或者至少提供对集合的排序。

此外,观察像 emoji_task 这样的任务的出现本身并没有多大意义。 如果一个模型还显示了在这种层次结构中类似“认识论集群”中其他任务的涌现,那么我们也许能够更多地说明与基本推理概念相关的涌现,而不是像 emoji_movie 这样的孤立任务。

归根结底,即使有潜在的简单因素有助于解释明显涌现的能力,但它们存在的事实是一个令人兴奋的发展。 毕竟,作为人类,我们最终更关心的是连续的性能曲线,而不是人工智能如何影响我们的生活。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢