近年来,清华大学计算机系孙茂松团队深入探索语言大模型参数高效微调方法的机理与特性,与校内其他相关团队合作完成的研究成果 “面向大规模预训练语言模型的参数高效微调”(Parameter-efficient Fine-tuning of Large-scale Pre-trained Language Models)3 月 2 日在《自然・机器智能》(Nature Machine Intelligence)上发表。

该研究成果由计算机系孙茂松、李涓子、唐杰、刘洋、陈键飞、刘知远和深圳国际研究生院郑海涛等团队师生共同完成,刘知远、郑海涛、孙茂松为该文章的通讯作者,清华大学计算机系博士生丁宁(导师郑海涛)与秦禹嘉(导师刘知远)为该文章的共同第一作者。

背景 & 概览

2018 年以来,预训练语言模型 (PLM) 及其 “预训练 - 微调” 方法已成为自然语言处理(NLP)任务的主流范式,该范式先利用大规模无标注数据通过自监督学习预训练语言大模型,得到基础模型,再利用下游任务的有标注数据进行有监督学习微调模型参数,实现下游任务的适配。

随着技术的发展,PLM 已经毫无疑问地成为各种 NLP 任务的基础架构,而且在 PLM 的发展中,呈现出了一个似乎不可逆的趋势:即模型的规模越来越大。更大的模型不仅会在已知任务上取得更好的效果,更展现出了完成更复杂的未知任务的潜力。

然而,更大的模型也在应用上面临着更大的挑战,传统方法对超大规模的预训练模型进行全参数微调的过程会消耗大量的 GPU 计算资源与存储资源,巨大的成本令人望而却步。这种成本也造成了学术界中的一种 “惯性”,即研究者仅仅在中小规模模型上验证自己的方法,而习惯性地忽略大规模模型。

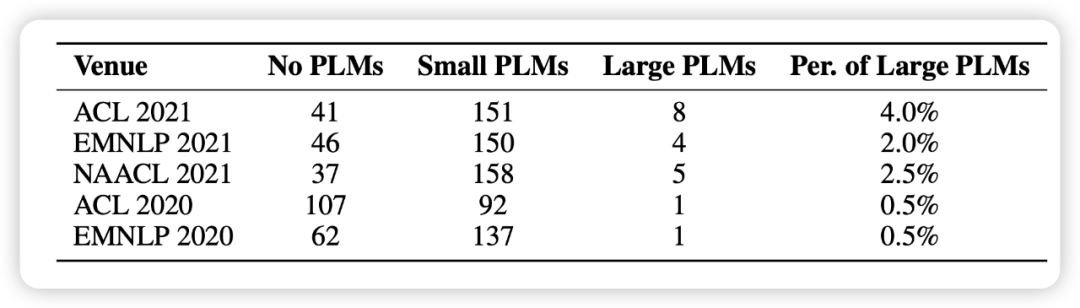

在本文的统计中,我们随机选取了 1000 篇来自最近五个 NLP 会议的论文,发现使用预训练模型已经成为了研究的基本范式,但涉及大模型的却寥寥无几(如图 1 所示)。

图 1:在 1000 篇随机挑选的论文中,使用预训练模型的统计分布

在这样的背景下,一种新的模型适配方案,参数高效(Parameter-efficient)方法逐渐受到关注,与标准全参数微调相比,这些方法仅微调模型参数的一小部分,而其余部分保持不变,大大降低了计算和存储成本,同时还有着可以媲美全参数微调的性能。我们认为,这些方法本质上都是在一个 “增量”(Delta Paremters)上进行调整,因此将它命名为 Delta Tuning。

在本文中,我们定义和描述了 Delta Tuning 问题,并且通过一个统一的框架对以往的研究进行梳理回顾。在这个框架中,现有的 Delta Tuning 方法可以被分为三组:增量式(Addition-based)、指定式(Specification-based)和重参数化(Reparameterization)的方法。

除去实践意义之外,我们认为它还具有非常重要的理论意义,Delta Tuning 在某种程度上昭示着大模型的背后机理,有助于我们进一步发展面向大模型甚至深度神经网络的理论。为此,我们从优化和最优控制两个角度,提出理论框架去讨论 Delta Tuning,以指导后续的结构和算法设计。

此外,我们对代表性方法进行了全面的实验对比,并在超过 100 个 NLP 任务的结果展示了不同方法的综合性能比较。实验结果涵盖了对 Delta Tuning 的性能表现、收敛表现、高效性表现、Power of Scale、泛化表现、迁移性表现的研究分析。我们还开发了一个开源工具包 OpenDelta,使从业者能够高效、灵活地在 PLM 上实现 Delta Tuning。

-

论文链接:https://www.nature.com/articles/s42256-023-00626-4 -

OpenDelta 工具包:https://github.com/thunlp/OpenDelta

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢