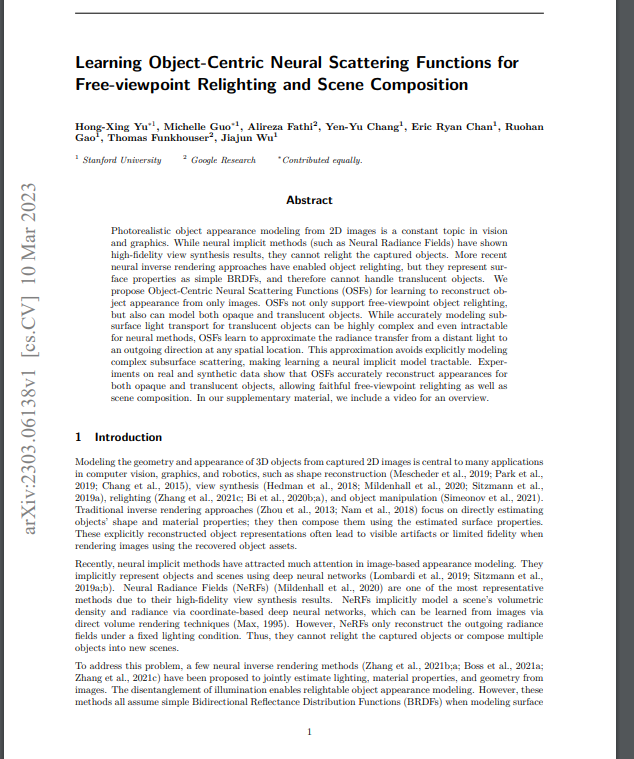

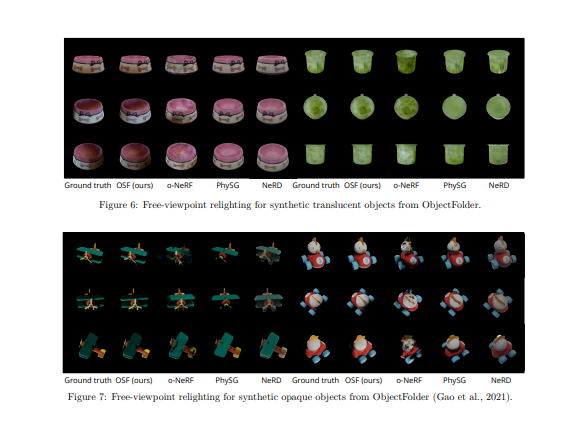

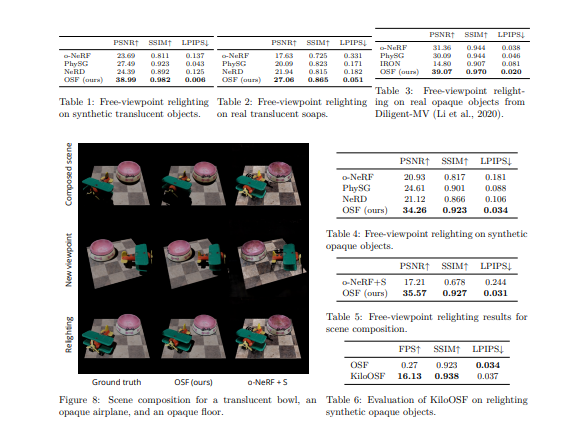

提出以物体为中心的神经散射函数(OSFs),用于学习从唯一的图像中重建物体外观。OSFs不仅支持自由视点的物体再照明,而且可以对不透明和半透明的物体进行建模。

Learning Object-Centric Neural Scattering Functions for Free-viewpoint Relighting and Scene Composition

Hong-Xing Yu, Michelle Guo, Alireza Fathi, Yen-Yu Chang, Eric Ryan Chan, Ruohan Gao, Thomas Funkhouser, Jiajun Wu

[Stanford University & Google Research]

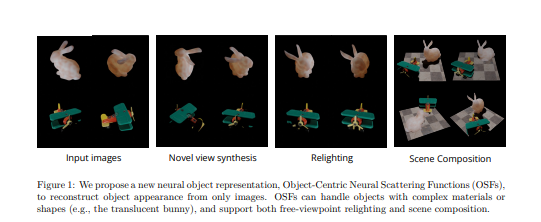

- 从二维图像中建立逼真的物体外观模型是视觉和图形学的一个永恒话题。虽然神经隐含方法(如神经辐射场)已经显示出高保真的视图合成结果,但它们不能重新照亮捕获的物体。最近的神经逆向渲染方法实现了对物体的重新照明,但它们将表面属性表示为简单的BRDFs,因此不能处理半透明物体。

- 本文提出了以物体为中心的神经散射函数(OSFs),用于学习从唯一的图像中重建物体外观。OSFs不仅支持自由视点的物体再照明,而且可以对不透明和半透明的物体进行建模。

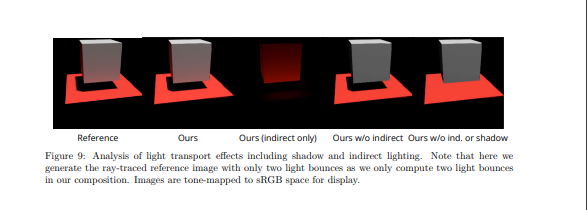

- 虽然准确地为半透明物体的表面下光传输建模可能是非常复杂的,甚至对神经方法来说是难以实现的,但OSFs可以学习近似地将辐射度从远处的光线转移到任何空间位置的出射方向。这种近似避免了对复杂的次表面散射进行明确的建模,使学习神经隐含模型变得可行。

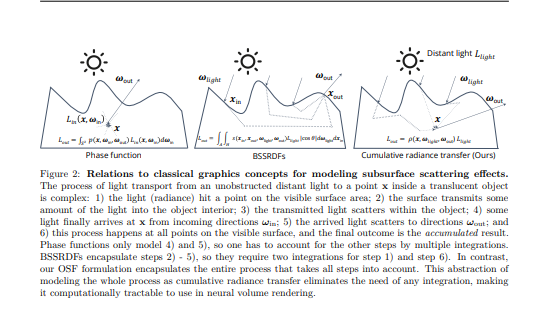

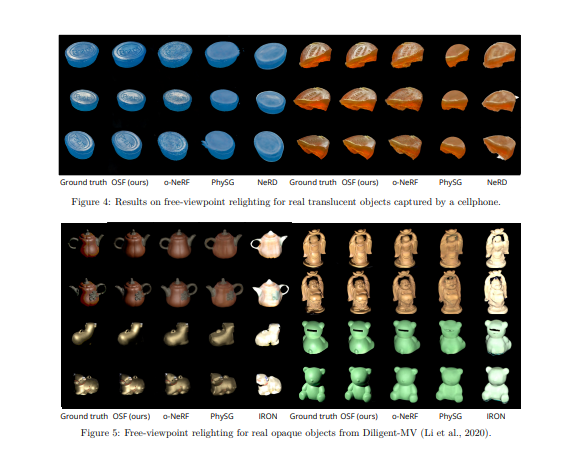

- 在真实和合成数据上的实验表明,OSFs准确地重建了不透明和半透明物体的外观,允许忠实的自由视点重新打光以及场景构成。

https://arxiv.org/pdf/2303.06138.pdf

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢