OpenAI 以显着方式升级了为其在线聊天机器人提供支持的技术。它更准确,但它仍然可以弥补。

Cade Metz and

四个月前吸引科技行业的 AI 聊天机器人所采用的技术的新版本在其前身的基础上进行了改进。它是一系列学科的专家,其医疗建议甚至令医生惊叹不已。它可以描述图像,并且接近于讲几乎好笑的笑话。但传闻已久的新人工智能系统 GPT-4 仍然存在一些怪癖,并且会犯一些同样的习惯性错误,这些错误在引入聊天机器人 ChatGPT 时让研究人员感到困惑。虽然它是一个非常好的应试者,但这个系统——来自旧金山初创公司 OpenAI——还没有达到与人类智能相匹配的水平。下面是GPT-4的简要指南。:

它已经学会了更精确的方法

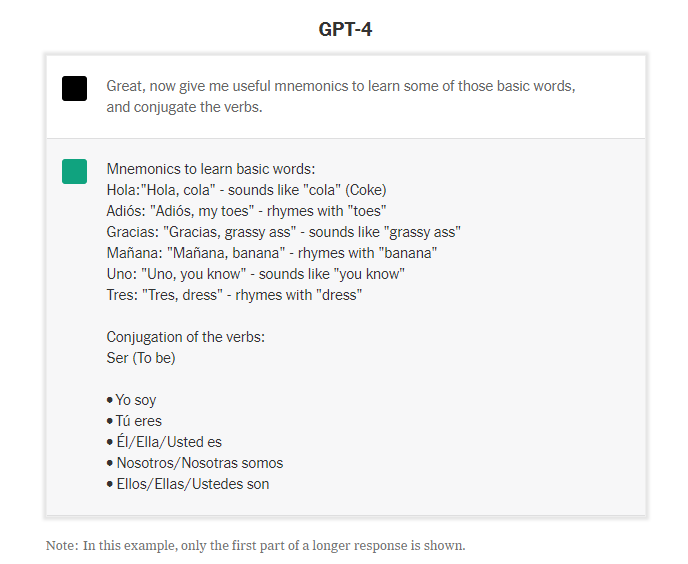

人工智能专家兼风险投资公司Page One Ventures的合伙人 Chris Nicholson在最近的一个下午使用 GPT-4 时,他告诉机器人他是一个说英语但不懂西班牙语的机器人。他要求提供一份可以教他基础知识的教学大纲,而机器人提供了一个详细且组织良好的教学大纲。它甚至提供了广泛的学习和记忆西班牙语单词的技巧(尽管并非所有建议都中肯)。

Nicholson 先生向以前版本的 ChatGPT 寻求类似的帮助,该版本依赖于 GPT-3.5。它也提供了教学大纲,但它的建议更笼统且帮助不大。

“它已经突破了精确的障碍,”尼科尔森先生说。“它包含了更多的事实,而且它们往往是正确的。”

它提高了准确性

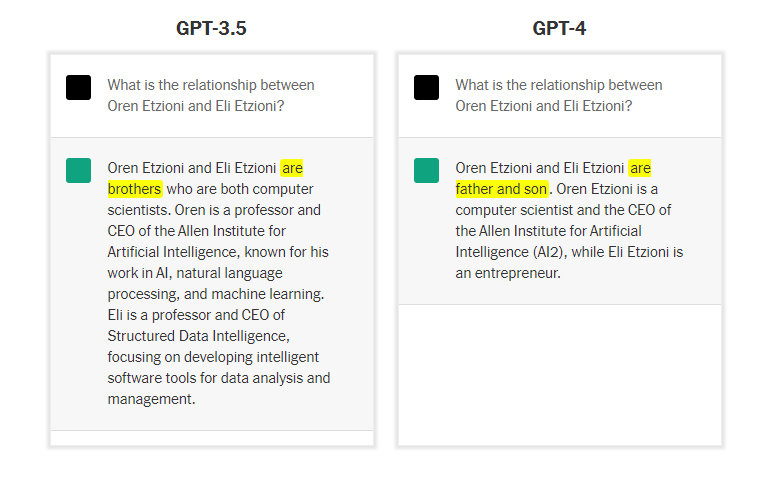

当 AI 研究员兼教授 Oren Etzioni 首次尝试这款新机器人时,他问了一个直截了当的问题:“Oren Etzioni 和 Eli Etzioni 之间有什么关系?” 机器人正确响应。内容中包含的图片若涉及版权问题,请及时与我们联系删除

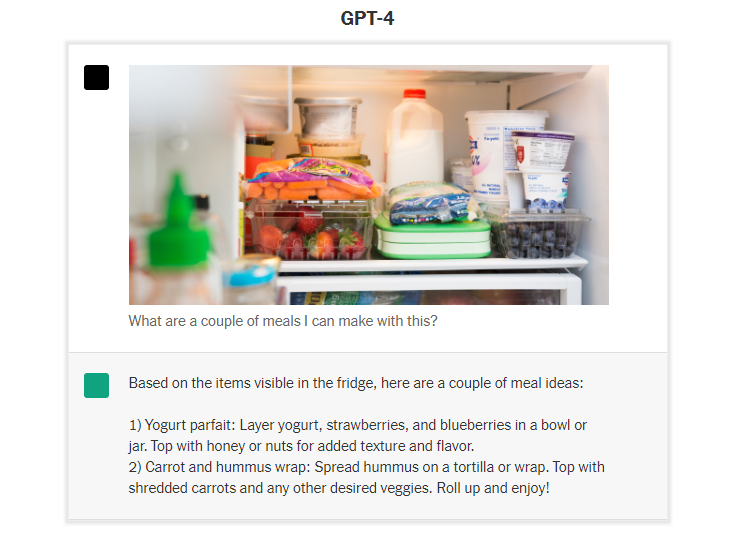

OpenAI 尚未向公众发布这部分技术,但一家名为 Be My Eyes 的公司已经在使用 GPT-4 构建服务,可以更详细地了解在互联网上遇到的图像或在现实世界中拍摄的图像.

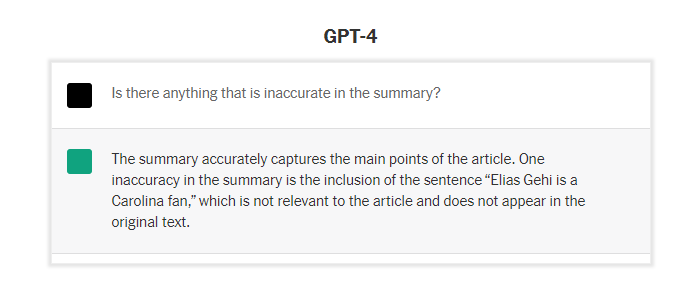

OpenAI 尚未向公众发布这部分技术,但一家名为 Be My Eyes 的公司已经在使用 GPT-4 构建服务,可以更详细地了解在互联网上遇到的图像或在现实世界中拍摄的图像. Etzioni 博士说这是一项了不起的技能。“要进行高质量的总结和比较,就必须对文本有一定程度的理解,并有能力表达这种理解,”他说。“那是一种高级形式的情报。”

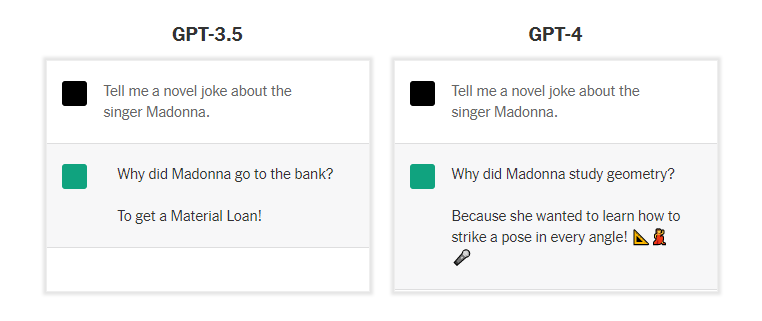

Etzioni 博士说这是一项了不起的技能。“要进行高质量的总结和比较,就必须对文本有一定程度的理解,并有能力表达这种理解,”他说。“那是一种高级形式的情报。” 除了公式化的“爸爸笑话”之外,新的机器人仍然很难写出任何东西。但它比它的前身稍微有趣一点。

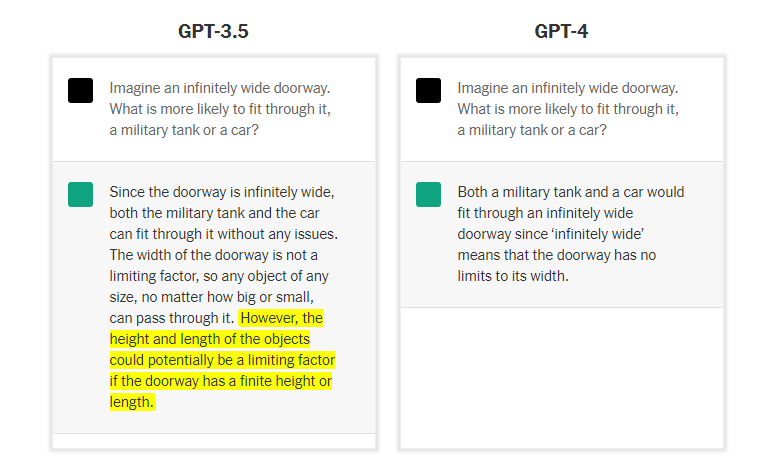

除了公式化的“爸爸笑话”之外,新的机器人仍然很难写出任何东西。但它比它的前身稍微有趣一点。 系统似乎做出了适当的回应。但是答案没有考虑门口的高度,这也可能会阻止坦克或汽车通过。OpenAI 的首席执行官 Sam Altman 说,新的机器人可以推理“一点点”。但它的推理能力在许多情况下都会崩溃。以前版本的 ChatGPT 更好地处理了这个问题,因为它认识到高度和宽度很重要。

系统似乎做出了适当的回应。但是答案没有考虑门口的高度,这也可能会阻止坦克或汽车通过。OpenAI 的首席执行官 Sam Altman 说,新的机器人可以推理“一点点”。但它的推理能力在许多情况下都会崩溃。以前版本的 ChatGPT 更好地处理了这个问题,因为它认识到高度和宽度很重要。

评论

沙发等你来抢