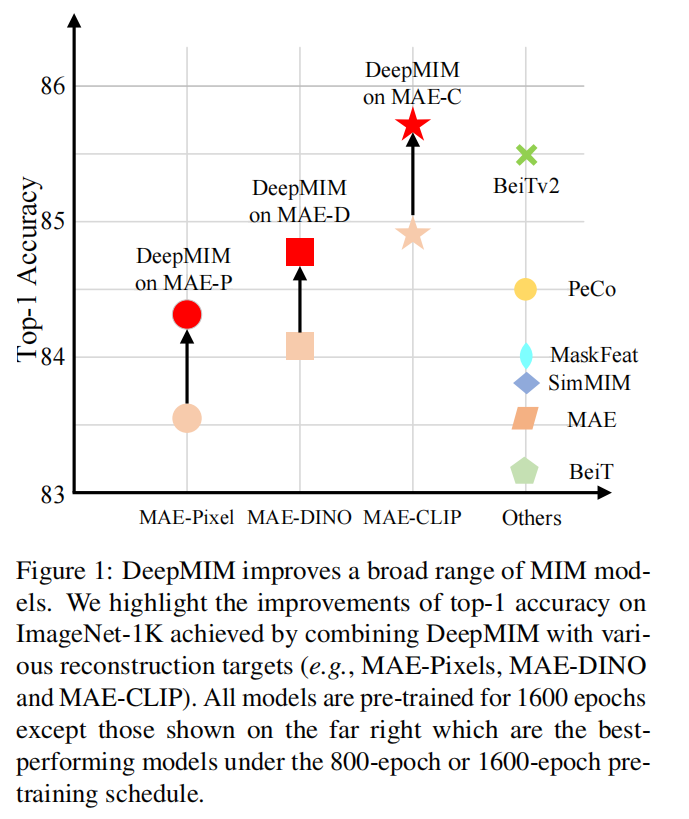

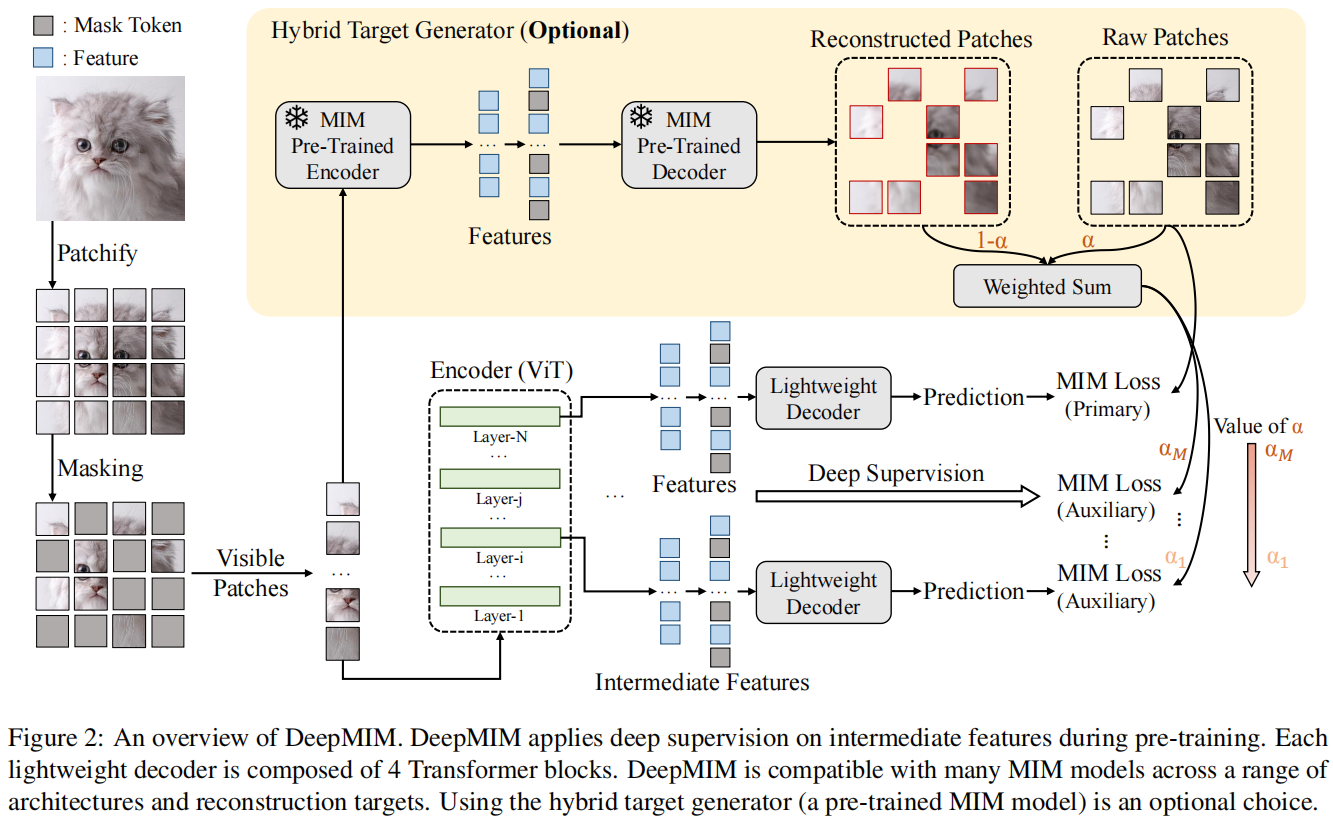

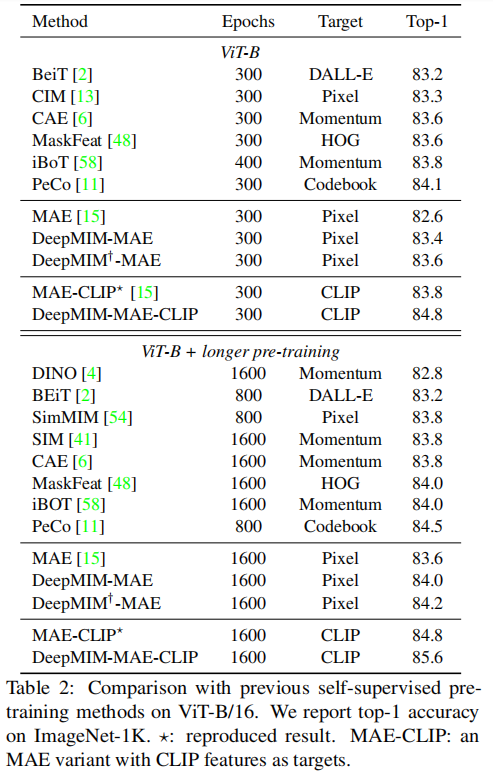

深度监督,即对神经网络的中间特征天界额外约束,是图像分类等视觉任务中的常见手段。尽管在后期研究中,正则化层和残差连接等新方法取得了更好的效果,但研究人员仍未发现这一方法能够在预训练、自监督学习过程中迫使底层特征得到更好的表达能力,从而加速模型收敛。本文提出的方法DeepMIM显著地提升了模型特征的表达能力,其训练得到的Vit-B模型在ImageNet数据集上取得了84.2的精确率,超越MAE等方法0.6。在CLIP模型上,DeepMIM能够得到85.6的ImageNet数据集分类准确率,在COCO检测数据集上取得52.8的AP,在ADE20K语义分割数据集上取得53.1的mIoU。

论文地址:https://arxiv.org/pdf/2303.08817.pdf

开源代码:https://github.com/OliverRensu/DeepMIM

作者:Sucheng Ren, Fangyun Wei, Samuel Albanie, Zheng Zhang, Han Hu

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢