今天我们发布了我们的新课程,从深度学习基础到稳定扩散,这是编码员实用深度学习的第 2 部分。

课程链接:

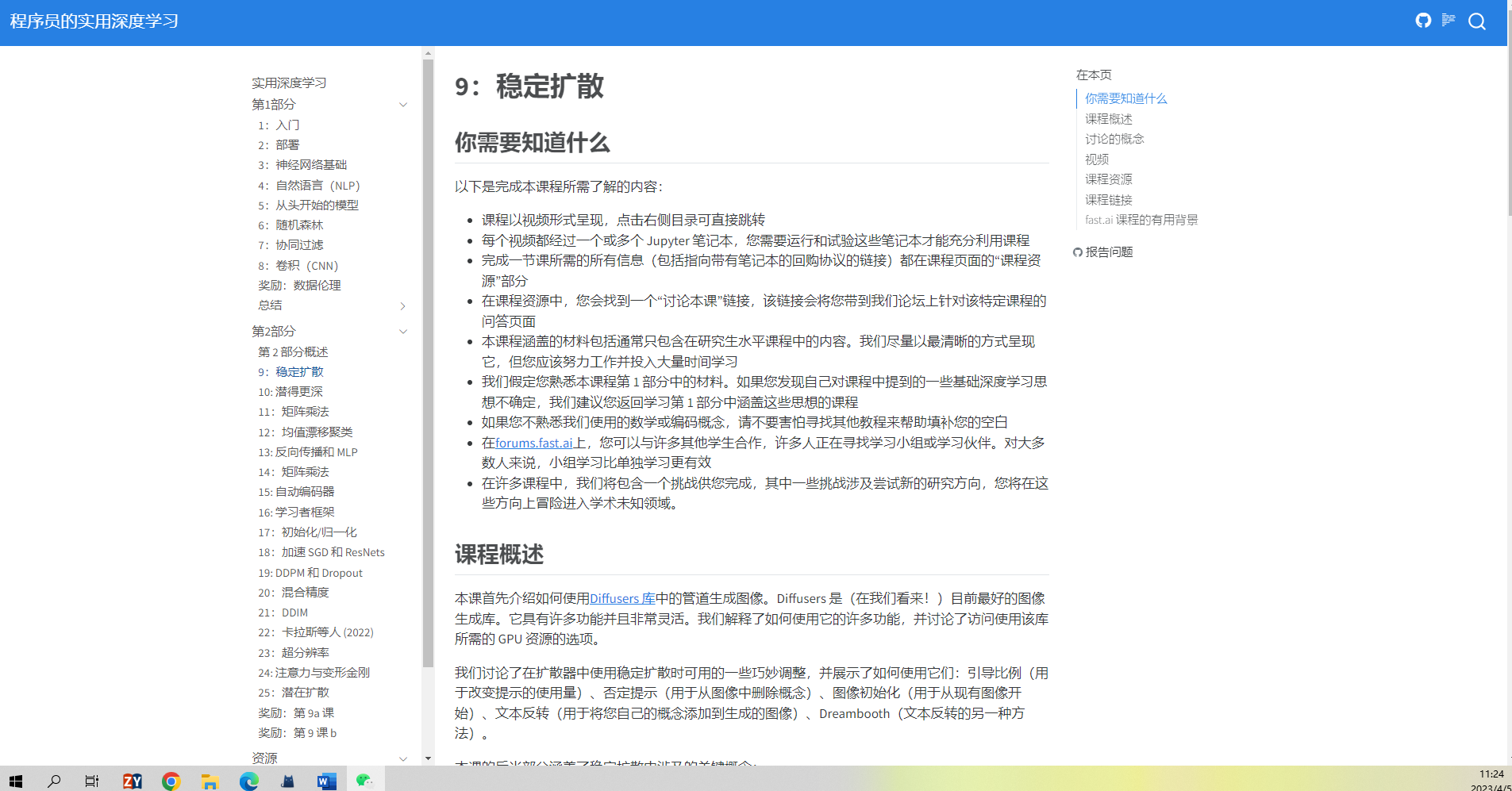

https://course.fast.ai/Lessons/lesson9.html

在本课程中,包含 30 多个小时的视频内容,我们从头开始实现惊人的稳定扩散算法!那是让互联网为之疯狂的杀手级应用,并让媒体说“你可能再也不会相信你在网上看到的东西了”。

我们与 Stability.ai 和 Hugging Face(Diffusers 库的创建者)的专家密切合作,以确保我们对最新技术有严格的覆盖。该课程涵盖了在 Stable Diffusion 发布后发布的论文——因此它实际上远远超出了 Stable Diffusion 所包含的内容!我们还解释了如何阅读研究论文,并通过在整个课程中研究和实施许多论文来练习这项技能。感谢所有帮助将这门课程整合在一起的了不起的人。我要特别感谢Tanishq Mathew Abraham (Stability.ai) 和Jonathan Whitaker(即将出版的 O'Reilly Diffusion 书的合著者)帮助我介绍了一些课程,以及 Pedro Cuenca(Hugging Face)的伟大幕后贡献。还要感谢Kat Crowson的k-diffusion库,我们在整个课程中大量使用它,并感谢她回答了我们所有的问题,还要感谢 Francisco Mussari 为大部分课程创建了抄本。

出于多种原因,稳定扩散和一般扩散方法是一个很好的学习目标。一方面,当然,你可以用这些算法创造出惊人的东西!要真正将这项技术提升到一个新的水平,并创造出前所未见的东西,您需要真正深入地了解引擎盖下发生的事情。有了这种理解,您就可以设计自己的损失函数、初始化方法、多模型混合等,以创建以前从未见过的全新应用程序。同样重要的是:这是一个伟大的学习目标,因为现代深度学习中的几乎所有关键技术都汇集在这些方法中。对比学习、transformer 模型、自动编码器、CLIP 嵌入、潜在变量、u-net、resnet 等等都涉及创建单个图像。

要充分利用本课程,您应该是一个相当自信的深度学习从业者。如果您已完成 fast.ai 的实用深度学习课程,那么您就准备好了!如果您还没有学过这门课程,但对使用 Python 从头开始构建 SGD 训练循环、在 Kaggle 竞赛中具有竞争力、使用现代 NLP 和计算机视觉算法解决实际问题以及使用 PyTorch 和 fastai 感到满意,那么您将准备开始课程。(如果您不确定,那么我们强烈建议您从Practical Deep Learning开始。)

内容概要

在本课程中,我们将探索扩散方法,例如去噪扩散概率模型 (DDPM) 和去噪扩散隐式模型 (DDIM)。我们将从头开始实施无条件和条件扩散模型,构建和试验不同的采样器,并深入研究文本倒置和 Dreambooth 等最新技巧。我们还将研究和实施 Karras 等人在 2022 年发表的论文阐明基于扩散的生成模型的设计空间,该论文使用预处理来确保模型的输入和目标按单位方差缩放。Karras 模型根据输入中存在的噪声量预测干净图像和噪声的插值版本。

在此过程中,我们将涵盖基本的深度学习主题,包括各种神经网络架构、数据增强方法(包括非常有效且被严重低估的 TrivialAugment 策略)以及各种损失函数,包括感知损失和风格损失。我们将从头开始构建自己的模型,例如多层感知器 (MLP)、ResNet 和 Unet,同时试验自动编码器和转换器等生成架构。

在整个课程中,我们将使用 PyTorch 来实现我们的模型(但前提是我们首先在纯 Python 中实现了所需的一切!),并将创建我们自己的深度学习框架,称为miniai. 我们将掌握迭代器、生成器和装饰器等 Python 概念,以保持我们的代码简洁高效。我们还将探索 AdamW 和 RMSProp 等深度学习优化器、学习率退火,并学习如何试验不同初始化程序、批量大小和学习率的影响。当然,我们将使用 Python 调试器 (pdb) 和 nbdev 等便捷工具从 Jupyter 笔记本构建 Python 模块。

最后,我们将介绍张量、微积分和伪随机数生成等基本概念,为我们的探索奠定坚实的基础。我们会将这些概念应用于机器学习技术,例如均值漂移聚类和卷积神经网络 (CNN),并将了解如何使用带有权重和偏差 (W&B) 的跟踪。

我们还将使用 NVIDIA 的 apex 库和 Hugging Face 的 Accelerate 库处理混合精度训练。我们将研究各种类型的规范化,如层规范化和批量规范化。到课程结束时,您将深入了解扩散模型和实施尖端深度学习技术的技能。

塔尼什克的想法

以下是来自 Stability.ai 的 Tanishq Mathew Abraham 对这门课程的看法,他帮助教授了许多课程:

fast.ai 第 2 部分课程是独一无二的课程。我认为这门课程的独特之处在于它教你如何从头开始构建深度学习模型,同时还探索扩散模型的前沿研究。没有其他课程可以指导您阅读传播空间中最先进的论文(有时在它们首次出现后仅几周)并构建清晰、可访问的实现。我们甚至在课程中探索了一些新的研究方向,希望课程能让其他人进一步探索自己的想法。

如果您对从头开始构建最先进的深度学习模型的更高级课程感兴趣,和/或您对最先进的扩散模型如何工作以及如何构建它们感兴趣,这是适合你的课程!即使作为帮助开发这门课程的人,我也发现这是一次了不起的学习经历,我希望它也适合你!

深度学习正在改变世界。我们正在使深度学习更易于使用,并通过我们的以下方式吸引来自不同背景的更多人参与:

关于我们的口号

世界需要每个人都参与 AI,无论你的背景多么不可能。

酷就是排外,这与我们想要的相反。我们想让深度学习尽可能地易于使用——包括使用 C# 等不酷语言、Windows(世界上大多数人都在使用)这样不酷的操作系统的人、不酷的数据集(比谷歌的任何东西都小,并且在领域你认为晦涩难懂的领域)和不酷的背景(也许你没有上过斯坦福大学)。

新闻中的 fast.ai

- 经济学人:新方案教会大众构建人工智能

- 麻省理工学院技术评论:初创公司使 AI 劳动力多样化,而不仅仅是“技术人员”

- 纽约时报:终于,一台可以完成你的句子的机器

- The Verge:AI 速度测试表明,聪明的程序员仍然可以击败谷歌和英特尔等科技巨头

- 麻省理工科技评论:一小群学生 AI 程序员击败了谷歌的机器学习代码

- 福布斯:人工智能教育改变发展中国家

- ZDNet:fast.ai 的软件可以从根本上使人工智能民主化

关于团队

杰里米霍华德

Jeremy 是Enlitic的创始 CEO ,该公司是第一家将深度学习应用于医学的公司,连续两年被《麻省理工科技评论》评选为全球最聪明的 50 家公司之一。他是数据科学平台Kaggle的总裁兼首席科学家,连续 2 年在国际机器学习竞赛中名列前茅。他是两家成功的澳大利亚初创公司( FastMail和 Optimal Decisions Group——被 Lexis-Nexis 收购)的创始首席执行官。在此之前,他曾在McKinsey & Co和AT Kearney从事管理咨询工作 8 年. Jeremy 投资、指导和建议了许多初创公司,并为许多开源项目做出了贡献。

他多次出现在媒体上,包括为《卫报》、《今日美国》和《华盛顿邮报》撰稿,出现在 ABC(早安美国)、MSNBC(乔伊·里德)、CNN、福克斯新闻、BBC 上,并且是澳大利亚最高电视台的常客-额定早餐新闻节目。他在 TED.com 上的演讲“可以学习的计算机的美妙和可怕的影响”有超过 250 万的浏览量。他是全球 Masks4All 运动的联合创始人。

雷切尔托马斯

她的作品已被超过一百万人阅读;已被翻译成中文、西班牙文、韩文和葡萄牙文;并登上了 Hacker News 9x 的头版。她的一些最受欢迎的文章包括:

- 医学的机器学习问题

- 指标问题对人工智能来说是个大问题

- 如果你认为科技界的女性只是一个管道问题,那是你没有注意

- 女性退出技术的真正原因,以及如何解决它

- 谷歌的 AutoML:破除炒作

- 表格数据深度学习简介

雷切尔的演讲包括:

- 人工智能、医学和偏见:使数据集多样化是不够的(斯坦福医学与影像学人工智能研讨会)

- 具体了解算法偏差(PyBay 上的专题演讲)

- NLP 的新时代(SciPy 的主题演讲)

- 人工智能的障碍比你想象的要低(麻省理工学院技术评论会议)

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢