本次OpenAI发布了一致性模型的实现代码库。

OpenAI 的这项研究主要是图像生成方面的,大家或多或少的都听过这项技术,例如最近热门的 Midjourney 和 Stable Diffusion,它们大都采用扩散模型,由于其生成的图片效果惊艳,很多人都将其视为最好的工具。但扩散模型依赖于迭代生成过程,这导致此类方法采样速度缓慢,进而限制了它们在实时应用中的潜力。

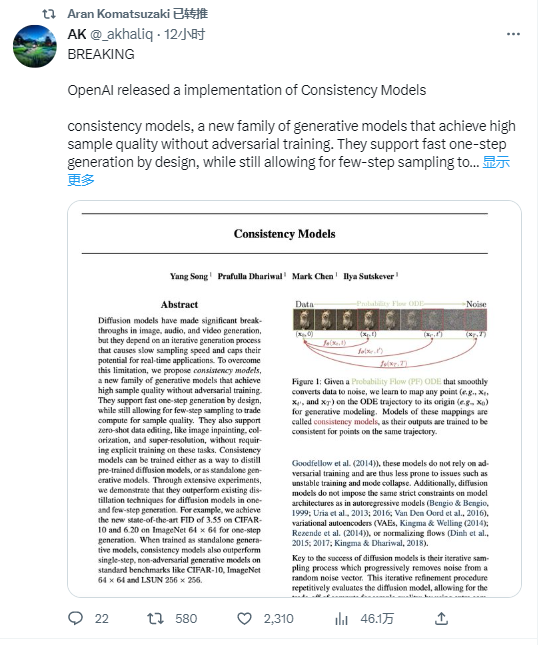

OpenAI 的这项研究就是为了克服这个限制,提出了 Consistency Models,这是一类新的生成模型,无需对抗训练即可快速获得高质量样本。与此同时,OpenAI 还发布了 Consistency Models 实现以及权重。

此前报告相关论文链接:https://hub.baai.ac.cn/view/24651

项目地址:https://github.com/openai/consistency_models

Consistency Models一致性模型

Yang Song, P Dhariwal, M Chen,Ilya Sutskever

[OpenAI]

一作是在OpenAI担任研究员的宋飏,14岁时,曾以17位评委全票通过的成绩,入选“清华大学新百年领军计划”。在次年高考中,他又成为连云港市理科状元,考入清华。2016年,宋飏从清华大学数理基础科学班毕业,此后赴斯坦福深造。2022年,宋飏获斯坦福计算机科学博士学位,而后加入OpenAI。在博士期间,他的一作论文“Score-Based Generative Modeling through Stochastic Differential Equations”还获得过ICLR 2021的杰出论文奖。宋飏将于 2024 年 1 月加入加州理工学院电子系(Electrical Engineering)和计算数学科学系(Computing and Mathematical Sciences)担任助理教授。

此外还包括 OpenAI 联合创始人、首席科学家 Ilya Sutskever。

一致性模型代码库介绍

该存储库包含一致性模型的代码库,使用 PyTorch 实现,用于在 ImageNet-64、LSUN Bedroom-256 和 LSUN Cat-256 上进行大规模实验。我们的存储库基于openai/guided-diffusion,它最初是在 MIT 许可下发布的。我们的修改支持一致性蒸馏、一致性训练以及本文中讨论的几种采样和编辑算法。

CIFAR-10 实验的存储库位于 JAX 中,将单独发布。

预训练模型

我们已经发布了论文中主要模型的检查点。在使用这些模型之前,请查看相应的模型卡以了解这些模型的预期用途和限制。

以下是每个模型检查点的下载链接:

- ImageNet-64 上的 EDM:edm_imagenet64_ema.pt

- 具有 l2 指标的 ImageNet-64 上的 CD:cd_imagenet64_l2.pt

- 具有 LPIPS 指标的 ImageNet-64 上的 CD:cd_imagenet64_lpips.pt

- ImageNet-64 上的 CT:ct_imagenet64.pt

- LSUN Bedroom-256 上的 EDM:edm_bedroom256_ema.pt

- LSUN Bedroom-256 上的 CD,l2 公制:cd_bedroom256_l2.pt

- LSUN Bedroom-256 上的 CD,LPIPS 指标:cd_bedroom256_lpips.pt

- LSUN Bedroom-256 上的 CT:ct_bedroom256.pt

- LSUN Cat-256 上的 EDM:edm_cat256_ema.pt

- LSUN Cat-256 上的 CD,具有 l2 公制:cd_cat256_l2.pt

- CD on LSUN Cat-256 with LPIPS metric: cd_cat256_lpips.pt

- LSUN Cat-256 上的 CT:ct_cat256.pt

依赖关系

要安装此代码库中的所有包及其依赖项,请运行

pip install -e .

模型训练和抽样

我们在cm/scripts/launch.sh中提供了 EDM 训练、一致性蒸馏、一致性训练、单步生成和多步生成的示例。

评价

为了比较不同的生成模型,我们使用 FID、Precision、Recall 和 Inception Score。这些指标都可以使用存储在 (numpy) 文件中的样本批次来计算.npz。可以使用cm/evaluations/evaluator.py以与openai/guided-diffusion中描述的相同方式评估样本,其中提供了参考数据集批次。

引用

如果您发现此方法和/或代码有用,请考虑引用

@article{song2023consistency,

title={Consistency Models},

author={Song, Yang and Dhariwal, Prafulla and Chen, Mark and Sutskever, Ilya},

journal={arXiv preprint arXiv:2303.01469},

year={2023},

}

作为一个图像生成AI,一致性模型(Consistency Model)最大的特点在于快又好。

相比扩散模型,它主要有两大优势:

其一,无需对抗训练(adversarial training),就能直接生成高质量的图像样本。

其二,相比扩散模型可能需要几百甚至上千次迭代,一致性模型只需要一两步就能搞定多种图像任务——

包括上色、去噪、超分等,都可以在几步之内搞定,而不需要对这些任务进行明确训练。(当然,如果进行少样本学习的话,生成效果也会更好)。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢