ZipIt! Merging Models from Different Tasks without Training

解决问题:本篇论文旨在解决将完全不同的模型合并为一个多任务模型的难题,且无需进行额外的训练。这是一个新问题。

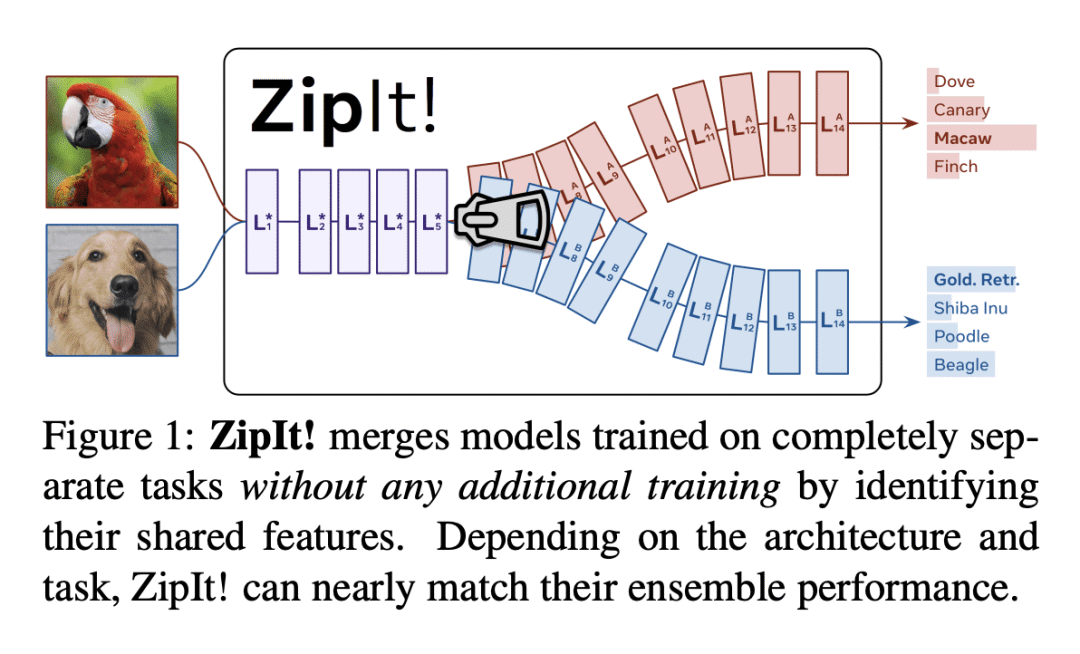

关键思路:本文提出了一种名为“ZipIt!”的通用方法,用于合并两个具有相同架构的任意模型,其中包含两个简单策略。首先,为了考虑不在模型之间共享的特征,我们将模型合并问题扩展到允许在每个模型内部合并特征,定义了一个通用的“zip”操作。其次,我们支持部分压缩模型,直到指定的层,自然地创建一个多头模型。这两个变化的结合使得本文的方案比之前的工作在性能上提高了20-60%,使得合并在不同任务上训练的模型成为可能。

其他亮点:本文通过实验验证了ZipIt!方法的有效性,使用了CIFAR-10和CIFAR-100数据集,并且开源了代码。这项工作值得进一步深入研究,特别是在多任务学习领域。

关于作者:

G Stoica, D Bolya, J Bjorner, T Hearn, J Hoffman

https://arxiv.org/abs/2305.03053

论文摘要:本文提出了一种名为“ZipIt!”的通用方法,可以将两个完全不同的、具有不同初始化的模型合并为一个多任务模型,而无需进行任何额外的训练。这些模型分别解决各自的任务。以前的模型合并工作将一个模型排列到另一个模型的空间中,然后将它们相加。虽然这对于在同一任务上训练的模型有效,但我们发现这未能考虑到在不同任务上训练的模型之间的差异。因此,我们引入了两个简单的策略来解决这个问题。首先,为了解决模型之间不共享的特征,我们将模型合并问题扩展到允许在每个模型内部合并特征,定义了一个通用的“zip”操作。其次,我们添加了对部分压缩模型的支持,自然地创建了一个多头模型。我们发现,这两个变化结合起来,相对于以前的工作,可以取得惊人的20-60%的改进,使得在不同任务上训练的模型的合并成为可能。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢