Augmented Large Language Models with Parametric Knowledge Guiding

作者:

Ziyang Luo, Can Xu, Pu Zhao, Xiubo Geng, Chongyang Tao, Jing Ma, Qingwei Lin, Daxin Jiang

Hong Kong Baptist University, Hong Kong SAR, China,Microsoft Corporation

摘要:

大型语言模型(LLMs)以其令人印象深刻的语言理解和生成能力大大推进了自然语言处理(NLP)。然而,由于对特定领域的知识和词汇接触有限,它们的性能对于长尾或特定领域的任务来说可能是次优的。

大型语言模型(LLMs)以其卓越的语言理解和生成能力显著推进了自然语言处理(NLP)。然而,由于对领域特定知识和词汇的有限接触,它们在长尾或领域特定任务上的表现可能不够优秀。此外,大多数最先进的 LLMs 缺乏透明度,只能通过 API 访问,这阻碍了进一步使用自定义数据进行微调。此外,数据隐私是一个重要问题。

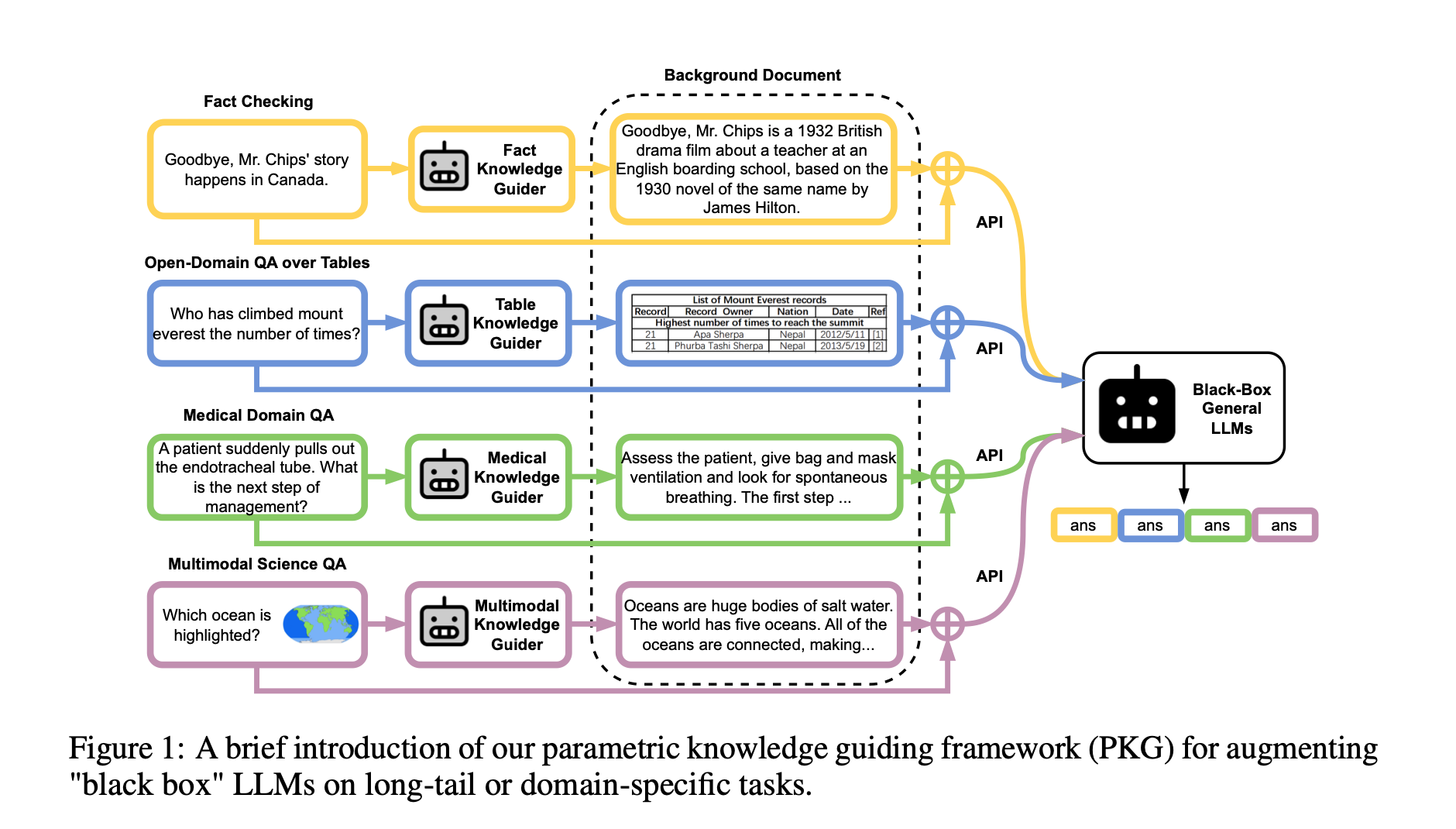

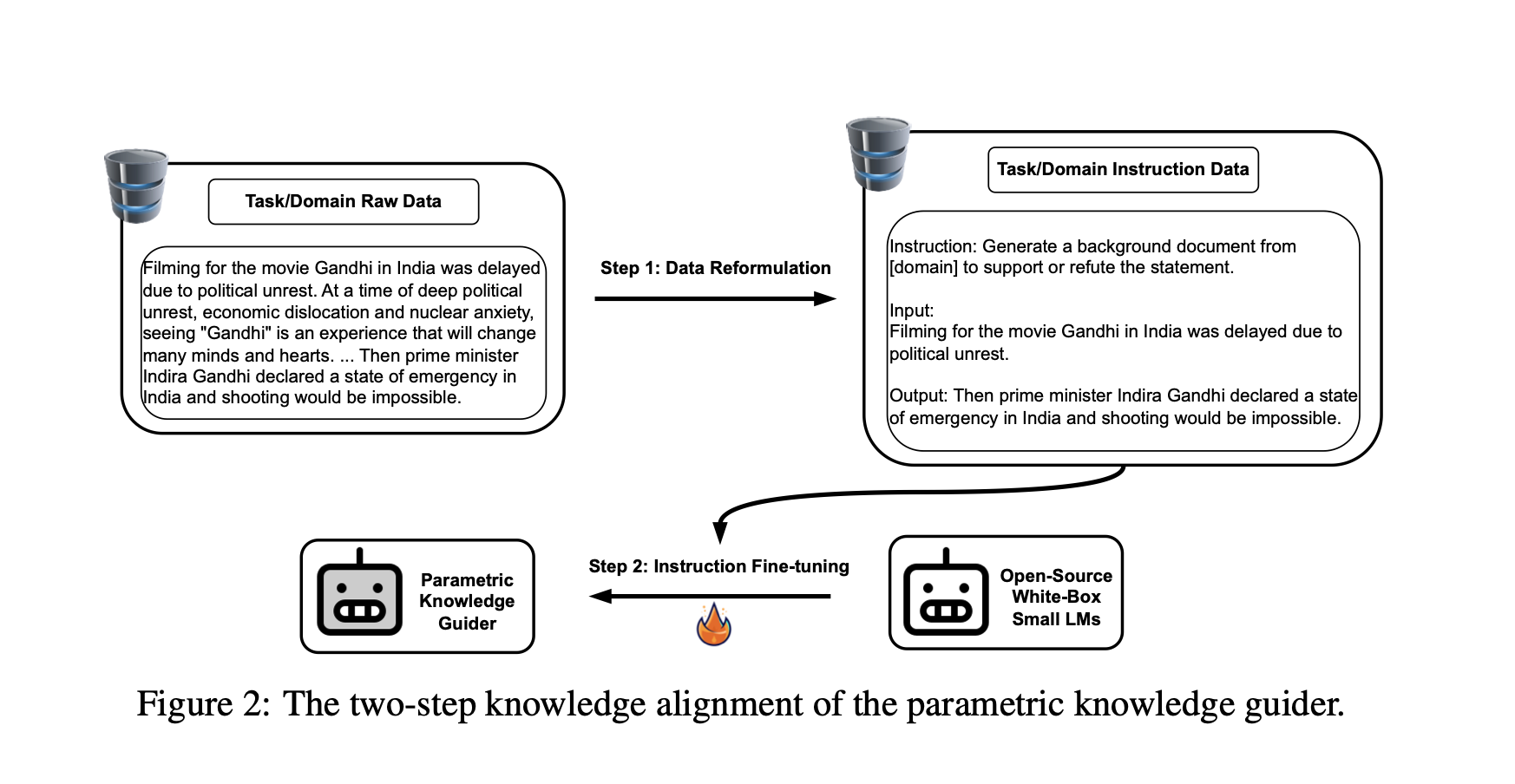

为了解决这些挑战,本文提出了一种新颖的参数化知识引导(PKG)框架,该框架配备了一个知识引导模块,使 LLMs 能够在运行时访问相关知识,而不改变 LLMs 的参数。本文的 PKG 基于开源的「白盒」小型语言模型,允许离线存储 LLMs 需要的任何知识。本文证明了 PKG 框架可以增强「黑盒」LLMs 在需要事实、表格、医学和多模式知识的一系列长尾和领域特定的下游任务上的性能。

-

动机:大型语言模型在自然语言处理领域具有卓越的语言理解和生成能力,但对于长尾或领域特定任务的性能可能不够优化,且缺乏透明度和数据隐私的问题也存在。 -

方法:提出基于参数化知识引导(PKG)框架,为大型语言模型增加了一个知识引导模块,使其能在运行时访问相关知识而不改变模型参数。PKG基于开源的小型语言模型,允许离线存储LLM所需的任何知识。 -

优势:PKG框架能够提升"黑盒"大型语言模型在长尾和领域特定任务上的性能,包括事实性、表格、医疗和多模态知识的下游任务。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢