Physics of Language Models: Part 1, Context-Free Grammar

Zeyuan Allen-Zhu, Yuanzhi Li

[Meta FAIR Labs & Mohamed bin Zayed University of AI]

语言模型物理学: 上下文无关文法

要点:

-

动机:研究生成式语言模型如何学习和生成上下文无关文法(CFG),揭示其学习CFG结构和规则的物理机制。 -

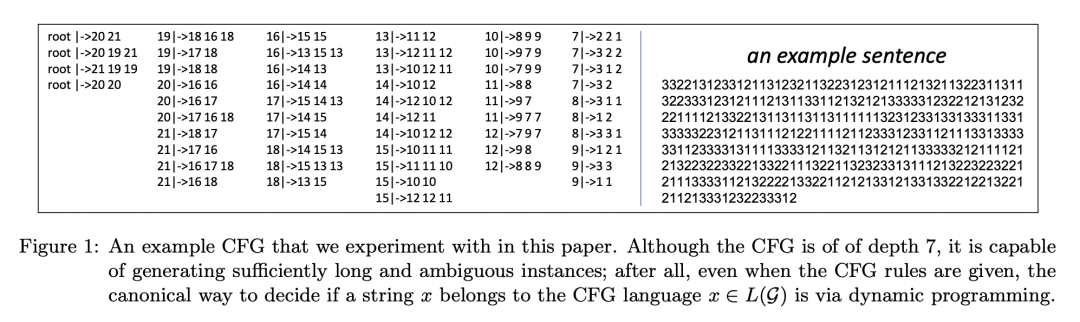

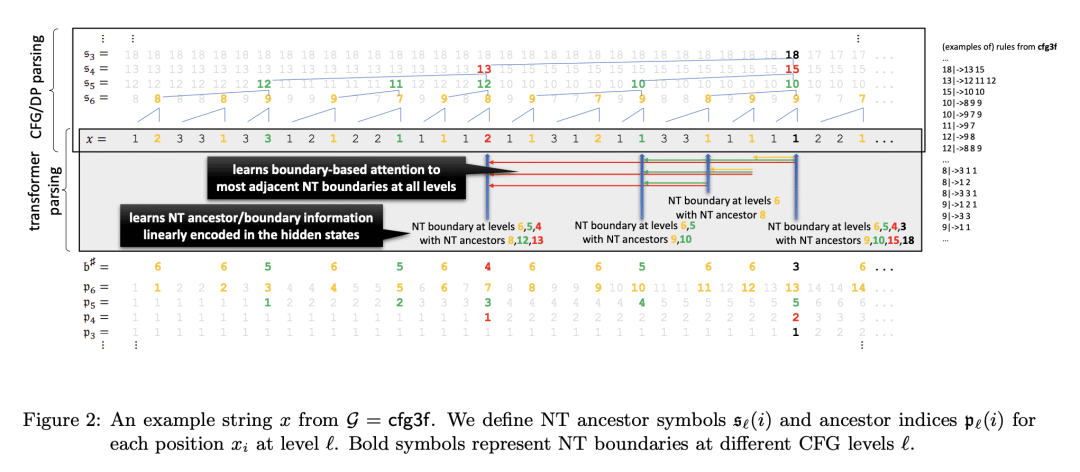

方法:通过预训练模型并设计实验,分析生成式语言模型(特别是GPT-2)在不同难度级别的CFG上生成准确和多样化字符串的能力,研究其隐藏状态和注意力机制。 -

优势:提供了对生成式语言模型如何学习和生成复杂多样的表达形式的全面和实证的理解,揭示了模型捕捉CFG的层次结构和类似动态规划的物理机制。这项研究对于解释和理解这些模型的内部工作机制具有重要意义。

一句话总结:

通过研究生成式语言模型如何学习和生成上下文无关文法(CFG),揭示了其对CFG结构和规则的准确捕捉,以及类似动态规划的注意力机制。

https://arxiv.org/abs/2305.13673

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢