Is Pre-training Truly Better Than Meta-Learning?

Brando Miranda, Patrick Yu, Saumya Goyal, Yu-Xiong Wang, Sanmi Koyejo

[Stanford University & University of Illinois Urbana-Champaign]

预训练比元学习更好吗?

-

动机:当前观点认为预训练模型在微调后,通常会优于标准的元学习算法。本文对此进行了重新评估,探讨预训练模型和元学习算法(特别是模型无关元学习,MAML)在少样本学习环境中的有效性。 -

方法:进行了深入的实证研究,使用了各种数据集,并将预训练模型与MAML进行了比较。强调了公平比较,使用了相同的架构,相同的优化器,并训练所有模型至收敛。还使用了更严格的统计工具(Cohen's d效应量)来确定预训练模型与MAML之间差异的实际意义。 -

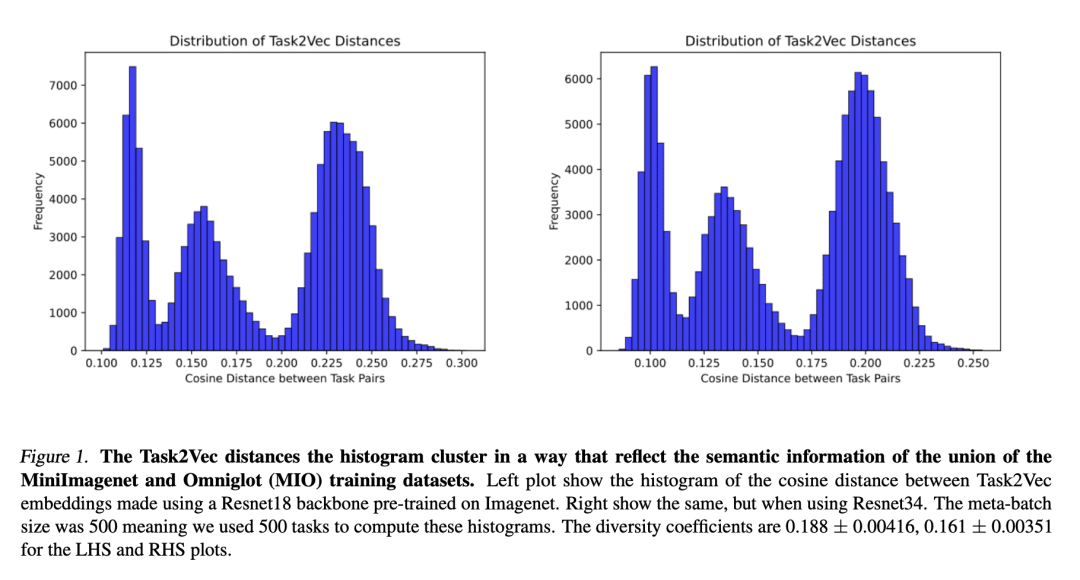

优势:当数据集的形式多样性较低时,预训练模型平均上优于MAML。然而,当形式多样性较高时,MAML平均上优于预训练模型。该观察结果与当前观点相矛盾,即预训练模型总是优于元学习模型。

重新评估了预训练模型与元学习算法在少样本学习环境中的有效性,发现预训练模型并不总是优于元学习模型,数据集的形式多样性是一个关键因素。

https://arxiv.org/abs/2306.13841

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢