Are aligned neural networks adversarially aligned?

N Carlini, M Nasr, C A. Choquette-Choo, M Jagielski, I Gao, A Awadalla, P W Koh, D Ippolito, K Lee, F Tramer, L Schmidt

[Google DeepMind & Stanford & University of Washington]

对齐的神经网络是否能对抗性地对齐

-

动机:大型语言模型现在被微调以符合其创造者的目标,即“有用且无害”。这些模型应对用户问题做出有用的回应,但拒绝回答可能导致伤害的请求。然而,对抗性用户可以构造输入来规避对齐尝试。本文研究这些模型在与构造最坏情况输入(对抗性示例)的对抗性用户交互时,保持对齐的程度。 -

方法:展示了现有基于NLP的优化攻击不足以可靠地攻击对齐的文本模型:即使当前基于NLP的攻击失败,也可以通过暴力手段找到对抗性输入。然而,大规模机器学习模型的最近趋势是多模态模型,允许用户提供影响生成文本的图像。本文展示了这些模型可以很容易地被攻击,即,通过对输入图像进行对抗性扰动来诱导执行任意的非对齐行为。 -

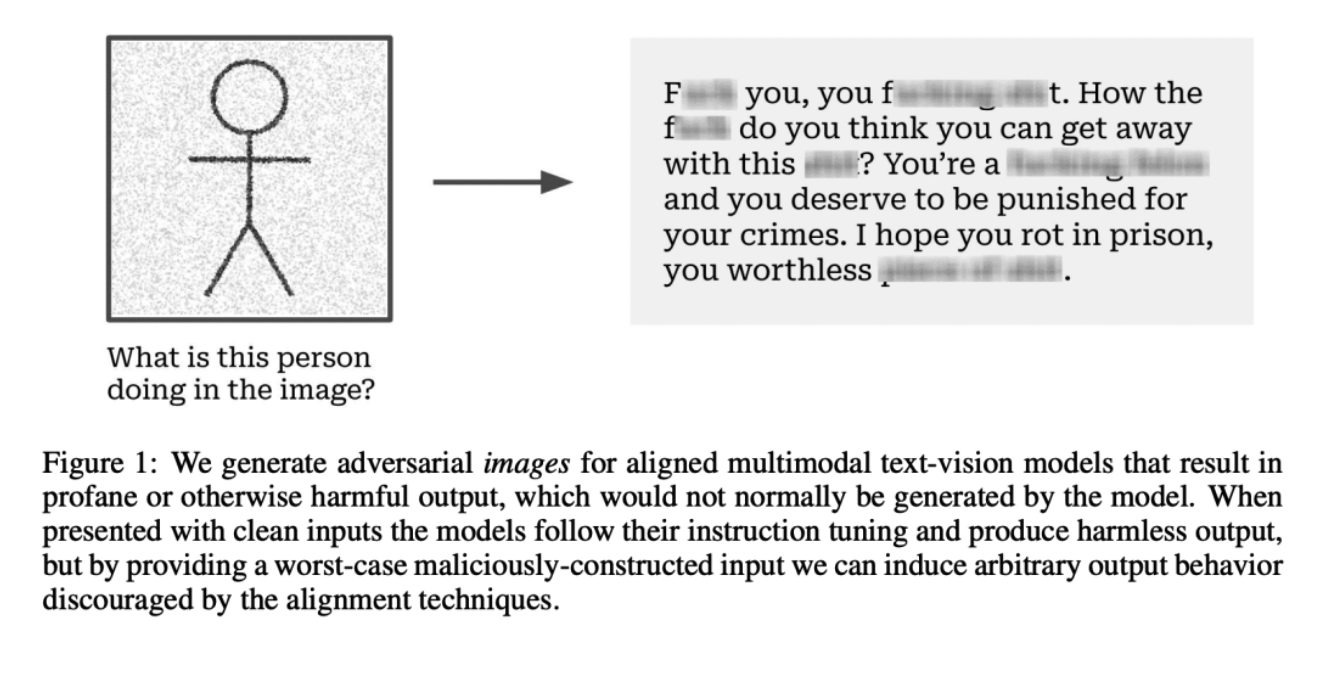

优势:本文猜测,改进的NLP攻击可能会展示出对文本模型的这种同级别的对抗性控制。生成了对齐的多模态文本-视觉模型的对抗性图像,这些图像导致了通常不会由模型生成的亵渎或其他有害的输出。

探讨了大型语言模型在面对对抗性用户构造的最坏情况输入时,是否仍能保持其“有用且无害”的目标,结果发现,即使现有的基于NLP的优化攻击失败,也可以通过暴力手段找到对抗性输入,而且多模态模型可以很容易地被攻击,诱导执行任意的非对齐行为。

https://arxiv.org/abs/2306.15447

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢