Speed Limits for Deep Learning

I Seroussi, A A. Alemi, M Helias, Z Ringel

[Tel Aviv Univer & Google Research & Institute of Neuroscience and Medicine & Hebrew University]

深度学习的速度限制

-

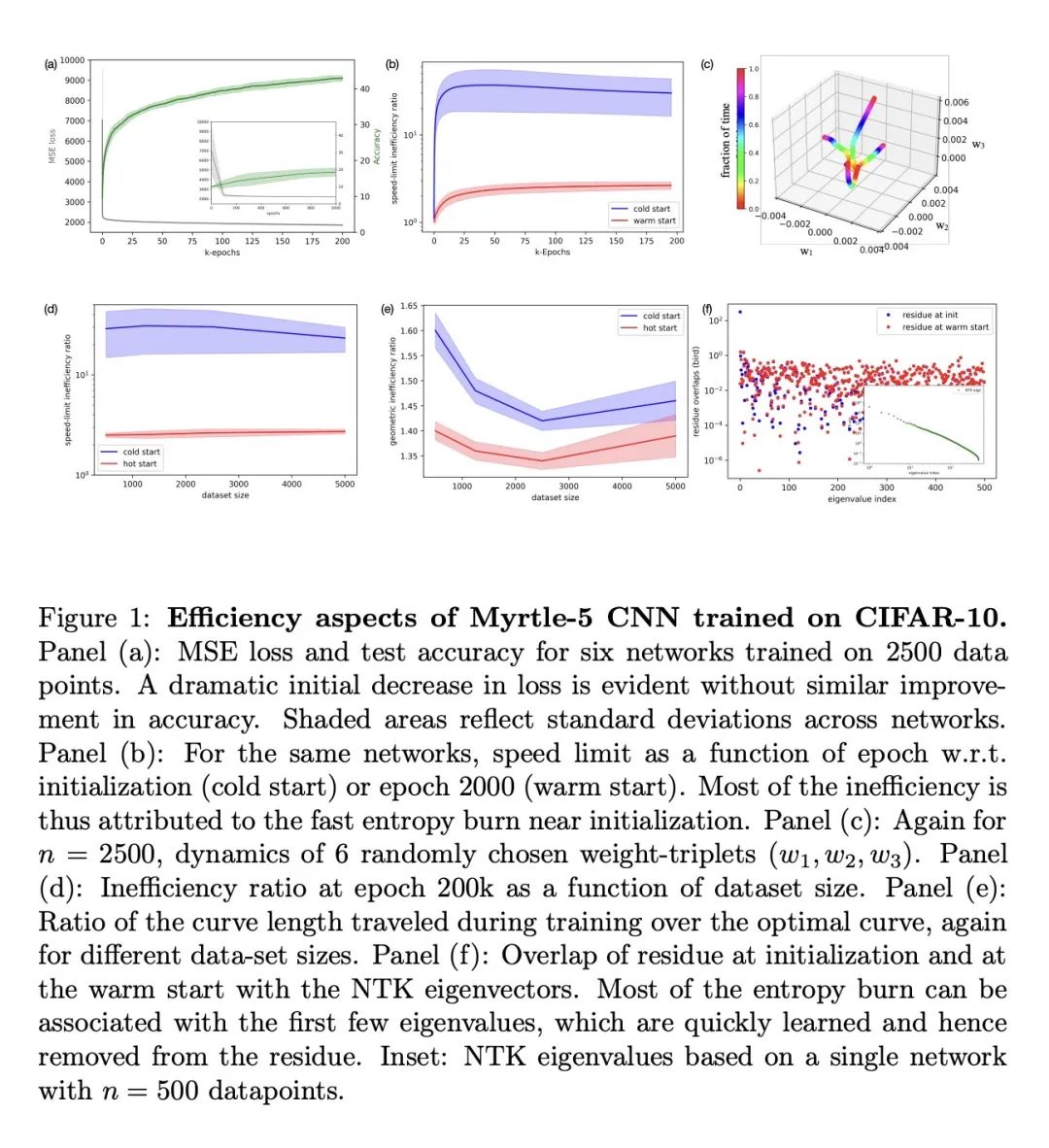

动机:研究在深度学习中,神经网络的训练速度是否可以进行优化,以及是否存在一个最优的训练速度限制。 -

方法:采用随机热力学的最新进展,用于限制从初始权重分布到完全训练网络的最优速度,基于它们的Wasserstein-2距离与动态过程的熵产生速率之比。考虑了梯度流和Langevin训练动力学,并针对线性和可线性化神经网络(如神经切向核NTK)提供了这些速度限制的分析表达式。 -

优势:将热力学的概念应用于深度学习领域,通过理论推导和实验验证,得出了关于神经网络训练速度的一系列结论,特别是对于使用NTK训练的神经网络,其学习效率在一定条件下是最优的。该研究为理解神经网络的训练动态提供了新的视角和参考,对于优化训练过程具有一定的指导意义。

探索了深度神经网络的学习动力学,应用热力学理论分析神经网络的训练速度限制,发现某些条件下使用NTK训练的神经网络具有最优的学习效率。

https://arxiv.org/abs/2307.14653

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢