LLM-Native:AGI的另一种路径

《银河系漫游指南》的作者——道格拉斯·亚当斯曾经对「技术」一词做出这样一种解释:

「技术」是描述某种尚未发挥作用的东西的词汇。

这是一个充满实用主义的定义,这句话可以被更直观地表述为:当我们还在热烈讨论某种技术时,往往意味着该技术还未真正发挥作用。

事实上所有底层技术驱动的产业革命都将经历一个市场焦点从技术向应用转移的过程,而当这种转移开始发生时,才意味着该技术开始兑现其价值。

对于大语言模型技术(下文称:LLMs)来说,在经历了注定载入科技史册的技术狂飙后,虽然目前其技术进展依然占据绝大多数的市场关注度,但已有迹象表明我们正处于技术兑现价值的破晓:

-

5月:Character.ai web端月访问量超过2亿并拥有恐怖的平均使用时长——Killer App的产品形态初见端倪。

-

6月:OpenAI招聘了世界级产品经理Peter Deng来操刀未来的消费级产品(可能是个人助理)——头部玩家的战略变化。

-

7月:Inflection完成13亿美元融资,创始人Mustafa明确表示公司定位为应用公司而非AGI研究机构——以应用为目标的新公司开始建立。

所以在AGI到来前,一个与“如何实现AGI”同样值得我们兴奋的问题摆在了面前:

当信仰AI的先知们摆脱AGI执念,带领信徒到达技术的应许之地后,拔地而起的将是一座何等壮丽的全新城邦。

这个问题的可能答案指向LLM-Native产品:一种建立在LLMs技术特点和思维方式上的全新产品范式。

事实上,LLM-Native产品并不意味着与AGI技术分道扬镳,而更像是某种形式的殊途同归,也许当我们暂时忘记AGI而转向扩大LLMs技术的使用范围以及创造全新产品时,这反而会成为另一种实现AGI的路径,就如同现在LLMs技术得以发展是建立在互联网数十年产品化积累的海量数据一样。

下面我们将对LLM-Native产品的底层逻辑、特点、以及如何创建等问题展开讨论。

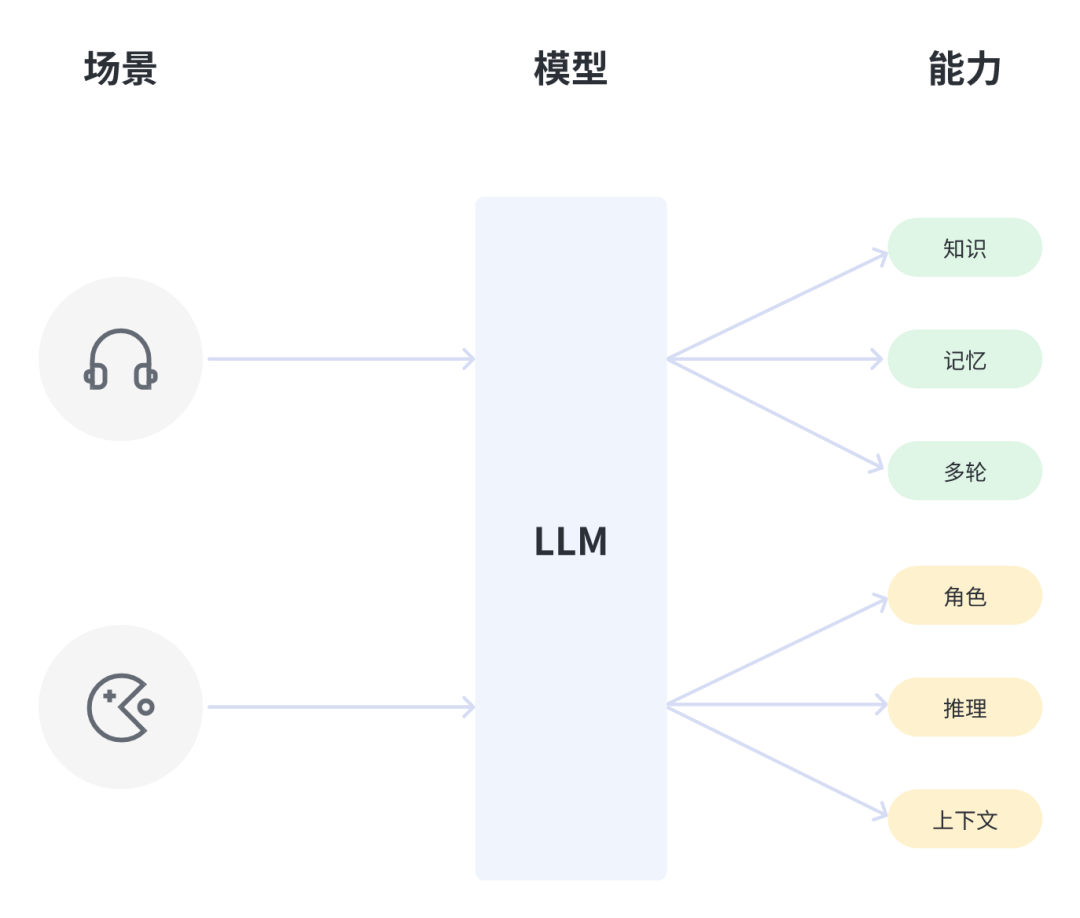

产品视角下的LLMs技术

在开始讨论LLM-Native产品之前,我们需要对LLMs技术的特点进行分析,这里的分析将从产品视角进行,更具体来说,我们将从产品开发者和产品使用者两种视角来观察LLMs技术。

产品开发者视角

-

模型即应用

从产品形态角度来看,LLMs相关的模型接收的输入是用户的自然语言,输出是最终可用信息或者任务执行结果(不需要开发者或者用户继续处理),所有中间处理所需的能力(如,任务拆解、信息生成、工具调用)都被封装在了模型中,所以对于LLMs来说,模型本身就是一个应用。

-

需求即功能

从功能设计角度来看,由于「涌现」的存在,LLMs所具备的能力是一个开放域,其能够解决何种问题同时取决于模型能力如何被设计以及用户如何去使用(即描述需求),也就是说LLMs会根据其对用户需求(意图)的理解自动形成对应的能力,这种能力的呈现形式不仅仅是我们所熟知的文本或者图像回应,也可以是一个交互界面或者是一个行动。

-

语言即代码

从产品开发角度来看,由于LLMs使用自然语言作为输入并对其进行回应,用户的文本描述将部分替代开发代码,由用户自己实现其需要的功能,另一方面也带来了LLMs产品天然的UGC属性。

Mr.-Ranedeer-AI-Tutor:用400+行prompt实现教学机器人

产品使用者视角

-

实时性

从信息时效性来看,由于LLMs的输出是对用户所描述需求的回应,所以用户从LLMs产品中每次获取的信息都是实时生成的,而非对已经存在的信息按照某种规则进行分发。

-

自主性

从使用过程来看,由于LLMs具备对用户需求进行任务拆解、目标规划、自动执行的能力,所以一个任务的完成过程并非完全由用户控制,LLMs产品在其中具有很强的自主性,任务将由用户和LLMs协作完成,这个特点已经在Agent类产品中出现。

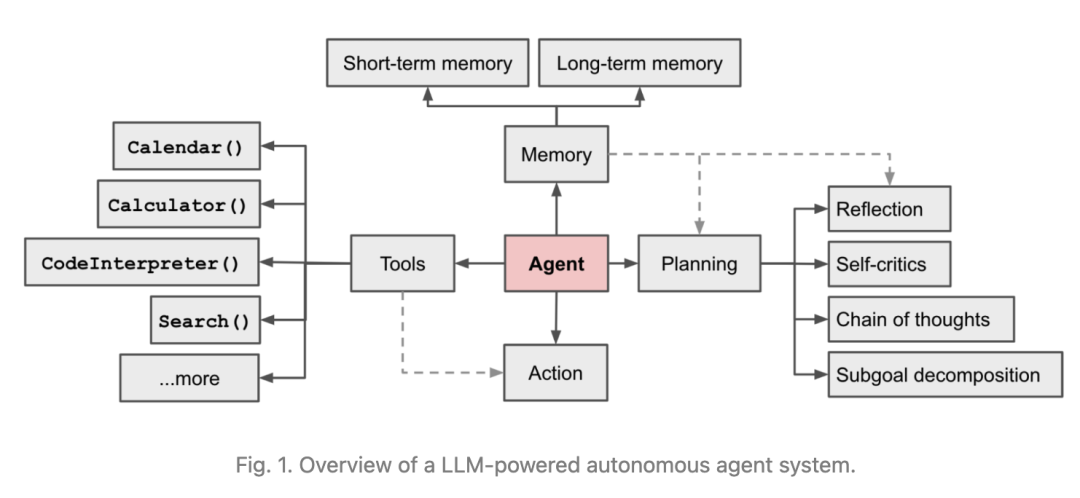

Agent具备显著的自主性:规划、行动、使用工具

Agent具备显著的自主性:规划、行动、使用工具

-

不确定性

从获取的信息质量来看,由于LLMs采用自回归方式生成,并且面向开放性任务的目标设计,其生成结果存在较强的不确定性,即用户很难精确、稳定、可控的获取其想要的内容或者结果。

我们当然还能总结出LLMs技术的其他特点,但由于本文的目标,这里主要关注对LLM-Native有决定性影响的部分,在下文中我们将看到这些产品维度的特点将如何影响我们对LLM-Native产品的设计与决策。

Welcome to Hogwarts

LLMs技术的新特点必然会给产品工作带来变化,认识并接受这些变化的过程也许会像从麻瓜世界长大的巫师首次进入霍格沃兹——有趣、反常、但必要,下面我们将从用户、需求、产品、业务、市场等不同维度来介绍我们在开展LLM-Native产品工作时将要面临的变化,欢迎进入LLMs的产品新世界。

当用户=开发者

用户作为产品的开发者并不是一件新鲜事,由用户为产品开发插件、甚至优化产品功能“古已有之”,但是像LLMs产品这样,每个用户的每次使用都是在对产品进行「开发」的情况却是头一次出现。

由于上文提到的「语言即代码」和「需求即功能」特点,LLMs产品的每一个prompt,都会是一个对应特定功能、或者可复用插件,而当将Agent、UI生成等能力加入产品后,用户的开发能力将会得到更大提升。

生产力决定生产关系,在LLMs提供的强大生产力下,我们将迎来一个全民开发的时代,如果说互联网实现了信息自由,那么LLM-Native产品将实现开发自由。

需求的无损传递与个性化满足

对于产品有这样一种表述:对用户需求抽象后的解决方案实现。那么从这个角度来看,产品功能其实是对用户需求的接收和翻译。

在实际产品工作中,无论是对需求的人为抽象还是对功能的人工设计,都无法实现用户需求的无损传递,而功能的标准化设计则注定其无法满足用户的个性化需求,那么不可避免的结果会是:

-

总有人不满意——功能设计的标准化与用户需求的个性化矛盾。

-

功能变复杂——为了更精确翻译更多的用户需求,不得不增加功能。

-

学习门槛增加——功能变多,以及单个功能与用户需求的匹配度降低。

在产品的生命周期中,这三者体现出相互叠加促进的关系,最终的结果是产品功能越来越复杂、新用户进入门槛高、老用户因体验下降流失,这个过程是很多产品在增长过程中无法逃脱的“用户规模马尔萨斯陷阱”。从搜索到推荐,算法一直在试图让产品增长脱离这个困境,即努力让功能内化在算法中从而实现用更少的产品复杂度来实现更多的功能,而这正是LLMs最为擅长的,具体来说:

对于LLM-Native产品,由于「模型即应用」、「需求即功能」的特点,我们可以实现:

-

需求通过自然语言描述输入模型——需求的高效传递。

-

需求对应的功能被实时生成——面向不同用户的个性化功能。

所以LLM-Native产品有很可能会打破产品设计的“用户规模马尔萨斯陷阱”,即用极简的产品设计在保持低使用门槛的前提下,个性化的满足复杂、海量的用户需求。

供给侧与消费侧改革

从经济角度来看,我们日常使用的绝大多数互联网产品都在围绕信息的生产、分配和消费进行设计,LLMs技术「需求即功能」和「语言即代码」的特点将对信息的供给和消费同时带来变革,具体如下:

在供给侧

-

信息的生产角色从人类开始向人类+算法过渡,这个过程将逐步实现信息内容生产的工业化、自动化和智能化,这意味着更高的内容生产效率以及内容生产成本边际递减。

-

信息生产活动将从库存逻辑向订单逻辑变化,即信息生产从一项业务的固定成本(提前生产好信息等待用户阅读、搜索、推荐)变成了一项可变成本(根据用户需求实时生成)。

-

信息的供给模式将从分发逻辑向生成逻辑转变,搜索和推荐都在进行信息分发,即让用户更高效地获得正确的「原始信息」,而LLMs生产信息的方式天然会将「原始信息」与用户进行隔离,当用户得到有用的信息时可能并不需要知道这个信息原本来自于哪里。

在消费侧

-

信息的使用方式从消费离线内容向消费实时内容变化,与信息生产逻辑变化相对应,用户使用信息的方式将从消费已经生产好的信息变为消费实时生成的信息。

-

信息的形式从静态向动态变化,与上一个变化对应,内容形式将从静态内容逐渐向可交互内容变化(比如对话实际上可被视为可交互的文本)。

-

获取的信息的方式从个性化向定制化变化,LLMs时代产品提供信息的方式将实现针对不同用户的定制化,即为特定用户生产专属信息,这在带来更好的信息消费体验的同时也会进一步增加信息茧房效应。

从产品的算法到算法的产品

从业务角度看,传统的AI业务中,算法与产品是两个有关联但又有各自独立的工作环节,而对于LLMs的产品来说,由于「算法即产品」的特点,对产品功能的设计将逐渐等同于对算法能力的设计,这将在以下三个维度带来变化:

-

目标层面:LLMs模型工作的目标是直接满足业务需求,而非提供某种模型能力后再进行业务封装,这需要对模型进行产品化的设计。

-

组织层面:与上述变化需要配套的是组织层面的变化,LLMs的模型研发团队不应是一个并行于业务单元的支持单元,而是其本身就是一个业务单元。

-

执行层面:对LLMs的产品经理有更多的要求,其工作范围将包括模型应当具备何种能力(任务设计),模型实际具备何种能力(模型评测),模型如何具备何种能力(数据与对齐策略)等。

新的市场熵增周期

市场熵(Market Entropy)用来代表市场上用户需求的无序程度(Figma的投资人Kevin Kwok提出),如果用户的需求变化速度更快,市场熵就会更高,其核心表述为:

-

较低的市场熵有利于已有产品(组织),较高的市场熵更有利于新产品(组织),市场熵处于上升趋势时,是拓展新业务的好时机,市场熵处于下降趋势时,则更需要考虑如何巩固已有优势。

-

自然状态下,市场熵的发展趋势是逐渐减少的,原因在于产品设计者会通过不断增加功能来满足、引导用户的需求,从而让市场上存量的有效用户需求不断减少,底层技术的革命会带来新的市场熵增。

-

底层技术能够将原本处在低熵状态的市场进行有效整合,从而形成全新的市场机会,而这是变革中最容易被忽视的点,即在被认为没有机会的市场中长出伟大的新产品。

显然LLMs技术将对市场熵产生广泛且剧烈的影响,带来新的熵增周期,这是本轮LLM-Native产品工作开展的一个基本外在客观事实,具体到当下,我们可以观察到:

-

熵增已经开始出现,用户对LLMs能做的事情正在进行积极地探索,需求产品化的速度显然低于用户在这种探索中形成新需求的速度。

-

目前的LLMs产品并未影响新增的市场熵,因为其仍处在面向已有需求设计产品的阶段,解决的是存量需求,比如实现更高效的搜索(直接获取加工后的信息)、更高的文本处理效率(摘要、数据处理、翻译)、辅助内容创作(代码、邮件、报告)。

变革中的那些确定性

信息的解构

-

旧的内容形式被解构后用来满足原有用户需求并形成新的产品形态。 -

新的产品形态在迭代中形成新的内容形式。

-

博客被解构为内容更短、参与门槛更低的Twitter、instgram。 -

电影被解构为电影解说类视频和弹幕。 -

歌曲被解构为其中最好听的那一小部分来作为短视频的BGM。

通过制造稀缺

-

从经济学的供需原理来看,稀缺性将提升价格——卖的更贵。 -

从心理学的稀缺效应来看,稀缺将带来更多的关注——获得更多注意力从而获得更高的经济价值。 -

从行为经济学来看,稀缺将带来更容易做出的消费决策——更高的付费意愿。

满足控制感

-

功能的可控性变弱:功能被隐藏在模型能力中了,对用户来说会不知所措。 -

形态的可控性变强:形态上,以自然语言对话为核心的产品形态将增强用户的控制感。 -

全新的内容可控性:与上文提到的信息供给侧逻辑变化相对应,由于内容是模型实时生成的,所以用户第一次拥有了对内容的控制感。

需求抽象程度不断提升

-

Photoshop面向的需求为如何更好的控制像素点,而到了Canvas、Figma时代需求变成了如何更快的使用模板得到一个可用的设计稿。 -

搜索引擎面向「哪些信息包含我提供的query」的需求,而推荐引擎使用更高抽象程度的user profile作为分配依据,将需求抽象至「哪些信息可能是符合我的偏好」。

-

Midjourney面向图像所包含的要素、风格以及其他用户要求来创作图像。 -

Jasper等文本生成产品将文本创作需求的抽象程度提升到对内容的直接描述。 -

Perplexity等搜索(或者称之为生成)引擎则将获取信息的需求抽象到了对所需信息本身的描述(当然也继承了推荐时代的user profile)。

加工更高层级的智慧信息

-

媒介是人的延伸:一种媒介总能够映射到某种人类的能力。 -

媒介即是信息:媒介本身决定其传递的信息内容。

-

实际业务中被验证有效的工作流。 -

尚未被信息化的行业know-how。 -

带有行业属性的结构化信息模板。

创建LLM-Native产品的几个原则

LLM-Native与模型自由

-

垂直模型面向应用,用更低的成本以及更好的业务效果为特定场景服务。 -

通用模型面向模型生产,用更强的智慧水平提高垂直模型生产的效率。

找到自己的LLMs的能力光谱

-

知道自己需要什么样的模型。 -

能够评价不同模型对业务的价值。 -

可以指导模型效果的优化方向。

利用LLMs的优势而非劣势

-

优势

-

能力是一个开放域

-

通过自然语言完成交互

-

内容是动态可操作的

-

...

-

劣势

-

内容不可控

-

实时生成速度慢

-

模型更新、使用成本高

-

...

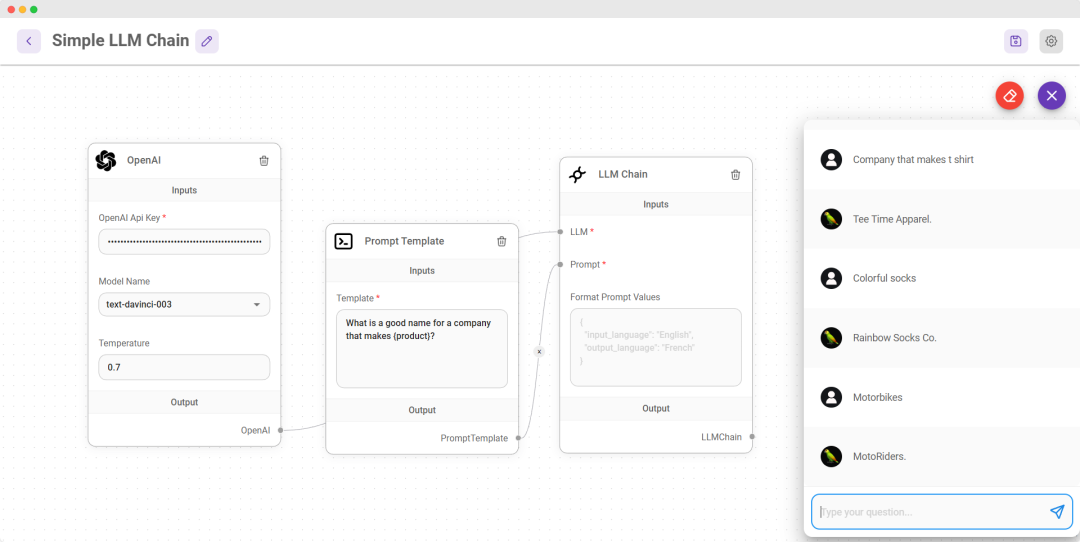

生成器和系统2

-

由于模型能力的开放性,相同需求的不同指令差距会很大。 -

除了prompt外的其他要素也会加入指令被输入模型,比如外部知识库、工具接口等。 -

模型能力越来越强,对应的指令也会越来越复杂,这也是上文提到的“语言即代码”特性的必然结果。

-

设计产品就是设计模型 -

设计产品就是设计生成器

LLM-Native产品的特点

新问题

-

什么会更好:如何通过新技术更好的解决已有问题。 -

什么会出现:拥有新技术后有哪些之前无法解决的问题变得可解了。

-

第一类问题:需求容易被发现,很快就能有收益,但解决的是存量需求,通常会表现为某种形式的降本,需求的价值上限低。 -

第二类问题:需求通常是被隐藏或者压抑的,需要被挖掘,通常需要更长的产品周期才能兑现收益,解决的是增量需求,带来的也是社会整体价值的增加,比如创造新职业,甚至新行业,需求的价值上限更高。

-

拥有新技术才能解决,比如短视频产品需要同时具备智能手机+4G网络才会出现。 -

将已有产品的底层需求代入新技术,比如个人知识库在表面解决的是信息存储和处理的问题,而其底层则包含着如何有效的使用这些信息的需求,从这个底层需求出发,就能发现LLMs的生成能力与这个需求天然契合。 -

从新技术的特点出发,我们上文提到了一些LLMs技术的特点,那么用这些特点来对应用户问题也是一个可行的思路,比如LLMs可以生成如何行动的信息,那么对应的问题便是计划类、行动类问题,相比上一代AI解决感知型、决策型问题而言,就是新问题。

新形态

-

LLMs的开放域使用方式,要求其必须拥有无限的功能与界面,而这些功能与界面显然是无法通过人工设计来满足的,所以从技术的特性上其具有必然性。 -

LLMs的「语言即代码」特性则提供了动态功能的可行性,在这个特性下,用户的需求以自然语言的形式进行转化和加工后,可以直接生成对应的功能或者界面。

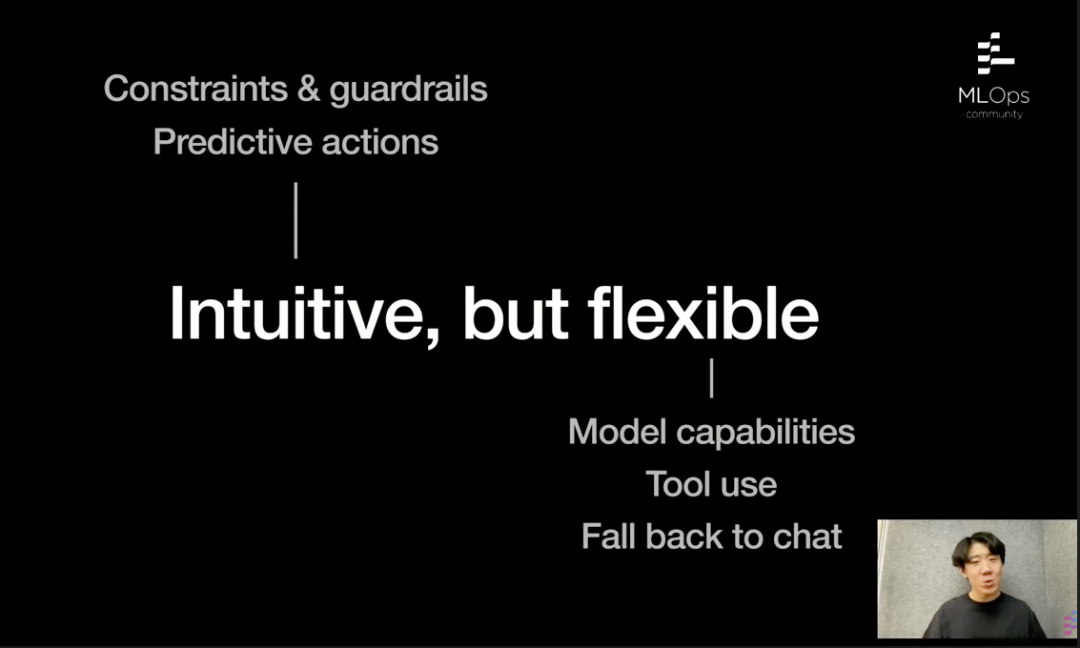

新交互

-

自然语言作为交互方式有优点(更高的灵活性)也有弱点(可理解性)。 -

LLMs对交互设计来说,其价值在于增加了一种新的维度,应当与其他的交互维度(如GUI)配合使用。

自然语言交互提供了更好的灵活性,但也损失了产品的可理解性

-

尽可能减少对用户行为的约束。 -

会有更多设计被用于帮助和引导用户理解和调起模型能力。 -

对模型输出会有更多的引导和约束从而确保结果的可控。

早期LLM-Native产品的观察

社交

-

人-机社交:人类与AI进行社交,比如Character.ai,Replika。 -

机-机社交:AI与AI进行社交,人类进行观察或者参与,比如chirper。

-

交换信息:即提供效率价值 -

找到同类(from 张小龙):即提供情绪价值

内容

-

可以自定义剧情的多模态内容”小说“。 -

可以按需生产的新型”短视频“内容。 -

可以结合用户画像以及其需求描述的实时生成的资讯内容。 -

...

工具

-

确实能够在LLMs的能力下提供更高的工作效率。 -

被集成在现有的工作流中并能够获取工作流中的用户操作信息。 -

用户操作信息是已有LLMs能力的衍生。

-

对某个场景有效的LLMs能力建设。 -

以尽可能高效获取工作流中的更高智慧信息为目标进行Copilot产品形态设计。 -

优化LLMs能力直至成为AI-worker。

Github Copilot:最早也是最为典型的Copilot产品

总结

-

LLM-Native产品有何不同 -

LLM-Native产品的独特性从何而来 -

在进行LLM-Native产品时应当注意哪些问题

Reference:

-

https://github.com/JushBJJ/Mr.-Ranedeer-AI-Tutor#prompt-formats -

https://kwokchain.com/2021/02/05/atomic-concepts/ -

https://www.nngroup.com/articles/ai-paradigm/ -

https://maithraraghu.com/blog/2023/does-one-model-rule-them-all/ -

https://www.bilibili.com/video/BV1ts4y1T7UH/?vd_source=0a7349493c5d70149efefa88eac70de1 -

https://mp.weixin.qq.com/s/p0qFgduUX4R-4LnRDhHP2Q -

https://www.geoffreylitt.com/2023/03/25/llm-end-user-programming.html?utm_source=bensbites&utm_medium=newsletter&utm_campaign=have-you-been-a-bard-boy -

https://www.youtube.com/watch?v=rd-J3hmycQs -

https://a16z.com/2023/05/23/generative-ai-probabilistic-products/ -

https://mp.weixin.qq.com/s/JvnGT9RnrcO1KGn6c-9qMg -

https://mp.weixin.qq.com/s/quzcSo7y-z96k_waujYjAw -

https://mp.weixin.qq.com/s/m85shIJ5r-kYvXkuHrrnFQ?from=timeline&isappinstalled=0&scene=2&clicktime=1686992182&enterid=1686992182 -

https://mp.weixin.qq.com/s/_vqNmQECdKaJJXW4agQh9g -

https://www.inworld.ai/ -

https://www.youtube.com/watch?v=OT7XvazhHgE

一起在人工智能时代旋转跳跃眨巴眼

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢