论文题目:When to Pre-Train Graph Neural Networks? From Data Generation Perspective! 作者:Yuxuan Cao, Jiarong Xu, Carl Yang, Jiaan Wang, Yunchao Zhang, Chunping Wang, Lei Chen, Yang Yang 机构:浙江大学,复旦大学, 埃默里大学,苏州大学,芬诺科技

本文提出一个W2PGNN框架,以回答何时进行图神经网络预训练的问题。通过研究从预训练数据到下游数据的生成机制,该框架可以告知在进行耗费大量资源的预训练和微调之前,进行预训练的可行性。具体来说,本文将预训练图拟合为graphon基,并以graphon基的凸组合构建图生成器,该生成器可以生成可能从预训练中受益的下游图。因此,下游数据被该生成器以高概率生成的程度可以表示预训练的可行性。实验表明,本文方法可以准确评估预训练的可行性,并可以选择提升下游性能的预训练数据。

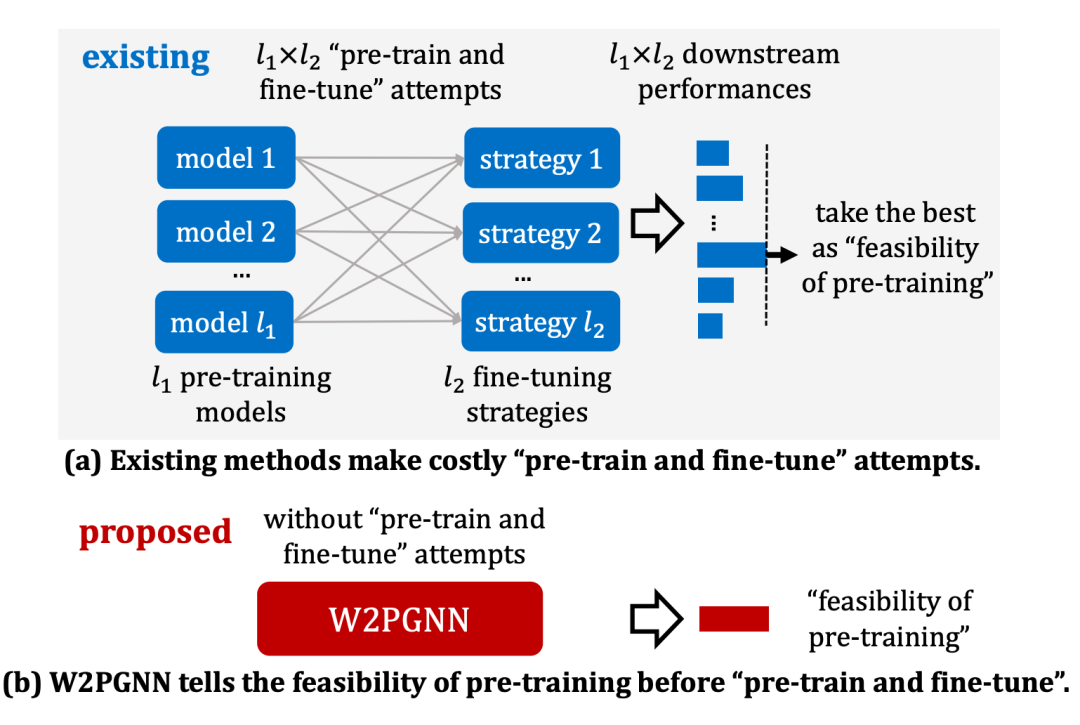

近年来,图预训练在学习图数据方面得到了迅速发展和日益普及。图预训练模型通常在自监督或无监督的目标下首先从大规模图数据集中学习通用知识(即预训练阶段),然后将这些知识转移到解决特定下游任务(即微调阶段)。 然而,图预训练模型并非都会使下游任务受益。相反,图预训练模型可能会导致许多下游任务的负迁移,特别是当用于预训练的图与下游数据不一定来自相同域时。 为了避免无效的,有害的迁移,最近的工作解决要预训练什么和如何预训练的问题,即设计/采用各种自监督任务进行图预训练和微调策略。但是,所有这些努力都需要解决要预训练什么和如何预训练的问题,通过开发预训练或微调方法。 本文研究什么时候预训练图神经网络

W2PGNN框架通过数据生成角度回答何时预训练图神经网络的问题。

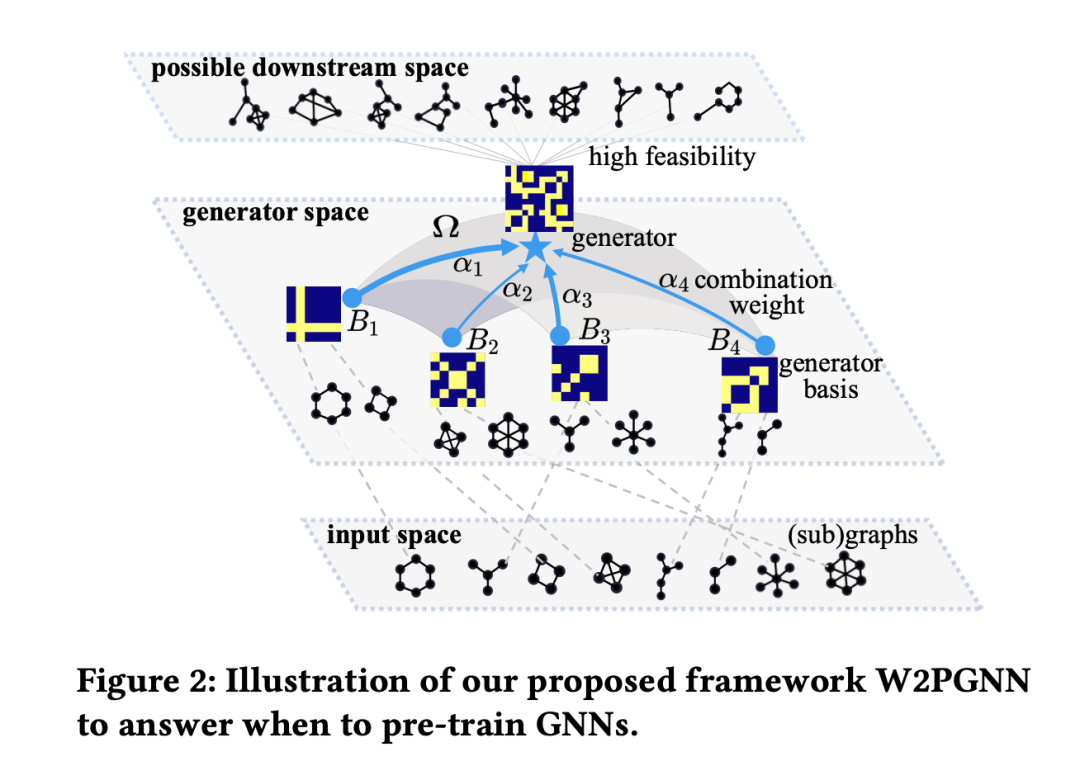

输入空间由节点的自身网络或子图组成。对于节点级预训练,作者采用节点的网络构成输入空间;对于图级预训练,作者将图(例如小分子图)作为输入空间。 生成器空间中的每个点{B1,B2,...,Bk}的凸组合。形式上,将图生成器定义为f({αi},{Bi})= Σki=1 αiBi,其中Σki=1 αi=1,αi≥0。不同的{αi},{Bi}组成不同的图生成器。所有可能的生成器构成生成器空间Ω={f({αi},{Bi}),{Bi}}。 对于生成器空间Ω中的每个生成器f,可以生成一个n节点图G,其中先独立为每个节点采样一个随机潜在变量,然后为每对节点分配它们之间的边,边存在的概率等于图在它们随机采样的点的值f(vi,vj)。这样,利用生成器空间Ω中的所有生成器,可能的下游空间定义为D=G~f。 如果下游图可以以更高的概率从生成器空间Ω中的任何生成器生成,则该图可以更多地从预训练中受益。因此,我们将执行预训练的可行性定义为下游数据由Ω中的生成器生成的最高概率,可以表示为一个优化问题。

该方法主要挑战是如何获得一个适当的图生成器,希望它不仅继承预训练数据的可转移拓扑模式,而且还具有生成可行下游图的能力。

为了解决这个挑战,作者建议根据graphon设计图生成器。作者首先将预训练图拟合到不同的graphon中以构建一个graphon基,其中每个graphon(即graphon基的元素)标识共享常见可转移模式的一组预训练图的集合。然后将graphon基的凸组合定义为图生成器,它充当预训练数据的综合和代表性汇总。

给定上述三种graphon基,可以将graphon基的选择指定为其中之一。在减小的graphon基搜索空间中,可行性可以被近似。最后,我们获得三种不同{Bi}下的下界距离中的最小值,作为预训练可行性的近似值。

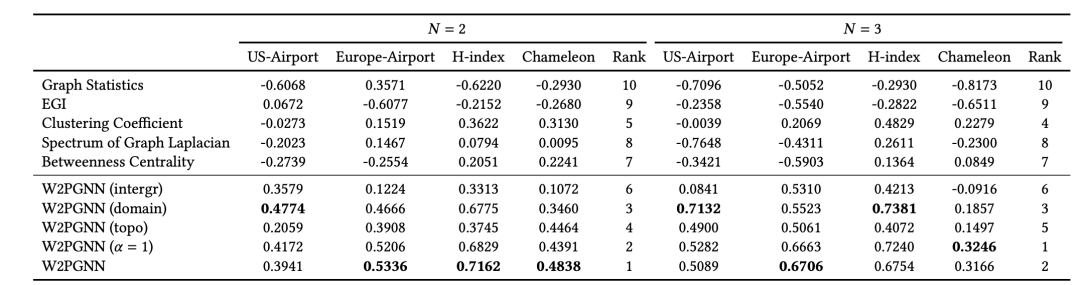

在节点分类和图分类任务上验证了所提出的框架。结果显示,该模型在大多数情况下都具有最高的整体排名,这表明了提出框架的有效性。 其他基准给出的度量有时与最佳下游性能无关或呈负相关。

通过比较W2PGNN及其变体,发现尽管变体有时在某些下游数据集上取得优越表现,但它们无法始终在所有数据集上保持良好的表现。而顶级排名的W2PGNN可以提供各种图基和可学习组合权重的更全面图像。 结果显示,模型达到了最高的整体排名,这表明选择预训练数据方法的有效性仍然显著。 作者还发现,有时简单的图属性(如群集系数)对特定数据集(即H-index)来说是一个不错的选择,当预训练数据预算为2时。这是因为H-index相比其他下游数据集展示了最大的群集系数,这有助于通过群集系数进行数据选择。但是,当您需要为预训练选择更多数据集时,这种简单的图属性就不起作用了。 有趣的是,作者发现使用所有预训练数据进行预训练并不总是一个可靠的选择。仔细选择预训练数据不仅可以提高下游性能,还可以减少计算资源。

本文根据预训练数据到下游数据的生成机制,提出了一个W2PGNN框架来回答何时预训练图神经网络的问题。W2PGNN设计了一个基于graphon的图生成器来总结预训练数据中的知识,该生成器反过来可以产生可以从预训练中受益的下游图的解空间。

作者从理论和实验两方面证明了W2PGNN的有效性。在多个领域的真实世界图数据集上进行的大量实验表明,所提出的方法可以对预训练可行性进行准确估计,所选定的预训练数据可以提高下游性能。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢