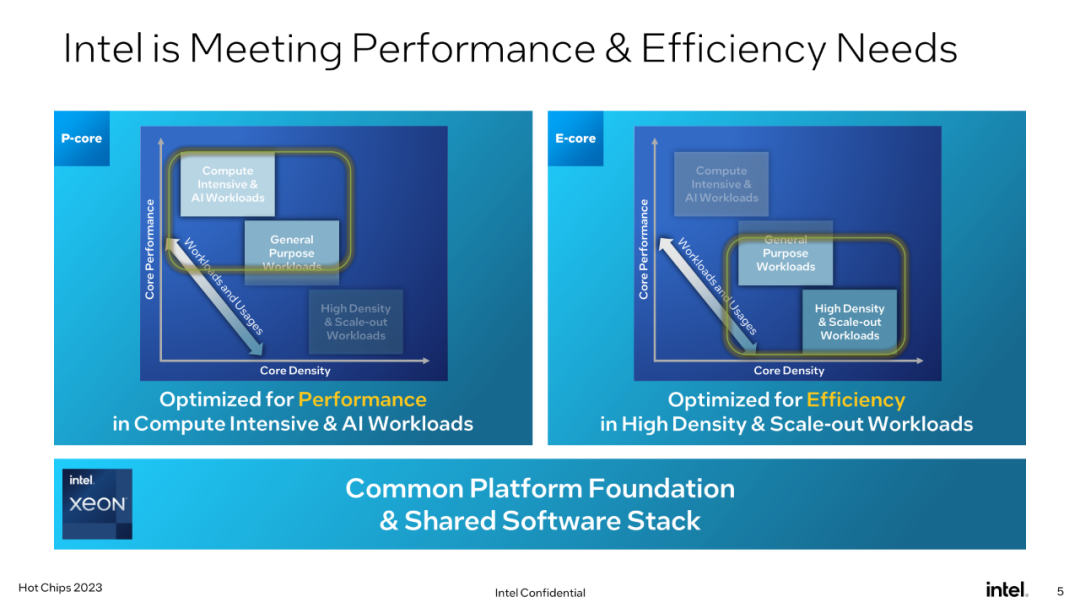

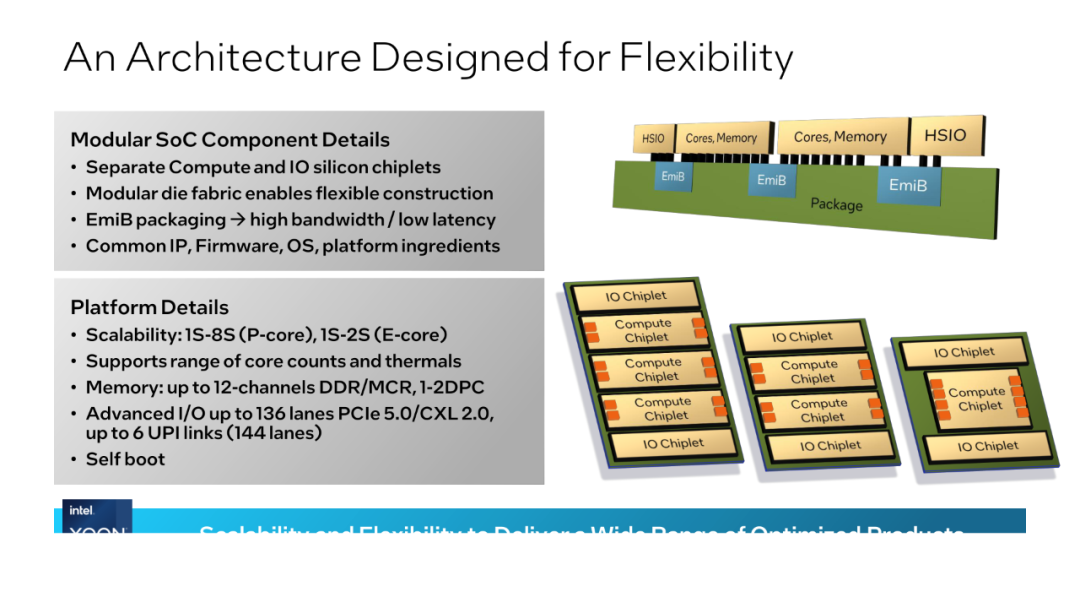

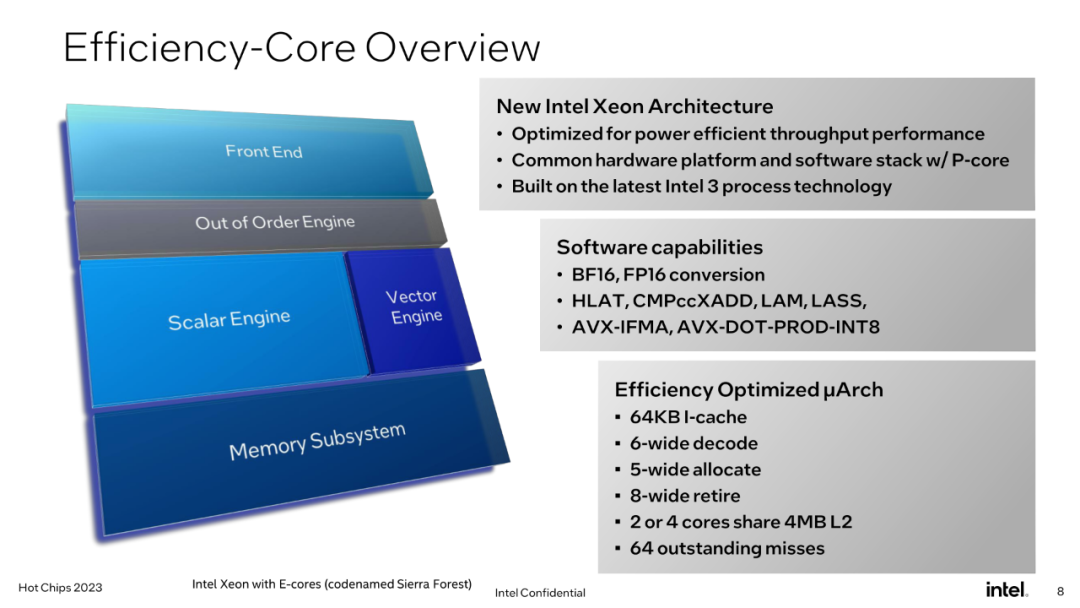

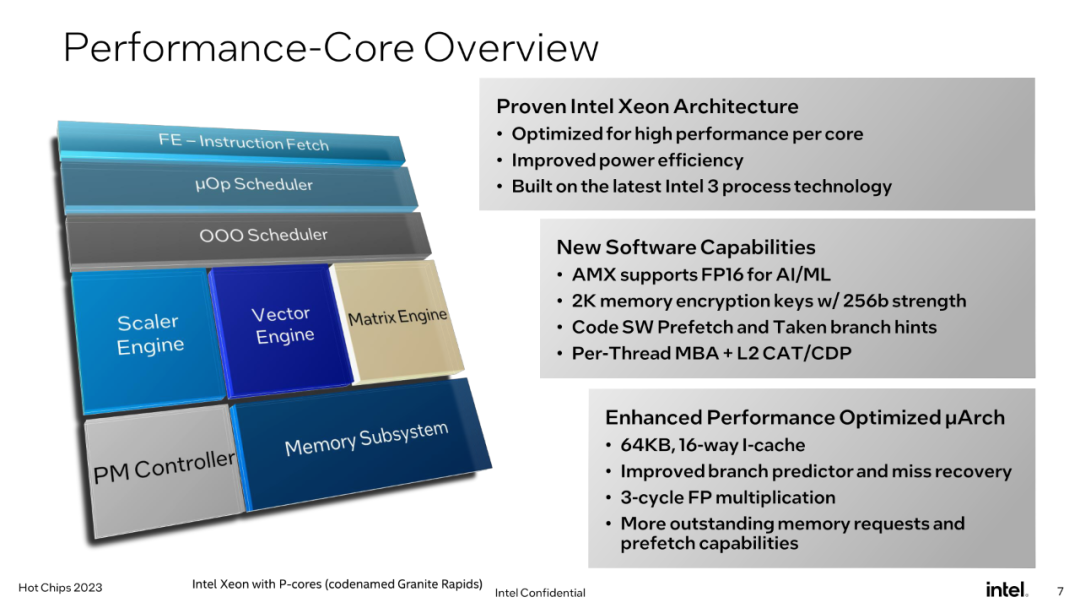

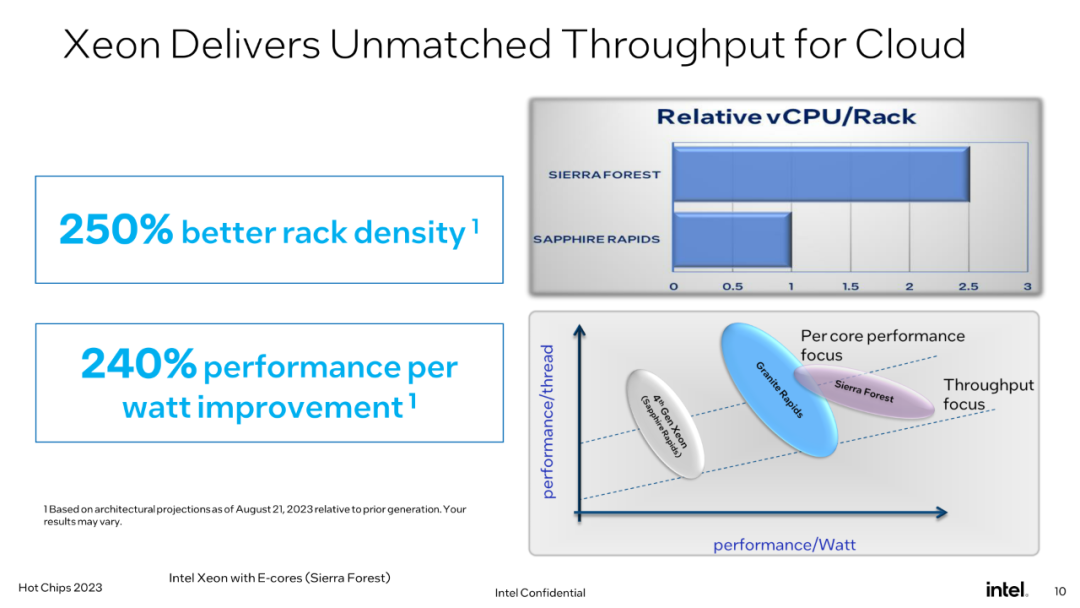

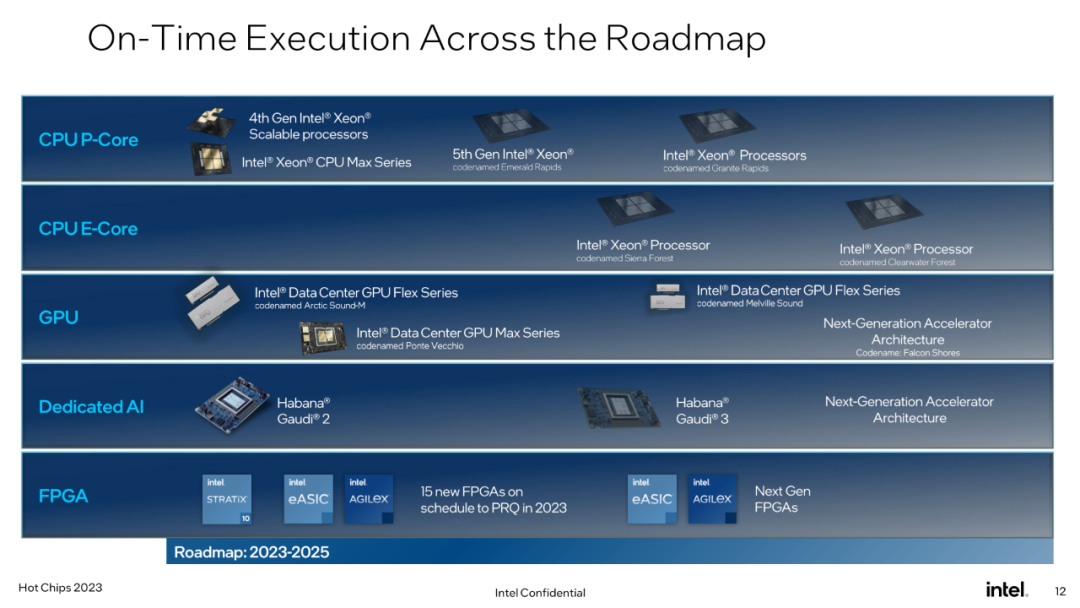

每年一度的 Hot Chips 是半导体业界最重要的技术会议。在其中,芯片领域专家齐聚一堂,全球芯片厂商也经常选择在这里发布新产品,或是阐述未来的发展方向。当地时间周一,在斯坦福大学举办的 Hot Chips 2023 上,英特尔首次披露了新一代数据中心芯片「Sierra Forest」,它的每瓦性能较前代提升了 240%,并有望于明年推出。同时,英特尔首次将旗下数据中心芯片分为两类:一类是 Granite Rapids,专注于高能耗高性能;一类是 Sierra Forest,专注于高能效。接下来看 Granite Rapids 和 Sierra Forest 这两款数据中心芯片的具体细节。整体来讲,得益于引入了面积高效的 E 核(能效核),Granite Rapids 和 Sierra Forest 将有望成为迄今为止英特尔 Xeon(至强 )可扩展硬件生态系统中最重要的更新之一。先来看 Sierra Forest,它是英特尔首款用于数据中心的 E 核 Xeon 可扩展芯片,还是基于 EUV 的 Intel 3 工艺的主导产品。英特尔表示,Sierra Forest 有望于明年上半年上市。同时,Granite Rapids 也采用相同的 Intel 3 工艺。在设计上,Granite 和 Sierra 都是基于小芯片(chiplet)的设计,依赖通过英特尔 EMIB(Embedded Multi-Die Interconnect Bridge, 嵌入式多核心互联桥接)技术封装在一起的计算和 I/O 小芯片的混合。不仅如此,这次的小芯片设计还有独到之处,使用不同的计算 / IO 小芯片,而不是将「完整的」Xeon 小芯片封装在一起。这意味着,Granite 和 Sierra 可以共享基于 Intel 7 工艺构建的、通用 I/O 小芯片。除了共享平台的详细信息外,英特尔还首次提供了 E 核和 P 核(性能核)所用架构的高级概述。正如现在多代 Xeon 的情况一样,英特尔正在利用与其消费部件相同的基本 CPU 架构。因此,Granite 和 Sierra 可以被认为是解构的 Meteor Lake 处理器,Granite 配备 Redwood Cove P 核心,而 Sierra 配备 Crestmont E 核心。如前所述,这是英特尔首次尝试为 Xeon 市场提供 E 核。对英特尔来说,这意味着要针对数据中心工作负载调整 E 核设计,与上一代以消费级应用为中心的 E 核心设计大有不同。英特尔透露,Crestmont 正在提供 6-wide 指令解码路径以及 8-wide 隐退后端。虽然不如英特尔的 P 核心强大,但 E 核心绝不是轻量级核心,英特尔的设计决策反映了这一点。尽管如此,它的设计在芯片空间和能耗方面都比 Granite 中的 P 核心要高效得多。Crestmont 的 L1 指令高速缓存(I 高速缓存)将为 64KB,是早期设计中 I-cache 大小的两倍。与此同时,Crestmont E-core 系列的新成员可以将这些核心打包成 2 或 4 核集群,这与目前仅提供 4 核集群的 Gracemont 不同。最后,对于 Sierra/Crestmont,该芯片将提供与 Granite Rapids 尽可能接近的指令。这意味着有 BF16 数据类型支持,以及对各种指令集的支持,例如 AVX-IFMA 和 AVX-DOT-PROD-INT8。同时对于 Granite Rapids,我们有 Redwood Cove P 核心。Redwood/Granite 是 Xeon 处理器的传统核心,对于英特尔来说,变化并不像 Sierra Forest 那样大,但这并不意味着他们没有改进。在微架构方面,Redwood Cove 获得了与 Crestmont 相同的 64KB I 缓存,容量是其前身的 2 倍。但最值得注意的是,英特尔成功地进一步降低了浮点乘法的延迟,将其从 4/5 个周期减少到仅 3 个周期。像这样的基本指令延迟改进很少见,因此我们总是期盼能够出现。除此之外,Redwood Cove 微架构还有分支预测和预取等特性,这是英特尔的典型优化目标。它们可以采取的任何措施来改进分支预测(并降低罕见失误的成本),经常会在性能方面带来相对较大的红利。Redwood Cove 的 AMX 矩阵引擎获得了 FP16 支持,尤其适用于 Xeon 系列,而 FP16 的使用不如已支持的 BF16 和 INT8 那么多,但它总体上改进了 AMX 的灵活性。对于内存加密的支持也正在得到改进。Granite Rapids 的 Redwood Cove 将支持 2048 个 256 位内存 key,而 Sapphire Rapids 则支持 128 个 key。虽然现在谈论 Granite Rapids 和 Sierra Forest 的各个 SKU 还为时过早,但英特尔已明确告诉我们,核心数量总体正在增加。Granite Rapids 芯片将提供比 Sapphire Rapids 更多的 CPU 内核(SPR XCC 为 60 个)。当然,Sierra 的 144 个内核将提供更多的 CPU 内核。在之前的 Xeon 推迟并花费很长时间才将 E 核 Xeon 可扩展芯片推向市场之间,英特尔并没有像以前那样在数据中心市场占据主导地位,因此 Granite Rapids 和 Sierra Forest 将标志着一个重要的拐点,给英特尔数据中心产品的未来发展指明了道路。我们知道,为互联网和在线服务提供动力的数据中心承载着巨量的算力需求,同时也需要消耗大量电力。最近几年随着 AI 等技术的发展,科技公司正面临提升算力、降低能耗的挑战,这促使芯片公司专注于提升功耗效率。目前,在数据中心芯片市场,英特尔的份额正一步步被 AMD 和 Ampere(前英特尔高管 Renee James 成立的初创公司)等竞争对手蚕食。今年,Ampere 和 AMD 都已推出了自己的高效率云计算芯片,Arm 也在本次的 Hot Chips 2023 上提出了 Neoverse V2 平台。竞争愈加激烈的当下,英特尔有危机感在所难免。https://www.anandtech.com/show/20034/hot-chips-2023-intel-details-granite-rapids-and-sierra-forest-xeonshttps://www.reuters.com/technology/intel-says-new-sierra-forest-chip-more-than-double-power-efficiency-2023-08-28/若觉得还不错的话,请点个 “赞” 或 “在看” 吧

论文指导班

论文指导班面向那些没有导师指导、需要升学申博的朋友,指导学员从零开始调研相关方向研究、尝试idea、做实验、写论文,指导老师会提供一些idea、代码实现部分的指导、论文写作指导和修改,但整体仍然是由学员自主完成。需要说明的是,论文指导班并非帮你写论文,或者直接给一篇论文让你挂名,我们不会做任何灰色产业,因此,想直接买论文或挂名的朋友请勿联系。

指导老师:

海外QS Top-60某高校人工智能科学博士在读, 师从IEEE Fellow,曾在多家AI企业担任研究实习生和全职算法研究员,具备极强的学术届和工业界综合背景。研究领域主要包括通用计算机视觉模型的高效设计,训练,部署压缩以及在目标检测,语义分割等下游任务应用,具体包括模型压缩 (知识蒸馏,模型搜索量化剪枝), 通用视觉模型与应用(VIT, 目标检测,语义分割), AI基础理论(AutoML, 数据增广,无监督/半监督/长尾/噪声/联邦学习)等;共发表和审稿中的15余篇SCI国际期刊和顶级会议论文,包括NeurIPS,CVPR, ECCV,ICLR,AAAI, ICASSP等CCF-A/B类会议。发明专利授权2项。

长期担任计算机视觉、人工智能、多媒体领域顶级会议CVPR, ECCV, NeurIPS, AAAI, ACM MM等审稿人。指导研究生本科生发表SCI, EI,CCF-C类会议和毕业论文累计30余篇,有丰富的保研,申博等方面经验,成功辅导学员赴南洋理工,北大,浙大等深造。

涉及范围:CCF会议A类/SCI一区、CCF会议B类/SCI二区、CCF会议C类/SCI三区、SCI四区、EI期刊、EI会议、核心期刊、研究生毕业设计

报名请扫描下方二维码了解详细情况,备注:“论文班报名”。

如果有其他想要当论文指导老师的朋友,请发简历给我,同样扫描上方二维码,备注:“论文指导老师”。基本条件:已发表两篇以上一作顶会,或3-5篇其他级别的一作论文,学历在985博士及以上。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢