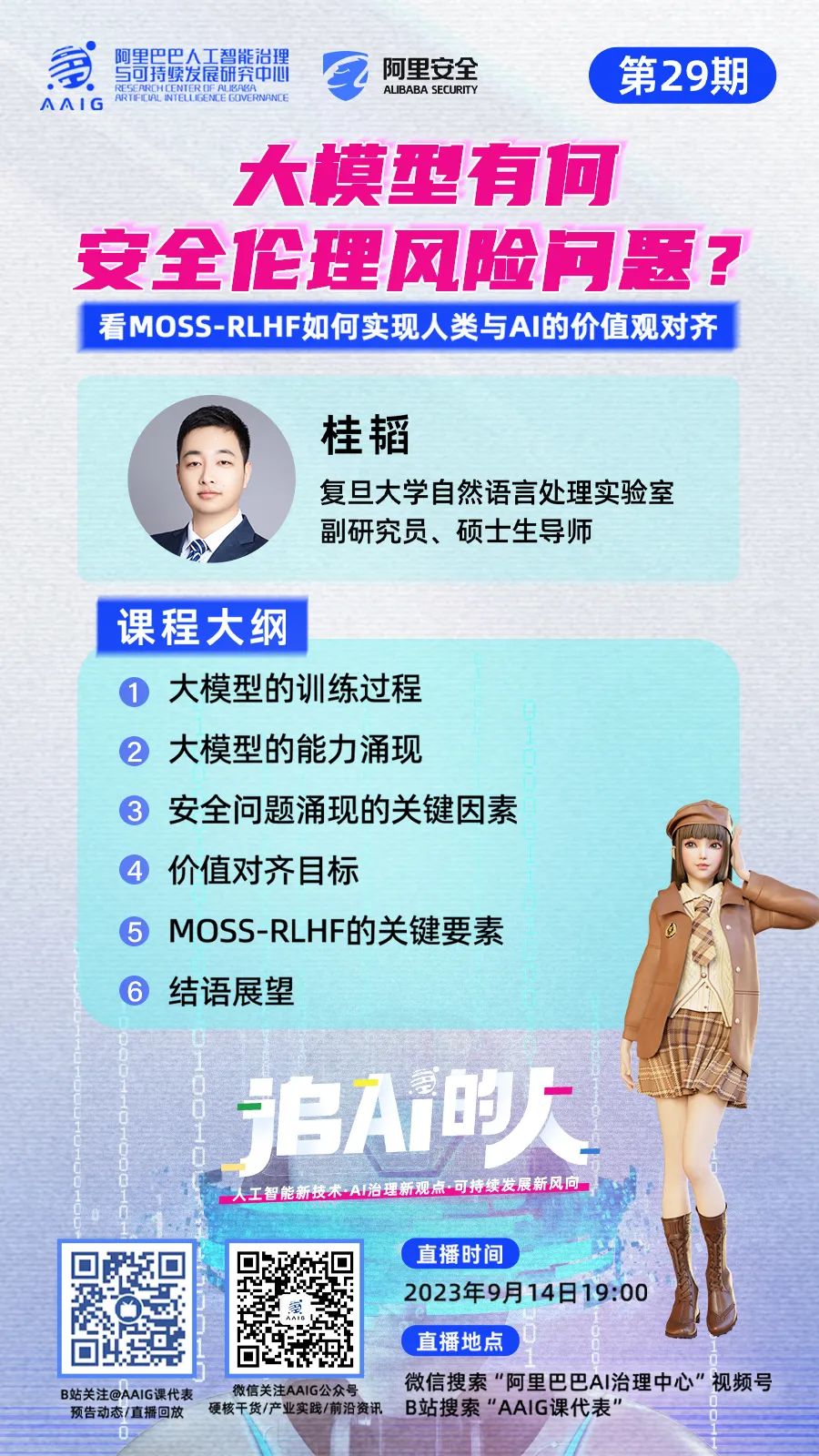

💙 大模型有什么安全伦理风险问题?安全问题如何涌现?

💙 什么是价值观对齐?实现价值观对齐的关键因素有哪些?

💙 如何让大模型的能力和行为与人类的价值、真实意图和伦理原则一致?

本周四(9月14日)19:00,《追AI的人》系列直播第29期邀请了复旦大学自然语言处理实验室副研究员、硕士生导师桂韬分享《大模型有何安全伦理风险问题?看MOSS-RLHF如何实现人类与AI的价值观对齐》。直播主题:《大模型有何安全伦理风险问题?看MOSS-RLHF如何实现人类与AI的价值观对齐》

直播地点:微信搜索“阿里巴巴AI治理中心”视频号,B站搜“AAIG课代表”。随着基础模型的兴起,NLP正在经历模型范式“同质化”的转变,如今,NLP领域几乎所有的SOTA模型都是少数几个基于Transformer 的大模型进化而来。而且,这种趋势正在向图像、语音、蛋白质序列预测、强化学习等多个领域蔓延。整个 AI 社区似乎出现了一种大一统的趋势。这种同质化也带来了一些隐患,因为基础模型的安全性、公平性、隐私性缺陷也会被所有下游模型所继承。本报告将介绍大模型的安全伦理风险以及带来的社会影响,探讨通过人类反馈的强化学习算法实现价值观对齐-MOSS RLHF,以及缓解安全伦理问题的可行方案。

桂 韬

复旦大学自然语言处理实验室副研究员、硕士生导师。研究领域为预训练模型、类人对齐和工具学习。在高水平国际学术期刊和会议上发表了50余篇论文,主持国家自然科学基金、计算机学会、人工智能学会多个人才项目。曾获钱伟长中文信息处理科学技术奖一等奖、COLING2018最佳论文提名奖、NLPCC2019杰出论文奖、CIPS优博奖、ACM优博奖,入选第七届“中国科协青年人才托举工程”、上海市启明星计划、世界人工智能大会云帆奖“璀璨明显”称号。《追AI的人》系列直播是一档由阿里巴巴人工智能治理与可持续发展研究中心(AAIG)联合高校和产业界发起的AI治理交互栏目。重点关注并分享人工智能新技术、AI治理新观点、可持续发展新风向。目前联合高校、律所等多家单位举办了28期直播,吸引全国超100万人次实时观看。

👇AAIG课代表,获取最新动态就找她

关注公众号发现更多干货❤️

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢