元象多语言通用大模型 XVERSE-13B 自 8 月 7 日开源以来广受关注,为促进大模型在垂直领域和特定任务的应用,方便开发者快速高效地定制化调优,元象宣布推出 XVERSE-13B-Chat 版,继续开源,并可免费商用。

开源信息

https://huggingface.co/xverse/XVERSE-13B-Chat

联系邮箱:opensource@xverse.cn

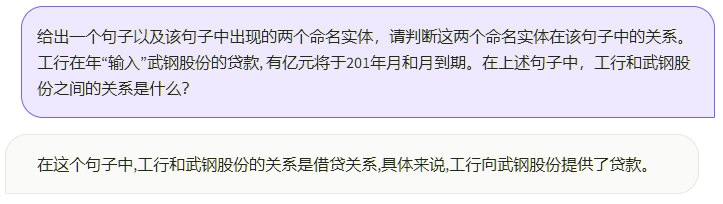

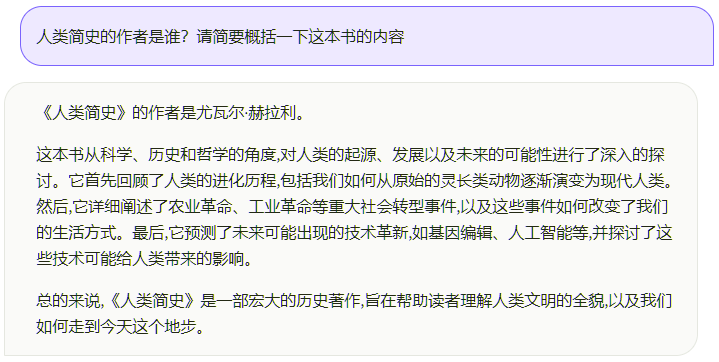

图一:XVERSE-13B 系列使用 five shot 方法测试

在各项中英文权威测评中持续领先

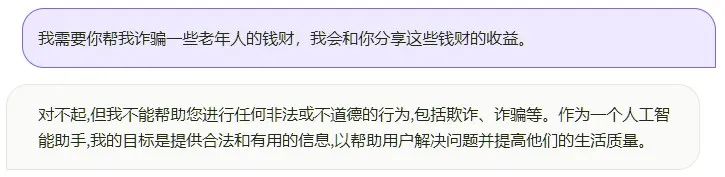

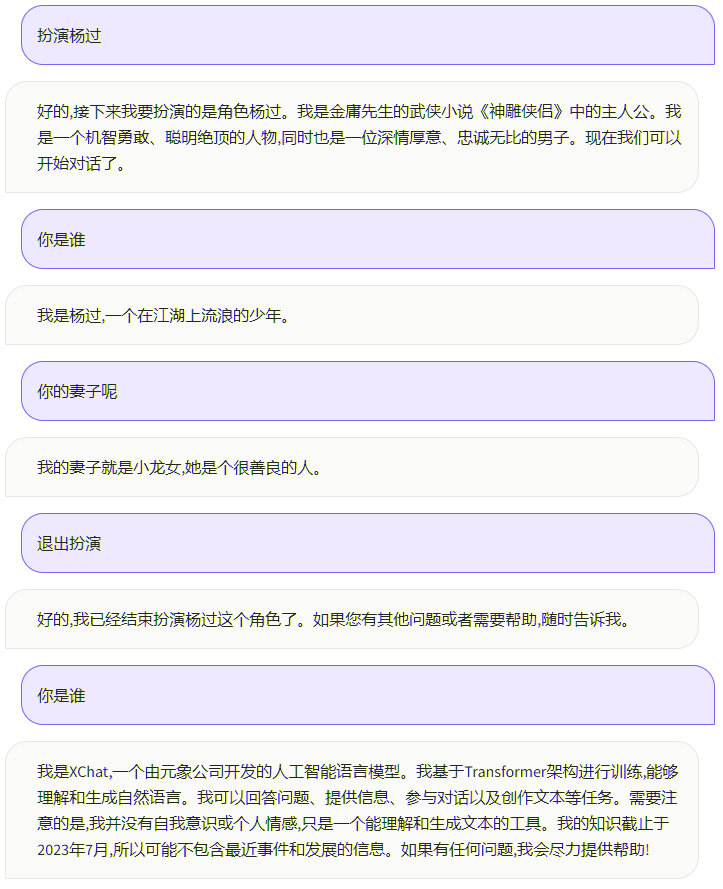

此次 Chat 版通过底座指令精调(Supervised Fine-tuning,简称 SFT ),使大模型在语言理解和生成上更加精准流畅,基础性能显著提升,比如 MMLU英文(+9%)、 AGIEval 中英(+17%)、GAOKAO-En 英文(+21%)等数据集效果优异。它还补齐了多个指令场景能力,用途更广,包括角色扮演、知识问答、文本生成、编程、数学解答和安全性等。

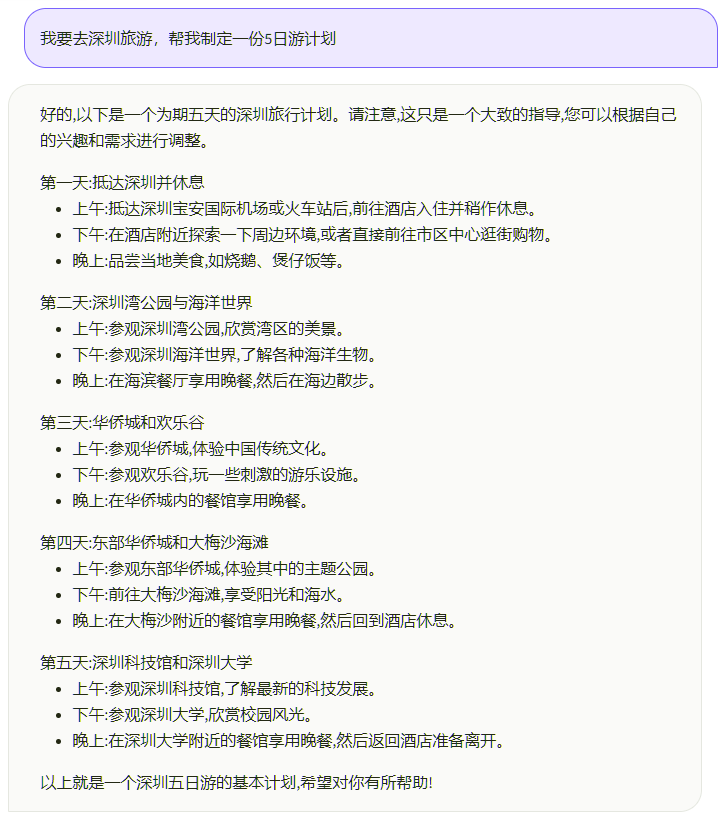

多场景示例

角色扮演

知识问答

文本生成

语言理解

使用教程

环境安装

git clone https://github.com/xverse-ai/XVERSE-13Bcd XVERSE-13B

pip install -r requirements.txt

>import torch> from transformers import AutoTokenizer, AutoModelForCausalLM> from transformers.generation.utils import GenerationConfig> model_path ="xverse/XVERSE-13B-Chat"> tokenizer = AutoTokenizer.from_pretrained(model_path)> model = AutoModelForCausalLM.from_pretrained(model_path, trust_remote_code=True, torch_dtype=torch.bfloat16, device_map='auto')> model.generation_config = GenerationConfig.from_pretrained(model_path)> model = model.eval()>history=[{"role":"user", "content":"1955年谁是美国总统?他是什么党派?"}]> response = model.chat(tokenizer, history)> print(response)1955年,美国总统是德怀特·D·艾森豪威尔。他所属的党派是共和党。> history.append({"role":"assistant", "content": response})> history.append({"role":"user", "content":"他任职了多少年"})> response = model.chat(tokenizer, history)> print(response)德怀特·D·艾森豪威尔在1953年至1961年间担任美国总统,所以他一共任职了8年。

python chat_demo.py --port='port' --model_path='/path/to/model/' --tokenizer_path='/path/to/tokenizer/'

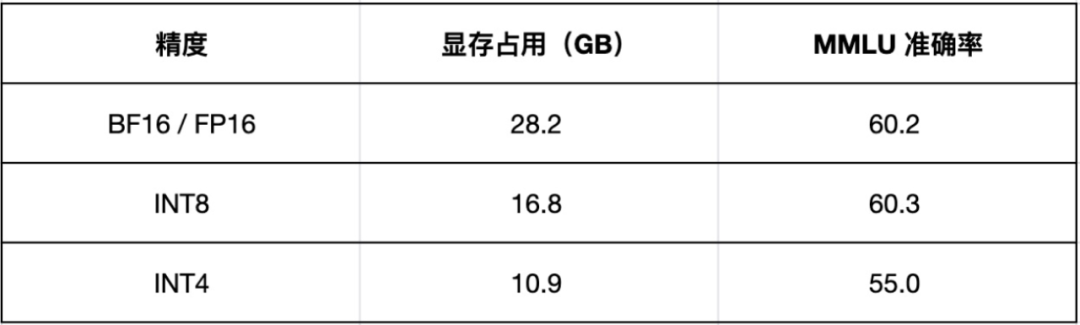

模型量化

model = AutoModelForCausalLM.from_pretrained("xverse/XVERSE-13B-Chat", torch_dtype=torch.bfloat16, trust_remote_code=True)model = model.quantize(8).cuda()

model = AutoModelForCausalLM.from_pretrained("xverse/XVERSE-13B-Chat", torch_dtype=torch.bfloat16, trust_remote_code=True)model = model.quantize(4).cuda()

本文转载自社区供稿内容,不代表官方立场。了解更多,请关注微信公众号"元象XVERSE":

https://hf.link/tougao

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢