Machine Intelligence Research

在三维场景感知领域,深度估计作为核心技术之一,为其他感知决策任务提供关键的环境结构信息。提高单目深度估计模型的准确率有助于实现更准确的三维环境感知,从而增强自动驾驶汽车、机器人导航等应用的安全性和可靠性。哈尔滨工业大学江俊君教授团队旨在解决监督单目深度估计的问题。首先,通过一个严谨细致的验证性实验,文章展示了长程关联对精确深度估计的不可或缺性。又因为Transformer和卷积分别擅长长程关联深度估计和局部关联深度估计,因此文章提出采用一种由Transformer分支和卷积分支双支并行的编码器结构。Transformer分支通过有效注意力机制对全局上下文进行建模,但因为Transformer在对这类内容进行建模时缺乏空间归纳偏置,故在这一过程中由卷积分支对局部特征进行提取。但是,独立的分支会导致不同特征之间缺乏交互。为了解决这一问题,文章设计了一个分层聚合和异构交互模块来加强Transformer特征以及以一种集合对集合的变换对异质特征进行建模。由于对高分辨率特征图进行全局注意力计算导致内存开销太大,文章采用可变形策略来降低复杂度。在KITTI, NYU和SUN RGB-D数据集上的大量实验表明,本文提出的DepthFormer模型以显著的优势超越了当前最先进的单目深度估计方法。通过深入的消融研究,文章对每个所提出模块的有效性进行了全面评估。

图片来自Springer

全文下载:

DepthFormer: Exploiting Long-range Correlation and Local Information for Accurate Monocular Depth Estimation

Zhenyu Li, Zehui Chen, Xianming Liu, Junjun Jiang

https://link.springer.com/article/10.1007/s11633-023-1458-0

https://www.mi-research.net/en/article/doi/10.1007/s11633-023-1458-0

单目深度估计在三维重建和感知中起着至关重要的作用。在深度估计领域,编码器-解码器的结构至关重要,而自《用于图像识别的深度残差学习》中富有开创性的应用以来,卷积神经网络(CNN)就一直在深度估计领域中被用作主流方法。尽管有关解码器设计的研究数量众多,但最近研究表明,编码器对于精确深度估计更为关键。由于缺乏深度线索,充分利用长程关联(比如不同对象间的距离关系)和局部信息(如同一对象的一致性)是一个有效编码器的关键能力。因此,当前深度估计方法的潜在瓶颈可能在于编码器中有限感受野的卷积算子几乎无法长程关联进行建模。

为了克服上述局限,研究者们在CNN上进行了了大量努力,大致可分为两类:操作卷积算子和融合注意力机制。前者应用了包括多尺度融合、空洞卷积和特征金字塔在内的高级变体来提高卷积算子的效率。后者引入注意力模块来对特征图中所有像素进行全局交互建模。也有一些尝试将两种策略结合起来的通用方法尝试。尽管这些方法取得了显著的改进,但仍然面临相同的困境。

作为CNN的替代物,在图像识别领域取得了巨大成功的Vision Transformer(ViT)展示了作为深度估计编码器的优势。得益于注意力机制,Transformer更擅长全局感受野长程关联建模。但是本文的验证性实验显示,ViT 编码器由于在对局部信息进行建模时缺乏空间归纳前置,表现并不是很令人满意,从而导致在近程深度估计中的表现也不佳。相较之下,带有卷积编码器的模型对于局部信息能够进行更好的深度预测。虽然目前有些工作考虑将两种分支结合在一起,但这些研究主要关注的还是图像分类等任务。对于深度估计领域,将两者结合在一起的深入研究探讨还是相当缺乏的。

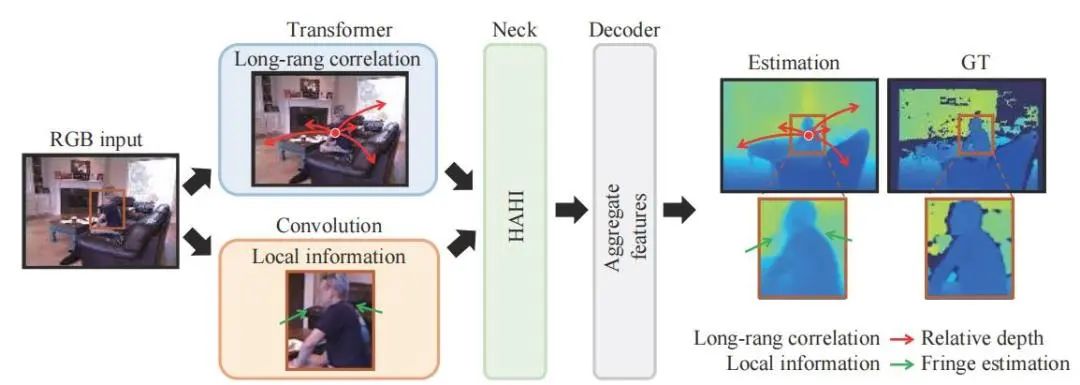

因此,本文提出了一个通过结合Transformer和CNN两者优势来提升深度估算表现的新颖单目深度估计框架,DepthFormer(如图1所示)。DepthFormer的原理在于Transformer分支可以进行长程关联建模而卷积分支可以保持图像的局部信息。本文认为,并行架构的融合有助于实现更准确的深度估计,而进行简单后融合的独立分支会导致解码器的特征聚合不足。

为了改善这一问题,本文设计了层次聚合与异构交互(HAHI)模块来将两个分支各自的优势结合在一起。具体而言,一方面,自注意力模块通过按元素对特征进行交叉运算来加强Transformer分支中不同层次间的特征;另一方面,交叉注意模块将异构特征(即Transformer特征和CNN特征)间的相互关系以集合对集合的变换方式进行建模。因为对高分辨率特征图的全局注意需要的内存开销很大,故本文提出以一种可学习的方式,即采用只关注有限关键样本向量集的可变形方案来缓解这一问题。

本文主要贡献有三:1)设计了一种同时使用长程关联和局部信息的解码器并行结构。2)设计了HAHI来按元素对特征进行交叉运算的方法以加强特征表达能力,同时通过集合对集合的变换方式对相关关系进行建模。3)本文提出的解决方案DepthFormer在KITTI、NYU和SUN RGB-D 数据集上显著优于其他现有模型。而且,DepthFormer在具有竞争力的KITTI深度估计基准上拥有具有竞争力的表现。

图1 概览:本文设计了一个由Transformer分支和卷积分支并行的编码器结构,其中Transformer负责学习长程关联,而卷积分支负责提取局部信息。为了增加两个分之间的联系,本文还提出用HAHI模块来加强特征与对密切关系进行建模。

全文下载:

DepthFormer: Exploiting Long-range Correlation and Local Information for Accurate Monocular Depth Estimation

Zhenyu Li, Zehui Chen, Xianming Liu, Junjun Jiang

https://link.springer.com/article/10.1007/s11633-023-1458-0

https://www.mi-research.net/en/article/doi/10.1007/s11633-023-1458-0

BibTex:

@Article{MIR-2023-03-030,

author={Zhenyu Li and Zehui Chen and Xianming Liu and Junjun Jiang},

journal={Machine Intelligence Research},

title={DepthFormer: Exploiting Long-range Correlation and Local Information for Accurate Monocular Depth Estimation},

year = {2023},

volume = {20},

number = {6},

pages = {837-854},

doi = {10.1007/s11633-023-1458-0}

}

李震宇

陈泽徽

刘贤明

江俊君

MIR为所有读者提供免费寄送纸刊服务,如您对本篇文章感兴趣,请点击下方链接填写收件地址,编辑部将尽快为您免费寄送纸版全文!

说明:如遇特殊原因无法寄达的,将推迟邮寄时间,咨询电话010-82544737

收件信息登记:

https://www.wjx.cn/vm/eIyIAAI.aspx#

关于Machine Intelligence Research

Machine Intelligence Research(简称MIR,原刊名International Journal of Automation and Computing)由中国科学院自动化研究所主办,于2022年正式出版。MIR立足国内、面向全球,着眼于服务国家战略需求,刊发机器智能领域最新原创研究性论文、综述、评论等,全面报道国际机器智能领域的基础理论和前沿创新研究成果,促进国际学术交流与学科发展,服务国家人工智能科技进步。期刊入选"中国科技期刊卓越行动计划",已被ESCI、EI、Scopus、中国科技核心期刊、CSCD等数据库收录。

点击"阅读原文"免费下载全文

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢