新智元报道

新智元报道

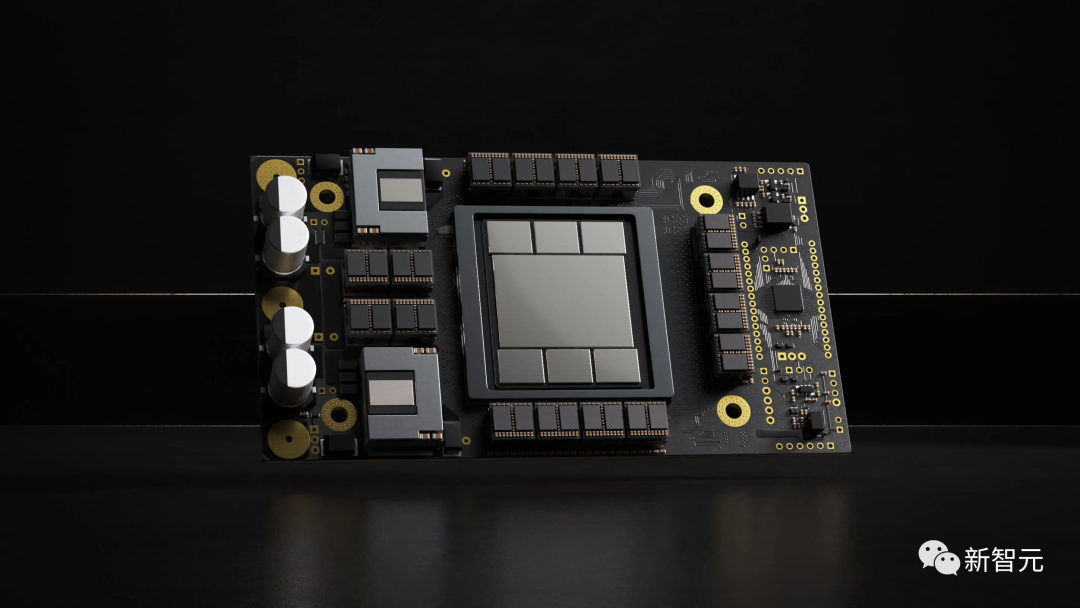

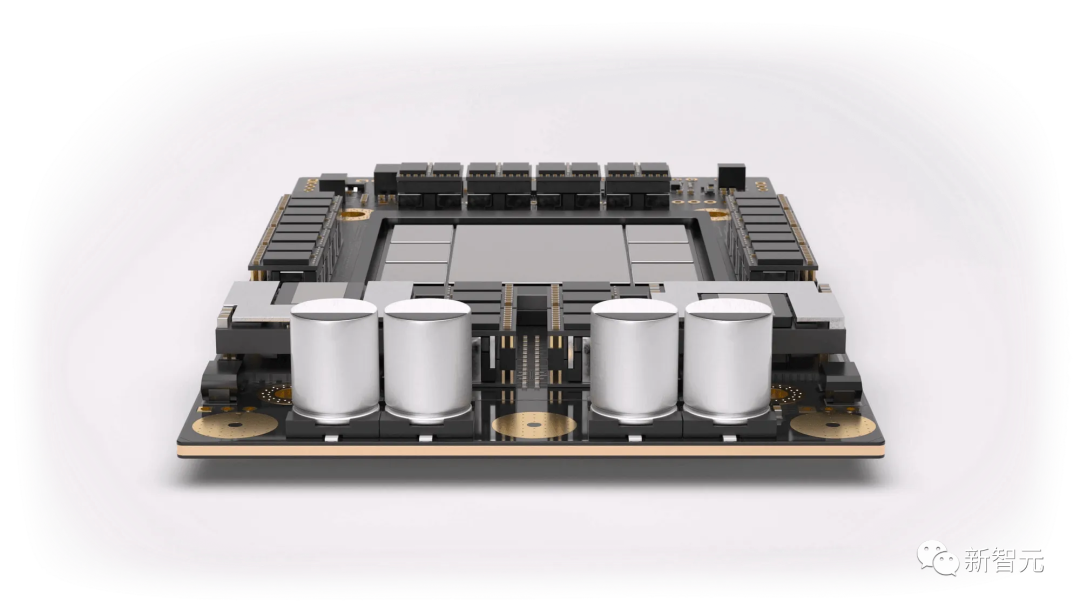

【新智元导读】最近,两位哈佛辍学生共同创立的AI芯片公司,估值已达3400万美元,并计划明年交付一款名为「Sohu」的AI推理加速芯片——其LLM推理性能达到H100的10倍,而单价吞吐量更是高达140倍。

像Pika一样的神级创业故事又要再次上演了?

两位哈佛退学的年轻人,想要制造一款专用于大语言模型加速的AI加速器芯片,将于2024年第三季度交付,推理性能达H100的10倍。

在今年6月份,两位创始人Gavin Uberti和Chris Zhu创立了Etched.ai,获得了包括Ebay前CEO Devin Wenig在内一众风投机构的536万美元的种子轮投资。

公司估值更是高达3400万美元!

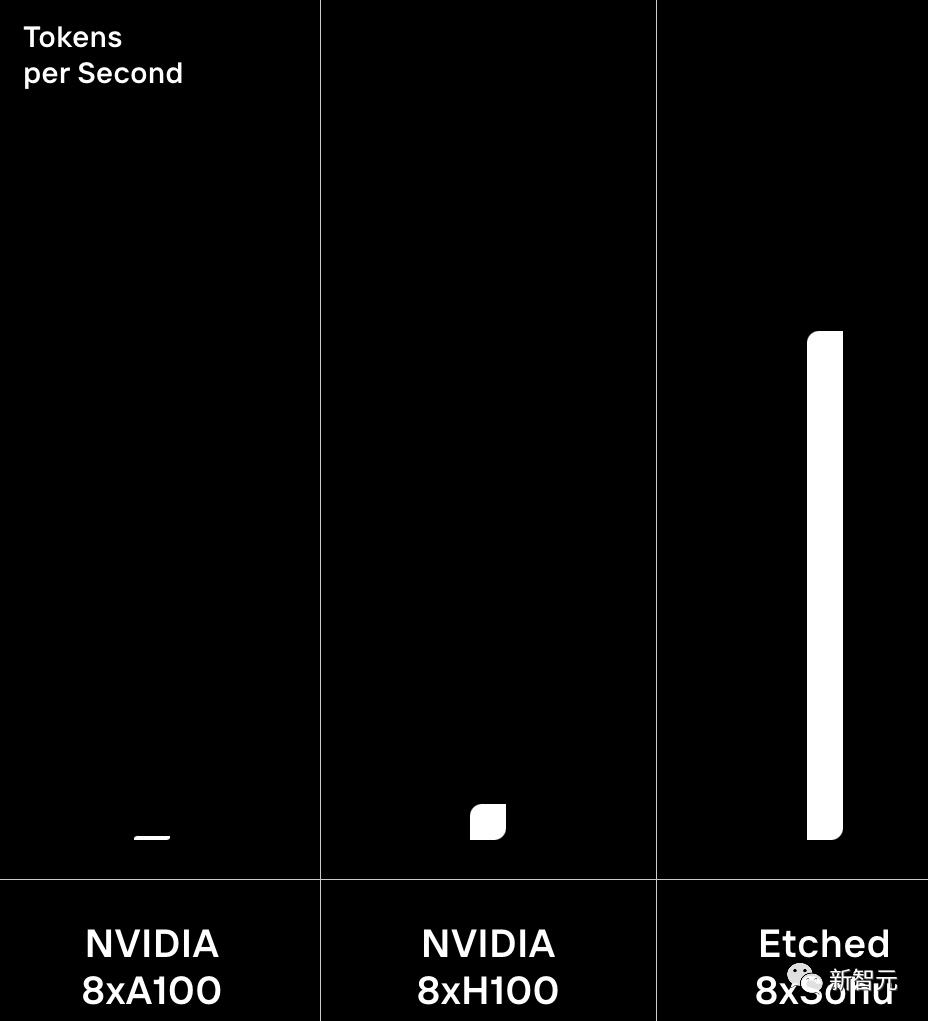

根据公司官网上放出的数据,这款芯片将在硬件层面上集成Transformer构架,将推理速度相比于英伟达H100提升了8-10倍!

他们将第一款LLM加速芯片命名为「Sohu」,号称可以在毫秒级别的时间里处理数千个单词。

两个哈佛辍学本科生挑战芯片行业最顶尖业务

两人原本计划从哈佛休学一年,在一家芯片公司找到了一份负责ApacheTVM开源编译器和微内核的工作。 但在工作中,他们发现Arm的指令集中的一些低效设计使得他们的工作效率很差。 当他们思考如何系统性地解决这个问题时,发现可以利用这个思路来设计一款针对当下爆火的AI加速芯片。 在创始人之一的Uberti看来,通用设计无法获得他们正在研发的专有加速芯片所能带来的那种性能提升: 「必须在单一架构上下大力气,让芯片处理AI任务,目标太大了,必须要针对更具体的任务来设计芯片......我们认为英伟达最终会这么做。」

在他们两人看来,这个市场机会太大了,一定不能错过。 「如果你回顾四年前的GPT-2,与Meta最近的 Llama模型相比,只有两个区别——大小和激活函数。训练方式存在差异,但这对于推理来说并不重要。」 Transformer的基本组件是固定的,虽然存在细微差别,但他们并不担心短期之内就会出现新的构架代替Transformer。 所以他们决定做一个Transformer构架的专用集成电路(ASIC),在未来和英伟达等一系列芯片巨头在大模型推理市场中竞争。 他们认为,Etched.ai推出的第一款芯片,相比于H100,单位价格内将获得140倍的吞吐量性能! 二到底是什么样的背景,能让两个本科还没有毕业的学生,敢于挑战芯片业目前最炙手可热的赛道呢?

创始人兼公司CEO Gavin Uberti自从2020进入哈佛之后,就一直在校外兼职,在2022年底,成立了Etched.ai。

在进入大学之前,他参与了美国最著名的青少年科技创新大赛FIRST Tech Challenge,团队获得了Top 10奖项。团队开发的自动驾驶软件排在600个参赛团队第二名。

另一位创始人Chris Zhu,也是在哈佛就读时就在校外疯狂实习,甚至还没有从哈佛毕业,就已经成为兼职教员。

AMD MI300X决战NVIDIA H100

AMD MI300X决战NVIDIA H100

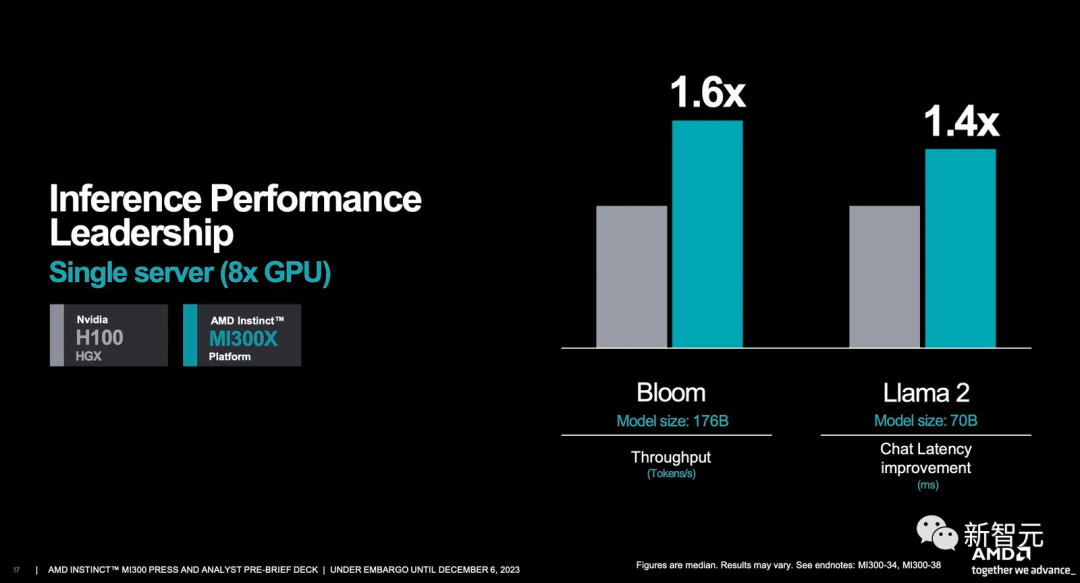

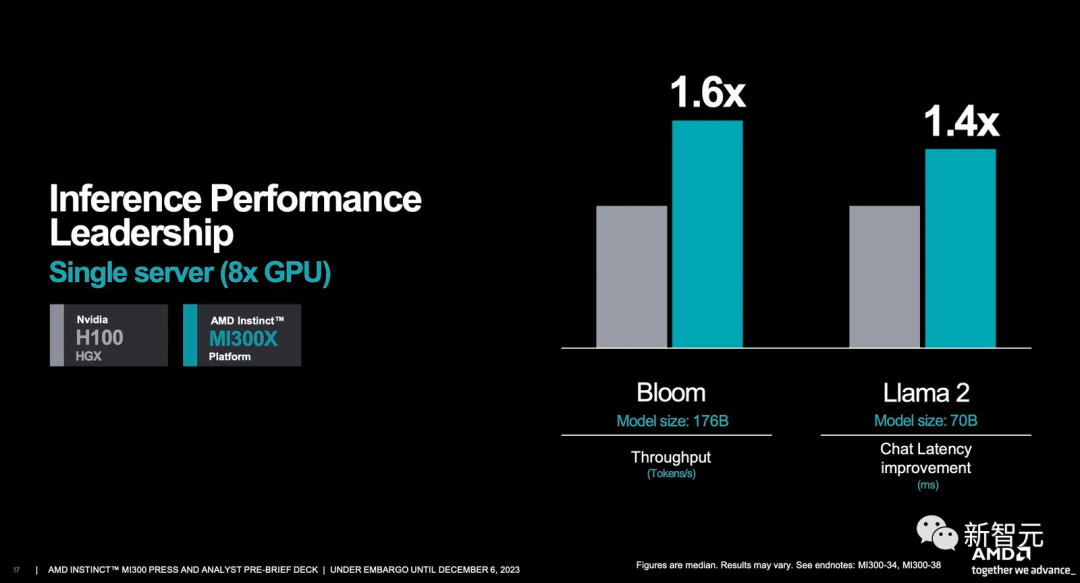

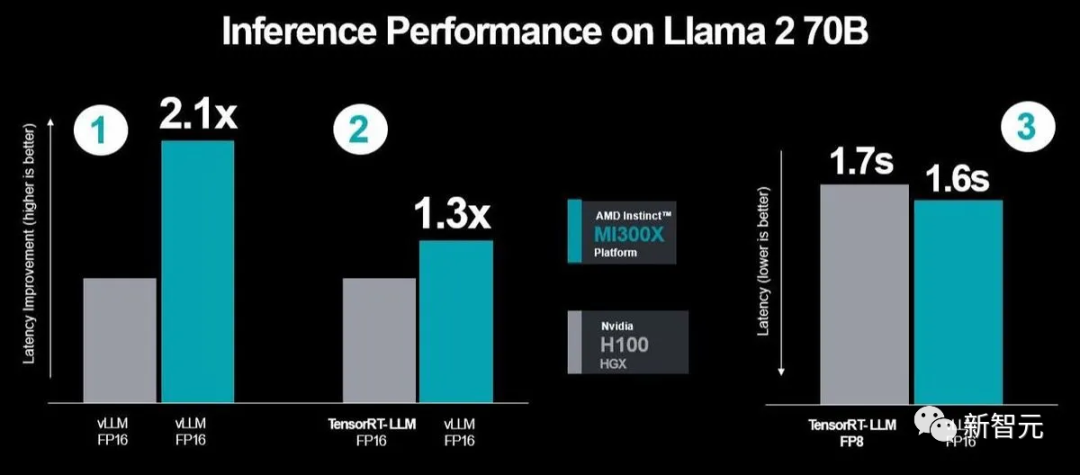

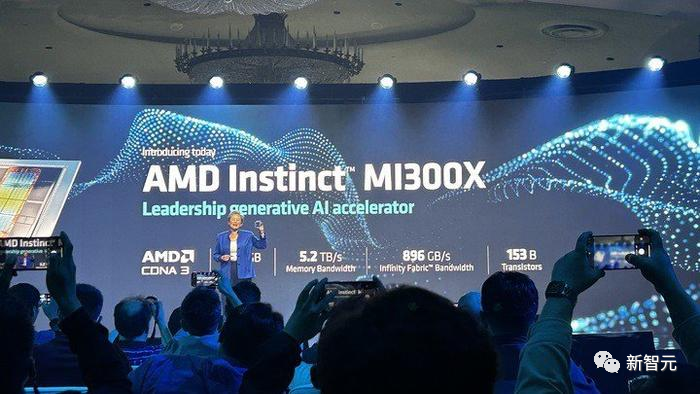

而英伟达和AMD这边,最近打得更是热火朝天,甚至连官方都直接下场写博客硬刚。 就在前段时间,AMD高调发布了自家最强的AI芯片MI300X。 PPT显示,由8块MI300X组成的服务器在大模型推理方面的表现,要比同样规模的H100速度最高提升1.6倍之多。 对于AMD来说,这种直接对标,实属罕见。

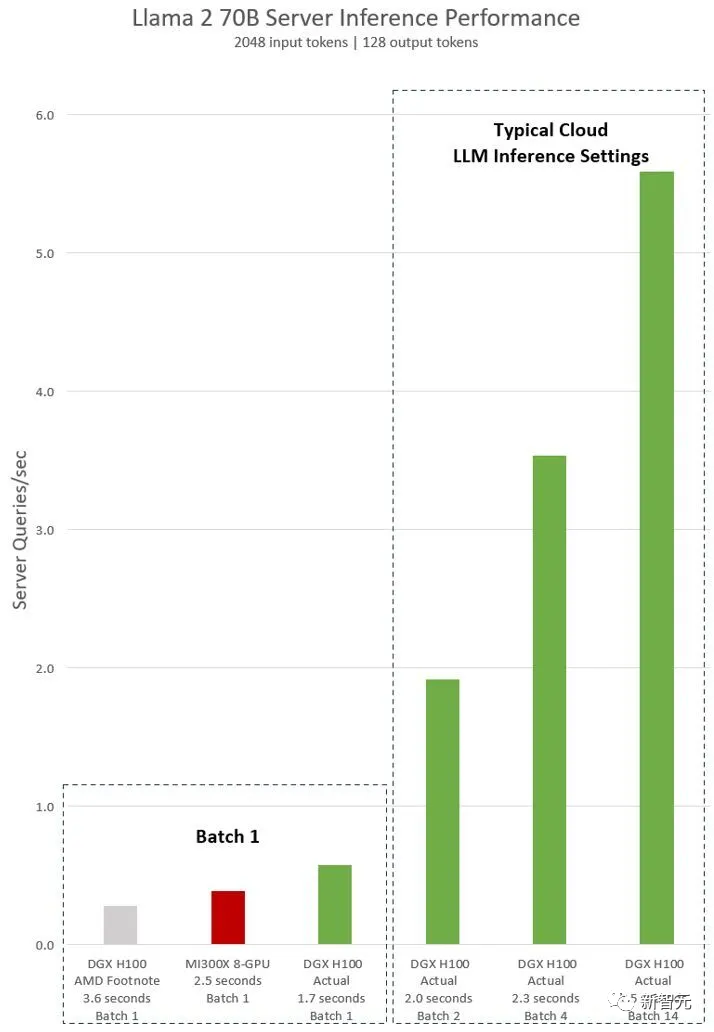

对此,英伟达很快就发表了一篇博客文章,驳斥AMD的评测不客观。 英伟达表示,如果H100 GPU使用了优化过的软件进行正确的基准测试,它的性能将大大超过MI300X。 作为回应,英伟达展示了采用TensorRT-LLM优化设置后,两款GPU在Llama 2 70B上的比较结果。

AMD毫不示弱

GPU大战进入白热化

在人工智能加速器领域,一些公司拥有针对特定工作负载的专门架构。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢