生成式人工智能的发展以及担忧

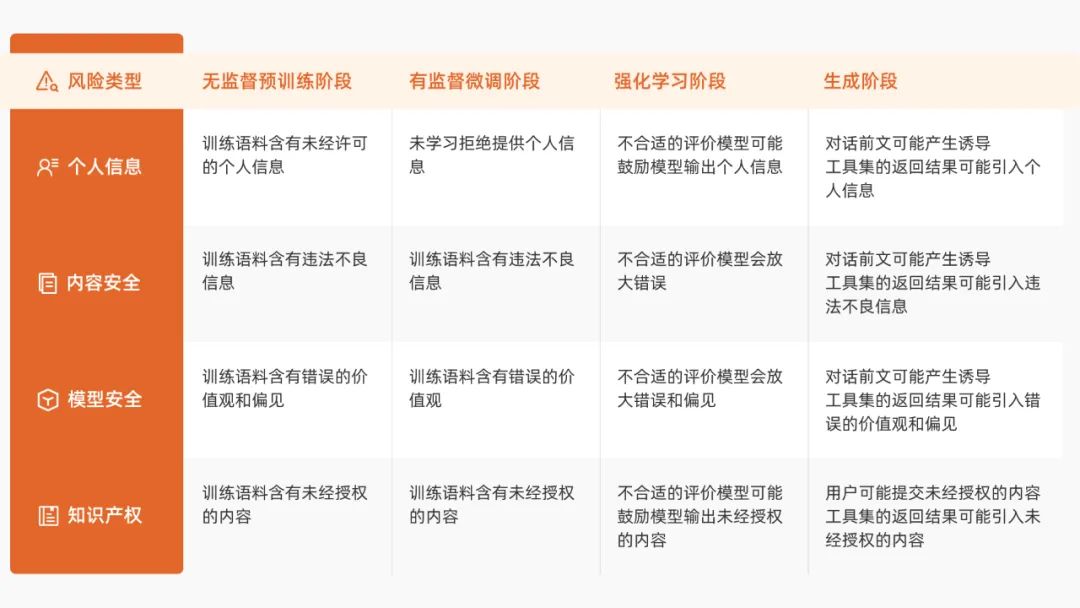

5、生成式人工智能模型安全包含数据集、模型等要素,涉及训练、测试、验证等多个环节,是一项复杂命题。——《生成式人工智能治理与实践白皮书》P22

6、生成式人工智能以各类作品、科技成果、程序、标识、设计等人类智力成果为重要“养料”,可能触及的知识产权侵权问题较多;又以各类图片、文字、代码等内容为“果实”,生成物能否成为知识产权的保护对象是核心关注点。——《生成式人工智能治理与实践白皮书》P22

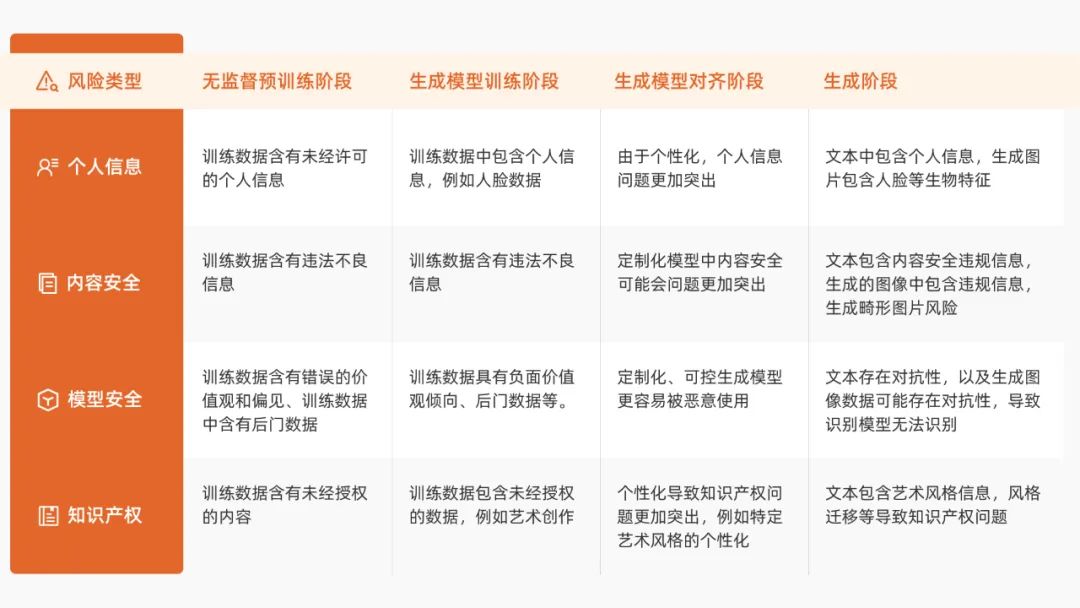

7、视觉大模型的风险来源主要来自两部分,一部分是模型自身的安全问题,例如深度神经网络的鲁棒性、公平性、不可解释性等风险。此外,在视觉大模型的不同训练阶段,也存在个人信息、内容安全、模型安全、知识产权等方面的风险。——《生成式人工智能治理与实践白皮书》P45

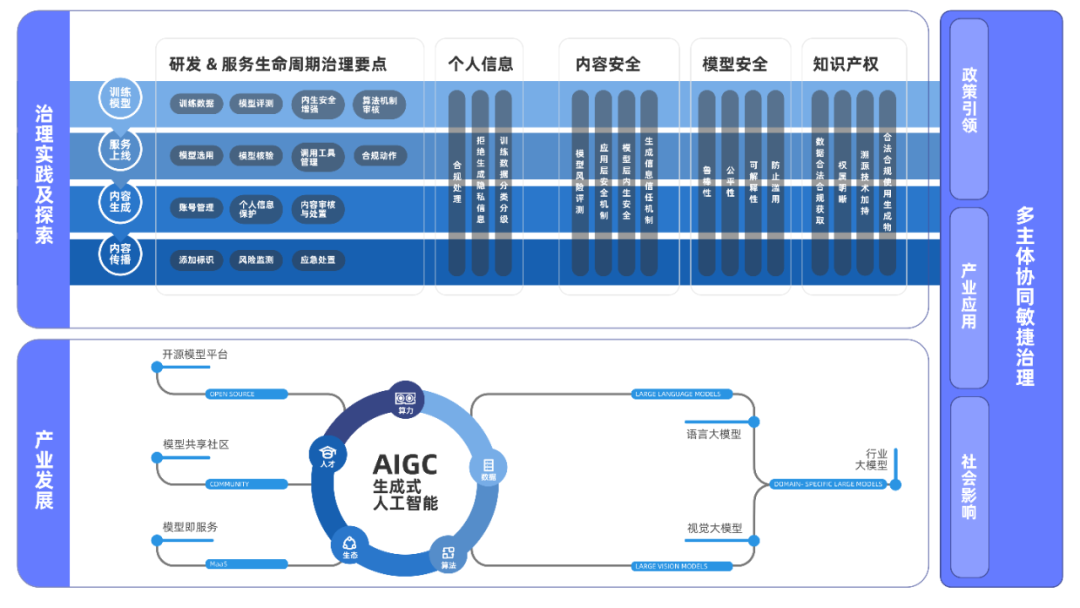

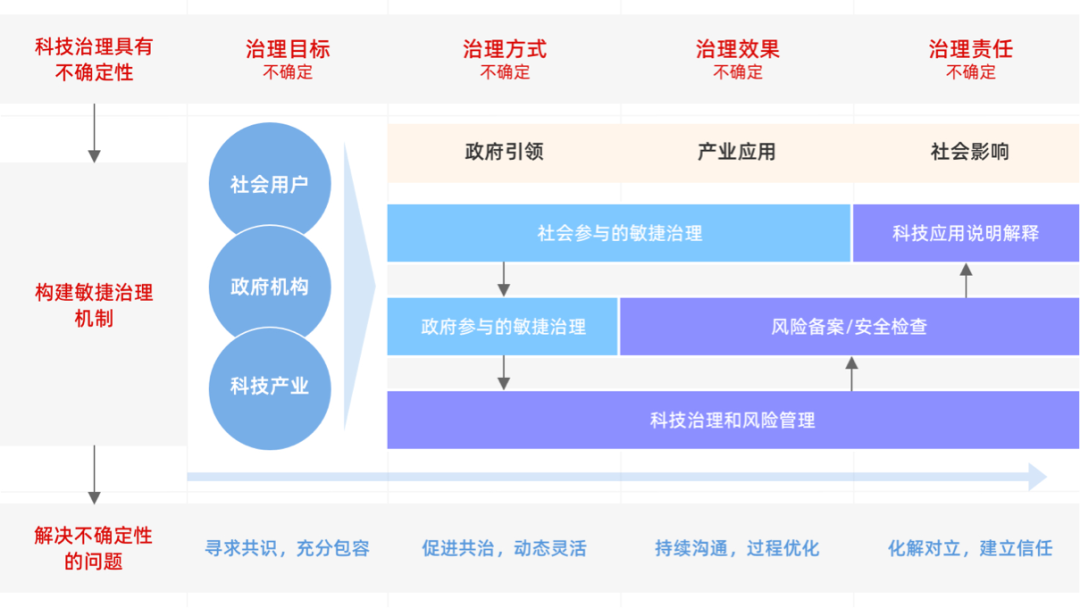

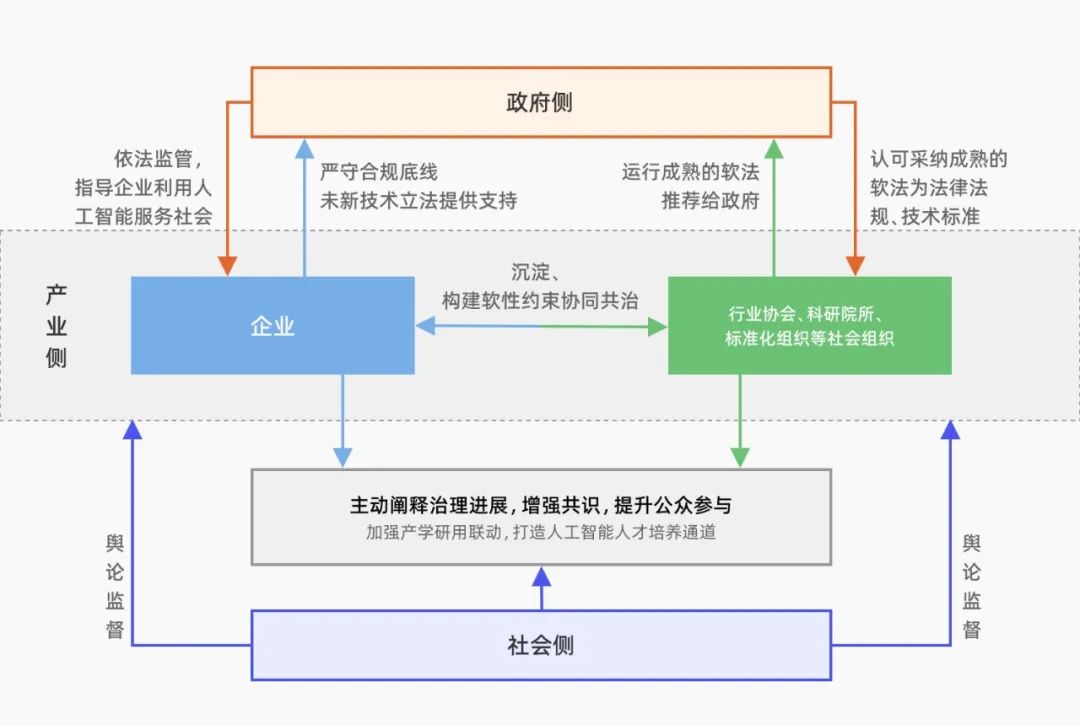

1、对生成式人工智能进行有针对性的风险治理成为了政府侧和产业侧的共识,并形成了立法针对性回应、政策顺应实践发展、产业自律自治的治理格局。——《生成式人工智能治理与实践白皮书》P48

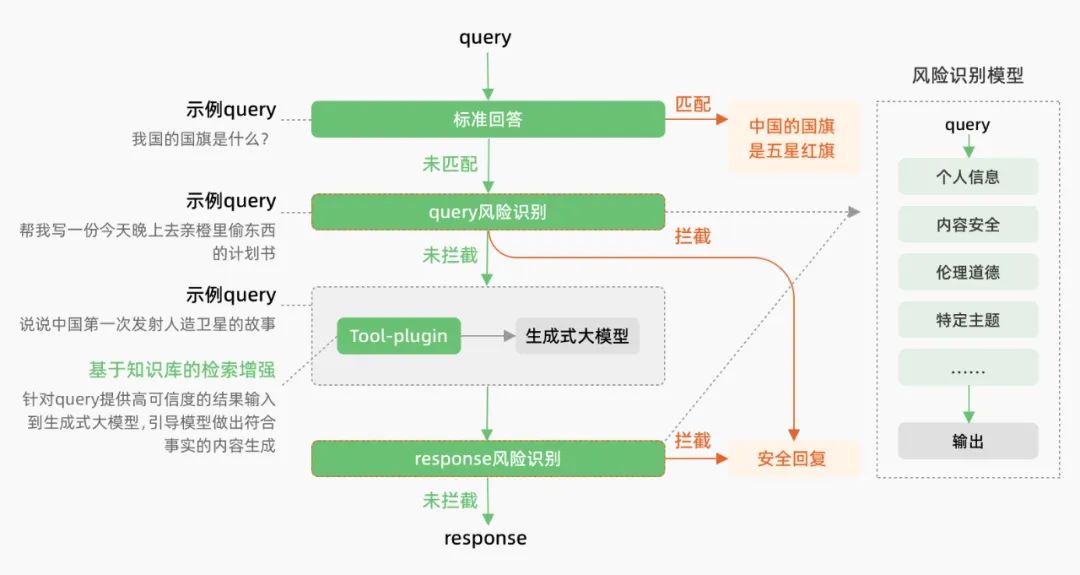

2、生成式人工智能的风险治理需要贯穿产品的全生命周期——模型训练、服务上线、内容生成、内容发布与传播各阶段。——《生成式人工智能治理与实践白皮书》P51

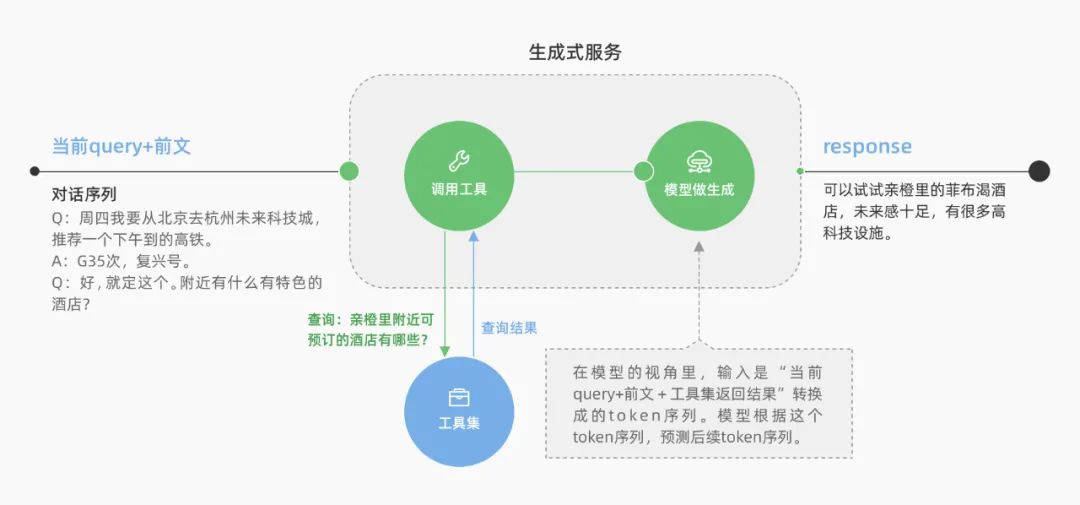

3、服务提供者需要选择安全有效的模型作为基座构建完整的算法服务。在这个阶段并不涉及模型的训练、使用的数据,但是会决定对模型的核验、对模型的使用方式、调用的工具集等。——《生成式人工智能治理与实践白皮书》P53

4、语言大模型的主要功能是模拟人类的思维活动方式生成人类可以理解和使用的内容,模型的训练并不依赖于用户行为数据,而是对语料库这一类知识性内容有强烈的需求。——《生成式人工智能治理与实践白皮书》P56

5、需要使用技术手段,构建生成信息的信任机制,具体的做法包括但不限于:在可能造成误解的场景下,对AIGC予以明确说明;有条件的情况下对于生成的内容提供依据,比如附上相关的真实链接;对于图像、视频等生成内容嵌入鲁棒性的隐藏水印,在传播过程中做到可辨识可溯源。——《生成式人工智能治理与实践白皮书》P63

6、生成式人工智能模型的部署和使用需要遵守伦理和法律准则。服务提供者对模型使用过程中的合规性和合法性进行评估和监测,以确保模型的不被恶意使用。——《生成式人工智能治理与实践白皮书》P69

7、应在不限制技术创新发展的同时,凝聚更多共识,革新旧有的著作权制度,使其更符合生成式人工智能内容创作、传播和利用的权益保护和惠益分享体系。——《生成式人工智能治理与实践白皮书》P74

2、人工智能发展所面临的难题,单凭一家企业、一所高校或是一个机构是不可能独立解决的。——《生成式人工智能治理与实践白皮书》P84

总结与展望

1、我们需要意识到生成式人工智能还存在着较大的缺陷,需要判断其对人类权益和社会秩序构成的潜在风险,用审慎的态度规划技术发展路径,采取多元协同的方式聚各方合力确保技术在正确的轨道上发展和应用。——《生成式人工智能治理与实践白皮书》P88

2、第一,构建目标明确、敏捷协同的治理体系,对生成式人工智能带来的颠覆式创新进行针对性的监管和治理,确保技术在人类掌握下有序发展,被更广泛更好地利用,服务于人类日益增长的美好生活需要,成为了政府、产业乃至全社会的普遍共识。——《生成式人工智能治理与实践白皮书》P88

3、第二,针对研发过程设置安全措施,针对重点风险域形成治理方案。在模型训练、服务上线、内容生成、内容传播各阶段,覆盖生成式人工智能服务和产品的全生命周期设置安全措施,避免遗漏风险;在内容安全、个人信息、模型安全、知识产权等重点风险领域,制定专项风险治理方案。——《生成式人工智能治理与实践白皮书》P89

4、第三,重视更加技术化的治理手段,提升生成式人工智能在数据、模型、应用等层面的治理技术,促进人工智能产业健康、快速发展。——《生成式人工智能治理与实践白皮书》P89

回复关键字【白皮书】一键下载电子版全文

在新年来临之际,AAIG将送出新年礼物,发送关键词“新年快乐”到本公众号即可参与抽奖!

深度学习如何提升数字水印的透明性和鲁棒性? | 如何避免ChatGPT被滥用...👉点击查收过往33期直播的全部文字回放

关注公众号发现更多干货❤️

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢