【全球AI战略洞察】栏目由清华大学人工智能国际治理研究院推出,旨在通过对当前人工智能领域发生的重要信息进行“标注、提炼、解读”,剖析全球AI治理各国家间不同的战略图景,以此描绘人工智能治理领域的国际格局。

栏目主理人:刘典

复旦大学中国研究院副研究员、清华大学人工智能国际治理研究院战略与宏观研究项目主任

2023年12月21日,联合国人工智能咨询机构就《以人为本的人工智能治理》(Governing AI for Humanity)征求公众意见,公开征询意见截止时间为2024年3月31日。该报告强调了人工智能全球治理的多个方面,其中重点关注三大方面:人工智能的机遇和推动因素、面临的风险和挑战以及解决全球治理赤字需要明确的原则以及适应当前形势的机构职能安排。

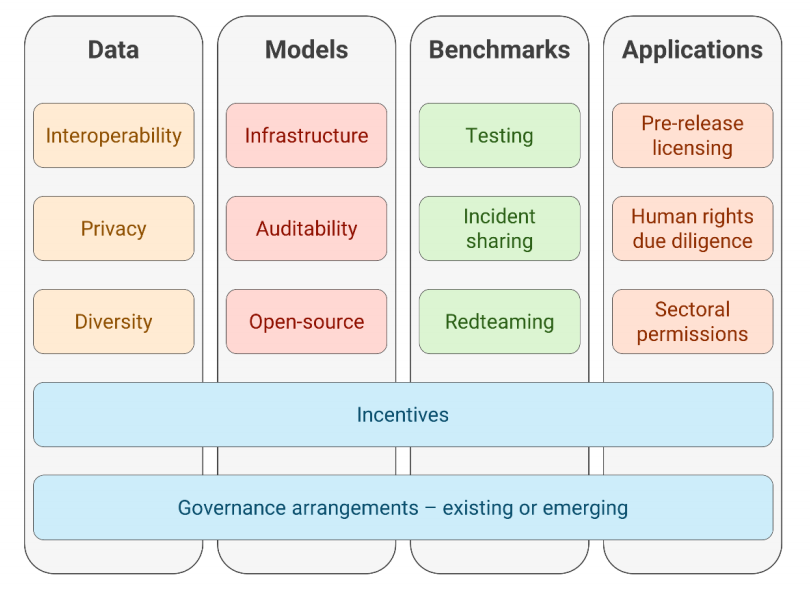

图1 考虑不同AI治理工作间的互操作性的三重简化模式图1 考虑不同AI治理工作间的互操作性的三重简化模式(中文翻译)①通过数据保护和交换框架促进模型构建生态系统,实现AI开发的更具包容性和可持续性。②制定共同的数据标准和测试标准,促进AI初创企业在更多国家和地区进行测试和部署。③促进各利益相关方和成员国之间计算资源的平等获取和隐私保护数据共享的机制,以实现更公平的AI发展。④通过国际合作,促进AI人才的培养和交流,推动AI在科学研究和可持续发展目标方面的应用。⑤鼓励政府和私营部门投资其他核心基础设施,以推动全球AI的发展。

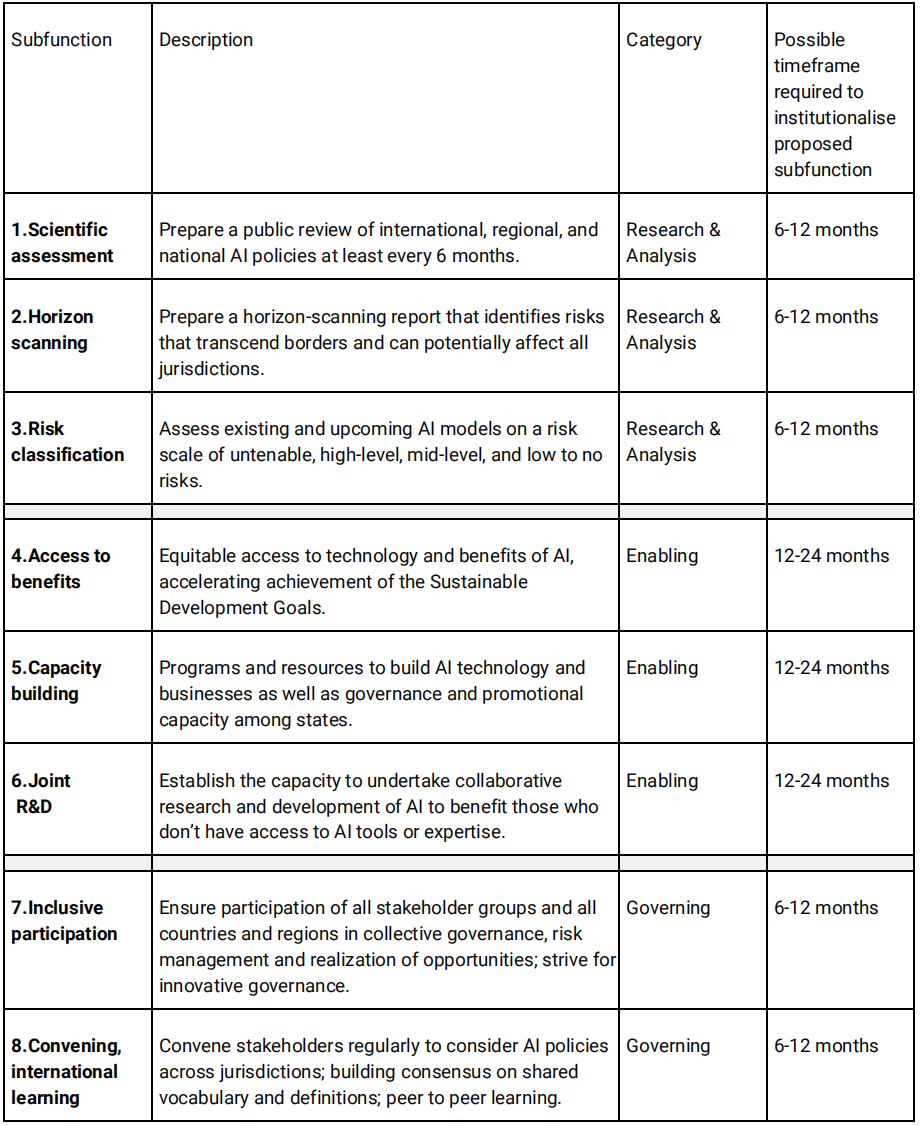

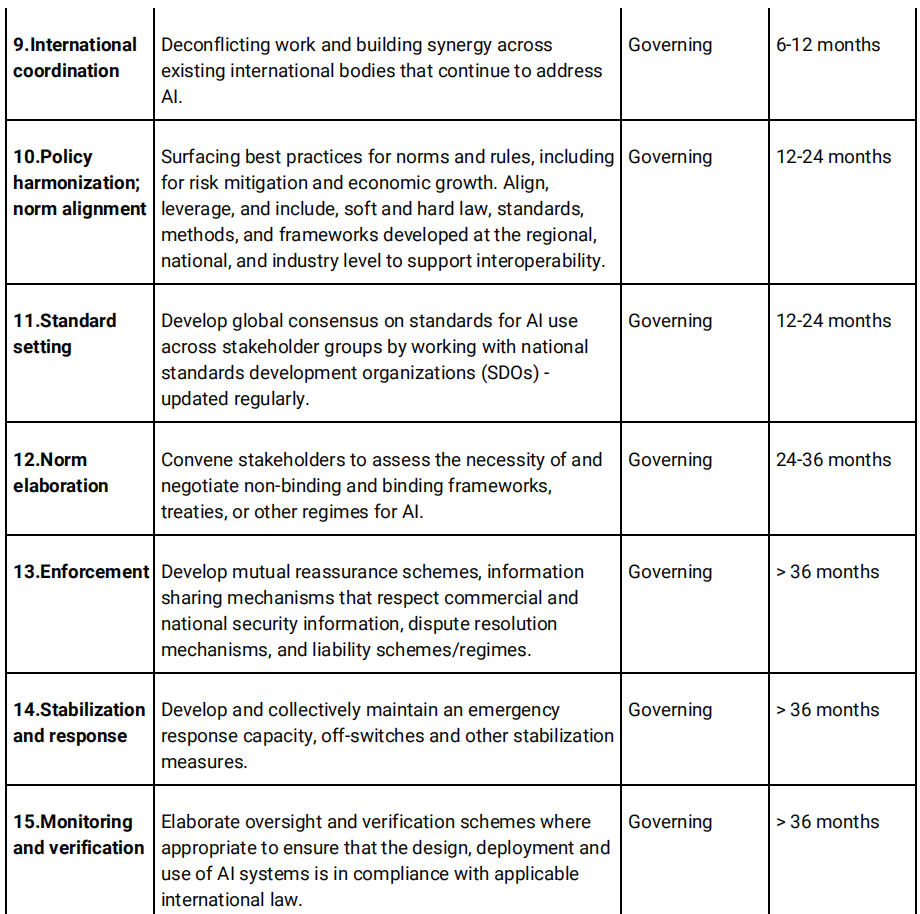

| | | | |

| | 至少每6个月准备一份关于国际、区域和国家人工智能政策的公开审查。 | | |

| | 准备一份前瞻性评估报告,以识别跨国界、可能影响所有司法辖区的风险。 | | |

| | 对现有以及即将推出的人工智能模型进行风险评估,根据“不可继续——高风险——中风险——低风险——无风险”进行风险等级划分。 | | |

| | 确保获取人工智能技术及其福祉的机会平等,加速实现可持续发展目标。 | | |

| | 推出计划、部署资源,以开发人工智能技术和业务,并加强各国之间的治理和推广能力。 | | |

| | 促进人工智能的联合研究和开发,以使无法获得人工智能工具或相关专业知识的人受益。 | | |

| | 确保所有利益相关方群体、所有国家和地区参与集体治理、风险管理和发掘机遇;努力实现创新治理。 | | |

| | 定期召集利益相关方,考虑制定跨区域的人工智能政策;基于共识建立共享词汇和定义;实现点对点学习。 | | |

| | 解决现有国际机构在继续解决人工智能问题方面的工作冲突,并建立协同作用。 | | |

| | 呈现规范和规则的最佳实践,包括风险缓解和经济增长。通过对接、利用、包含在区域、国家和行业层面制定的软法和硬法、标准、方法和框架,支持互操作性。 | | |

| | 通过与国家标准制定组织(SDOs)合作,制定全球范围内利益相关方群体对人工智能使用的标准,定期更新。 | | |

| | 召集利益相关方,评估制定与人工智能相关的非约束性和约束性框架、条约或其他体系的必要性。 | | |

| | 制定相互信任计划、尊重商业和国家安全信息的信息共享机制、争端解决机制和责任方案/体系。 | | |

| | 制定并共同维护紧急响应方案、“关闭开关”等维稳措施。 | | |

| | 制定监督和验证方案,以确保人工智能系统的设计、部署和使用符合适用的国际法。 | | |

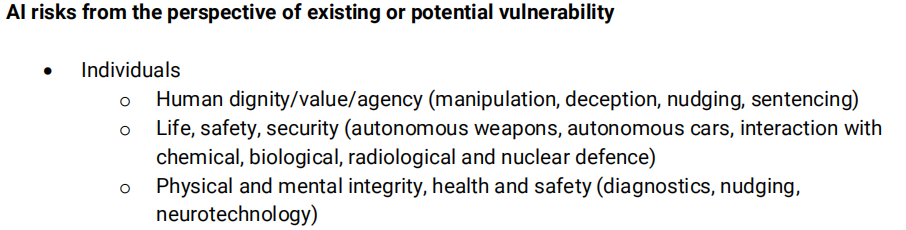

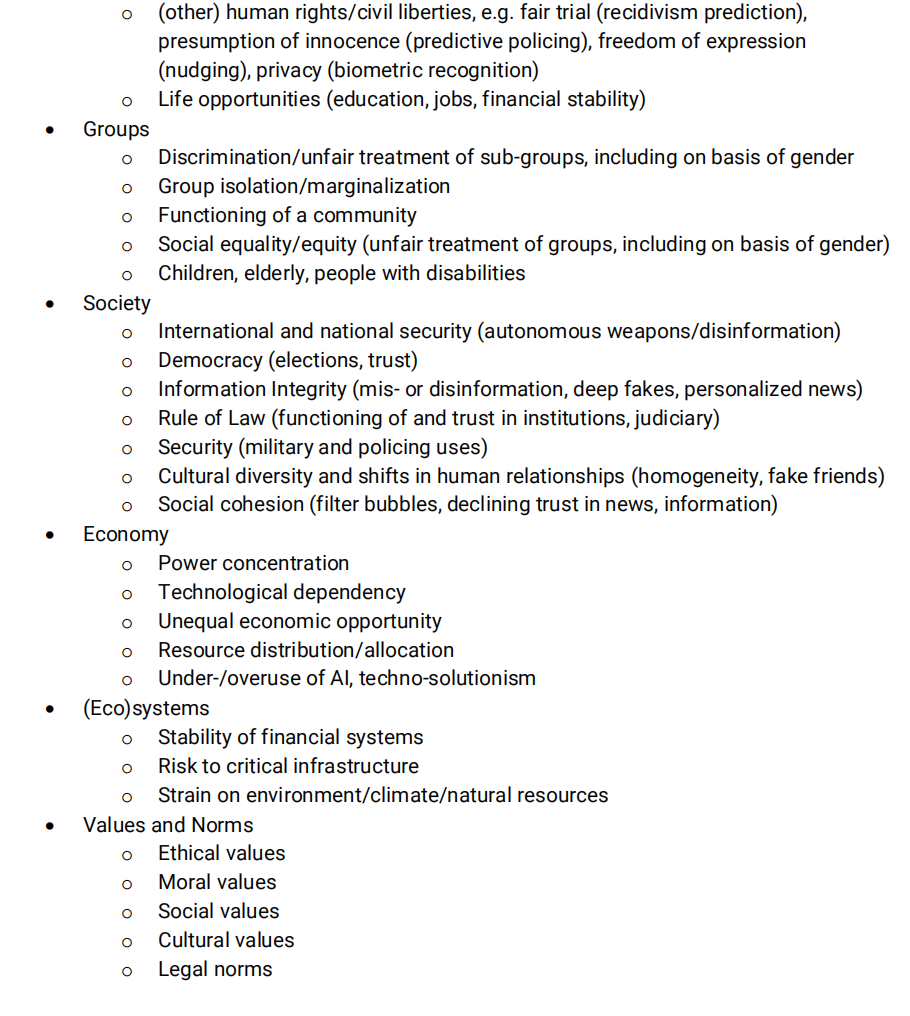

①需要达成共识,识别、分类和解决AI风险,平衡AI的利益和风险,确保AI的发展符合人类的利益。②AI的发展可能会导致一些社会问题,如就业和隐私问题,需要制定相应的政策和规定。③AI的发展可能会导致一些国家和地区的数字鸿沟,需要采取措施促进全球AI的平等发展。●个人尊严/价值/行为能力(操纵、欺骗、劝导、判刑)●生命、安全、安全(自主武器、自动驾驶汽车、AI与化学、生物、放射和核防御的关联)●(其他)人权/公民自由,例如公平审判(累犯预测)、推定无罪(预测性执法)、言论自由(引导)、隐私(生物识别识别)●社会平等/公正(对部分群体的不公平对待,包括对不同性别的不公平对待)●信息完整性(错误或虚假信息、深度伪造、个性化新闻)●对人工智能的过度/不足使用、技术解决方案主义(techno-solutionism)●包容性:所有的一切都应该以包容的方式,按照所有指导原则进行管理,并为所有指导原则的利益服务●数据治理的中心地位:人工智能治理应与数据治理并驾齐驱,推进数据公域指导原则●普遍性、网络化和多利益攸关方:人工智能必须是通用的、网络化的,并植根于自适应多利益相关者协作指导原则●国际法:AI治理应以《联合国宪章》《国际人权法》以及可持续发展目标等国际承诺为基础⑤数据、计算和人才方面的国际合作,以解决可持续发展目标

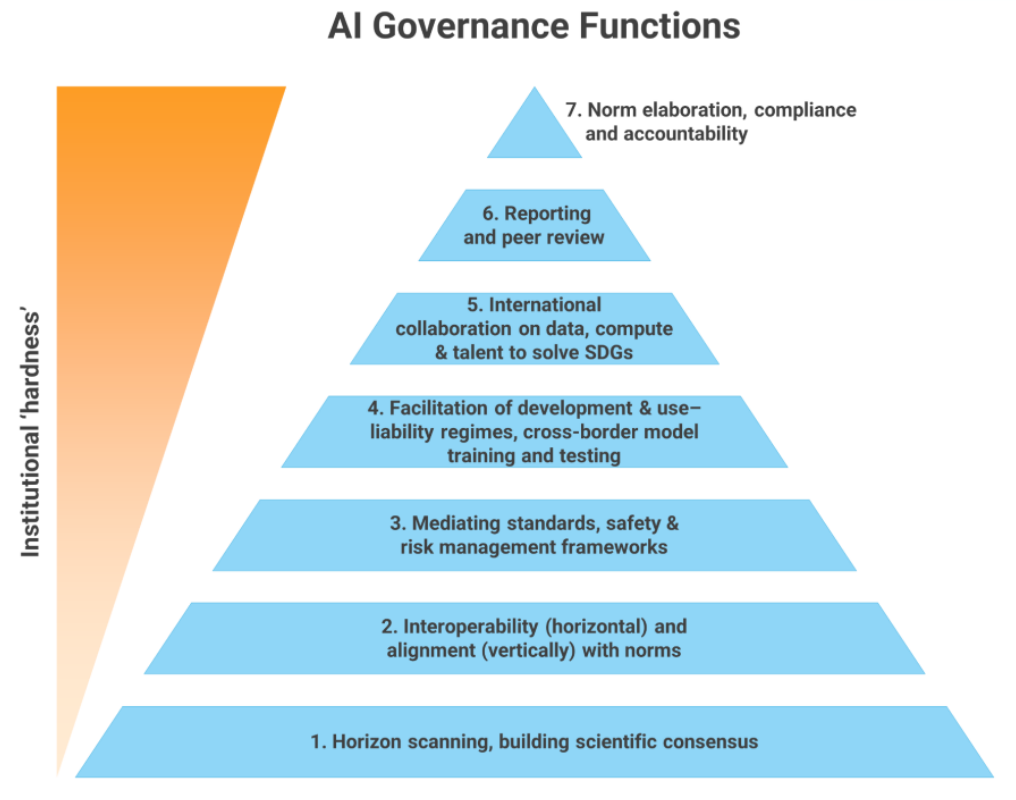

机构职能1:定期评估人工智能的未来方向和影响

机构职能2:通过在全球范围内认可的全球人工智能治理框架,加强全球治理工作的互操作性及其在国际规范中的基础(联合国)

机构职能3:制定和协调标准、安全和风险管理框架

机构功能4:通过国际合作促进人工智能的发展和使用,以实现经济和社会效益

机构功能5:促进人才发展、获取计算基础设施、建立各种高质量数据集和人工智能公共产品方面的国际合作,以实现可持续发展目标

机构职能6:监测风险,报告事件,协调应急响应

预计这些建议将在定于2024 年 8 月发布的最终报告中进一步发展和阐述。https://www.un.org/ai-advisory-bodyhttps://www.un.org/sites/un2.un.org/files/ai_advisory_body_interim_report.pdf

文案丨王昕晨 陶含孜

排版丨赵杨博

校审丨王祚

终审丨梁正 鲁俊群

清华大学人工智能国际治理研究院(Institute for AI International Governance, Tsinghua University,THU I-AIIG)是2020年4月由清华大学成立的校级科研机构。依托清华大学在人工智能与国际治理方面的已有积累和跨学科优势,研究院面向人工智能国际治理重大理论问题及政策需求开展研究,致力于提升清华在该领域的全球学术影响力和政策引领作用,为中国积极参与人工智能国际治理提供智力支撑。

新浪微博:@清华大学人工智能国际治理研究院

微信视频号:THU-AIIG

Bilibili:清华大学AIIG

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢